WildGaussians: 3D Gaussian Splatting in the Wild

作者: Jonas Kulhanek, Songyou Peng, Zuzana Kukelova, Marc Pollefeys, Torsten Sattler

分类: cs.CV

发布日期: 2024-07-11 (更新: 2024-10-31)

备注: NeurIPS 2024; Project page: https://wild-gaussians.github.io/

💡 一句话要点

WildGaussians:在复杂场景下实现高质量、实时3D高斯溅射

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 场景重建 复杂场景 DINO特征 外观建模

📋 核心要点

- NeRFs和3DGS在受控场景表现出色,但在遮挡、动态物体和光照变化等复杂场景中面临挑战。

- WildGaussians利用DINO特征和外观建模模块,增强3DGS处理复杂场景中遮挡和外观变化的能力。

- WildGaussians在保持3DGS实时渲染速度的同时,在复杂场景数据处理上超越了3DGS和NeRF等基线方法。

📝 摘要(中文)

由于其照片般逼真的质量,NeRFs 在 3D 场景重建领域占据主导地位。但最近,3D 高斯溅射 (3DGS) 崭露头角,它在提供类似质量的同时,实现了实时的渲染速度。然而,这两种方法主要在良好控制的 3D 场景中表现出色,而现实场景(以遮挡、动态对象和变化的光照为特征)仍然具有挑战性。NeRFs 可以通过每图像嵌入向量轻松适应这些条件,但 3DGS 由于其显式表示和缺乏共享参数而难以适应。为了解决这个问题,我们引入了 WildGaussians,这是一种处理 3DGS 中遮挡和外观变化的新方法。通过利用强大的 DINO 特征并在 3DGS 中集成外观建模模块,我们的方法实现了最先进的结果。我们证明 WildGaussians 匹配了 3DGS 的实时渲染速度,同时在处理现实场景数据方面超越了 3DGS 和 NeRF 基线,所有这些都在一个简单的架构框架内实现。

🔬 方法详解

问题定义:现有3DGS方法在处理真实场景数据时,由于场景中普遍存在的遮挡、动态物体和变化的光照条件,难以保持高质量的渲染效果。NeRFs虽然可以通过per-image embedding适应这些变化,但3DGS的显式表达和缺乏共享参数使其难以有效处理这些问题。

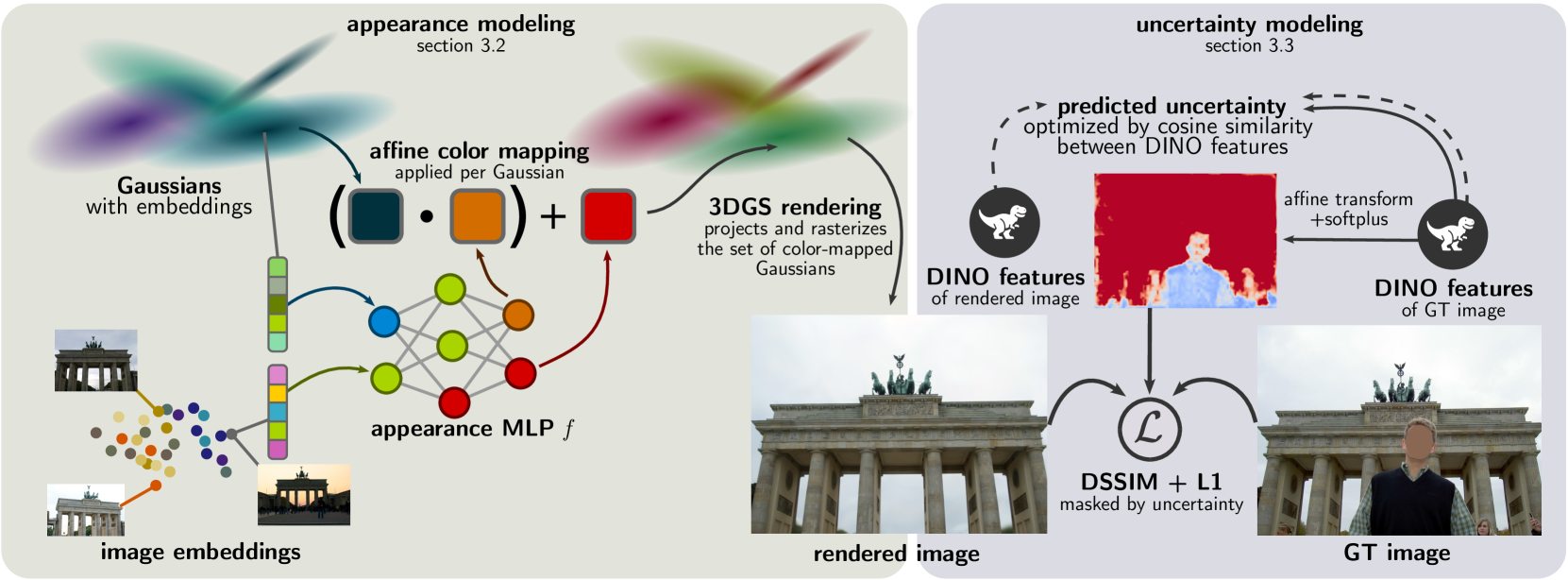

核心思路:WildGaussians的核心思路是通过引入DINO特征和外观建模模块,增强3DGS对复杂场景的适应能力。DINO特征提供了一种鲁棒的场景表示,可以有效应对遮挡和光照变化。外观建模模块则允许3DGS学习场景中不同视角和光照条件下的外观变化。

技术框架:WildGaussians的整体框架是在标准的3DGS基础上,增加了DINO特征提取和外观建模两个主要模块。首先,使用预训练的DINO模型提取图像特征。然后,将这些特征与3D高斯参数结合,输入到外观建模模块中,预测每个高斯在不同视角和光照条件下的颜色。最后,使用渲染模块将这些高斯投影到图像平面上,生成最终的渲染图像。

关键创新:WildGaussians的关键创新在于将DINO特征和外观建模模块集成到3DGS框架中,从而使其能够有效处理复杂场景中的遮挡和外观变化。与传统的3DGS方法相比,WildGaussians不再依赖于静态的场景表示,而是能够根据输入图像的特征动态调整高斯参数,从而更好地适应场景的变化。

关键设计:WildGaussians的关键设计包括:1) 使用预训练的DINO模型提取图像特征,避免了从头训练特征提取器的困难。2) 设计了一个轻量级的外观建模模块,用于预测每个高斯在不同视角和光照条件下的颜色。3) 使用了一种新的损失函数,鼓励外观建模模块学习到鲁棒的场景表示。

🖼️ 关键图片

📊 实验亮点

WildGaussians在复杂场景数据集上取得了显著的性能提升,在保持3DGS实时渲染速度的同时,超越了3DGS和NeRF等基线方法。实验结果表明,WildGaussians能够有效处理遮挡、动态物体和光照变化等问题,生成更加逼真和稳定的3D场景表示。具体性能数据未知,但摘要强调了其超越现有技术的能力。

🎯 应用场景

WildGaussians在自动驾驶、机器人导航、虚拟现实和增强现实等领域具有广泛的应用前景。它可以用于重建真实世界的复杂场景,并实现高质量、实时的渲染。例如,在自动驾驶中,WildGaussians可以用于构建高精度的3D地图,帮助车辆更好地理解周围环境。在虚拟现实中,它可以用于创建更加逼真的虚拟场景,提升用户的沉浸感。

📄 摘要(原文)

While the field of 3D scene reconstruction is dominated by NeRFs due to their photorealistic quality, 3D Gaussian Splatting (3DGS) has recently emerged, offering similar quality with real-time rendering speeds. However, both methods primarily excel with well-controlled 3D scenes, while in-the-wild data - characterized by occlusions, dynamic objects, and varying illumination - remains challenging. NeRFs can adapt to such conditions easily through per-image embedding vectors, but 3DGS struggles due to its explicit representation and lack of shared parameters. To address this, we introduce WildGaussians, a novel approach to handle occlusions and appearance changes with 3DGS. By leveraging robust DINO features and integrating an appearance modeling module within 3DGS, our method achieves state-of-the-art results. We demonstrate that WildGaussians matches the real-time rendering speed of 3DGS while surpassing both 3DGS and NeRF baselines in handling in-the-wild data, all within a simple architectural framework.