ScaleDepth: Decomposing Metric Depth Estimation into Scale Prediction and Relative Depth Estimation

作者: Ruijie Zhu, Chuxin Wang, Ziyang Song, Li Liu, Tianzhu Zhang, Yongdong Zhang

分类: cs.CV

发布日期: 2024-07-11

备注: 14 pages, 11 figure, 13 tables

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出ScaleDepth,将单目深度估计分解为尺度预测和相对深度估计,提升跨场景泛化性。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 单目深度估计 度量深度 尺度预测 相对深度估计 场景理解 深度学习 计算机视觉

📋 核心要点

- 现有度量深度估计方法在特定数据集上训练,难以泛化到尺度差异大的场景。

- ScaleDepth将度量深度分解为场景尺度和相对深度,分别使用SASP和ARDE模块预测。

- 实验表明,ScaleDepth在室内外等多种场景下均达到SOTA,无需针对特定场景进行调整。

📝 摘要(中文)

本文提出了一种新的单目深度估计方法ScaleDepth,旨在解决现有度量深度估计方法在具有显著尺度变化的场景中泛化能力不足的问题。ScaleDepth将度量深度分解为场景尺度和相对深度,并通过语义感知尺度预测(SASP)模块和自适应相对深度估计(ARDE)模块分别预测它们。SASP模块隐式地结合图像的结构和语义特征来预测精确的场景尺度。ARDE模块自适应地估计每个图像在归一化深度空间中的相对深度分布。该方法在统一的框架下实现了室内和室外场景的度量深度估计,无需设置深度范围或微调模型。大量实验表明,该方法在室内、室外、无约束和未见场景中均取得了最先进的性能。

🔬 方法详解

问题定义:现有的单目深度估计方法,尤其是在度量深度估计方面,往往依赖于特定数据集的训练,导致模型在面对具有显著尺度变化的场景时泛化能力较差。这些方法通常难以适应室内和室外场景之间的尺度差异,需要针对不同场景进行微调或设置深度范围,限制了其在实际应用中的灵活性和通用性。

核心思路:ScaleDepth的核心思路是将度量深度估计问题分解为两个子问题:场景尺度预测和相对深度估计。通过分别解决这两个问题,可以更好地处理不同场景下的尺度变化。场景尺度反映了场景的整体大小,而相对深度则描述了场景中物体之间的深度关系。这种分解方式使得模型可以独立地学习场景尺度和相对深度,从而提高泛化能力。

技术框架:ScaleDepth的整体框架包含两个主要模块:语义感知尺度预测(SASP)模块和自适应相对深度估计(ARDE)模块。SASP模块负责预测场景的尺度,它利用图像的结构和语义信息来估计场景的整体大小。ARDE模块负责估计图像的相对深度分布,它将深度值归一化到[0,1]范围内,并自适应地学习每个图像的相对深度关系。这两个模块的输出最终被组合起来,得到度量深度估计结果。

关键创新:ScaleDepth的关键创新在于将度量深度估计分解为尺度预测和相对深度估计,并设计了相应的SASP和ARDE模块。SASP模块通过结合结构和语义特征来预测精确的场景尺度,而ARDE模块则自适应地估计每个图像的相对深度分布。这种分解方式使得模型可以更好地处理不同场景下的尺度变化,从而提高泛化能力。与现有方法相比,ScaleDepth无需针对特定场景进行微调或设置深度范围,具有更好的通用性。

关键设计:SASP模块的具体网络结构未知,但强调了对结构和语义特征的结合。ARDE模块的关键设计在于将深度值归一化到[0,1]范围内,并自适应地学习每个图像的相对深度关系。损失函数的设计也至关重要,可能包含尺度预测损失和相对深度估计损失,以及用于约束两者一致性的损失项。具体的参数设置和网络结构细节需要在论文原文中查找。

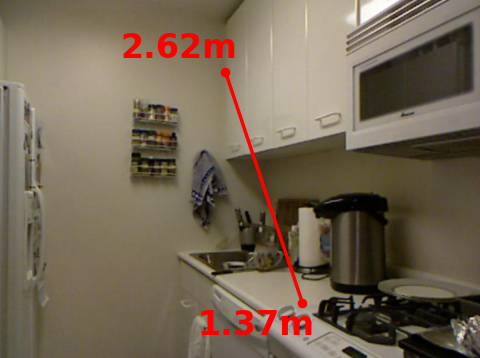

🖼️ 关键图片

📊 实验亮点

ScaleDepth在多个数据集上取得了state-of-the-art的性能,包括室内、室外、无约束和未见场景。具体的性能数据需要在论文原文中查找,但摘要中强调了其在跨场景泛化能力方面的优势。该方法无需针对特定场景进行微调或设置深度范围,具有更好的通用性。

🎯 应用场景

ScaleDepth在机器人导航、自动驾驶、增强现实等领域具有广泛的应用前景。它可以帮助机器人和自动驾驶系统更好地理解周围环境的深度信息,从而实现更安全、更可靠的导航和驾驶。在增强现实领域,ScaleDepth可以用于创建更逼真的虚拟场景,并实现虚拟物体与真实场景的自然交互。此外,该方法还可以应用于三维重建、场景理解等领域。

📄 摘要(原文)

Estimating depth from a single image is a challenging visual task. Compared to relative depth estimation, metric depth estimation attracts more attention due to its practical physical significance and critical applications in real-life scenarios. However, existing metric depth estimation methods are typically trained on specific datasets with similar scenes, facing challenges in generalizing across scenes with significant scale variations. To address this challenge, we propose a novel monocular depth estimation method called ScaleDepth. Our method decomposes metric depth into scene scale and relative depth, and predicts them through a semantic-aware scale prediction (SASP) module and an adaptive relative depth estimation (ARDE) module, respectively. The proposed ScaleDepth enjoys several merits. First, the SASP module can implicitly combine structural and semantic features of the images to predict precise scene scales. Second, the ARDE module can adaptively estimate the relative depth distribution of each image within a normalized depth space. Third, our method achieves metric depth estimation for both indoor and outdoor scenes in a unified framework, without the need for setting the depth range or fine-tuning model. Extensive experiments demonstrate that our method attains state-of-the-art performance across indoor, outdoor, unconstrained, and unseen scenes. Project page: https://ruijiezhu94.github.io/ScaleDepth