DSCENet: Dynamic Screening and Clinical-Enhanced Multimodal Fusion for MPNs Subtype Classification

作者: Yuan Zhang, Yaolei Qi, Xiaoming Qi, Yongyue Wei, Guanyu Yang

分类: eess.IV, cs.CV

发布日期: 2024-07-11

备注: Accepted by MICCAI2024

🔗 代码/项目: GITHUB

💡 一句话要点

DSCENet:动态筛选与临床增强的多模态融合用于MPNs亚型分类

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 骨髓增生性肿瘤 亚型分类 多模态融合 全切片图像 临床信息

📋 核心要点

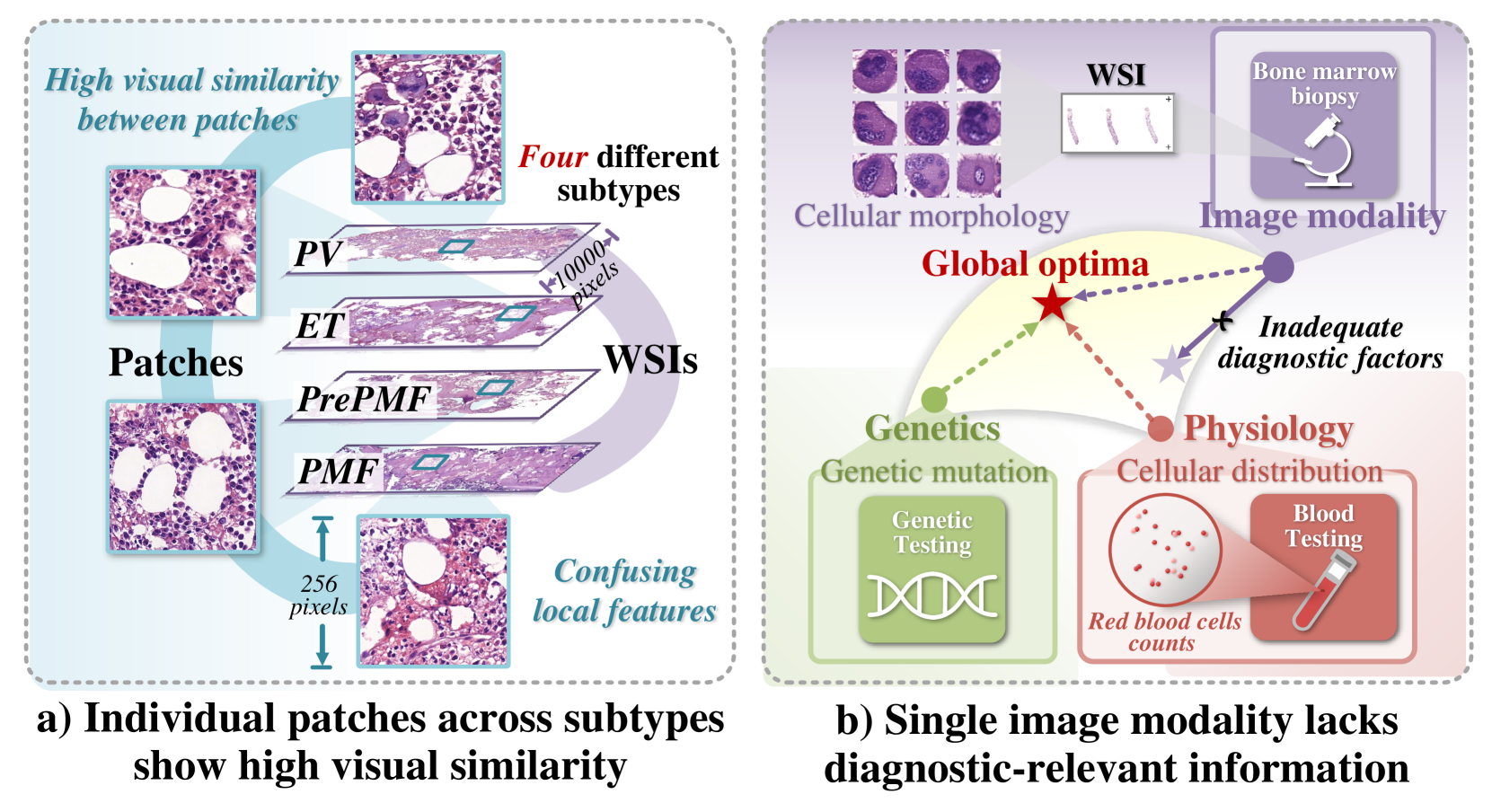

- 现有方法在MPNs亚型分类中,难以有效利用局部病灶的诊断代表性,且单一模态信息不足。

- DSCENet通过动态筛选模块自适应学习局部病灶特征,并利用临床增强融合模块整合多模态信息。

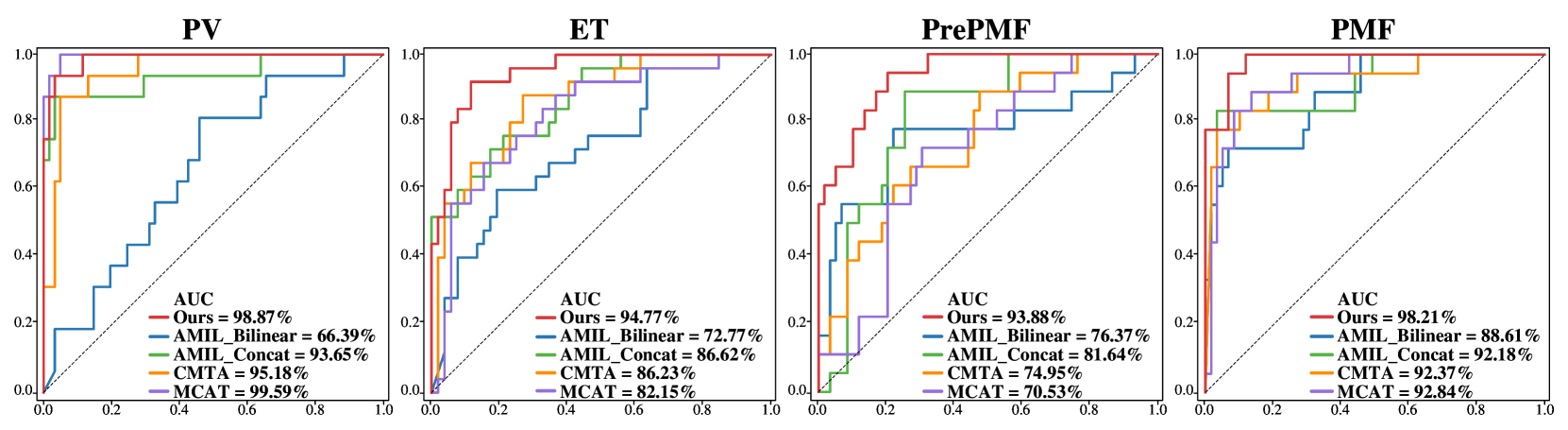

- 实验结果表明,DSCENet在MPNs亚型分类任务中,AUC提升7.91%,准确率提升16.89%。

📝 摘要(中文)

基于多模态信息对骨髓增生性肿瘤(MPNs)进行精确的亚型分类,对临床医生进行诊断和长期治疗方案的制定具有重要的临床意义。然而,由于局部病灶缺乏诊断代表性以及单一模态缺乏诊断相关特征,这仍然是一个巨大的挑战。本文提出了一种动态筛选和临床增强网络(DSCENet),用于在全切片图像(WSI)和临床信息的多模态融合上进行MPNs亚型分类。(1) 提出了一种动态筛选模块,以灵活地适应局部病灶的特征学习,减少无关特征的干扰,并增强其诊断代表性。(2) 提出了一种临床增强融合模块,以整合临床指标,探索跨模态的互补特征,提供全面的诊断信息。我们的方法已在真实的临床数据上得到验证,与先前的最先进(SOTA)方法相比,AUC提高了7.91%,准确率提高了16.89%。代码可在https://github.com/yuanzhang7/DSCENet获得。

🔬 方法详解

问题定义:论文旨在解决骨髓增生性肿瘤(MPNs)亚型分类问题。现有方法主要痛点在于,全切片图像(WSI)的局部病灶缺乏诊断代表性,容易受到无关特征的干扰,且单一模态(如仅WSI)的信息不足以进行准确分类。临床信息虽然重要,但如何有效融合到模型中是一个挑战。

核心思路:论文的核心思路是利用动态筛选模块增强局部病灶的诊断代表性,减少无关特征的干扰,并利用临床增强融合模块整合WSI和临床信息,从而实现更准确的MPNs亚型分类。通过动态调整局部patch的学习权重,使模型更加关注具有诊断意义的区域。

技术框架:DSCENet的整体框架包含两个主要模块:动态筛选模块和临床增强融合模块。首先,WSI经过预处理和特征提取,然后输入到动态筛选模块,该模块自适应地调整局部病灶的特征学习。接着,临床信息与筛选后的WSI特征通过临床增强融合模块进行整合,生成最终的分类结果。

关键创新:论文的关键创新在于动态筛选模块和临床增强融合模块的设计。动态筛选模块能够根据局部病灶的诊断相关性动态调整特征学习的权重,从而提高诊断代表性。临床增强融合模块则有效地整合了临床信息,弥补了单一模态信息的不足。与现有方法相比,DSCENet能够更有效地利用多模态信息进行MPNs亚型分类。

关键设计:动态筛选模块的具体实现细节未知,但可以推测其可能使用了注意力机制或者其他动态权重调整方法。临床增强融合模块的具体融合方式也未知,可能采用了concat、加权融合或者更复杂的网络结构。损失函数方面,论文可能使用了交叉熵损失函数或者其他适用于多分类问题的损失函数。具体的网络结构细节和参数设置需要在论文原文或代码中进一步分析。

🖼️ 关键图片

📊 实验亮点

DSCENet在真实的临床数据上进行了验证,实验结果表明,与先前的最先进(SOTA)方法相比,DSCENet的AUC提高了7.91%,准确率提高了16.89%。这表明DSCENet能够有效地利用多模态信息进行MPNs亚型分类,显著提升了分类性能。

🎯 应用场景

该研究成果可应用于临床辅助诊断,帮助医生更准确地对骨髓增生性肿瘤(MPNs)进行亚型分类,从而制定更有效的治疗方案。该方法具有推广潜力,可扩展到其他需要多模态数据融合的医学图像分析任务中,例如肿瘤分期、疾病预测等,具有重要的临床应用价值。

📄 摘要(原文)

The precise subtype classification of myeloproliferative neoplasms (MPNs) based on multimodal information, which assists clinicians in diagnosis and long-term treatment plans, is of great clinical significance. However, it remains a great challenging task due to the lack of diagnostic representativeness for local patches and the absence of diagnostic-relevant features from a single modality. In this paper, we propose a Dynamic Screening and Clinical-Enhanced Network (DSCENet) for the subtype classification of MPNs on the multimodal fusion of whole slide images (WSIs) and clinical information. (1) A dynamic screening module is proposed to flexibly adapt the feature learning of local patches, reducing the interference of irrelevant features and enhancing their diagnostic representativeness. (2) A clinical-enhanced fusion module is proposed to integrate clinical indicators to explore complementary features across modalities, providing comprehensive diagnostic information. Our approach has been validated on the real clinical data, achieving an increase of 7.91% AUC and 16.89% accuracy compared with the previous state-of-the-art (SOTA) methods. The code is available at https://github.com/yuanzhang7/DSCENet.