Hybrid Structure-from-Motion and Camera Relocalization for Enhanced Egocentric Localization

作者: Jinjie Mai, Abdullah Hamdi, Silvio Giancola, Chen Zhao, Bernard Ghanem

分类: cs.CV

发布日期: 2024-07-10

备注: 1st place winner of the 2024 Ego4D-Ego-Exo4D Challenge in VQ3D

🔗 代码/项目: GITHUB

💡 一句话要点

提出混合结构光重建与相机重定位以增强自我中心定位

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 自我中心定位 结构光重建 相机重定位 2D-3D匹配 模型集成策略

📋 核心要点

- 现有方法在自我中心视频的相机姿态估计上存在准确性不足的问题,限制了定位效果。

- 论文提出了一种混合结构光重建与相机重定位的策略,通过2D-3D匹配提升相机姿态估计的准确性。

- 实验结果显示,EgoLoc-v1在整体成功率上超越了竞争对手EgoLoc,提升幅度为1.5%,表现出色。

📝 摘要(中文)

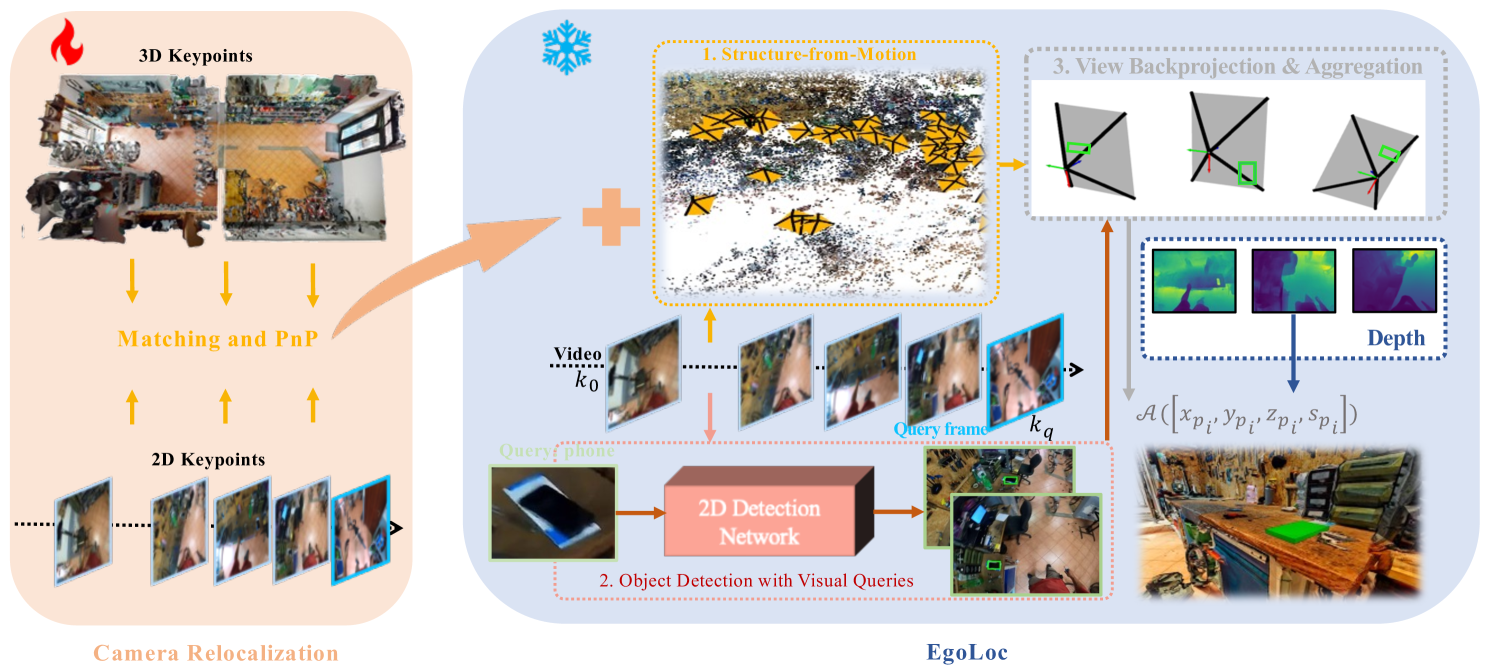

我们构建了EgoLoc-v1管道,主要受到EgoLoc的启发。我们提出了一种模型集成策略,以改善VQ3D任务中的相机姿态估计部分,这在之前的工作中被证明是至关重要的。核心思想不仅是对自我中心视频进行结构光重建(SfM),还要在现有的3D扫描与2D视频帧之间进行2D-3D匹配。通过这种方式,我们建立了一个混合SfM和相机重定位的管道,能够提供更多的相机姿态,从而提高QwP和整体成功率。我们的方法在最重要的指标——整体成功率上达到了最佳性能,超越了之前的最先进技术EgoLoc,提升幅度为1.5%。代码可在https://github.com/Wayne-Mai/egoloc_v1获取。

🔬 方法详解

问题定义:本论文旨在解决自我中心视频中相机姿态估计的准确性不足问题。现有方法在处理复杂场景时,往往无法提供足够的相机位置信息,导致定位效果不佳。

核心思路:论文的核心思路是结合结构光重建(SfM)与相机重定位,通过对2D视频帧与现有3D扫描进行匹配,提升相机姿态估计的准确性。这种混合方法能够有效利用已有的3D信息,增强定位的可靠性。

技术框架:整体架构包括两个主要模块:首先是对自我中心视频进行SfM处理,提取相机的初步姿态;其次是通过2D-3D匹配进一步优化相机姿态,确保最终输出的准确性和稳定性。

关键创新:最重要的技术创新在于提出了模型集成策略,结合了SfM与相机重定位的优势。这一方法与现有的单一SfM或重定位方法相比,能够提供更丰富的相机姿态信息,从而显著提高定位成功率。

关键设计:在参数设置上,论文采用了优化的损失函数以平衡2D-3D匹配的精度与SfM的稳定性。此外,网络结构设计上,结合了多种特征提取方法,以增强对复杂场景的适应能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,EgoLoc-v1在整体成功率上达到了最佳性能,超越了竞争对手EgoLoc,提升幅度为1.5%。这一结果展示了混合SfM与相机重定位方法在自我中心定位任务中的有效性,具有显著的实用价值。

🎯 应用场景

该研究的潜在应用领域包括虚拟现实、增强现实和机器人导航等。通过提高自我中心定位的准确性,能够为这些领域提供更可靠的定位基础,进而提升用户体验和系统性能。未来,该方法可能在自动驾驶和智能家居等新兴领域中发挥重要作用。

📄 摘要(原文)

We built our pipeline EgoLoc-v1, mainly inspired by EgoLoc. We propose a model ensemble strategy to improve the camera pose estimation part of the VQ3D task, which has been proven to be essential in previous work. The core idea is not only to do SfM for egocentric videos but also to do 2D-3D matching between existing 3D scans and 2D video frames. In this way, we have a hybrid SfM and camera relocalization pipeline, which can provide us with more camera poses, leading to higher QwP and overall success rate. Our method achieves the best performance regarding the most important metric, the overall success rate. We surpass previous state-of-the-art, the competitive EgoLoc, by $1.5\%$. The code is available at \url{https://github.com/Wayne-Mai/egoloc_v1}.