VIMI: Grounding Video Generation through Multi-modal Instruction

作者: Yuwei Fang, Willi Menapace, Aliaksandr Siarohin, Tsai-Shien Chen, Kuan-Chien Wang, Ivan Skorokhodov, Graham Neubig, Sergey Tulyakov

分类: cs.CV, cs.AI, cs.CL

发布日期: 2024-07-08

💡 一句话要点

VIMI:通过多模态指令实现视频生成中的视觉 grounding

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频生成 多模态学习 视觉 Grounding 扩散模型 文本到视频 多模态指令 UCF101

📋 核心要点

- 现有文本到视频模型依赖纯文本编码,缺乏大规模多模态数据支持,导致视觉 grounding 不足,限制了其应用。

- 论文提出一种两阶段训练策略,首先构建多模态数据集进行预训练,然后微调模型以处理多模态指令,实现 grounded 视频生成。

- VIMI 在生成具有大运动的连贯视频方面表现出色,并在 UCF101 基准测试中取得了最先进的文本到视频生成结果。

📝 摘要(中文)

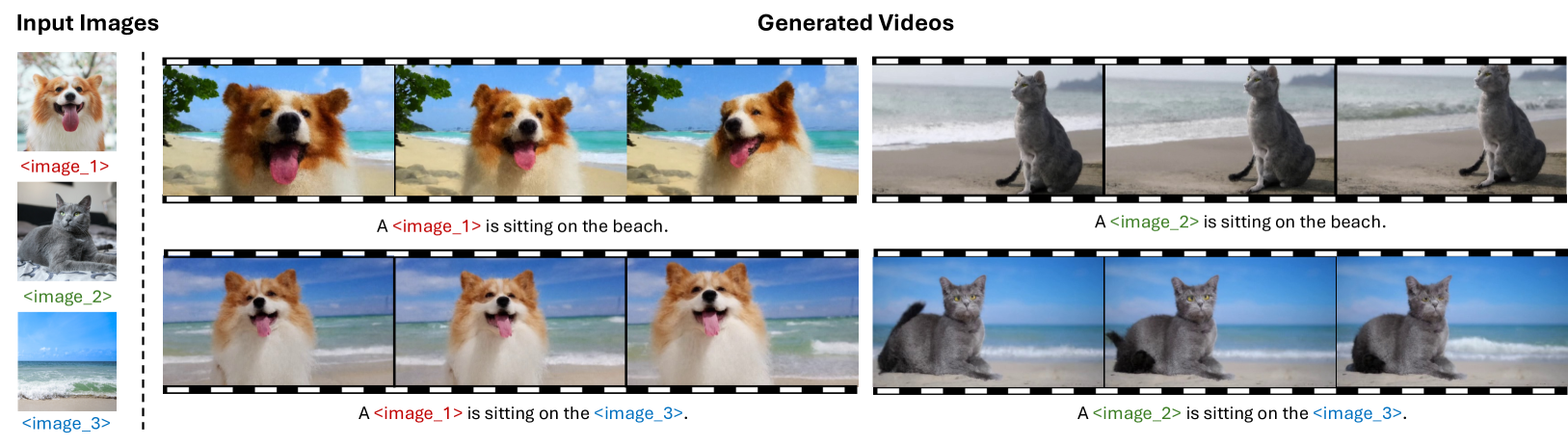

现有的文本到视频扩散模型主要依赖于纯文本编码器进行预训练。这种局限性源于缺乏大规模的多模态提示视频数据集,导致视觉 grounding 的不足,并限制了它们在多模态集成中的通用性和应用。为了解决这个问题,我们构建了一个大规模的多模态提示数据集,通过检索方法将上下文示例与给定的文本提示配对,然后采用两阶段训练策略,使同一个模型能够处理各种视频生成任务。在第一阶段,我们提出了一个多模态条件视频生成框架,用于在这些增强的数据集上进行预训练,从而为 grounded 视频生成建立一个基础模型。其次,我们将第一阶段的模型在三个视频生成任务上进行微调,整合多模态指令。这个过程进一步提高了模型处理各种输入和任务的能力,确保多模态信息的无缝集成。经过这两个阶段的训练,VIMI 展示了多模态理解能力,生成了基于输入、上下文丰富且个性化的视频,如图1所示。与以往的视觉 grounded 视频生成方法相比,VIMI 能够合成具有大运动且一致和时间连贯的视频,同时保持语义控制。最后,VIMI 还在 UCF101 基准测试中取得了最先进的文本到视频生成结果。

🔬 方法详解

问题定义:现有文本到视频生成模型主要依赖于文本信息,缺乏对视觉信息的有效利用,导致生成的视频在视觉内容上与文本描述的关联性较弱,即缺乏视觉 grounding。同时,缺乏大规模的多模态数据集限制了模型在多模态场景下的应用能力。现有方法难以生成具有复杂动作和时间连贯性的视频,且语义控制能力有限。

核心思路:论文的核心思路是通过构建大规模多模态数据集,并采用两阶段训练策略,使模型能够同时理解和利用文本和视觉信息,从而实现视觉 grounded 的视频生成。通过检索方法将文本提示与相关的视觉上下文示例配对,增强模型的视觉理解能力。两阶段训练分别关注基础的 grounded 视频生成和多模态指令的整合。

技术框架:VIMI 的整体框架包含两个主要阶段:预训练阶段和微调阶段。在预训练阶段,模型在一个大规模的多模态数据集上进行训练,该数据集包含文本提示和对应的视觉上下文示例。模型学习如何根据文本和视觉信息生成视频。在微调阶段,模型在三个视频生成任务上进行微调,这些任务涉及多模态指令。微调过程进一步提升了模型处理各种输入和任务的能力。

关键创新:VIMI 的关键创新在于构建了一个大规模的多模态数据集,并提出了一个两阶段训练策略,有效地提升了视频生成的视觉 grounding 能力。与现有方法相比,VIMI 能够生成具有更大运动幅度、更高时间连贯性和更好语义控制的视频。此外,VIMI 能够处理多模态指令,使其在多模态场景下具有更强的适应性。

关键设计:论文使用了检索方法来构建多模态数据集,具体检索策略未知。两阶段训练的具体损失函数和网络结构细节未知,但强调了多模态信息的融合和利用。模型可能采用了某种形式的注意力机制或交叉注意力机制来实现文本和视觉信息之间的交互。

🖼️ 关键图片

📊 实验亮点

VIMI 在 UCF101 基准测试中取得了最先进的文本到视频生成结果,表明其在生成高质量视频方面具有显著优势。与现有的视觉 grounded 视频生成方法相比,VIMI 能够生成具有更大运动幅度、更高时间连贯性和更好语义控制的视频,证明了其在视觉 grounding 方面的有效性。具体的性能数据和提升幅度未知。

🎯 应用场景

VIMI 的潜在应用领域包括视频编辑、内容创作、虚拟现实和增强现实等。它可以用于根据文本描述或视觉示例自动生成视频内容,从而提高视频制作的效率和质量。此外,VIMI 还可以应用于人机交互领域,例如,用户可以通过语音或手势指令来控制视频的生成过程。未来,VIMI 有望成为一种强大的视频生成工具,为各行各业带来创新和变革。

📄 摘要(原文)

Existing text-to-video diffusion models rely solely on text-only encoders for their pretraining. This limitation stems from the absence of large-scale multimodal prompt video datasets, resulting in a lack of visual grounding and restricting their versatility and application in multimodal integration. To address this, we construct a large-scale multimodal prompt dataset by employing retrieval methods to pair in-context examples with the given text prompts and then utilize a two-stage training strategy to enable diverse video generation tasks within the same model. In the first stage, we propose a multimodal conditional video generation framework for pretraining on these augmented datasets, establishing a foundational model for grounded video generation. Secondly, we finetune the model from the first stage on three video generation tasks, incorporating multi-modal instructions. This process further refines the model's ability to handle diverse inputs and tasks, ensuring seamless integration of multi-modal information. After this two-stage train-ing process, VIMI demonstrates multimodal understanding capabilities, producing contextually rich and personalized videos grounded in the provided inputs, as shown in Figure 1. Compared to previous visual grounded video generation methods, VIMI can synthesize consistent and temporally coherent videos with large motion while retaining the semantic control. Lastly, VIMI also achieves state-of-the-art text-to-video generation results on UCF101 benchmark.