ZARRIO @ Ego4D Short Term Object Interaction Anticipation Challenge: Leveraging Affordances and Attention-based models for STA

作者: Lorenzo Mur-Labadia, Ruben Martinez-Cantin, Josechu Guerrero-Campo, Giovanni Maria Farinella

分类: cs.CV

发布日期: 2024-07-05

备注: arXiv admin note: substantial text overlap with arXiv:2406.01194

💡 一句话要点

提出STAformer,融合环境认知与注意力机制,提升Ego4D短时物体交互预测性能。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 短时物体交互预测 第一人称视角视频 注意力机制 环境可供性 交互热点预测

📋 核心要点

- 现有短时物体交互预测方法难以有效利用环境信息和人类行为先验知识。

- STAformer通过整合环境可供性模型和交互热点预测,显式地建模了环境和人类行为对交互的影响。

- 实验表明,STAformer在Ego4D数据集上取得了显著的性能提升,验证了所提出方法的有效性。

📝 摘要(中文)

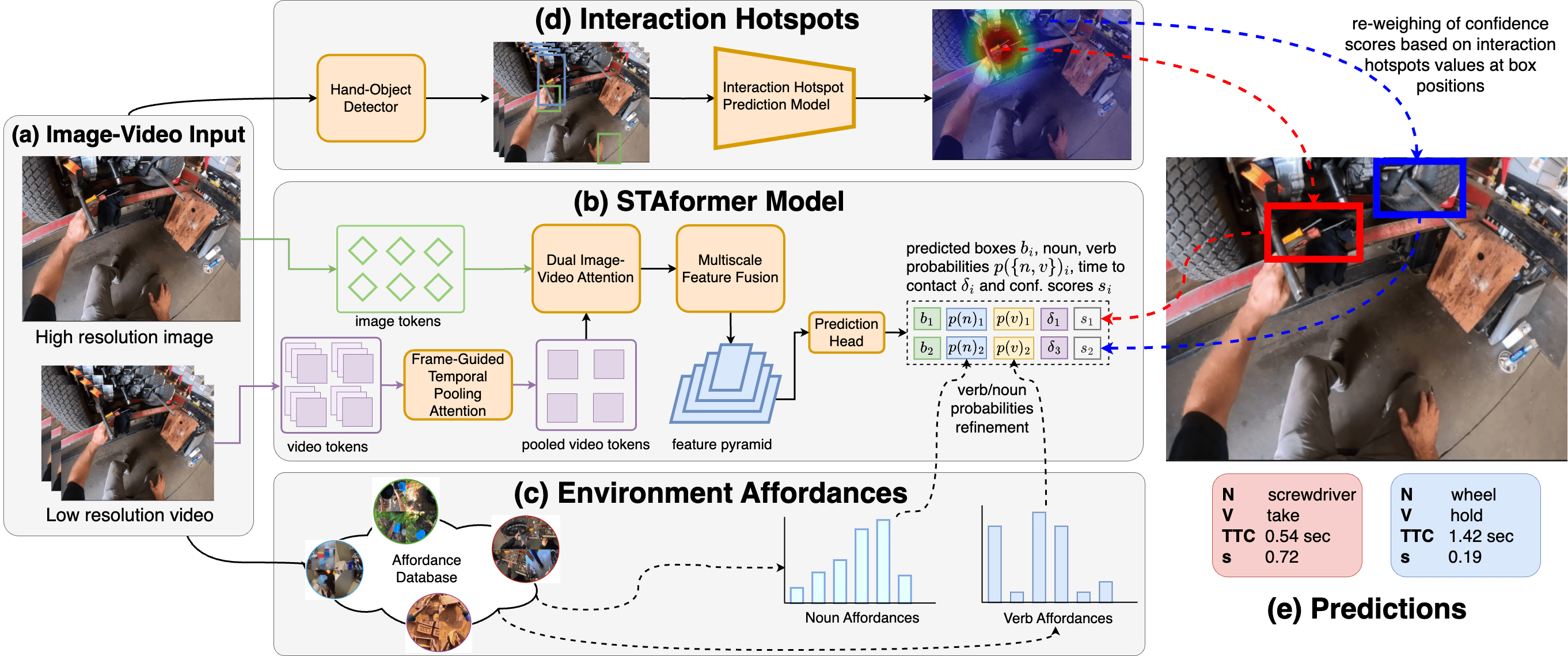

本文提出了一种名为STAformer的新型基于注意力的架构,用于短时物体交互预测(STA)任务。该架构集成了帧引导的时间池化、双重图像-视频注意力以及多尺度特征融合,从而支持从图像输入视频对中进行STA预测。此外,本文还引入了两个新模块,通过对可供性进行建模,将STA预测建立在人类行为的基础上。首先,集成了一个环境可供性模型,该模型充当给定物理场景中可能发生的交互的持久记忆。其次,通过观察手和物体轨迹来预测交互热点,从而提高对位于热点周围的STA预测的置信度。在v2训练数据集上训练后,我们的结果在测试集上获得了33.5 N mAP、17.25 N+V mAP、11.77 N+δ mAP和6.75 Overall top-5 mAP。

🔬 方法详解

问题定义:短时物体交互预测(STA)旨在从第一人称视角视频中预测下一个交互物体的类别、交互动作以及交互发生的时间。现有方法通常缺乏对环境上下文和人类行为模式的有效建模,导致预测精度受限。

核心思路:本文的核心思路是利用环境可供性(Affordance)和注意力机制来提升STA预测的准确性。通过环境可供性模型,学习不同场景下常见的交互模式,作为先验知识指导预测。同时,通过注意力机制,聚焦于与交互相关的图像和视频特征,提高特征表达能力。

技术框架:STAformer的整体架构包含以下几个主要模块:1) 帧引导的时间池化:用于提取视频的时序特征。2) 双重图像-视频注意力:用于融合图像和视频特征,并突出与交互相关的区域。3) 多尺度特征融合:用于整合不同尺度的特征信息,提高预测的鲁棒性。4) 环境可供性模型:用于提供场景级别的交互先验知识。5) 交互热点预测:用于预测交互可能发生的区域,进一步提升预测精度。

关键创新:本文的关键创新在于:1) 提出了STAformer,一种基于注意力机制的端到端STA预测模型。2) 引入了环境可供性模型,显式地建模了环境对交互的影响。3) 提出了交互热点预测模块,利用手部和物体轨迹信息,提高预测的置信度。

关键设计:环境可供性模型通过学习场景图像和交互类别之间的关联关系来实现。交互热点预测模块通过回归手部和物体轨迹的heatmap来实现。损失函数包括交互类别预测损失、交互动作预测损失、交互时间预测损失以及热点预测损失。网络结构采用Transformer架构,并针对STA任务进行了优化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,STAformer在Ego4D数据集上取得了显著的性能提升。与现有方法相比,N mAP指标提升至33.5,N+V mAP指标提升至17.25,N+δ mAP指标提升至11.77,Overall top-5 mAP指标提升至6.75。这些结果验证了所提出的环境可供性模型和注意力机制的有效性。

🎯 应用场景

该研究成果可应用于机器人辅助、智能家居、虚拟现实等领域。例如,机器人可以利用该技术预测人类的交互意图,从而提供更智能的辅助服务。在智能家居中,系统可以根据用户的行为预测其下一步操作,提前准备相关设备或服务。在虚拟现实中,可以根据用户的交互行为,动态调整场景内容,提供更沉浸式的体验。

📄 摘要(原文)

Short-Term object-interaction Anticipation (STA) consists of detecting the location of the next-active objects, the noun and verb categories of the interaction, and the time to contact from the observation of egocentric video. We propose STAformer, a novel attention-based architecture integrating frame-guided temporal pooling, dual image-video attention, and multi-scale feature fusion to support STA predictions from an image-input video pair. Moreover, we introduce two novel modules to ground STA predictions on human behavior by modeling affordances. First, we integrate an environment affordance model which acts as a persistent memory of interactions that can take place in a given physical scene. Second, we predict interaction hotspots from the observation of hands and object trajectories, increasing confidence in STA predictions localized around the hotspot. On the test set, our results obtain a final 33.5 N mAP, 17.25 N+V mAP, 11.77 N+δ mAP and 6.75 Overall top-5 mAP metric when trained on the v2 training dataset.