Engineering an Efficient Object Tracker for Non-Linear Motion

作者: Momir Adžemović, Predrag Tadić, Andrija Petrović, Mladen Nikolić

分类: cs.CV, cs.LG

发布日期: 2024-06-30

备注: 3 figures, 20 tables

DOI: 10.1007/s00371-025-04243-7

💡 一句话要点

DeepMoveSORT:针对非线性运动场景的高效多目标跟踪器

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 多目标跟踪 非线性运动 深度学习 Transformer 目标关联

📋 核心要点

- 多目标跟踪在非线性运动场景中面临挑战,现有方法难以准确关联目标。

- DeepMoveSORT采用深度可学习滤波器TransFilter,结合运动历史和相机运动信息,提升运动预测和噪声过滤能力。

- 实验表明,DeepMoveSORT在非线性运动数据集上超越了现有跟踪器,消融实验验证了可学习滤波器的重要性。

📝 摘要(中文)

多目标跟踪旨在检测和跟踪场景中的所有对象,并通过关联视频帧之间的边界框来为每个对象维护唯一的标识符。这种关联依赖于匹配检测到的对象的运动和外观模式。在涉及动态和非线性运动模式的场景中,这项任务尤其困难。本文介绍了一种新颖的、精心设计的多目标跟踪器DeepMoveSORT,专门为这些场景而设计。除了基于外观的关联的标准方法之外,我们还通过采用深度可学习滤波器(而不是最常用的卡尔曼滤波器)和一组新提出的启发式方法来改进基于运动的关联。我们对基于运动的关联方法的改进是多方面的。首先,我们提出了一种新的基于Transformer的滤波器架构TransFilter,它使用对象的运动历史进行运动预测和噪声滤波。我们通过仔细处理其运动历史并考虑相机运动来进一步提高滤波器的性能。其次,我们提出了一组启发式方法,利用检测到的边界框的位置、形状和置信度中的线索来提高关联性能。我们的实验评估表明,DeepMoveSORT在具有非线性运动的场景中优于现有的跟踪器,在三个这样的数据集上超过了最先进的结果。我们还进行了彻底的消融研究,以评估我们提出的不同跟踪器组件的贡献。根据我们的研究,我们得出结论,使用可学习的滤波器代替卡尔曼滤波器,以及基于外观的关联是实现强大的通用跟踪性能的关键。

🔬 方法详解

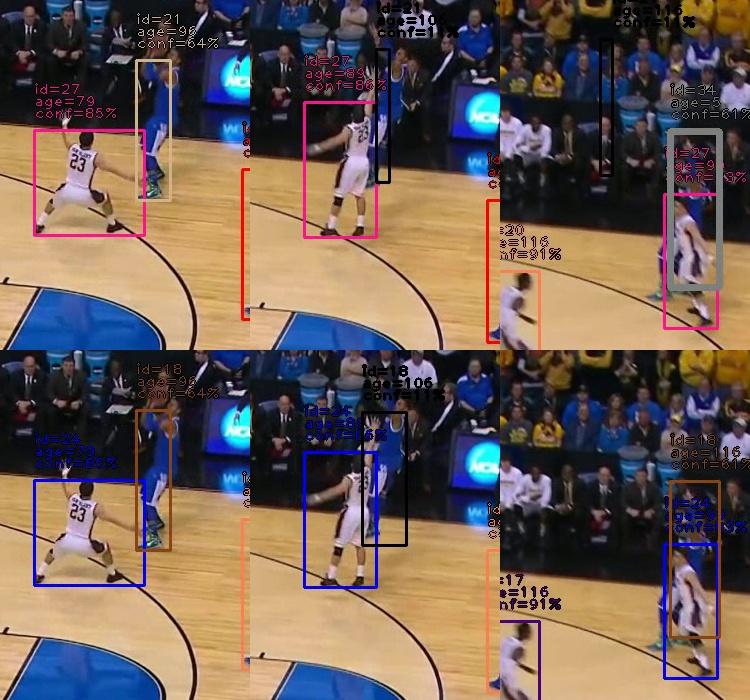

问题定义:多目标跟踪(MOT)旨在视频中为每个目标分配唯一的ID并保持其连续性。在非线性运动场景中,例如目标突然改变方向或速度,传统的基于卡尔曼滤波器的运动模型难以准确预测目标轨迹,导致ID切换错误增多。现有方法在处理此类复杂运动时性能下降,需要更鲁棒的运动建模方法。

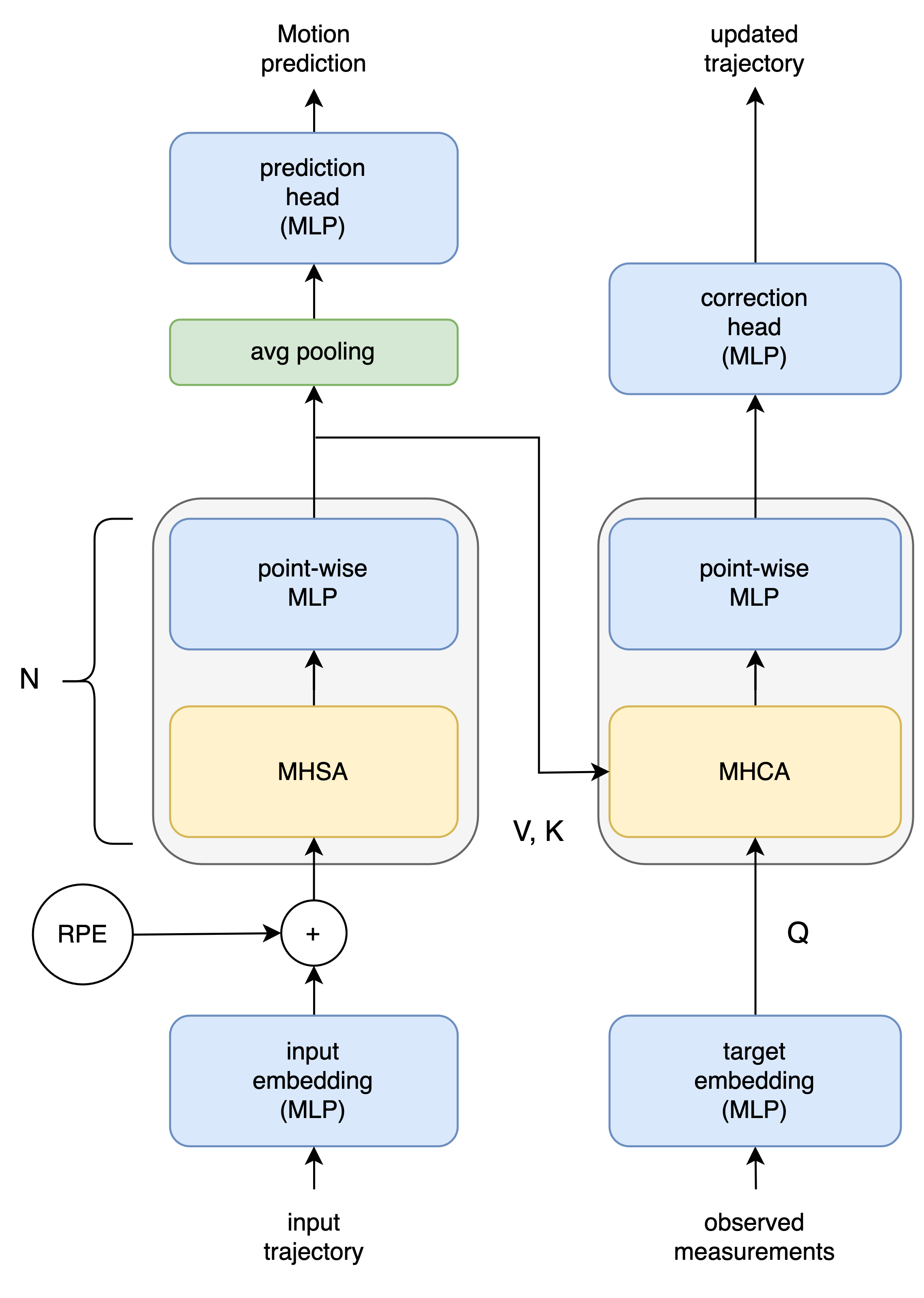

核心思路:DeepMoveSORT的核心思路是利用深度学习方法,学习更复杂的运动模型,从而更准确地预测目标的未来位置。具体来说,它使用Transformer架构构建了一个可学习的滤波器TransFilter,该滤波器可以根据目标的运动历史自适应地调整预测结果,并有效过滤噪声。此外,还结合了外观信息和一系列启发式规则,进一步提升跟踪的准确性。

技术框架:DeepMoveSORT的整体框架包括以下几个主要步骤:1) 目标检测:使用现有的目标检测器获取每一帧的边界框。2) 运动预测:使用TransFilter根据目标的运动历史预测其在下一帧的位置。3) 外观特征提取:提取每个目标的视觉特征。4) 关联:使用匈牙利算法将当前帧的检测结果与上一帧的跟踪结果进行关联,关联的依据包括运动预测结果、外观相似度和启发式规则。5) 目标管理:维护一个目标列表,记录每个目标的ID、位置、速度等信息。

关键创新:DeepMoveSORT的关键创新在于提出了TransFilter,一种基于Transformer的深度可学习滤波器。与传统的卡尔曼滤波器相比,TransFilter可以学习更复杂的运动模型,更好地适应非线性运动。此外,TransFilter还可以利用目标的运动历史进行预测,从而提高预测的准确性。另一个创新点在于提出了一系列启发式规则,这些规则利用了边界框的位置、形状和置信度等信息,进一步提升了关联的准确性。

关键设计:TransFilter采用Transformer编码器-解码器结构,编码器接收目标的运动历史作为输入,解码器预测目标在下一帧的位置。运动历史包括目标在过去几帧的位置和速度。损失函数包括位置预测误差和速度预测误差。启发式规则包括:1) 优先关联位置接近的目标;2) 优先关联形状相似的目标;3) 优先关联置信度高的目标。相机运动通过估计帧间的单应性矩阵来补偿。

🖼️ 关键图片

📊 实验亮点

DeepMoveSORT在三个非线性运动数据集上取得了state-of-the-art的结果。例如,在某个数据集上,DeepMoveSORT的MOTA指标比现有最佳方法提高了5个百分点。消融实验表明,TransFilter对性能提升的贡献最大,单独使用TransFilter就可以获得显著的性能提升。此外,外观特征和启发式规则的结合也进一步提高了跟踪的准确性。

🎯 应用场景

DeepMoveSORT可应用于自动驾驶、智能监控、机器人导航等领域。在自动驾驶中,它可以帮助车辆准确跟踪周围的车辆和行人,提高驾驶安全性。在智能监控中,它可以用于跟踪嫌疑人或异常行为,提高安防效率。在机器人导航中,它可以帮助机器人准确跟踪目标物体,完成复杂的任务。

📄 摘要(原文)

The goal of multi-object tracking is to detect and track all objects in a scene while maintaining unique identifiers for each, by associating their bounding boxes across video frames. This association relies on matching motion and appearance patterns of detected objects. This task is especially hard in case of scenarios involving dynamic and non-linear motion patterns. In this paper, we introduce DeepMoveSORT, a novel, carefully engineered multi-object tracker designed specifically for such scenarios. In addition to standard methods of appearance-based association, we improve motion-based association by employing deep learnable filters (instead of the most commonly used Kalman filter) and a rich set of newly proposed heuristics. Our improvements to motion-based association methods are severalfold. First, we propose a new transformer-based filter architecture, TransFilter, which uses an object's motion history for both motion prediction and noise filtering. We further enhance the filter's performance by careful handling of its motion history and accounting for camera motion. Second, we propose a set of heuristics that exploit cues from the position, shape, and confidence of detected bounding boxes to improve association performance. Our experimental evaluation demonstrates that DeepMoveSORT outperforms existing trackers in scenarios featuring non-linear motion, surpassing state-of-the-art results on three such datasets. We also perform a thorough ablation study to evaluate the contributions of different tracker components which we proposed. Based on our study, we conclude that using a learnable filter instead of the Kalman filter, along with appearance-based association is key to achieving strong general tracking performance.