Trimming the Fat: Efficient Compression of 3D Gaussian Splats through Pruning

作者: Muhammad Salman Ali, Maryam Qamar, Sung-Ho Bae, Enzo Tartaglione

分类: cs.CV

发布日期: 2024-06-26 (更新: 2024-07-29)

备注: Accepted at BMVC 2024

💡 一句话要点

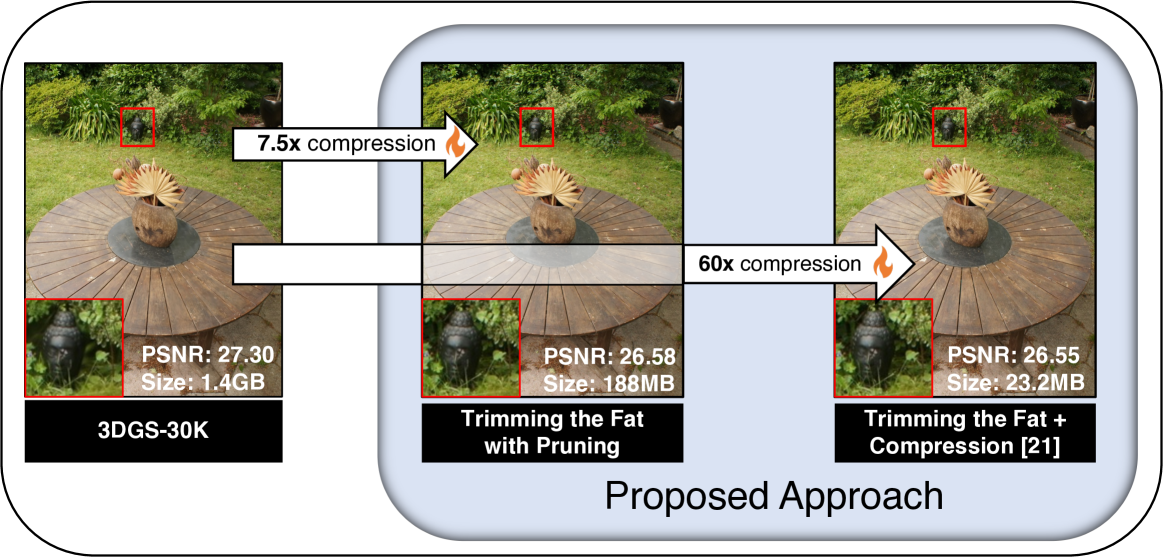

提出基于梯度信息的3D高斯Splats后处理剪枝方法,实现高效压缩。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯Splatting 模型压缩 剪枝 梯度信息 后处理 高效渲染

📋 核心要点

- 现有3DGS模型虽然训练快速且可编辑,但在模型规模的可扩展性方面仍存在挑战,限制了其应用。

- 论文提出一种后处理剪枝技术,利用梯度信息迭代地去除3DGS模型中的冗余高斯分布,从而压缩模型。

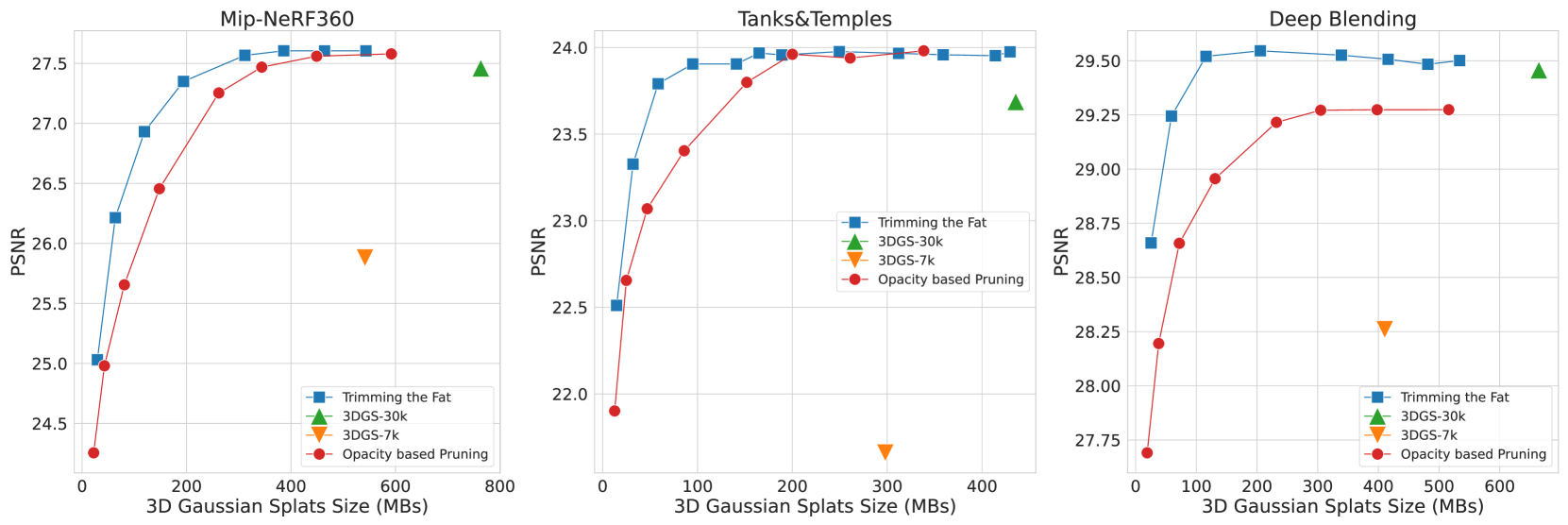

- 实验表明,该方法可以在移除高达75%的高斯分布的同时,保持甚至提高原始模型的性能,并显著提升计算速度。

📝 摘要(中文)

近年来,3D模型的使用越来越受欢迎,这得益于神经辐射场和3D高斯Splatting (3DGS)模型提供的端到端训练能力。后者在训练过程中具有快速收敛和可编辑性的显著优势。然而,尽管取得了快速进展,但关于这些模型可扩展性的研究仍处于起步阶段。本研究旨在解决这一差距,提出了一种能够提高此类模型内存和计算可扩展性的方法。具体来说,我们提出了一种名为“Trimming the fat”的后处理梯度信息迭代剪枝技术,以消除模型中编码的冗余信息。在广泛认可的基准测试上的实验结果证明了我们方法的有效性,表明在保持甚至提高基线性能的同时,可以移除高达75%的高斯分布。我们的方法实现了约50倍的压缩,同时保持与基线模型相似的性能,并且能够将计算速度提高到600 FPS。

🔬 方法详解

问题定义:现有3D高斯Splatting (3DGS)模型虽然在渲染质量和速度上表现出色,但模型规模较大,占用大量内存,计算复杂度高,限制了其在资源受限设备上的部署和应用。因此,如何有效地压缩3DGS模型,降低其存储和计算成本,同时保持渲染质量,是一个亟待解决的问题。

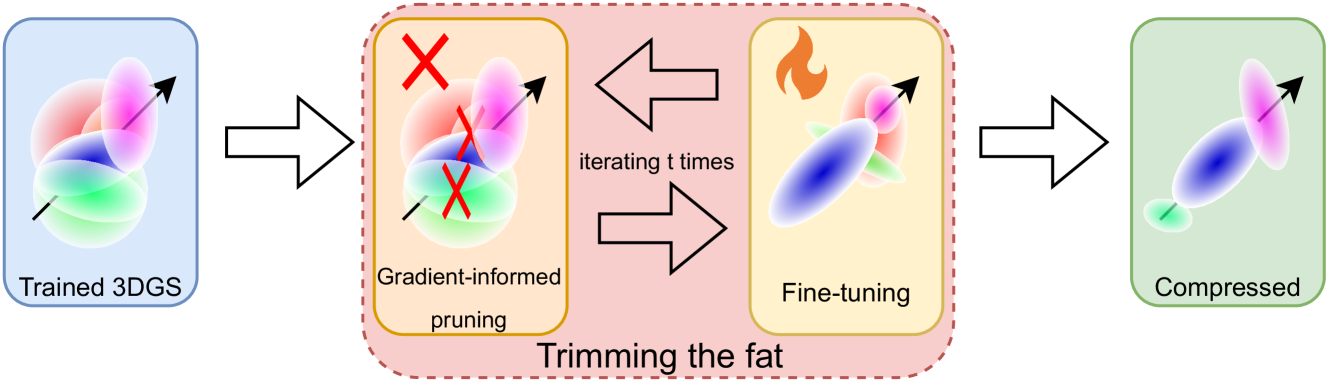

核心思路:论文的核心思路是通过剪枝去除3DGS模型中冗余或不重要的高斯分布。作者认为,并非所有高斯分布都对最终的渲染结果有同等贡献,因此可以通过分析每个高斯分布的重要性,去除那些对渲染结果影响较小的高斯分布,从而实现模型压缩。

技术框架:该方法是一种后处理的剪枝技术,即在3DGS模型训练完成后,再进行剪枝操作。其主要流程包括:1) 计算每个高斯分布的梯度信息,用于评估其重要性;2) 根据梯度信息,迭代地去除重要性较低的高斯分布;3) 对剩余的高斯分布进行微调,以恢复因剪枝造成的性能损失。

关键创新:该方法的关键创新在于利用梯度信息来指导剪枝过程。传统的剪枝方法通常基于启发式规则或随机策略,而该方法通过分析梯度信息,能够更准确地评估每个高斯分布对渲染结果的贡献,从而更有效地去除冗余信息。此外,该方法采用迭代剪枝策略,逐步去除高斯分布,并进行微调,以避免一次性去除过多高斯分布造成的性能下降。

关键设计:论文中梯度信息的计算方式未知,但可以推测是计算损失函数对每个高斯分布参数的梯度。剪枝的阈值和迭代次数是重要的超参数,需要根据具体任务进行调整。微调阶段可以使用与训练阶段相同的损失函数和优化器。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法可以在移除高达75%的高斯分布的同时,保持甚至提高原始模型的渲染质量。在压缩率达到50倍的情况下,性能与基线模型相似,并且计算速度提升至600 FPS。这些结果表明该方法在压缩3DGS模型方面具有显著优势。

🎯 应用场景

该研究成果可应用于各种需要高效3D渲染的场景,例如移动设备上的增强现实(AR)应用、虚拟现实(VR)游戏、以及自动驾驶等需要实时环境感知的领域。通过压缩3DGS模型,可以降低存储和计算成本,使其能够在资源受限的平台上运行,并提高渲染速度,从而改善用户体验。

📄 摘要(原文)

In recent times, the utilization of 3D models has gained traction, owing to the capacity for end-to-end training initially offered by Neural Radiance Fields and more recently by 3D Gaussian Splatting (3DGS) models. The latter holds a significant advantage by inherently easing rapid convergence during training and offering extensive editability. However, despite rapid advancements, the literature still lives in its infancy regarding the scalability of these models. In this study, we take some initial steps in addressing this gap, showing an approach that enables both the memory and computational scalability of such models. Specifically, we propose "Trimming the fat", a post-hoc gradient-informed iterative pruning technique to eliminate redundant information encoded in the model. Our experimental findings on widely acknowledged benchmarks attest to the effectiveness of our approach, revealing that up to 75% of the Gaussians can be removed while maintaining or even improving upon baseline performance. Our approach achieves around 50$\times$ compression while preserving performance similar to the baseline model, and is able to speed-up computation up to 600 FPS.