Three-Stream Temporal-Shift Attention Network Based on Self-Knowledge Distillation for Micro-Expression Recognition

作者: Guanghao Zhu, Lin Liu, Yuhao Hu, Haixin Sun, Fang Liu, Xiaohui Du, Ruqian Hao, Juanxiu Liu, Yong Liu, Hao Deng, Jing Zhang

分类: cs.CV

发布日期: 2024-06-25 (更新: 2025-07-02)

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于自知识蒸馏的三流时序注意力网络用于提升微表情识别性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 微表情识别 时序注意力网络 自知识蒸馏 运动放大 通道注意力

📋 核心要点

- 微表情识别面临微表情强度低和数据集规模小的挑战,限制了现有方法的性能。

- 论文提出三流时序注意力网络,结合运动放大、通道注意力和时序移位模块,增强特征表达。

- 引入自知识蒸馏,利用深层网络监督浅层网络,鼓励网络充分学习,实验结果达到SOTA。

📝 摘要(中文)

微表情是人们试图隐藏真实情感时自发产生的细微面部动作。微表情识别在犯罪分析和心理治疗等领域至关重要。然而,由于微表情强度低且公开数据集规模小,微表情识别极具挑战性。为此,本文提出了一种基于自知识蒸馏的三流时序注意力网络。首先,为了解决肌肉运动强度低的问题,我们利用基于学习的运动放大模块来增强肌肉运动的强度。其次,我们在局部-空间流中采用高效通道注意力模块,使网络专注于与微表情高度相关的面部区域。此外,动态-时间流中使用时序移位模块,通过混合来自两个不同时间域的运动信息,实现无需额外参数的时序建模。更重要的是,通过引入辅助分类器并使用网络的最深层进行监督,我们将自知识蒸馏引入到微表情识别任务中,鼓励所有块充分探索训练集的特征。最后,在五个公开的微表情数据集上进行了广泛的实验。实验结果表明,我们的网络优于其他现有方法,并实现了新的最先进性能。代码可在https://github.com/GuanghaoZhu663/SKD-TSTSAN获取。

🔬 方法详解

问题定义:微表情识别旨在识别人们试图隐藏真实情感时产生的细微面部动作。现有方法在处理微表情时,由于其强度低、持续时间短以及公开数据集规模有限,往往难以提取有效的判别性特征,导致识别精度不高。

核心思路:论文的核心思路是通过多流网络提取不同类型的特征,并利用注意力机制和时序建模增强关键特征的表达能力。同时,引入自知识蒸馏,利用深层网络的知识来指导浅层网络的学习,从而提升整体网络的泛化能力。

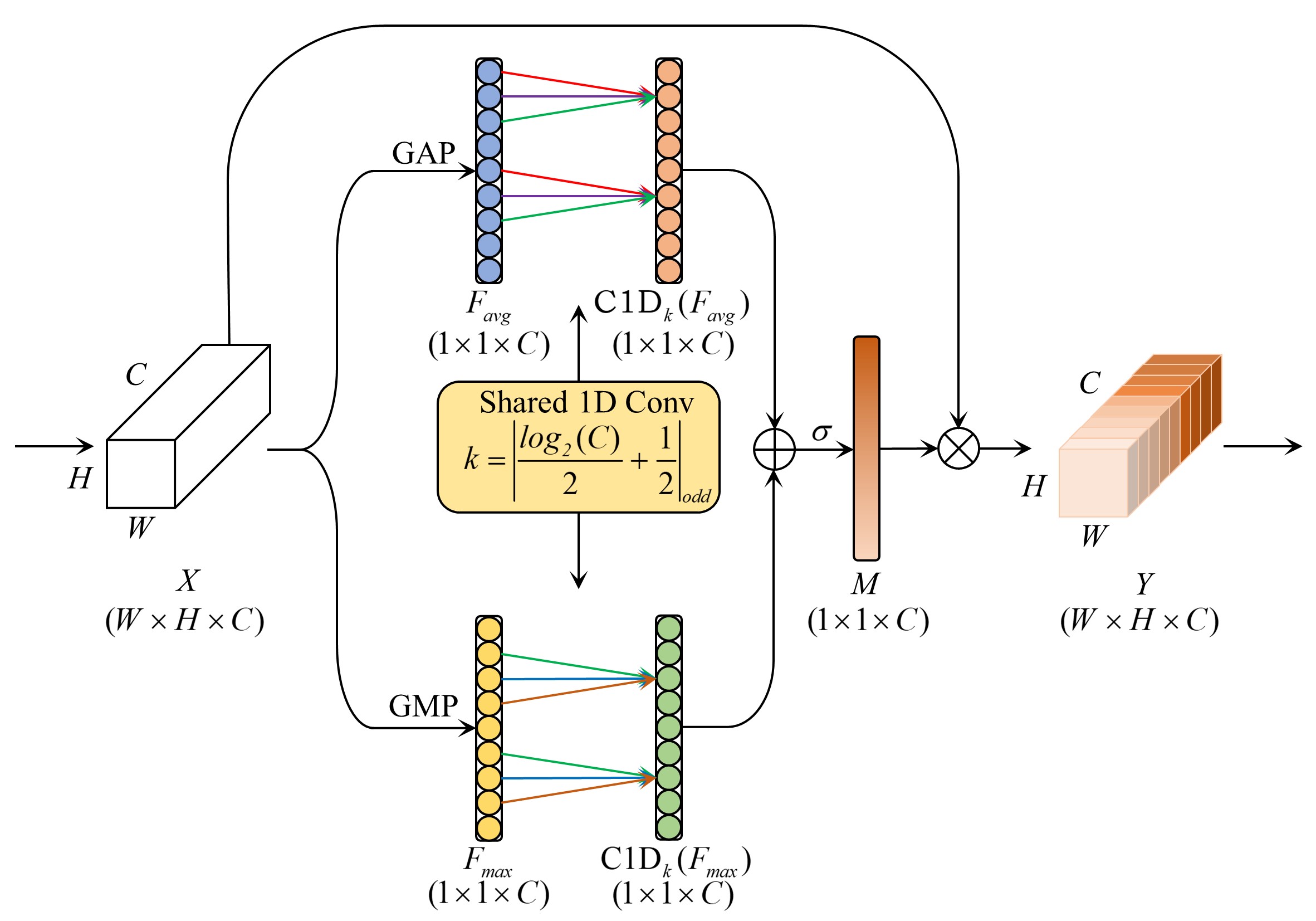

技术框架:该方法采用三流网络结构,包括:1) 局部-空间流:利用高效通道注意力模块关注与微表情相关的面部区域;2) 动态-时间流:使用时序移位模块进行时序建模,无需额外参数;3) 运动放大流:利用学习的运动放大模块增强肌肉运动的强度。此外,还引入了自知识蒸馏,通过辅助分类器和深层网络的监督,提升特征学习能力。

关键创新:该方法的主要创新点在于:1) 结合运动放大、通道注意力和时序移位模块的三流网络结构,能够更全面地提取微表情的特征;2) 将自知识蒸馏引入微表情识别任务,利用深层网络的知识指导浅层网络的学习,提升了网络的泛化能力。

关键设计:在局部-空间流中,使用了高效通道注意力(ECA)模块来关注重要的面部区域。在动态-时间流中,使用了时序移位模块(TSM)进行时序建模,该模块通过将部分通道的信息在时间维度上进行移位,实现相邻帧之间的信息交互,从而捕捉微表情的时序动态。自知识蒸馏通过在网络的中间层添加辅助分类器,并使用深层网络的输出来监督这些辅助分类器的训练,从而引导浅层网络学习到更丰富的特征表示。

🖼️ 关键图片

📊 实验亮点

该论文在五个公开微表情数据集上进行了实验,结果表明所提出的方法优于现有的方法,并取得了新的state-of-the-art性能。具体的性能数据在论文中给出,相较于之前的最佳方法,在多个数据集上均有显著提升。

🎯 应用场景

该研究成果可应用于犯罪分析、心理治疗、安全监控等领域。通过自动识别微表情,可以辅助判断个体的情绪状态和真实意图,从而在相关领域提供更准确的决策支持。未来,该技术有望在人机交互、情感计算等领域发挥更大的作用。

📄 摘要(原文)

Micro-expressions are subtle facial movements that occur spontaneously when people try to conceal real emotions. Micro-expression recognition is crucial in many fields, including criminal analysis and psychotherapy. However, micro-expression recognition is challenging since micro-expressions have low intensity and public datasets are small in size. To this end, a three-stream temporal-shift attention network based on self-knowledge distillation is proposed in this paper. Firstly, to address the low intensity of muscle movements, we utilize learning-based motion magnification modules to enhance the intensity of muscle movements. Secondly, we employ efficient channel attention modules in the local-spatial stream to make the network focus on facial regions that are highly relevant to micro-expressions. In addition, temporal shift modules are used in the dynamic-temporal stream, which enables temporal modeling with no additional parameters by mixing motion information from two different temporal domains. Furthermore, we introduce self-knowledge distillation into the micro-expression recognition task by introducing auxiliary classifiers and using the deepest section of the network for supervision, encouraging all blocks to fully explore the features of the training set. Finally, extensive experiments are conducted on five publicly available micro-expression datasets. The experimental results demonstrate that our network outperforms other existing methods and achieves new state-of-the-art performance. Our code is available at https://github.com/GuanghaoZhu663/SKD-TSTSAN.