Taming 3DGS: High-Quality Radiance Fields with Limited Resources

作者: Saswat Subhajyoti Mallick, Rahul Goel, Bernhard Kerbl, Francisco Vicente Carrasco, Markus Steinberger, Fernando De La Torre

分类: cs.CV, cs.GR

发布日期: 2024-06-21

💡 一句话要点

提出预算约束下的3DGS优化方法,实现高质量、低资源占用率的新视角合成。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 新视角合成 资源优化 移动设备 渲染加速

📋 核心要点

- 3DGS虽然渲染质量高,但资源消耗大,限制了其在移动设备等资源受限环境中的应用。

- 论文提出一种引导式的稠密化策略,结合训练时先验知识,控制模型大小,并优化梯度计算。

- 实验表明,该方法在预算约束下,显著降低了模型大小和训练时间,同时保持甚至超越了原3DGS的渲染质量。

📝 摘要(中文)

3D高斯溅射(3DGS)以其快速、可解释和高保真渲染改变了新视角合成领域。然而,其资源需求限制了它的可用性。尤其是在受限设备上,训练性能迅速下降,并且经常由于模型过度消耗内存而无法完成。该方法收敛时会产生无限数量的高斯分布——其中许多是冗余的——导致渲染速度不必要地慢,并阻止其在需要固定大小输入的下游任务中使用。为了解决这些问题,我们致力于在预算有限的情况下训练和渲染3DGS模型。我们使用引导式的、纯粹建设性的稠密化过程,引导稠密化朝着提高重建质量的高斯分布发展。模型大小以受控方式持续增加,达到确切的预算,使用基于分数的稠密化,利用训练时先验来衡量高斯分布的贡献。我们进一步解决了训练速度障碍:在仔细分析3DGS的原始流程后,我们推导出了更快、数值等效的梯度计算和属性更新解决方案,包括用于高效反向传播的替代并行化方案。我们还提出了在适当情况下保持质量的近似方法,以进一步减少训练时间。总而言之,这些增强功能提供了一个稳健、可扩展的解决方案,减少了训练时间、降低了计算和内存需求,并保证了高质量。我们的评估表明,在预算有限的情况下,我们获得了与3DGS具有竞争力的质量指标,同时模型大小和训练时间都减少了4-5倍。在更宽松的预算下,我们测量的质量超过了他们。这些进步为在受限环境中(例如,移动设备)进行新视角合成打开了大门。

🔬 方法详解

问题定义:3DGS方法虽然在新视角合成任务中表现出色,但其计算和内存需求较高,尤其是在资源受限的设备上,训练过程容易崩溃,且最终模型包含大量冗余高斯分布,导致渲染速度慢,难以应用于需要固定大小输入的下游任务。因此,需要一种能够在有限资源下训练和渲染高质量3DGS模型的方法。

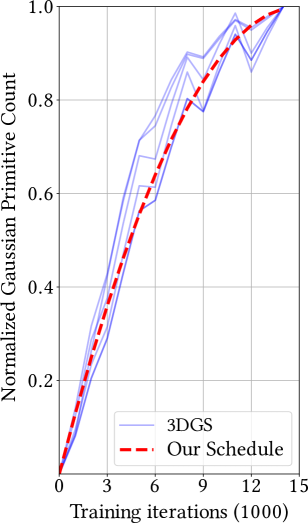

核心思路:论文的核心思路是在训练过程中对高斯分布进行选择性的稠密化,只增加那些对重建质量有显著贡献的高斯分布。同时,通过优化梯度计算和属性更新,提高训练速度。最终目标是在给定的资源预算下,获得尽可能高的渲染质量。

技术框架:该方法主要包含以下几个阶段:1) 引导式稠密化:使用基于分数的稠密化策略,根据高斯分布对重建质量的贡献程度来决定是否进行稠密化。2) 训练时先验:利用训练时获得的先验知识,例如梯度大小,来指导稠密化过程。3) 梯度计算优化:通过数值等价的变换,推导出更快的梯度计算方法。4) 属性更新优化:提出高效的属性更新策略,包括并行化方案。5) 质量保持近似:在保证渲染质量的前提下,采用近似计算来进一步减少训练时间。

关键创新:该方法最重要的创新点在于其引导式的稠密化策略,它不同于传统的盲目增加高斯分布的方法,而是有选择性地增加对重建质量贡献大的高斯分布,从而在资源有限的情况下,最大化渲染质量。此外,对梯度计算和属性更新的优化也显著提高了训练速度。

关键设计:1) 基于分数的稠密化:使用一个分数来衡量每个高斯分布对重建质量的贡献,只有当分数超过一定阈值时,才进行稠密化。2) 训练时先验:利用梯度大小等信息作为先验知识,指导稠密化过程。3) 并行化方案:针对属性更新,设计了一种高效的并行化方案,充分利用GPU的计算能力。4) 损失函数:使用标准的渲染损失函数,例如L1损失或PSNR损失。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在预算约束下,该方法能够以4-5倍的资源节省(模型大小和训练时间)达到与原始3DGS相当甚至更好的渲染质量。在更宽松的预算下,该方法的渲染质量超过了原始3DGS。这些结果验证了该方法在资源受限环境下的有效性。

🎯 应用场景

该研究成果可广泛应用于移动设备上的新视角合成、增强现实(AR)和虚拟现实(VR)等领域。通过降低3DGS的资源需求,使得这些应用能够在资源受限的设备上运行,从而扩展了3DGS的应用范围。此外,该方法还可以应用于其他需要高效渲染的场景,例如游戏开发和机器人导航。

📄 摘要(原文)

3D Gaussian Splatting (3DGS) has transformed novel-view synthesis with its fast, interpretable, and high-fidelity rendering. However, its resource requirements limit its usability. Especially on constrained devices, training performance degrades quickly and often cannot complete due to excessive memory consumption of the model. The method converges with an indefinite number of Gaussians -- many of them redundant -- making rendering unnecessarily slow and preventing its usage in downstream tasks that expect fixed-size inputs. To address these issues, we tackle the challenges of training and rendering 3DGS models on a budget. We use a guided, purely constructive densification process that steers densification toward Gaussians that raise the reconstruction quality. Model size continuously increases in a controlled manner towards an exact budget, using score-based densification of Gaussians with training-time priors that measure their contribution. We further address training speed obstacles: following a careful analysis of 3DGS' original pipeline, we derive faster, numerically equivalent solutions for gradient computation and attribute updates, including an alternative parallelization for efficient backpropagation. We also propose quality-preserving approximations where suitable to reduce training time even further. Taken together, these enhancements yield a robust, scalable solution with reduced training times, lower compute and memory requirements, and high quality. Our evaluation shows that in a budgeted setting, we obtain competitive quality metrics with 3DGS while achieving a 4--5x reduction in both model size and training time. With more generous budgets, our measured quality surpasses theirs. These advances open the door for novel-view synthesis in constrained environments, e.g., mobile devices.