E2GS: Event Enhanced Gaussian Splatting

作者: Hiroyuki Deguchi, Mana Masuda, Takuya Nakabayashi, Hideo Saito

分类: cs.CV

发布日期: 2024-06-21

备注: 7pages,

🔗 代码/项目: GITHUB

💡 一句话要点

提出E2GS,利用事件相机数据增强高斯溅射,实现快速高质量的新视角合成。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 事件相机 高斯溅射 新视角合成 图像去模糊 三维重建

📋 核心要点

- NeRF虽然在新视角合成上表现出色,但其体渲染方式导致训练和渲染速度较慢,难以满足实时性需求。

- E2GS将事件相机数据融入高斯溅射框架,利用事件数据辅助图像去模糊,从而提升新视角合成的质量和速度。

- 实验结果表明,E2GS在合成和真实数据集上均能实现高质量的渲染,且渲染速度高达140 FPS。

📝 摘要(中文)

本文提出了一种名为事件增强高斯溅射(E2GS)的新方法,该方法将事件数据融入到高斯溅射中,从而实现高质量的新视角合成。事件相机以其高动态范围、无运动模糊和低功耗而著称。近年来,基于神经辐射场(NeRF)的事件3D重建方法取得了显著进展,但NeRF的体渲染范式需要大量的训练和渲染时间。E2GS有效地利用模糊图像和事件数据,显著改善图像去模糊效果,并生成高质量的新视角合成结果。在合成和真实世界数据集上的综合实验表明,E2GS能够生成具有视觉吸引力的渲染结果,同时提供更快的训练和渲染速度(140 FPS)。代码已开源。

🔬 方法详解

问题定义:现有基于NeRF的事件相机3D重建方法虽然能够实现逼真的新视角合成,但由于NeRF的体渲染过程计算量大,导致训练和渲染速度慢,难以应用于实时性要求高的场景。此外,传统相机拍摄的图像可能存在运动模糊,进一步影响重建质量。

核心思路:E2GS的核心思路是将事件相机数据与高斯溅射相结合,利用事件数据提供的高时间分辨率信息来辅助图像去模糊,从而提高高斯溅射的重建质量和渲染速度。高斯溅射本身具有快速渲染的优势,结合事件数据可以进一步提升其性能。

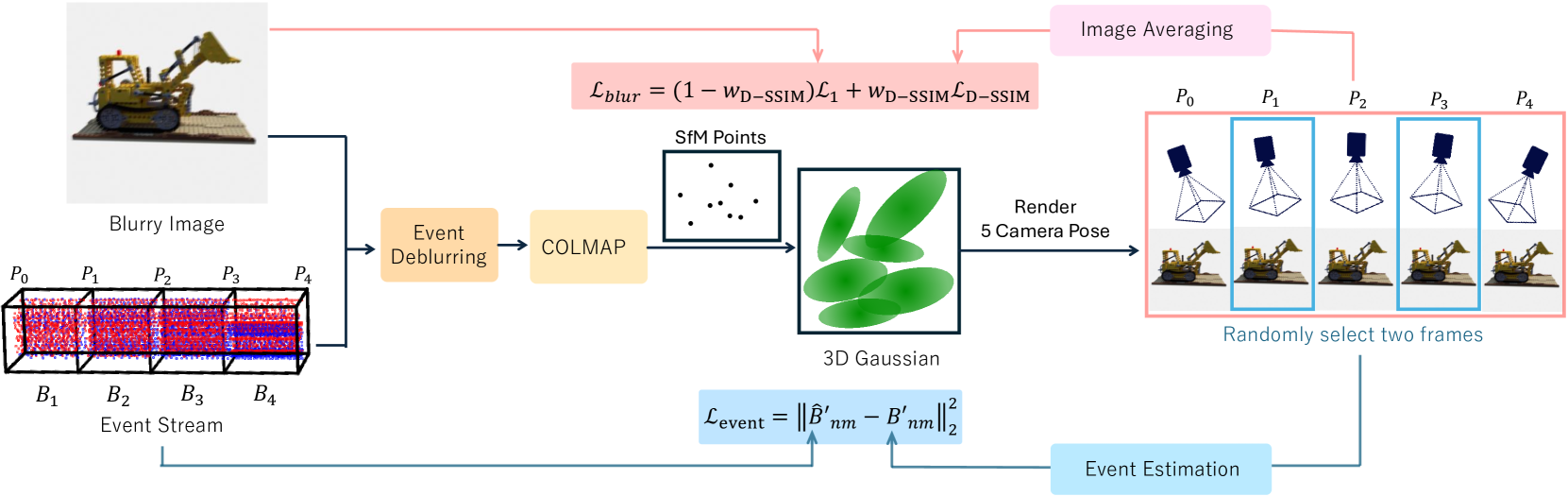

技术框架:E2GS的整体框架包括以下几个主要阶段:1) 事件数据预处理:对原始事件数据进行滤波和校正等预处理操作。2) 图像去模糊:利用事件数据辅助图像去模糊,得到清晰的图像。3) 高斯溅射优化:将去模糊后的图像和事件数据作为输入,优化高斯溅射的参数,包括高斯分布的中心、协方差矩阵、颜色和透明度等。4) 新视角渲染:利用优化后的高斯溅射模型,从任意视角渲染出新的图像。

关键创新:E2GS的关键创新在于将事件数据有效地融入到高斯溅射框架中。与传统的基于图像的高斯溅射方法相比,E2GS利用事件数据提供的高时间分辨率信息,可以更好地处理运动模糊问题,从而提高重建质量和渲染效果。此外,E2GS还设计了一种新的损失函数,用于约束高斯溅射的参数,使其更好地拟合事件数据。

关键设计:E2GS的关键设计包括:1) 使用事件数据驱动的图像去模糊算法,例如基于事件的运动估计和图像重建方法。2) 设计一种新的损失函数,该损失函数不仅考虑了渲染图像与真实图像之间的差异,还考虑了事件数据与高斯溅射参数之间的关系。例如,可以使用事件数据来约束高斯分布的形状和位置,使其更好地与场景中的运动物体对齐。3) 采用高效的高斯溅射渲染算法,例如基于GPU的并行渲染方法,以实现快速的渲染速度。具体参数设置和网络结构细节在论文中未明确说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

E2GS在合成和真实数据集上均取得了显著的性能提升。实验结果表明,E2GS能够生成具有视觉吸引力的渲染结果,同时提供更快的训练和渲染速度,达到了140 FPS。与现有方法相比,E2GS在图像质量和渲染速度方面均具有优势。具体的量化指标和对比基线在论文中未详细给出,属于未知信息。

🎯 应用场景

E2GS具有广泛的应用前景,包括:1) 机器人导航:利用事件相机和E2GS可以实现快速准确的3D场景重建,从而帮助机器人在复杂环境中进行导航。2) 虚拟现实/增强现实:E2GS可以生成高质量的新视角图像,为用户提供沉浸式的VR/AR体验。3) 运动捕捉:E2GS可以用于精确地捕捉运动物体的3D信息,例如用于电影制作和游戏开发。

📄 摘要(原文)

Event cameras, known for their high dynamic range, absence of motion blur, and low energy usage, have recently found a wide range of applications thanks to these attributes. In the past few years, the field of event-based 3D reconstruction saw remarkable progress, with the Neural Radiance Field (NeRF) based approach demonstrating photorealistic view synthesis results. However, the volume rendering paradigm of NeRF necessitates extensive training and rendering times. In this paper, we introduce Event Enhanced Gaussian Splatting (E2GS), a novel method that incorporates event data into Gaussian Splatting, which has recently made significant advances in the field of novel view synthesis. Our E2GS effectively utilizes both blurry images and event data, significantly improving image deblurring and producing high-quality novel view synthesis. Our comprehensive experiments on both synthetic and real-world datasets demonstrate our E2GS can generate visually appealing renderings while offering faster training and rendering speed (140 FPS). Our code is available at https://github.com/deguchihiroyuki/E2GS.