Invertible Consistency Distillation for Text-Guided Image Editing in Around 7 Steps

作者: Nikita Starodubcev, Mikhail Khoroshikh, Artem Babenko, Dmitry Baranchuk

分类: cs.CV

发布日期: 2024-06-20 (更新: 2024-12-02)

备注: Project page: https://yandex-research.github.io/invertible-cd/

💡 一句话要点

提出可逆一致性蒸馏(iCD),实现仅需约7步的文本引导图像编辑。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱四:生成式动作 (Generative Motion)

关键词: 扩散模型 蒸馏 图像编辑 文本引导 图像反演

📋 核心要点

- 现有蒸馏模型在真实图像反演能力上存在不足,限制了精确图像操作方法的应用。

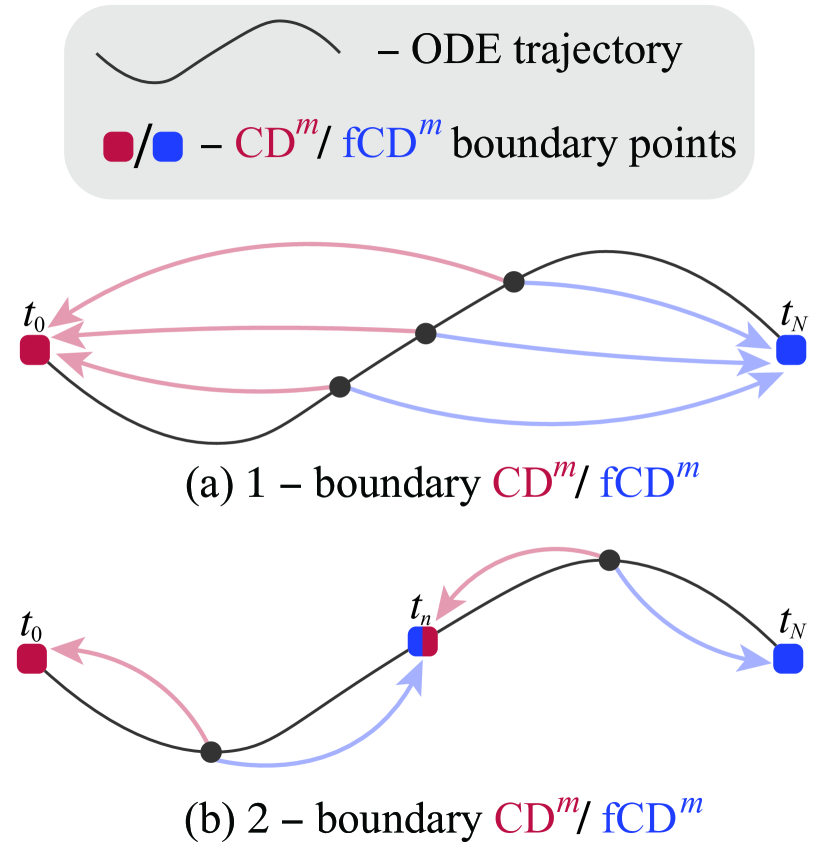

- 提出可逆一致性蒸馏(iCD)框架,通过一致性蒸馏实现高质量图像合成和精确图像编码。

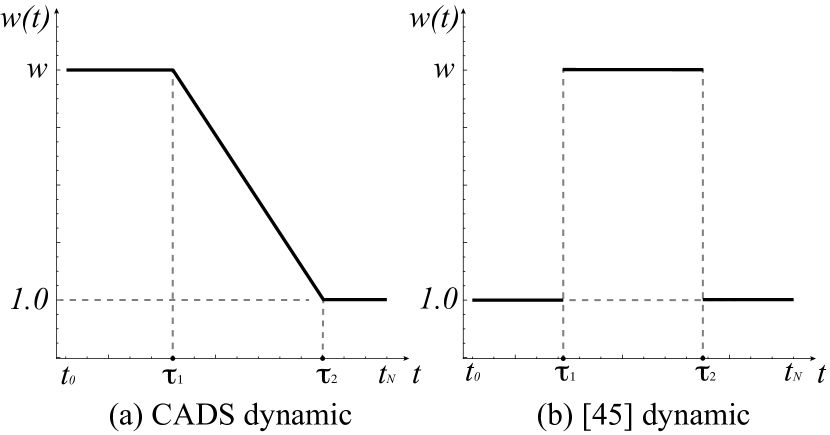

- 引入动态引导策略,有效降低了高分类器自由引导尺度下的重建误差,提升了编辑效果。

📝 摘要(中文)

扩散蒸馏是实现快速文本到图像生成的一个极具前景的方向。然而,尽管最近取得了一些成功,现有的蒸馏模型仍然不具备扩散模型的全部能力,例如真实图像反演,这使得许多精确的图像操作方法成为可能。本工作旨在增强蒸馏的文本到图像扩散模型,使其能够有效地将真实图像编码到其潜在空间中。为此,我们引入了可逆一致性蒸馏(iCD),这是一个广义的一致性蒸馏框架,仅需3-4个推理步骤即可实现高质量的图像合成和精确的图像编码。虽然文本到图像扩散模型的反演问题因高分类器自由引导尺度而加剧,但我们注意到动态引导显著减少了重建误差,而不会明显降低生成性能。因此,我们证明了配备动态引导的iCD可以作为零样本文本引导图像编辑的有效工具,与更昂贵的state-of-the-art替代方案竞争。

🔬 方法详解

问题定义:现有文本到图像的扩散蒸馏模型虽然加速了生成过程,但在将真实图像反演到潜在空间的能力上有所欠缺。高分类器自由引导尺度会进一步加剧反演问题,导致重建误差增大,限制了基于反演的图像编辑应用。

核心思路:论文的核心思路是通过可逆一致性蒸馏(iCD)框架,同时优化图像生成和图像反演能力。iCD旨在学习一个映射,使得从潜在空间到图像空间以及从图像空间到潜在空间的过程都具有一致性。此外,引入动态引导策略,自适应地调整引导尺度,以平衡生成质量和反演精度。

技术框架:iCD框架基于一致性蒸馏,包含以下主要步骤:1) 使用教师扩散模型生成图像和对应的潜在表示;2) 训练学生模型,使其能够从潜在表示生成高质量图像,并能够将真实图像反演到潜在空间;3) 引入动态引导策略,在训练和推理过程中自适应地调整分类器自由引导尺度。

关键创新:该论文的关键创新在于提出了可逆一致性蒸馏(iCD)框架,该框架能够同时优化图像生成和图像反演能力,从而使得蒸馏模型能够更好地应用于图像编辑任务。此外,动态引导策略也是一个重要的创新点,它能够有效地降低高分类器自由引导尺度下的重建误差。

关键设计:动态引导策略是关键设计之一,其核心思想是根据图像的内容和噪声水平,自适应地调整分类器自由引导尺度。具体的实现方式可以是使用一个神经网络来预测合适的引导尺度。损失函数的设计也至关重要,需要同时考虑生成质量和反演精度。此外,学生模型的网络结构也需要精心设计,以保证其能够有效地学习教师模型的知识。

🖼️ 关键图片

📊 实验亮点

实验结果表明,iCD在文本引导图像编辑任务上取得了显著的性能提升,仅需3-4步即可生成高质量的编辑图像,并且能够有效地将真实图像反演到潜在空间。配备动态引导的iCD在零样本文本引导图像编辑方面与更昂贵的state-of-the-art方法具有竞争力,在图像重建精度和编辑质量上都表现出色。

🎯 应用场景

该研究成果可广泛应用于图像编辑、图像修复、风格迁移等领域。通过iCD,用户可以利用文本描述对图像进行精确的修改和控制,例如改变物体的颜色、形状、材质等。该技术在艺术创作、广告设计、游戏开发等领域具有巨大的应用潜力,并有望推动图像编辑工具的智能化和自动化。

📄 摘要(原文)

Diffusion distillation represents a highly promising direction for achieving faithful text-to-image generation in a few sampling steps. However, despite recent successes, existing distilled models still do not provide the full spectrum of diffusion abilities, such as real image inversion, which enables many precise image manipulation methods. This work aims to enrich distilled text-to-image diffusion models with the ability to effectively encode real images into their latent space. To this end, we introduce invertible Consistency Distillation (iCD), a generalized consistency distillation framework that facilitates both high-quality image synthesis and accurate image encoding in only 3-4 inference steps. Though the inversion problem for text-to-image diffusion models gets exacerbated by high classifier-free guidance scales, we notice that dynamic guidance significantly reduces reconstruction errors without noticeable degradation in generation performance. As a result, we demonstrate that iCD equipped with dynamic guidance may serve as a highly effective tool for zero-shot text-guided image editing, competing with more expensive state-of-the-art alternatives.