Splatter a Video: Video Gaussian Representation for Versatile Processing

作者: Yang-Tian Sun, Yi-Hua Huang, Lin Ma, Xiaoyang Lyu, Yan-Pei Cao, Xiaojuan Qi

分类: cs.CV

发布日期: 2024-06-19 (更新: 2024-06-26)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出视频高斯表示,用于解决视频处理中复杂运动建模和可操作性问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频表示 3D高斯 视频处理 运动建模 显式表示

📋 核心要点

- 现有视频表示方法难以建模复杂运动,或依赖隐式3D表示,不适合操作任务。

- 提出视频高斯表示,利用显式3D高斯建模视频外观和运动,提供更内在的表示。

- 通过从基础模型蒸馏2D先验知识,规范化学习过程,并在多种视频处理任务上验证有效性。

📝 摘要(中文)

本文提出了一种新颖的显式3D表示——视频高斯表示,它将视频嵌入到3D高斯中。该方法使用显式高斯作为代理,在3D规范空间中对视频外观进行建模,并将每个高斯与视频运动的3D运动相关联。与分层图集或体素像素矩阵相比,这种方法提供了一种更内在和显式的表示。为了获得这种表示,我们从基础模型中提取光流和深度等2D先验知识,以规范化这种不适定设置中的学习。广泛的应用证明了我们新的视频表示的通用性。它已被证明在许多视频处理任务中有效,包括跟踪、一致的视频深度和特征细化、运动和外观编辑以及立体视频生成。

🔬 方法详解

问题定义:现有视频表示方法在处理复杂运动时存在困难,要么缺乏3D结构信息,要么依赖于隐式的3D表示,这使得对视频内容进行编辑和操作变得困难。因此,需要一种既能有效建模3D结构,又能方便进行操作的视频表示方法。

核心思路:本文的核心思路是将视频表示为3D高斯分布的集合。每个高斯分布代表视频中的一个局部区域,并包含了该区域的外观和运动信息。通过显式地建模3D结构,可以更好地处理复杂运动,并且高斯分布的参数化形式使得对视频内容进行编辑和操作更加方便。

技术框架:该方法首先从视频帧中提取2D先验信息,例如光流和深度图。然后,利用这些先验信息来初始化3D高斯分布的参数。接下来,通过优化一个损失函数来学习高斯分布的参数,该损失函数旨在使高斯分布能够准确地重建视频帧,并保持运动的一致性。最后,可以使用学习到的高斯分布来进行各种视频处理任务,例如跟踪、深度预测、分割、视角合成和编辑。

关键创新:该方法最重要的技术创新点在于提出了视频高斯表示,这是一种显式的3D视频表示方法,它使用高斯分布来建模视频的外观和运动。与现有的隐式3D表示方法相比,视频高斯表示更加易于操作,并且能够更好地处理复杂运动。

关键设计:在训练过程中,使用了从预训练模型中提取的2D先验信息来正则化学习过程。具体来说,使用了光流损失来鼓励高斯分布的运动与视频中的运动一致,并使用了深度损失来鼓励高斯分布的深度与视频中的深度一致。此外,还使用了渲染损失来确保高斯分布能够准确地重建视频帧。

🖼️ 关键图片

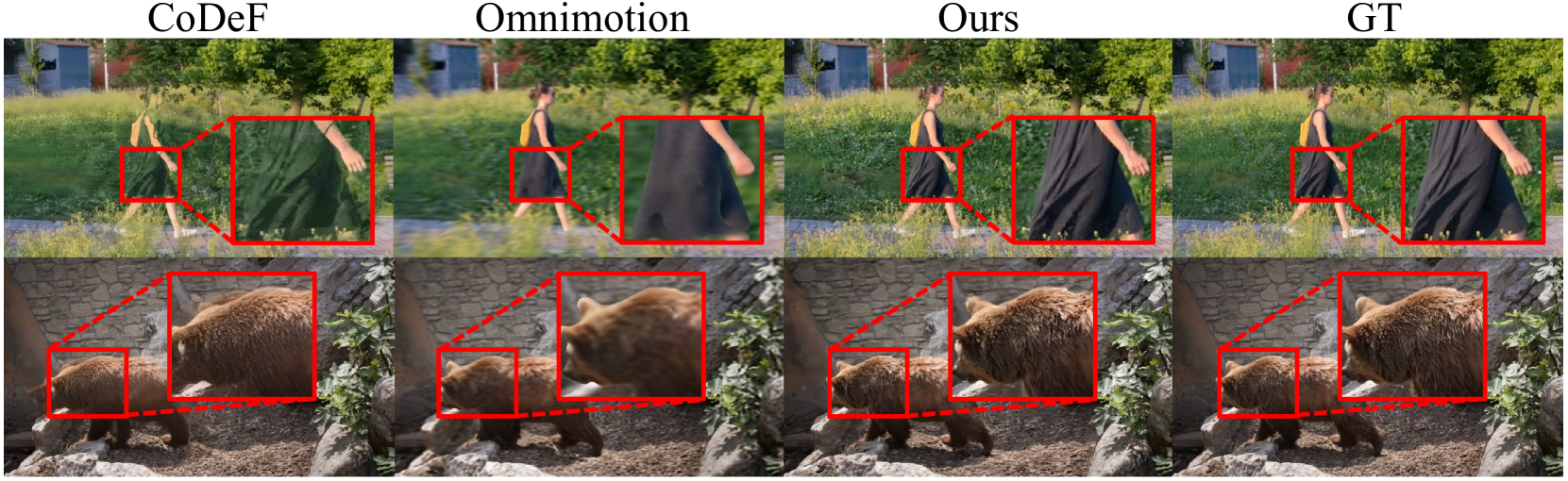

📊 实验亮点

论文在多个视频处理任务上进行了实验,包括跟踪、一致的视频深度和特征细化、运动和外观编辑以及立体视频生成。实验结果表明,该方法在这些任务上都取得了显著的性能提升,例如,在视频编辑任务上,该方法能够生成更加逼真和自然的编辑效果。

🎯 应用场景

该研究成果可广泛应用于视频编辑、特效制作、虚拟现实、增强现实等领域。例如,可以用于实现逼真的视频运动编辑、高质量的视角合成、以及沉浸式的虚拟现实体验。此外,该方法还可以用于视频监控、自动驾驶等领域,提高对视频内容的理解和分析能力。

📄 摘要(原文)

Video representation is a long-standing problem that is crucial for various down-stream tasks, such as tracking,depth prediction,segmentation,view synthesis,and editing. However, current methods either struggle to model complex motions due to the absence of 3D structure or rely on implicit 3D representations that are ill-suited for manipulation tasks. To address these challenges, we introduce a novel explicit 3D representation-video Gaussian representation -- that embeds a video into 3D Gaussians. Our proposed representation models video appearance in a 3D canonical space using explicit Gaussians as proxies and associates each Gaussian with 3D motions for video motion. This approach offers a more intrinsic and explicit representation than layered atlas or volumetric pixel matrices. To obtain such a representation, we distill 2D priors, such as optical flow and depth, from foundation models to regularize learning in this ill-posed setting. Extensive applications demonstrate the versatility of our new video representation. It has been proven effective in numerous video processing tasks, including tracking, consistent video depth and feature refinement, motion and appearance editing, and stereoscopic video generation. Project page: https://sunyangtian.github.io/spatter_a_video_web/