A Hierarchical 3D Gaussian Representation for Real-Time Rendering of Very Large Datasets

作者: Bernhard Kerbl, Andréas Meuleman, Georgios Kopanas, Michael Wimmer, Alexandre Lanvin, George Drettakis

分类: cs.CV, cs.GR

发布日期: 2024-06-17

备注: Project Page: https://repo-sam.inria.fr/fungraph/hierarchical-3d-gaussians/

期刊: ACM Transactions on Graphics, 43(4), July 2024

💡 一句话要点

提出层级3D高斯表示,实现超大数据集实时渲染与高质量视觉效果。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯splatting 实时渲染 超大数据集 细节层次(LOD) 分而治之

📋 核心要点

- 现有3D高斯splatting方法在处理超大规模场景时,面临训练和渲染资源的限制,难以保证视觉质量。

- 论文提出层级3D高斯表示,通过分块训练和层级优化,实现超大场景的高效LOD渲染。

- 实验结果表明,该方法能够处理数万张图像的超大场景,实现实时渲染,并保持良好的视觉质量。

📝 摘要(中文)

本文提出了一种层级3D高斯表示方法,旨在实现超大数据集的实时渲染。该方法在保持视觉质量的同时,为高效渲染远距离内容提供了一种有效的细节层次(LOD)解决方案,实现了有效的层级选择和层级间的平滑过渡。我们采用了一种分而治之的方法,允许独立地训练非常大的场景块。然后,我们将这些块整合到一个层级结构中,并对其进行优化,以进一步提高合并到中间节点的高斯模型的视觉质量。针对大型场景数据稀疏的问题,我们对原始的3D高斯splatting训练方法进行了调整和正则化。我们提供了一个完整的解决方案,能够实时渲染超大型场景,并能根据可用的资源进行调整。实验结果表明,该方法能够处理由数万张图像组成的场景,这些图像是通过简单且经济实惠的设备捕获的,覆盖了长达数公里的轨迹,持续时间长达一小时。

🔬 方法详解

问题定义:现有的3D高斯splatting方法在处理非常大的场景时,由于训练和渲染所需的资源量巨大,难以保证视觉质量和实时渲染性能。尤其是在场景数据稀疏的情况下,原始的训练方法面临诸多挑战。因此,如何高效地表示和渲染超大规模场景,同时保持视觉质量和实时性,是本文要解决的核心问题。

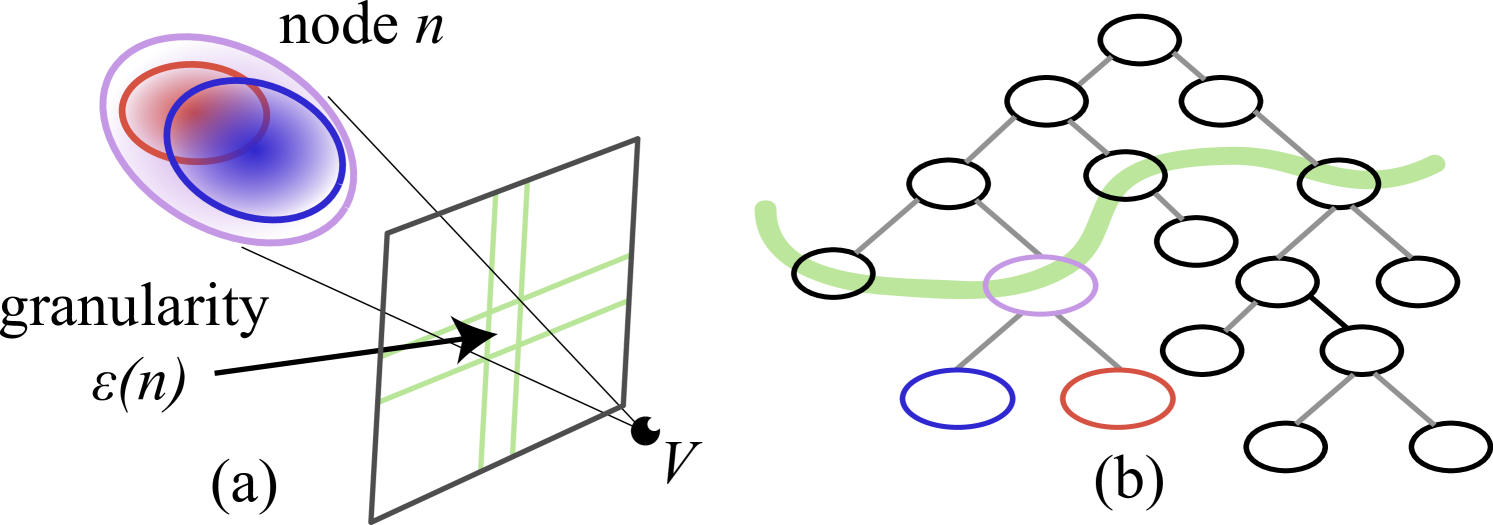

核心思路:本文的核心思路是采用分而治之的策略,将超大场景分解为多个独立的块进行训练,然后将这些块合并成一个层级结构。通过层级结构,可以实现细节层次(LOD)渲染,即根据视角距离选择不同层级的细节进行渲染,从而提高渲染效率。同时,对层级结构进行优化,可以进一步提高视觉质量。

技术框架:该方法主要包含以下几个阶段:1) 场景分块:将超大场景分割成多个独立的块。2) 独立训练:对每个块独立地进行3D高斯splatting训练。3) 层级构建:将训练好的块合并成一个层级结构,每个节点包含多个子节点的高斯模型。4) 层级优化:对层级结构进行优化,提高合并后的高斯模型的视觉质量。5) LOD渲染:根据视角距离选择不同层级的细节进行渲染。

关键创新:该方法最重要的创新点在于提出了层级3D高斯表示,通过分块训练和层级优化,实现了超大场景的高效LOD渲染。与原始的3D高斯splatting方法相比,该方法能够处理更大规模的场景,并能根据可用的资源进行调整,从而实现实时渲染。此外,针对大型场景数据稀疏的问题,该方法对原始的训练方法进行了调整和正则化。

关键设计:在层级构建阶段,需要选择合适的合并策略,例如基于空间距离或视觉相似度。在层级优化阶段,可以使用各种优化算法,例如梯度下降法,来调整高斯模型的参数,以提高视觉质量。在LOD渲染阶段,需要设计有效的层级选择策略,以保证渲染效率和视觉质量的平衡。此外,损失函数的设计也至关重要,需要考虑重建误差、正则化项等因素。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够处理由数万张图像组成的场景,这些图像是通过简单且经济实惠的设备捕获的,覆盖了长达数公里的轨迹,持续时间长达一小时。该方法实现了超大场景的实时渲染,并保持了良好的视觉质量,证明了其在处理大规模场景方面的有效性。

🎯 应用场景

该研究成果可广泛应用于城市级别的三维重建、自动驾驶仿真、虚拟现实、游戏开发等领域。通过高效渲染超大规模场景,可以为用户提供更逼真、更沉浸式的体验。此外,该方法还可以应用于文物保护、地理信息系统等领域,为相关研究提供技术支持。

📄 摘要(原文)

Novel view synthesis has seen major advances in recent years, with 3D Gaussian splatting offering an excellent level of visual quality, fast training and real-time rendering. However, the resources needed for training and rendering inevitably limit the size of the captured scenes that can be represented with good visual quality. We introduce a hierarchy of 3D Gaussians that preserves visual quality for very large scenes, while offering an efficient Level-of-Detail (LOD) solution for efficient rendering of distant content with effective level selection and smooth transitions between levels.We introduce a divide-and-conquer approach that allows us to train very large scenes in independent chunks. We consolidate the chunks into a hierarchy that can be optimized to further improve visual quality of Gaussians merged into intermediate nodes. Very large captures typically have sparse coverage of the scene, presenting many challenges to the original 3D Gaussian splatting training method; we adapt and regularize training to account for these issues. We present a complete solution, that enables real-time rendering of very large scenes and can adapt to available resources thanks to our LOD method. We show results for captured scenes with up to tens of thousands of images with a simple and affordable rig, covering trajectories of up to several kilometers and lasting up to one hour. Project Page: https://repo-sam.inria.fr/fungraph/hierarchical-3d-gaussians/