What is the Visual Cognition Gap between Humans and Multimodal LLMs?

作者: Xu Cao, Yifan Shen, Bolin Lai, Wenqian Ye, Yunsheng Ma, Joerg Heintz, Jintai Chen, Meihuan Huang, Jianguo Cao, Aidong Zhang, James M. Rehg

分类: cs.CV, cs.AI

发布日期: 2024-06-14 (更新: 2025-09-14)

备注: COLM 2025

💡 一句话要点

提出MaRs-VQA数据集,评估多模态大语言模型在视觉认知推理方面的能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 视觉认知 矩阵推理 数据集 视觉推理 认知推理 Qwen2 MaRs-VQA

📋 核心要点

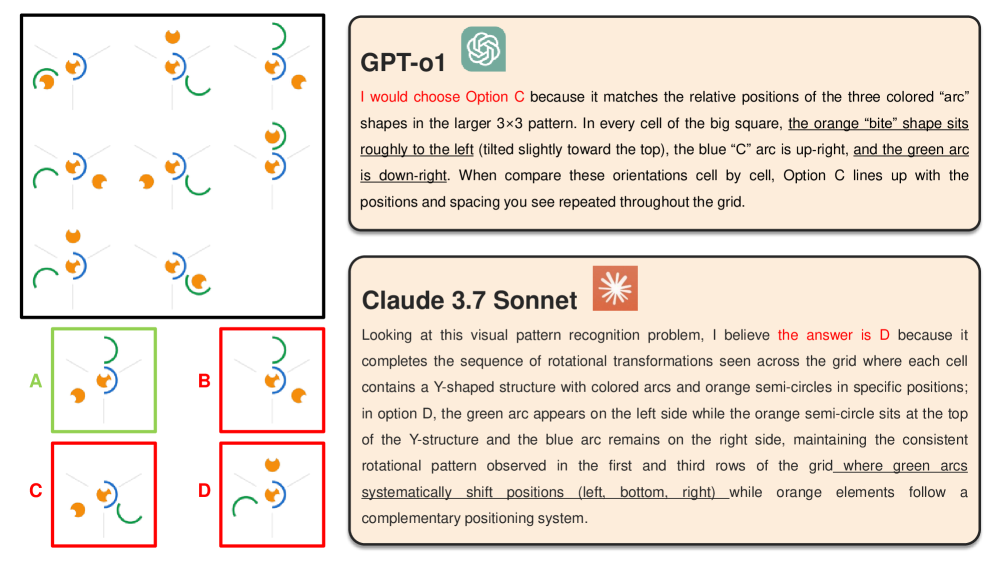

- 现有MLLM在视觉认知推理方面存在不足,尤其是在需要多图像推理和视觉工作记忆的任务中。

- 提出MaRs-VQA数据集,模拟人类认知推理过程,用于评估和提升MLLM的视觉认知能力。

- 通过在MaRs-VQA上微调Qwen2-VCog,实验结果揭示了MLLM与人类智能在视觉认知上的差距。

📝 摘要(中文)

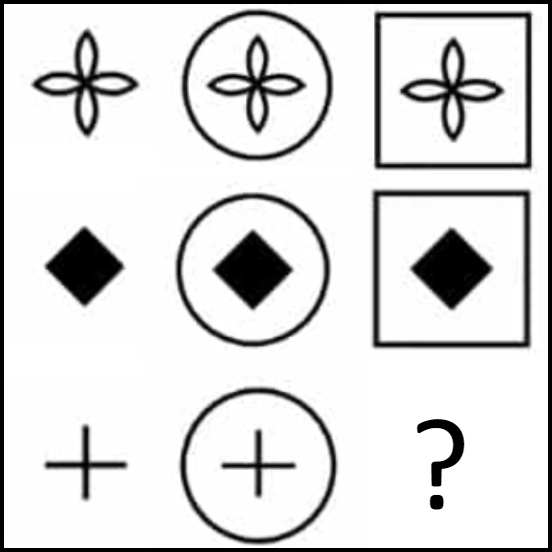

近年来,多模态大语言模型(MLLMs)和视觉语言模型(VLMs)在语言引导的感知任务(如识别、分割和目标检测)中展现出巨大潜力。然而,它们在解决需要高层次多图像推理和视觉工作记忆的视觉认知问题方面的有效性尚未得到充分验证。矩阵推理是其中一项挑战,它指的是辨别一组图像中模式之间的关系并推断后续模式的认知能力。这种技能在儿童早期神经发育阶段至关重要。受Raven渐进矩阵(RPM)和韦氏儿童智力量表(WISC)中矩阵推理任务的启发,我们提出了一个新的数据集MaRs-VQA,以评估MLLM的视觉认知能力,并将其性能与现有的人类视觉认知研究进行比较。基于MaRs-VQA的训练数据,我们还使用多阶段认知推理注释对基线模型Qwen2-VCog进行了微调。我们与不同基线的对比实验揭示了MLLM与人类智能之间的差距,突出了当前MLLM的视觉认知局限性。我们相信MaRs-VQA和Qwen2-VCog基线模型的公开发布将推动下一代具有类人视觉认知能力的MLLM的发展。MaRs-VQA可在huggingface.co/datasets/IrohXu/VCog-Bench获取。Qwen2-VCog的训练代码可在github.com/IrohXu/Cognition-MLLM获取。

🔬 方法详解

问题定义:论文旨在解决多模态大语言模型(MLLMs)在视觉认知推理方面的不足。现有MLLMs在处理需要高层次抽象、关系推理和视觉工作记忆的任务时表现不佳,无法达到人类水平。特别是在类似Raven渐进矩阵(RPM)的矩阵推理任务中,MLLMs难以准确识别图像间的模式关系并进行有效推断。

核心思路:论文的核心思路是通过构建一个专门用于评估和提升MLLMs视觉认知能力的数据集MaRs-VQA,来弥合MLLMs与人类智能之间的差距。该数据集模拟了人类在解决矩阵推理问题时的认知过程,旨在激发MLLMs学习更高级的视觉推理能力。同时,通过在MaRs-VQA上微调基线模型,验证数据集的有效性并探索提升MLLMs视觉认知能力的方法。

技术框架:论文的技术框架主要包括以下几个部分:1) MaRs-VQA数据集的构建,包含多种矩阵推理问题,并提供多阶段认知推理注释;2) 选择Qwen2作为基线模型,并命名为Qwen2-VCog;3) 使用MaRs-VQA数据集对Qwen2-VCog进行微调,训练模型进行视觉认知推理;4) 设计实验,对比Qwen2-VCog与其它基线模型以及人类在MaRs-VQA上的表现,评估模型的视觉认知能力。

关键创新:论文的关键创新在于提出了MaRs-VQA数据集,这是一个专门用于评估MLLMs视觉认知能力的数据集。与现有的视觉语言数据集不同,MaRs-VQA侧重于考察模型的高层次推理能力,而非简单的图像识别或描述。此外,论文还提供了多阶段认知推理注释,有助于模型学习人类的推理过程。

关键设计:MaRs-VQA数据集的设计参考了Raven渐进矩阵(RPM)和韦氏儿童智力量表(WISC)中的矩阵推理任务,包含了多种不同类型的矩阵推理问题。数据集中的每个问题都包含一个不完整的矩阵,模型需要从多个选项中选择正确的答案来完成矩阵。此外,数据集还提供了多阶段认知推理注释,记录了人类在解决问题时的推理步骤,例如识别图像中的模式、分析模式之间的关系、以及推断缺失的模式。

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使经过在MaRs-VQA数据集上的微调,Qwen2-VCog模型在视觉认知推理方面的表现仍然与人类存在显著差距,突显了当前MLLM在视觉认知方面的局限性。该研究为未来MLLM的发展指明了方向,即需要更加注重提升模型的高层次推理能力。

🎯 应用场景

该研究成果可应用于提升多模态大语言模型在视觉理解和推理方面的能力,使其能够更好地应用于智能助手、自动驾驶、医疗诊断等领域。通过提高模型对复杂视觉信息的理解能力,可以实现更智能、更可靠的自动化系统,例如辅助医生进行医学影像分析,或帮助自动驾驶汽车理解复杂的交通场景。

📄 摘要(原文)

Recently, Multimodal Large Language Models (MLLMs) and Vision Language Models (VLMs) have shown great promise in language-guided perceptual tasks such as recognition, segmentation, and object detection. However, their effectiveness in addressing visual cognition problems that require high-level multi-image reasoning and visual working memory is not well-established. One such challenge is matrix reasoning - the cognitive ability to discern relationships among patterns in a set of images and extrapolate to predict subsequent patterns. This skill is crucial during the early neurodevelopmental stages of children. Inspired by the matrix reasoning tasks in Raven's Progressive Matrices (RPM) and Wechsler Intelligence Scale for Children (WISC), we propose a new dataset MaRs-VQA to evaluate the visual cognition capability of MLLMs and compare their performance with existing human visual cognition studies. Based on the training data of MaRs-VQA, we also finetune a baseline model Qwen2-VCog with multi-stage cognition reasoning annotations. Our comparative experiments with different baselines reveal a gap between MLLMs and human intelligence, highlighting the visual cognitive limitations of current MLLMs. We believe that the public release of MaRs-VQA and the Qwen2-VCog baseline model will drive progress toward the next generation of MLLMs with human-like visual cognition abilities. MaRs-VQA is available at huggingface.co/datasets/IrohXu/VCog-Bench. The training code of Qwen2-VCog is available at github.com/IrohXu/Cognition-MLLM.