Wild-GS: Real-Time Novel View Synthesis from Unconstrained Photo Collections

作者: Jiacong Xu, Yiqun Mei, Vishal M. Patel

分类: cs.CV, cs.GR

发布日期: 2024-06-14

备注: 15 pages, 7 figures

💡 一句话要点

Wild-GS:针对非结构化照片集,实现高效实时的新视角合成

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 新视角合成 3D高斯溅射 神经渲染 非结构化照片集 实时渲染

📋 核心要点

- 现有NeRF方法在处理非结构化照片集时,面临训练成本高、渲染速度慢等问题,限制了实际应用。

- Wild-GS通过改进3D高斯溅射,利用材质属性、全局光照和相机参数建模外观,并显式对齐像素特征。

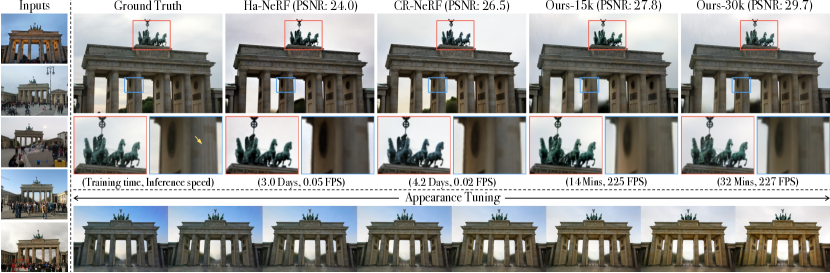

- 实验结果表明,Wild-GS在渲染性能、训练效率和推理速度方面均优于现有技术,达到SOTA水平。

📝 摘要(中文)

在非结构化的旅游环境中拍摄的照片通常具有多变的外观和瞬态遮挡,这给精确的场景重建带来了挑战,并在新视角合成中引入伪影。虽然先前的方法已经将神经辐射场(NeRF)与额外的可学习模块集成,以处理动态外观并消除瞬态对象,但它们大量的训练需求和缓慢的渲染速度限制了实际部署。最近,3D高斯溅射(3DGS)已成为NeRF的一种有前途的替代方案,它提供了卓越的训练和推理效率以及更好的渲染质量。本文提出了一种创新的3DGS改编方法Wild-GS,该方法针对非约束照片集进行了优化,同时保留了其效率优势。Wild-GS通过每个3D高斯固有的材质属性、全局光照和每张图像的相机属性以及反射率的点级局部方差来确定其外观。与先前在图像空间中对参考特征进行建模的方法不同,Wild-GS通过采样从参考图像中提取的三平面,将像素外观特征显式地对齐到相应的局部高斯。这种新颖的设计有效地将参考视图的高频详细外观转移到3D空间,并显着加快了训练过程。此外,利用2D可见性图和深度正则化来分别减轻瞬态效应和约束几何形状。大量的实验表明,Wild-GS在所有现有技术中实现了最先进的渲染性能和最高的训练和推理效率。

🔬 方法详解

问题定义:论文旨在解决从非结构化照片集中进行高质量、高效率的新视角合成问题。现有方法,特别是基于NeRF的方法,在处理具有动态外观和瞬态遮挡的真实世界场景时,需要大量的训练时间和计算资源,渲染速度也较慢,难以满足实时应用的需求。

核心思路:Wild-GS的核心思路是改进3D高斯溅射(3DGS),使其能够更好地处理非结构化照片集中的复杂外观变化和瞬态遮挡。通过显式地将像素外观特征与3D高斯对齐,并结合可见性图和深度正则化,Wild-GS能够更有效地学习场景的几何和外观信息,从而提高渲染质量和效率。

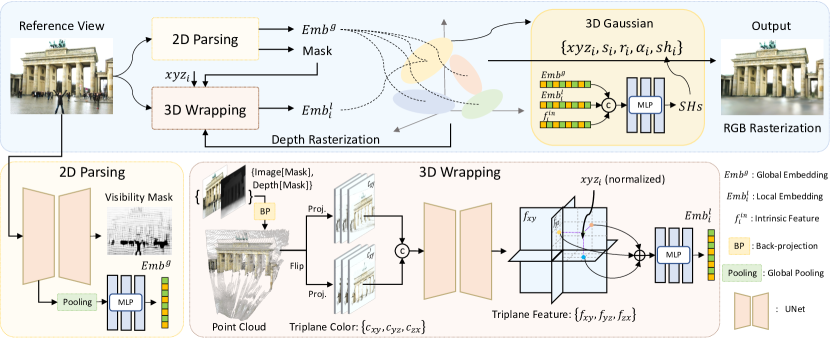

技术框架:Wild-GS的整体框架基于3DGS,主要包含以下几个关键模块:1) 3D高斯表示:使用3D高斯分布来表示场景的几何和外观信息。2) 外观建模:通过材质属性、全局光照、相机参数和局部反射率方差来建模每个3D高斯的外观。3) 特征对齐:从参考图像中提取三平面特征,并将像素外观特征显式地对齐到对应的局部高斯。4) 可见性处理:使用2D可见性图来减轻瞬态遮挡的影响。5) 深度正则化:使用深度正则化来约束场景的几何形状。

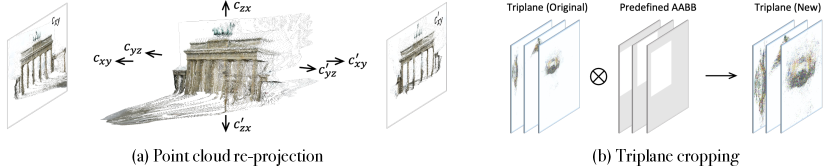

关键创新:Wild-GS的关键创新在于其显式的像素外观特征对齐方法。与以往在图像空间中建模参考特征的方法不同,Wild-GS通过采样参考图像的三平面特征,将像素外观特征直接映射到3D高斯上。这种方法能够更有效地将参考视图的高频细节信息传递到3D空间,从而提高渲染质量和训练效率。

关键设计:Wild-GS的关键设计包括:1) 使用材质属性、全局光照、相机参数和局部反射率方差来建模外观,能够更好地捕捉场景中的复杂光照效果和外观变化。2) 使用三平面特征进行特征对齐,能够有效地利用参考图像中的高频细节信息。3) 使用2D可见性图和深度正则化来分别减轻瞬态遮挡和约束几何形状,从而提高渲染的鲁棒性和准确性。

🖼️ 关键图片

📊 实验亮点

Wild-GS在多个数据集上取得了state-of-the-art的渲染性能,并在训练和推理效率方面显著优于现有方法。实验结果表明,Wild-GS在渲染质量和效率方面都达到了最佳的平衡,为非结构化照片集的新视角合成提供了一种有效的解决方案。

🎯 应用场景

Wild-GS在旅游景点重建、虚拟现实、增强现实、自动驾驶等领域具有广泛的应用前景。它可以用于快速生成高质量的3D场景模型,为用户提供沉浸式的体验。此外,Wild-GS的高效率使其能够应用于实时渲染和交互式应用,例如实时导航和游戏。

📄 摘要(原文)

Photographs captured in unstructured tourist environments frequently exhibit variable appearances and transient occlusions, challenging accurate scene reconstruction and inducing artifacts in novel view synthesis. Although prior approaches have integrated the Neural Radiance Field (NeRF) with additional learnable modules to handle the dynamic appearances and eliminate transient objects, their extensive training demands and slow rendering speeds limit practical deployments. Recently, 3D Gaussian Splatting (3DGS) has emerged as a promising alternative to NeRF, offering superior training and inference efficiency along with better rendering quality. This paper presents Wild-GS, an innovative adaptation of 3DGS optimized for unconstrained photo collections while preserving its efficiency benefits. Wild-GS determines the appearance of each 3D Gaussian by their inherent material attributes, global illumination and camera properties per image, and point-level local variance of reflectance. Unlike previous methods that model reference features in image space, Wild-GS explicitly aligns the pixel appearance features to the corresponding local Gaussians by sampling the triplane extracted from the reference image. This novel design effectively transfers the high-frequency detailed appearance of the reference view to 3D space and significantly expedites the training process. Furthermore, 2D visibility maps and depth regularization are leveraged to mitigate the transient effects and constrain the geometry, respectively. Extensive experiments demonstrate that Wild-GS achieves state-of-the-art rendering performance and the highest efficiency in both training and inference among all the existing techniques.