Towards Evaluating the Robustness of Visual State Space Models

作者: Hashmat Shadab Malik, Fahad Shamshad, Muzammal Naseer, Karthik Nandakumar, Fahad Shahbaz Khan, Salman Khan

分类: cs.CV

发布日期: 2024-06-13 (更新: 2024-09-16)

🔗 代码/项目: GITHUB

💡 一句话要点

评估视觉状态空间模型在各种扰动下的鲁棒性,并与Transformer和CNN进行对比。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 视觉状态空间模型 鲁棒性评估 对抗攻击 图像损坏 目标检测 图像分割 频率分析

📋 核心要点

- 现有视觉状态空间模型(VSSMs)在复杂视觉场景下的鲁棒性有待考量,尤其是在面对自然扰动和对抗攻击时。

- 该论文通过系统性的实验,评估VSSMs在各种扰动下的性能,并与Transformer和CNN等主流模型进行对比分析。

- 实验结果揭示了VSSMs在处理不同类型视觉损坏时的优势和不足,为后续研究提供了重要的参考依据。

📝 摘要(中文)

视觉状态空间模型(VSSMs)结合了循环神经网络和隐变量模型的优势,在视觉感知任务中表现出色,能有效捕捉长程依赖关系并建模复杂的视觉动态。然而,它们在自然和对抗扰动下的鲁棒性仍然是一个关键问题。本文全面评估了VSSMs在各种扰动场景下的鲁棒性,包括遮挡、图像结构、常见损坏和对抗攻击,并将其性能与Transformer和卷积神经网络等成熟架构进行了比较。此外,我们还研究了VSSMs在复杂基准测试中对目标-背景组合变化的弹性,这些基准旨在测试模型在复杂视觉场景中的性能。我们还使用模拟真实场景的损坏数据集评估了它们在目标检测和分割任务中的鲁棒性。为了更深入地了解VSSMs的对抗鲁棒性,我们对对抗攻击进行了基于频率的分析,评估了它们在低频和高频扰动下的性能。我们的研究结果突出了VSSMs在处理复杂视觉损坏方面的优势和局限性,为未来的研究提供了有价值的见解。我们的代码和模型将在https://github.com/HashmatShadab/MambaRobustness上提供。

🔬 方法详解

问题定义:论文旨在评估视觉状态空间模型(VSSMs)在各种扰动下的鲁棒性。现有方法,如Transformer和CNN,在特定扰动下表现不佳,且缺乏对VSSMs鲁棒性的系统性评估。因此,需要研究VSSMs在不同扰动下的性能,并与现有模型进行比较,从而了解其优势和局限性。

核心思路:论文的核心思路是通过设计一系列实验,模拟真实世界中可能遇到的各种扰动,包括遮挡、图像结构变化、常见损坏和对抗攻击。通过在这些扰动下评估VSSMs的性能,可以了解其鲁棒性。同时,将VSSMs的性能与Transformer和CNN等模型进行比较,可以了解其相对优势和劣势。

技术框架:论文的整体框架包括以下几个主要步骤:1) 选择VSSMs、Transformer和CNN作为研究对象;2) 设计各种扰动场景,包括遮挡、图像结构变化、常见损坏和对抗攻击;3) 在这些扰动场景下评估模型的性能,使用目标检测、图像分割等任务作为评估指标;4) 对实验结果进行分析,比较不同模型在不同扰动下的性能,从而了解VSSMs的鲁棒性。

关键创新:论文的关键创新在于对VSSMs的鲁棒性进行了系统性的评估,并将其与Transformer和CNN等模型进行了比较。此外,论文还对对抗攻击进行了基于频率的分析,评估了模型在低频和高频扰动下的性能。这些分析为理解VSSMs的鲁棒性提供了新的视角。

关键设计:论文的关键设计包括:1) 选择了具有代表性的扰动类型,如遮挡、图像结构变化、常见损坏和对抗攻击;2) 使用了标准的目标检测和图像分割数据集,并对这些数据集进行了损坏处理,以模拟真实场景;3) 使用了常用的评估指标,如mAP和IoU,来评估模型的性能;4) 对对抗攻击进行了基于频率的分析,使用了不同的对抗攻击方法,并评估了模型在不同频率扰动下的性能。

🖼️ 关键图片

📊 实验亮点

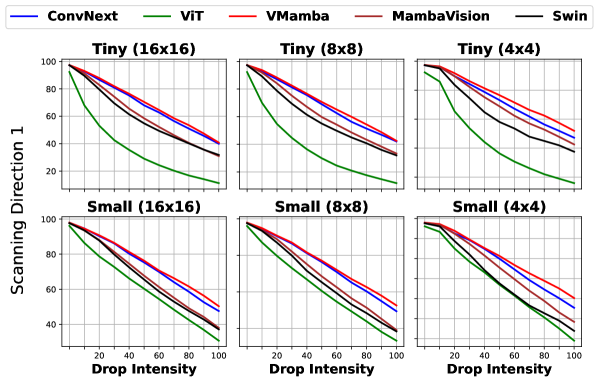

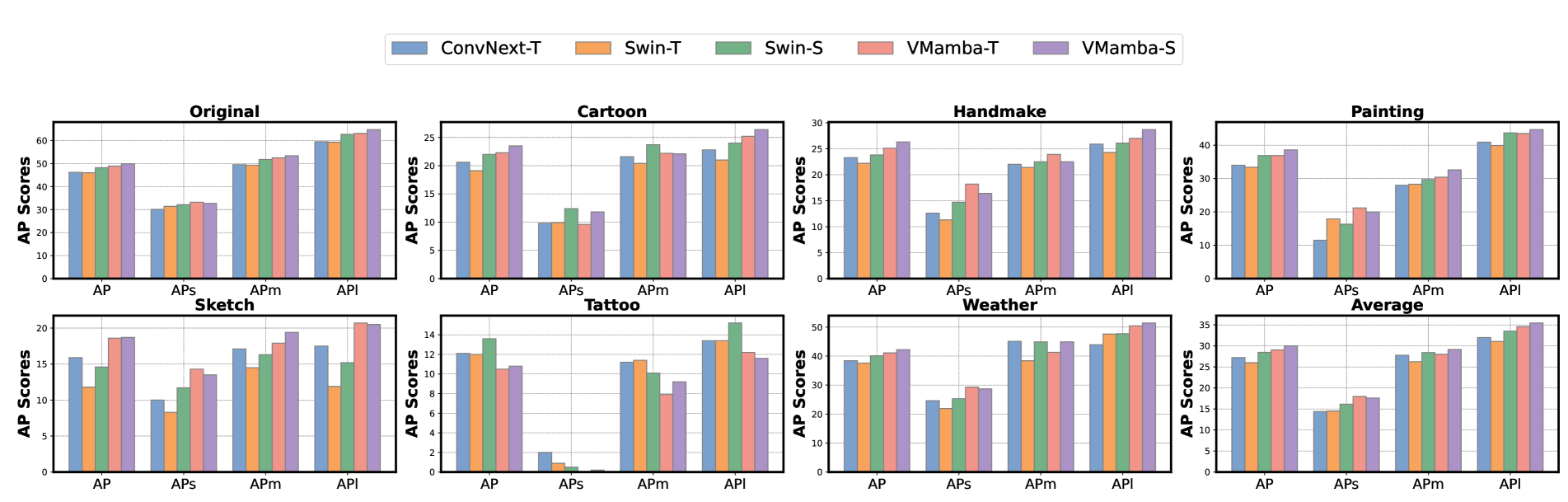

实验结果表明,VSSMs在某些类型的扰动下表现出较好的鲁棒性,例如对遮挡和图像结构变化的抵抗能力优于Transformer和CNN。然而,在对抗攻击下,VSSMs的性能下降明显,尤其是在高频扰动下。频率分析揭示了VSSMs对不同频率扰动的敏感性差异。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人视觉、医学图像分析等领域,提升模型在复杂环境下的可靠性。通过了解VSSMs的鲁棒性,可以更好地将其应用于实际场景,并指导未来模型的改进方向,例如设计更鲁棒的VSSM架构。

📄 摘要(原文)

Vision State Space Models (VSSMs), a novel architecture that combines the strengths of recurrent neural networks and latent variable models, have demonstrated remarkable performance in visual perception tasks by efficiently capturing long-range dependencies and modeling complex visual dynamics. However, their robustness under natural and adversarial perturbations remains a critical concern. In this work, we present a comprehensive evaluation of VSSMs' robustness under various perturbation scenarios, including occlusions, image structure, common corruptions, and adversarial attacks, and compare their performance to well-established architectures such as transformers and Convolutional Neural Networks. Furthermore, we investigate the resilience of VSSMs to object-background compositional changes on sophisticated benchmarks designed to test model performance in complex visual scenes. We also assess their robustness on object detection and segmentation tasks using corrupted datasets that mimic real-world scenarios. To gain a deeper understanding of VSSMs' adversarial robustness, we conduct a frequency-based analysis of adversarial attacks, evaluating their performance against low-frequency and high-frequency perturbations. Our findings highlight the strengths and limitations of VSSMs in handling complex visual corruptions, offering valuable insights for future research. Our code and models will be available at https://github.com/HashmatShadab/MambaRobustness.