WonderWorld: Interactive 3D Scene Generation from a Single Image

作者: Hong-Xing Yu, Haoyi Duan, Charles Herrmann, William T. Freeman, Jiajun Wu

分类: cs.CV, cs.GR

发布日期: 2024-06-13 (更新: 2025-03-25)

备注: CVPR 2025. Project website: https://kovenyu.com/WonderWorld/. The first two authors contributed equally

💡 一句话要点

WonderWorld:基于单张图像的交互式3D场景生成框架

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D场景生成 单视图重建 交互式编辑 高斯Surfels 深度扩散

📋 核心要点

- 现有3D场景生成方法速度慢,依赖多视图和耗时的几何优化,限制了交互性。

- WonderWorld提出快速分层高斯Surfels (FLAGS) 表示,并结合几何初始化和引导深度扩散加速生成。

- WonderWorld在单A6000 GPU上10秒内生成连贯3D场景,支持实时交互式内容创作。

📝 摘要(中文)

WonderWorld是一个新颖的交互式3D场景生成框架,它允许用户交互式地指定场景内容和布局,并以低延迟查看创建的场景。主要挑战在于快速生成3D场景。现有的场景生成方法速度不足,因为它们通常需要(1)逐步生成多个视图和深度图,以及(2)耗时的场景几何表示优化。我们引入了快速分层高斯Surfels(FLAGS)作为我们的场景表示,以及一种从单个视图生成它的算法。我们的方法不需要多个视图,并且它利用基于几何的初始化,从而显著减少了优化时间。另一个挑战是生成连贯的几何体,允许所有场景连接。我们引入了引导深度扩散,允许深度估计的部分条件化。WonderWorld在单个A6000 GPU上以不到10秒的速度生成连接且多样化的3D场景,从而实现实时的用户交互和探索。我们展示了WonderWorld在虚拟环境中用于用户驱动的内容创建和探索的潜力。我们发布了完整的代码和软件以实现可重复性。

🔬 方法详解

问题定义:现有3D场景生成方法通常需要从多个视图生成深度图,并进行耗时的几何优化,导致生成速度慢,难以支持实时的交互式场景编辑。这些方法在用户修改场景内容或布局时,需要重新进行大量的计算,严重影响了用户体验。

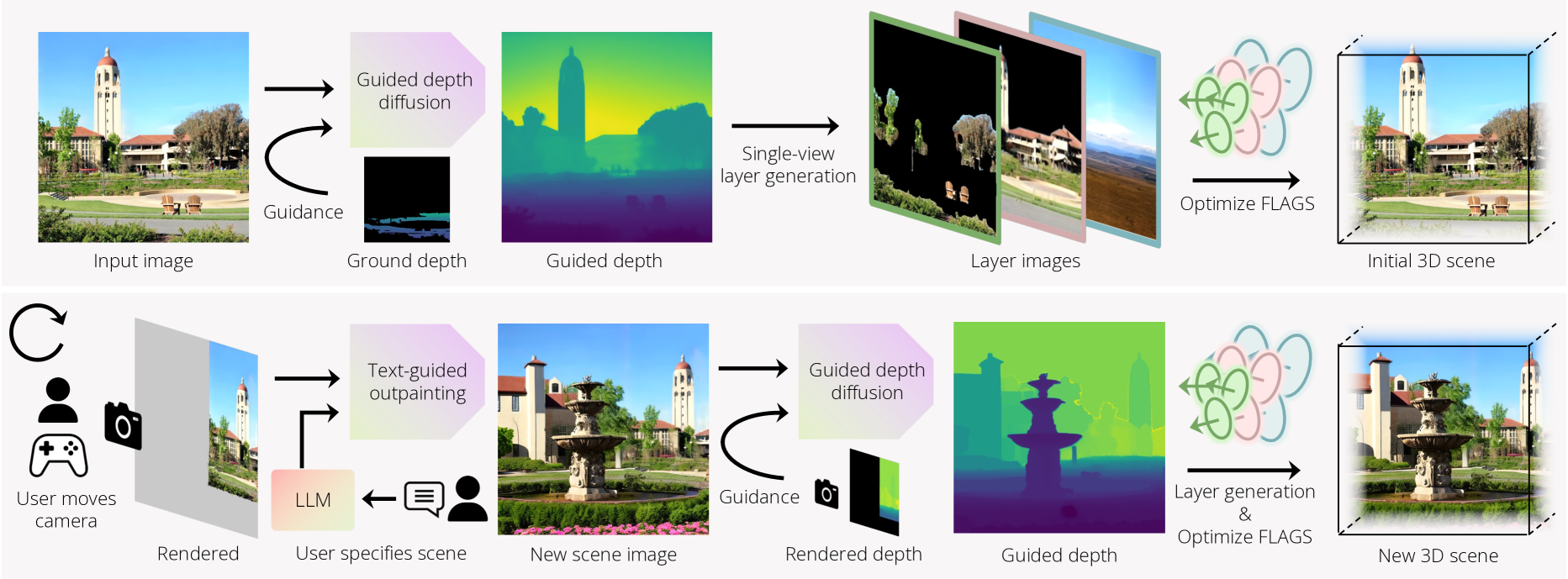

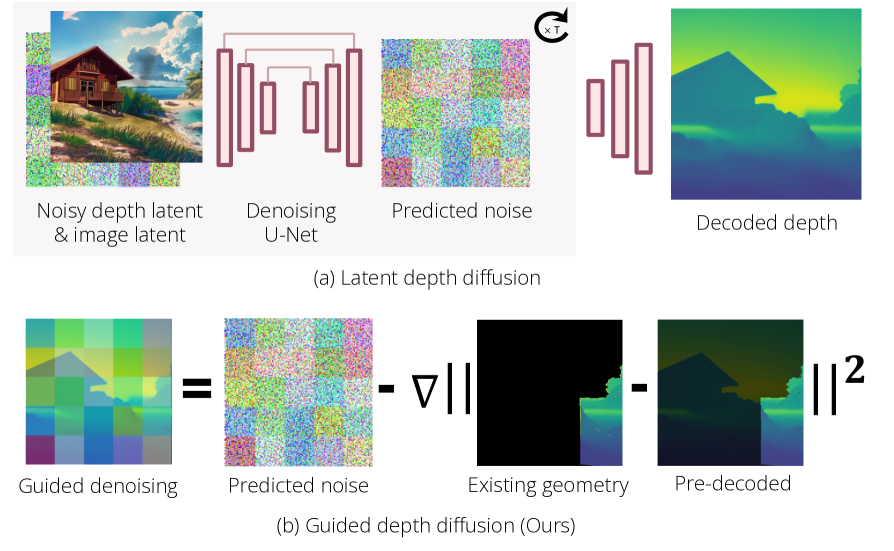

核心思路:WonderWorld的核心思路是通过一种新的场景表示方法(FLAGS)和单视图生成算法来加速3D场景的生成过程。FLAGS能够高效地表示场景的几何和外观信息,而单视图生成算法避免了多视图重建的复杂性。此外,通过几何初始化和引导深度扩散,可以进一步减少优化时间和提高场景的连贯性。

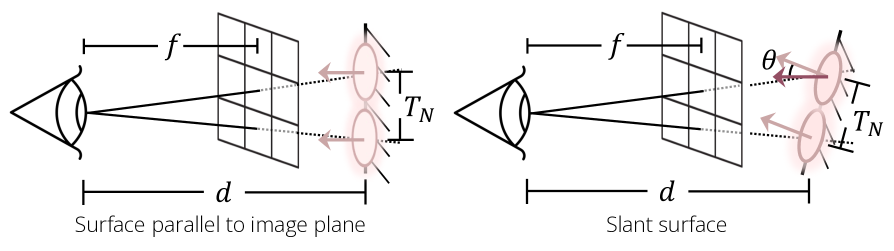

技术框架:WonderWorld的整体框架包括以下几个主要模块:1) 单视图深度估计:从单张输入图像估计场景的深度信息。2) FLAGS初始化:利用估计的深度信息初始化FLAGS表示。3) 几何优化:对FLAGS表示进行优化,以提高场景的几何质量。4) 引导深度扩散:通过部分条件化深度估计,生成连贯的场景几何。整个流程的目标是在尽可能短的时间内生成高质量的3D场景,并支持用户进行实时的交互式编辑。

关键创新:WonderWorld的关键创新在于以下几个方面:1) 提出了快速分层高斯Surfels (FLAGS) 作为场景表示,能够高效地表示场景的几何和外观信息。2) 提出了一种单视图生成算法,避免了多视图重建的复杂性,从而显著提高了生成速度。3) 引入了引导深度扩散,允许深度估计的部分条件化,从而生成连贯的场景几何。

关键设计:WonderWorld的关键设计包括:1) FLAGS表示的参数化方式,如何有效地表示场景的几何和外观信息。2) 几何初始化的方法,如何利用深度信息初始化FLAGS表示,从而减少优化时间。3) 引导深度扩散的条件化方式,如何通过部分条件化深度估计,生成连贯的场景几何。具体的损失函数和网络结构等技术细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

WonderWorld在单张A6000 GPU上,能够在10秒内生成连贯且多样化的3D场景,显著优于现有的多视图重建方法。通过与现有方法的对比实验,证明了WonderWorld在生成速度和场景质量方面的优势。论文提供了完整的代码和软件,方便研究人员进行复现和进一步研究。

🎯 应用场景

WonderWorld在虚拟现实、游戏开发、室内设计等领域具有广泛的应用前景。它可以用于快速生成各种虚拟环境,支持用户进行实时的交互式场景编辑和内容创作。例如,用户可以根据自己的喜好,快速创建个性化的虚拟房间或游戏场景。此外,WonderWorld还可以用于训练机器人,使其能够在各种虚拟环境中进行导航和操作。

📄 摘要(原文)

We present WonderWorld, a novel framework for interactive 3D scene generation that enables users to interactively specify scene contents and layout and see the created scenes in low latency. The major challenge lies in achieving fast generation of 3D scenes. Existing scene generation approaches fall short of speed as they often require (1) progressively generating many views and depth maps, and (2) time-consuming optimization of the scene geometry representations. We introduce the Fast Layered Gaussian Surfels (FLAGS) as our scene representation and an algorithm to generate it from a single view. Our approach does not need multiple views, and it leverages a geometry-based initialization that significantly reduces optimization time. Another challenge is generating coherent geometry that allows all scenes to be connected. We introduce the guided depth diffusion that allows partial conditioning of depth estimation. WonderWorld generates connected and diverse 3D scenes in less than 10 seconds on a single A6000 GPU, enabling real-time user interaction and exploration. We demonstrate the potential of WonderWorld for user-driven content creation and exploration in virtual environments. We release full code and software for reproducibility. Project website: https://kovenyu.com/WonderWorld/.