Neural NeRF Compression

作者: Tuan Pham, Stephan Mandt

分类: cs.CV, cs.LG

发布日期: 2024-06-13

备注: Accepted to ICML 2024

💡 一句话要点

提出一种基于神经压缩的NeRF模型压缩方法,有效降低存储开销。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 神经辐射场 NeRF压缩 神经压缩 特征网格 率失真优化

📋 核心要点

- 基于特征网格的NeRF模型虽然提升了渲染质量和速度,但其存储开销巨大,成为实际应用的瓶颈。

- 论文提出一种基于神经压缩的NeRF模型压缩方法,通过非线性变换编码和轻量级解码器实现高效压缩。

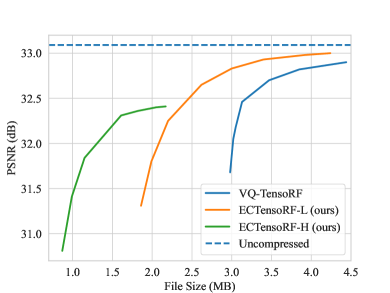

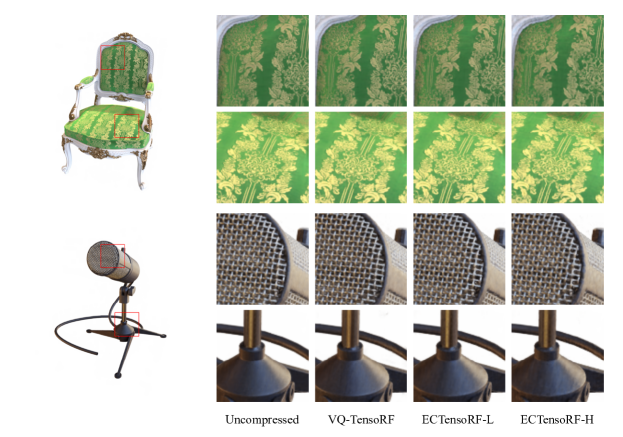

- 实验结果表明,该方法在压缩效率和重建质量上均优于现有方法,验证了其有效性。

📝 摘要(中文)

神经辐射场(NeRFs)已成为通过连续体表示捕获详细3D场景的强大工具。最近的NeRFs利用特征网格来提高渲染质量和速度;然而,这些表示引入了显著的存储开销。本文提出了一种有效压缩基于网格的NeRF模型的新方法,解决了存储开销问题。我们的方法基于非线性变换编码范式,采用神经压缩来压缩模型的特征网格。由于缺乏涉及许多独立同分布场景的训练数据,我们为单个场景设计了一种无编码器、端到端优化的方法,使用轻量级解码器。为了利用潜在特征网格的空间非均匀性,我们引入了重要性加权率失真目标和一个采用掩蔽机制的稀疏熵模型。我们的实验结果验证了我们提出的方法在基于网格的NeRF压缩效率和重建质量方面优于现有工作。

🔬 方法详解

问题定义:现有基于特征网格的NeRF模型,例如Instant-NGP,虽然在渲染速度和质量上表现出色,但其存储空间需求非常大,限制了其在资源受限设备上的应用。如何有效地压缩这些特征网格,同时保持渲染质量,是本文要解决的核心问题。现有方法可能无法在压缩率和重建质量之间取得良好的平衡,或者需要大量的训练数据。

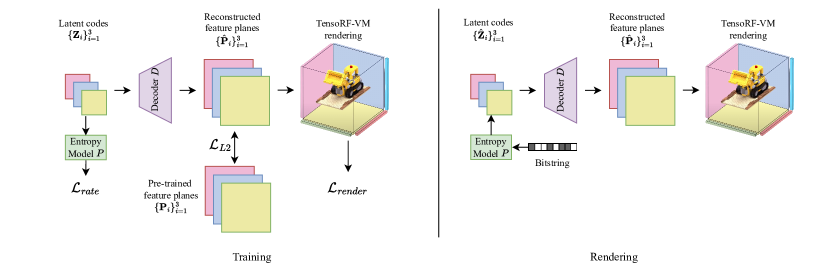

核心思路:本文的核心思路是利用神经压缩技术,将NeRF模型的特征网格视为一种图像或特征图,并使用非线性变换编码对其进行压缩。为了克服缺乏大量训练数据的难题,论文采用了一种无编码器的端到端优化方法,针对每个场景单独训练一个轻量级的解码器。此外,考虑到特征网格的空间非均匀性,引入了重要性加权和稀疏熵模型,以进一步提高压缩效率。

技术框架:该方法主要包含以下几个阶段:1) 特征网格提取:从预训练的NeRF模型中提取特征网格。2) 神经压缩:使用一个轻量级的解码器网络,将压缩后的潜在表示解码回特征网格。3) 端到端优化:联合优化解码器网络和潜在表示,以最小化重建误差和码率。4) 重要性加权和稀疏熵模型:利用掩蔽机制,对特征网格中重要的区域进行重点编码,并对潜在表示进行稀疏化,以进一步提高压缩率。

关键创新:该方法的关键创新在于:1) 提出了一种无编码器的端到端神经压缩方法,避免了对大量训练数据的依赖。2) 引入了重要性加权和稀疏熵模型,充分利用了特征网格的空间非均匀性,提高了压缩效率。3) 将神经压缩技术应用于NeRF模型的特征网格压缩,为NeRF模型的轻量化提供了一种新的思路。

关键设计:1) 解码器网络结构:采用轻量级的卷积神经网络作为解码器,以减少计算量。2) 重要性权重:根据特征网格中每个位置的梯度大小,确定其重要性权重。3) 稀疏熵模型:使用Gumbel-Softmax技巧,对潜在表示进行稀疏化,以降低码率。4) 损失函数:采用重要性加权率失真损失函数,平衡重建误差和码率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在压缩率和重建质量上均优于现有方法。具体来说,在保持相似的渲染质量下,该方法可以将NeRF模型的存储空间压缩到原来的1/10甚至更小。与直接对特征网格进行量化的方法相比,该方法能够显著提高压缩率,同时保持较高的渲染质量。

🎯 应用场景

该研究成果可应用于各种需要高效存储和传输3D场景的应用中,例如:移动端的AR/VR应用、在线3D模型展示、自动驾驶中的场景重建等。通过降低NeRF模型的存储开销,可以使其更容易部署在资源受限的设备上,并加速其在各个领域的应用。

📄 摘要(原文)

Neural Radiance Fields (NeRFs) have emerged as powerful tools for capturing detailed 3D scenes through continuous volumetric representations. Recent NeRFs utilize feature grids to improve rendering quality and speed; however, these representations introduce significant storage overhead. This paper presents a novel method for efficiently compressing a grid-based NeRF model, addressing the storage overhead concern. Our approach is based on the non-linear transform coding paradigm, employing neural compression for compressing the model's feature grids. Due to the lack of training data involving many i.i.d scenes, we design an encoder-free, end-to-end optimized approach for individual scenes, using lightweight decoders. To leverage the spatial inhomogeneity of the latent feature grids, we introduce an importance-weighted rate-distortion objective and a sparse entropy model employing a masking mechanism. Our experimental results validate that our proposed method surpasses existing works in terms of grid-based NeRF compression efficacy and reconstruction quality.