LLM-assisted Concept Discovery: Automatically Identifying and Explaining Neuron Functions

作者: Nhat Hoang-Xuan, Minh Vu, My T. Thai

分类: cs.CV

发布日期: 2024-06-12

💡 一句话要点

提出LLM辅助的概念发现方法,自动识别并解释神经网络神经元功能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 深度神经网络解释性 概念发现 大型语言模型 多模态学习 神经元功能分析

📋 核心要点

- 现有方法依赖预定义概念或示例,限制了解释范围,难以发现新概念,且需要人工干预。

- 利用多模态LLM进行开放式概念发现,无需预定义概念集,自动生成神经元功能的文本解释。

- 通过生成示例和反例验证概念,并评估神经元响应,实现概念发现和验证的自动化。

📝 摘要(中文)

本文提出了一种利用多模态大型语言模型(LLM)自动进行开放式概念发现的方法,旨在为深度神经网络(DNN)中的神经元提供基于文本的概念解释,从而理解DNN模型的工作原理。与以往基于概念示例或预定义概念集将概念与神经元关联的方法不同,该方法不限制可能的解释,从而能够发现新的概念,并且无需用户手动定义概念集或收集示例。通过生成概念的示例和反例,并评估神经元对这些新图像的响应来验证每个概念。该方法能够同时发现和验证概念,为解释深度神经网络提供了一个可信的自动化工具。

🔬 方法详解

问题定义:现有方法在解释深度神经网络神经元功能时,依赖于预定义的概念集合或人工提供的概念示例。这限制了解释的范围,使得模型只能解释用户预期的概念,而无法发现模型内部真正学习到的新概念。此外,定义这些概念集合需要大量的人工工作,无论是直接指定概念还是收集示例,都非常耗时耗力。

核心思路:本文的核心思路是利用多模态大型语言模型(LLM)的强大能力,自动地从神经元的激活模式中提取概念,并用自然语言进行描述。通过LLM的开放式生成能力,避免了对预定义概念的依赖,从而能够发现模型内部的新概念。同时,利用LLM的多模态能力,可以结合图像信息和文本信息,更好地理解神经元的功能。

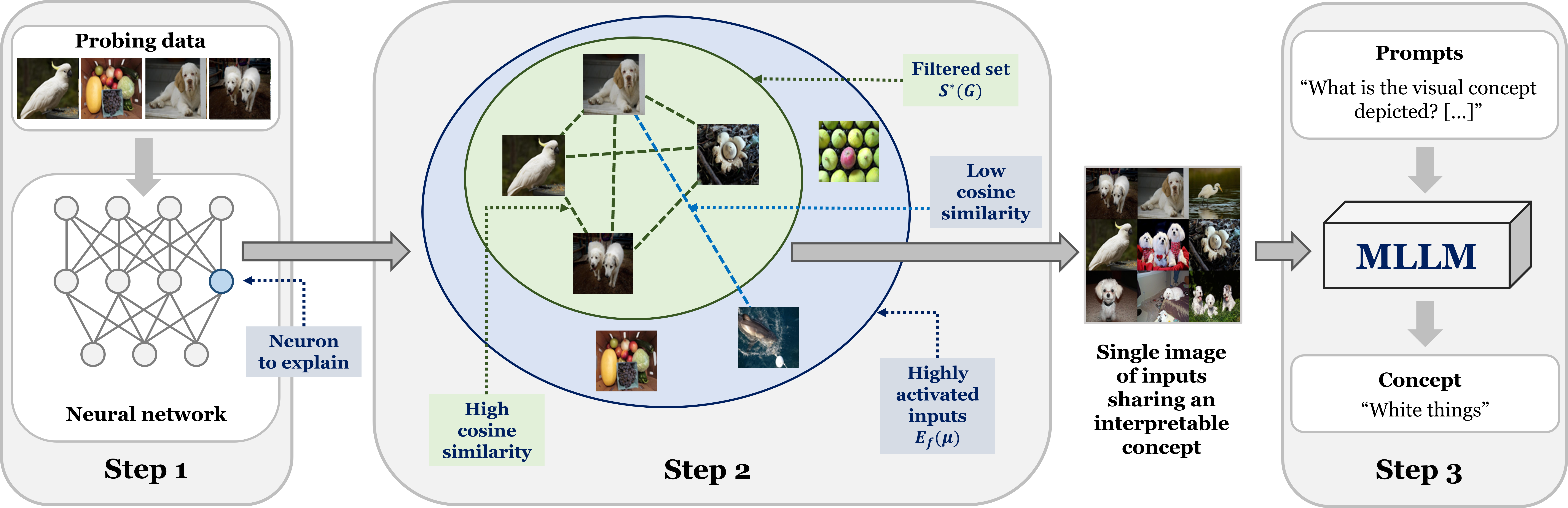

技术框架:该方法主要包含以下几个阶段:1) 神经元激活模式提取:首先,收集大量图像数据,并将其输入到待解释的深度神经网络中,记录每个神经元的激活值。2) LLM概念生成:将神经元的激活模式输入到多模态LLM中,LLM根据激活模式生成对神经元功能的文本描述,即概念。3) 概念验证:为了验证生成的概念的有效性,利用LLM生成该概念的示例图像和反例图像。4) 神经元响应评估:将生成的示例图像和反例图像输入到深度神经网络中,评估神经元对这些图像的响应。如果神经元对示例图像的响应明显高于对反例图像的响应,则认为该概念是有效的。

关键创新:该方法最重要的技术创新点在于利用多模态LLM进行开放式概念发现。与现有方法相比,该方法无需预定义概念集合,能够自动发现模型内部的新概念。此外,该方法还能够同时验证生成的概念,提高了概念解释的可信度。

关键设计:在LLM概念生成阶段,需要选择合适的LLM模型,并设计合适的prompt,以引导LLM生成高质量的概念描述。在概念验证阶段,需要设计合适的指标来评估神经元对示例图像和反例图像的响应差异。此外,还需要考虑如何处理LLM生成的概念描述中的噪声和冗余信息。

🖼️ 关键图片

📊 实验亮点

该论文提出的方法能够自动发现并解释深度神经网络中的神经元功能,无需预定义概念集。通过生成示例和反例验证概念,提高了概念解释的可信度。实验结果表明,该方法能够发现现有方法无法发现的新概念,并提供更忠实于模型行为的解释。

🎯 应用场景

该研究成果可应用于深度神经网络的可解释性分析、模型调试和优化、以及知识发现等领域。通过自动识别和解释神经元的功能,可以帮助研究人员更好地理解深度学习模型的工作原理,从而改进模型的设计和性能。此外,该方法还可以用于发现新的概念和知识,例如,可以用于分析医学图像,发现新的疾病特征。

📄 摘要(原文)

Providing textual concept-based explanations for neurons in deep neural networks (DNNs) is of importance in understanding how a DNN model works. Prior works have associated concepts with neurons based on examples of concepts or a pre-defined set of concepts, thus limiting possible explanations to what the user expects, especially in discovering new concepts. Furthermore, defining the set of concepts requires manual work from the user, either by directly specifying them or collecting examples. To overcome these, we propose to leverage multimodal large language models for automatic and open-ended concept discovery. We show that, without a restricted set of pre-defined concepts, our method gives rise to novel interpretable concepts that are more faithful to the model's behavior. To quantify this, we validate each concept by generating examples and counterexamples and evaluating the neuron's response on this new set of images. Collectively, our method can discover concepts and simultaneously validate them, providing a credible automated tool to explain deep neural networks.