PixMamba: Leveraging State Space Models in a Dual-Level Architecture for Underwater Image Enhancement

作者: Wei-Tung Lin, Yong-Xiang Lin, Jyun-Wei Chen, Kai-Lung Hua

分类: cs.CV

发布日期: 2024-06-12

🔗 代码/项目: GITHUB

💡 一句话要点

PixMamba:双层状态空间模型用于水下图像增强,提升全局一致性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 水下图像增强 状态空间模型 Mamba 全局建模 双层架构

📋 核心要点

- 现有水下图像增强方法计算成本高昂,且全局建模能力不足,导致图像局部区域出现过度或不足的调整。

- PixMamba利用状态空间模型(SSM)高效捕获全局依赖关系,克服了CNN感受野有限和Transformer计算量大的问题。

- PixMamba在多个水下图像数据集上取得了SOTA性能,并提供了视觉效果更佳的增强图像。

📝 摘要(中文)

水下图像增强(UIE)对于海洋研究和探索至关重要,但受到复杂颜色失真和严重模糊的影响。 近期基于深度学习的方法取得了显著成果,但这些方法在高计算成本和全局建模不足方面存在不足,导致局部区域出现欠调整或过调整。 我们提出了PixMamba,一种新颖的架构,旨在通过利用状态空间模型(SSM)进行高效的全局依赖建模来克服这些挑战。 与感受野有限的卷积神经网络(CNN)和计算成本高的Transformer网络不同,PixMamba有效地捕获全局上下文信息,同时保持计算效率。 我们的双层策略包括用于重建增强图像特征的patch级别的Efficient Mamba Net(EMNet)和像素级别的PixMamba Net(PixNet),以确保精细的特征捕获和增强图像的全局一致性,而这些在以前很难获得。 PixMamba在各种水下图像数据集上实现了最先进的性能,并提供了视觉上更优越的结果。 代码可在https://github.com/weitunglin/pixmamba获得。

🔬 方法详解

问题定义:水下图像增强旨在校正水下图像中存在的颜色失真和模糊,以提高图像质量和可理解性。现有基于深度学习的方法虽然取得了一定进展,但通常面临计算资源需求高、难以有效建模全局上下文信息的问题,导致增强后的图像在局部区域出现不一致或失真。

核心思路:PixMamba的核心思路是利用状态空间模型(SSM)来高效地捕获水下图像的全局依赖关系。SSM能够在保持较低计算复杂度的同时,有效地建模长距离依赖,从而避免了CNN感受野有限和Transformer计算量大的问题。通过全局建模,可以更好地校正颜色和对比度,并保持图像的整体一致性。

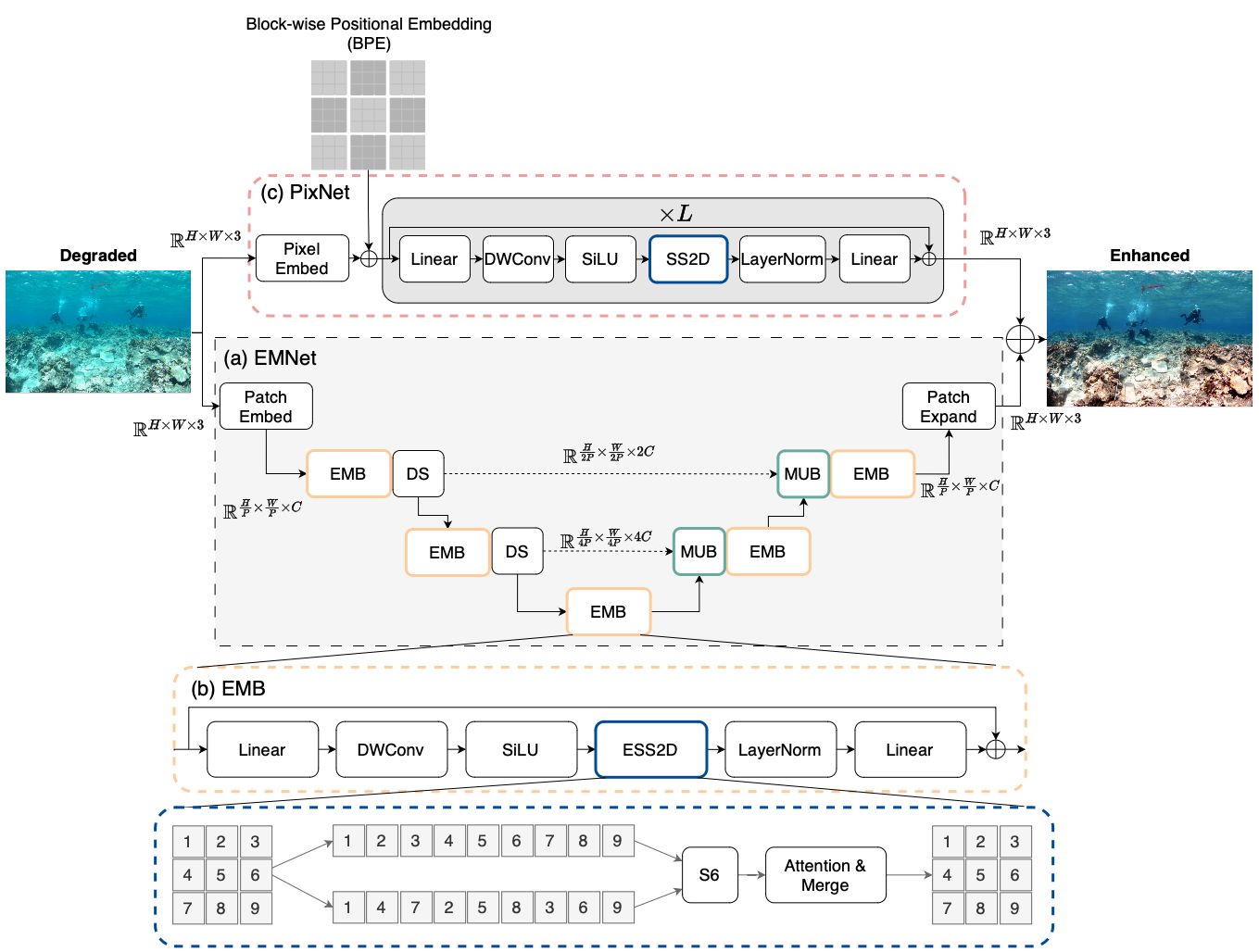

技术框架:PixMamba采用双层架构,包含Patch-level Efficient Mamba Net (EMNet) 和 Pixel-level PixMamba Net (PixNet)。EMNet首先在图像块级别提取特征并进行初步增强,然后PixNet在像素级别进行精细调整,以确保最终增强图像的全局一致性和细节清晰度。这种双层结构允许模型在不同尺度上捕获图像特征,从而实现更有效的增强。

关键创新:PixMamba的关键创新在于将状态空间模型(特别是Mamba架构)引入到水下图像增强任务中,并设计了双层网络结构。与传统的CNN和Transformer相比,Mamba在建模长距离依赖方面具有优势,并且计算效率更高。双层结构则允许模型在不同尺度上进行特征提取和增强,从而提高了增强效果。

关键设计:EMNet和PixNet都基于Mamba架构,具体参数设置未知。损失函数未知,但推测可能包含重建损失、感知损失或对抗损失等,以保证增强图像的质量和真实感。网络结构的关键在于双层设计,通过EMNet进行初步增强,再通过PixNet进行精细调整,从而实现全局一致性和细节清晰度。

🖼️ 关键图片

📊 实验亮点

PixMamba在多个水下图像数据集上实现了最先进的性能(SOTA),表明其在水下图像增强方面具有显著优势。论文强调了PixMamba在视觉效果上的优越性,暗示了其在主观视觉质量方面超越了现有方法。具体的性能数据和对比基线未知,但SOTA的结果表明其性能提升具有统计意义。

🎯 应用场景

PixMamba在海洋科学研究、水下机器人视觉、水下考古、水下环境监测等领域具有广泛的应用前景。高质量的水下图像能够帮助科学家更好地研究海洋生物、探索水下遗迹、监测水下环境变化,并提高水下机器人的自主导航和作业能力。该研究的成果有助于推动相关领域的发展。

📄 摘要(原文)

Underwater Image Enhancement (UIE) is critical for marine research and exploration but hindered by complex color distortions and severe blurring. Recent deep learning-based methods have achieved remarkable results, yet these methods struggle with high computational costs and insufficient global modeling, resulting in locally under- or over- adjusted regions. We present PixMamba, a novel architecture, designed to overcome these challenges by leveraging State Space Models (SSMs) for efficient global dependency modeling. Unlike convolutional neural networks (CNNs) with limited receptive fields and transformer networks with high computational costs, PixMamba efficiently captures global contextual information while maintaining computational efficiency. Our dual-level strategy features the patch-level Efficient Mamba Net (EMNet) for reconstructing enhanced image feature and the pixel-level PixMamba Net (PixNet) to ensure fine-grained feature capturing and global consistency of enhanced image that were previously difficult to obtain. PixMamba achieves state-of-the-art performance across various underwater image datasets and delivers visually superior results. Code is available at: https://github.com/weitunglin/pixmamba.