From Chaos to Clarity: 3DGS in the Dark

作者: Zhihao Li, Yufei Wang, Alex Kot, Bihan Wen

分类: eess.IV, cs.CV

发布日期: 2024-06-12

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出Raw3DGS框架,解决低光照raw图像下3DGS重建质量下降问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 新视角合成 原始图像 噪声鲁棒性 自监督学习

📋 核心要点

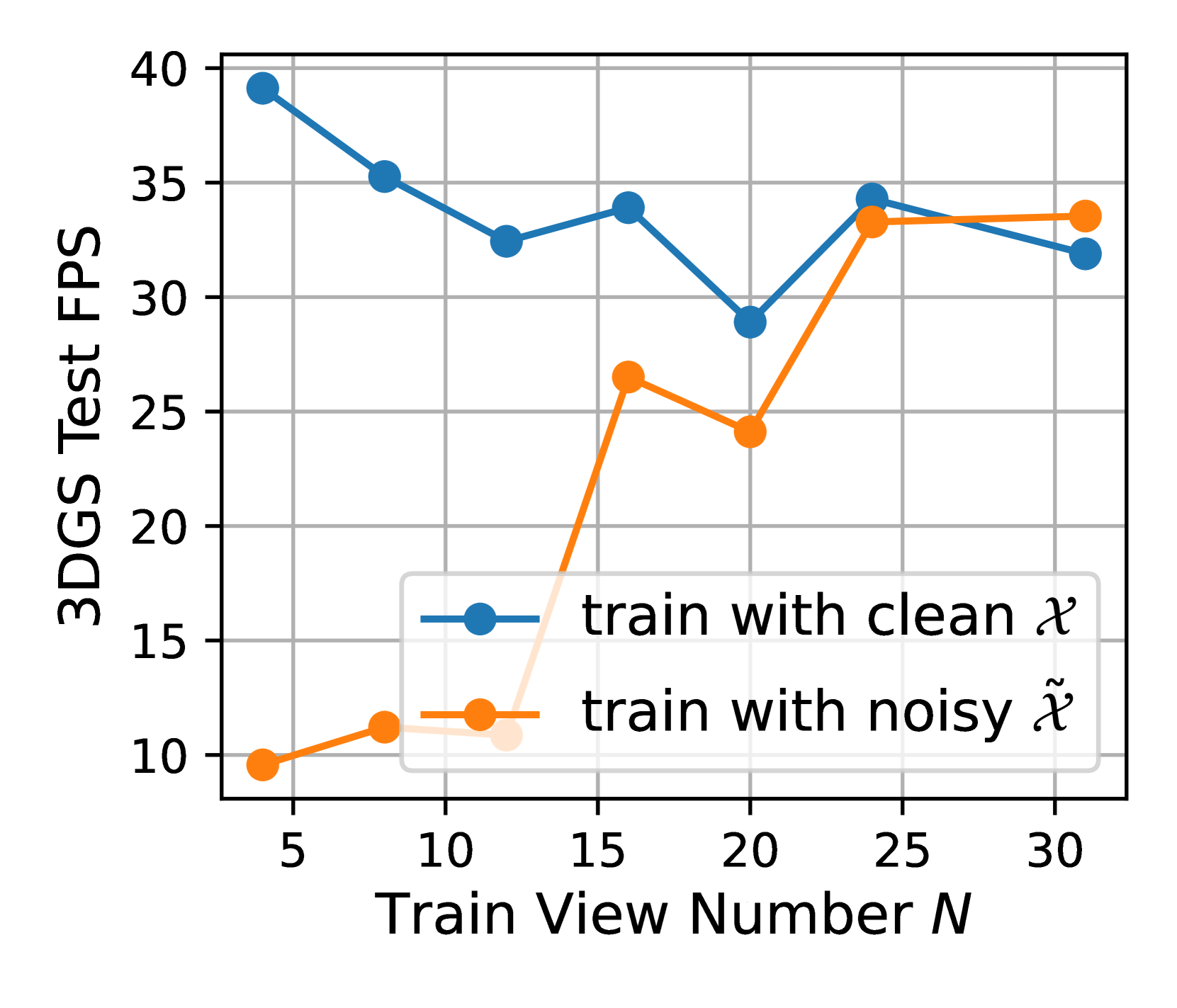

- 现有方法在噪声较大的raw图像上进行3DGS重建时,易受噪声干扰,导致重建质量下降和推理速度降低。

- 论文提出自监督学习框架Raw3DGS,通过噪声提取和噪声鲁棒损失函数,提升3DGS在噪声环境下的性能。

- 实验表明,Raw3DGS在RawNeRF数据集上,相比现有LDR/HDR 3DGS及SOTA模型,重建质量和推理速度均有提升。

📝 摘要(中文)

本文提出了一种新颖的自监督学习框架,旨在从有限数量的噪声raw图像中重建HDR 3D高斯溅射(3DGS)。与从低动态范围RGB图像重建相比,从原始图像进行新视角合成能够提供卓越的高动态范围(HDR)信息。然而,原始图像中固有的噪声会降低3D场景表示的准确性。研究表明,3DGS特别容易受到这种噪声的影响,导致大量细长的Gaussian形状过度拟合噪声,从而显著降低重建质量并降低推理速度,尤其是在视图数量有限的情况下。该框架通过集成噪声提取器并采用利用噪声分布先验的噪声鲁棒重建损失来增强3DGS。实验结果表明,在各种训练视图下,该方法在RawNeRF数据集上的重建质量和推理速度均优于LDR/HDR 3DGS以及先前的最先进(SOTA)自监督和监督预训练模型。

🔬 方法详解

问题定义:论文旨在解决在低光照或高动态范围场景下,直接从未经处理的raw图像进行3D高斯溅射(3DGS)重建时,由于图像噪声的影响,导致重建质量下降和推理速度变慢的问题。现有的3DGS方法通常基于干净的RGB图像进行训练,无法有效处理raw图像中存在的噪声,导致高斯分布过度拟合噪声,产生大量细长的高斯形状,从而降低重建效果。

核心思路:论文的核心思路是通过自监督学习的方式,显式地建模和去除raw图像中的噪声,并设计噪声鲁棒的损失函数,从而提高3DGS模型在噪声环境下的重建能力。通过引入噪声提取器,学习raw图像中的噪声分布,并利用该分布作为先验知识,指导3DGS模型的训练,使其能够更好地抵抗噪声的干扰。

技术框架:Raw3DGS框架主要包含以下几个模块:1) 噪声提取器:用于从raw图像中提取噪声信息,学习噪声的分布特征。2) 3DGS模型:用于从去噪后的图像中重建3D场景。3) 噪声鲁棒损失函数:用于指导3DGS模型的训练,使其能够更好地抵抗噪声的干扰。整体流程是,首先利用噪声提取器从raw图像中提取噪声信息,然后将去噪后的图像输入到3DGS模型中进行重建,最后利用噪声鲁棒损失函数对模型进行优化。

关键创新:论文的关键创新在于:1) 提出了一个自监督学习框架,能够直接从raw图像中重建高质量的3D场景。2) 引入了噪声提取器,显式地建模和去除raw图像中的噪声。3) 设计了噪声鲁棒的损失函数,提高了3DGS模型在噪声环境下的重建能力。与现有方法相比,Raw3DGS能够更好地处理raw图像中的噪声,从而获得更高的重建质量和更快的推理速度。

关键设计:论文的关键设计包括:1) 噪声提取器的网络结构和训练方式。2) 噪声鲁棒损失函数的具体形式,例如,可以采用基于噪声分布先验的正则化项,或者采用对噪声不敏感的损失函数。3) 3DGS模型的参数设置和优化策略。4) 如何将噪声提取器和3DGS模型进行联合训练,以实现最佳的重建效果。具体的参数设置、损失函数和网络结构等细节需要在论文中进一步查找。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Raw3DGS在RawNeRF数据集上取得了显著的性能提升。在重建质量方面,Raw3DGS优于LDR/HDR 3DGS以及先前的SOTA自监督和监督预训练模型。在推理速度方面,Raw3DGS也优于其他方法。具体的数据指标需要在论文中查找,例如PSNR、SSIM等。

🎯 应用场景

该研究成果可应用于低光照或高动态范围场景下的三维重建、新视角合成等领域。例如,在自动驾驶中,可以利用该方法从车载摄像头拍摄的raw图像中重建周围环境的三维模型,提高自动驾驶系统的感知能力。在医学影像领域,可以利用该方法从低剂量CT图像中重建高质量的三维模型,减少患者的辐射暴露。此外,该方法还可以应用于虚拟现实、增强现实等领域,提供更逼真的沉浸式体验。

📄 摘要(原文)

Novel view synthesis from raw images provides superior high dynamic range (HDR) information compared to reconstructions from low dynamic range RGB images. However, the inherent noise in unprocessed raw images compromises the accuracy of 3D scene representation. Our study reveals that 3D Gaussian Splatting (3DGS) is particularly susceptible to this noise, leading to numerous elongated Gaussian shapes that overfit the noise, thereby significantly degrading reconstruction quality and reducing inference speed, especially in scenarios with limited views. To address these issues, we introduce a novel self-supervised learning framework designed to reconstruct HDR 3DGS from a limited number of noisy raw images. This framework enhances 3DGS by integrating a noise extractor and employing a noise-robust reconstruction loss that leverages a noise distribution prior. Experimental results show that our method outperforms LDR/HDR 3DGS and previous state-of-the-art (SOTA) self-supervised and supervised pre-trained models in both reconstruction quality and inference speed on the RawNeRF dataset across a broad range of training views. Code can be found in \url{https://lizhihao6.github.io/Raw3DGS}.