MotionClone: Training-Free Motion Cloning for Controllable Video Generation

作者: Pengyang Ling, Jiazi Bu, Pan Zhang, Xiaoyi Dong, Yuhang Zang, Tong Wu, Huaian Chen, Jiaqi Wang, Yi Jin

分类: cs.CV

发布日期: 2024-06-08 (更新: 2024-10-22)

备注: 18 pages, 14 figures, https://bujiazi.github.io/motionclone.github.io/

💡 一句话要点

MotionClone:一种免训练的运动克隆方法,用于可控视频生成

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 视频生成 运动克隆 免训练 时间注意力 可控生成

📋 核心要点

- 现有可控视频生成方法依赖于训练或微调来编码运动信息,缺乏灵活性和泛化能力。

- MotionClone通过稀疏时间注意力权重提取运动表示,实现免训练的运动克隆和控制。

- 实验表明,MotionClone在运动保真度、文本对齐和时间一致性方面优于现有方法。

📝 摘要(中文)

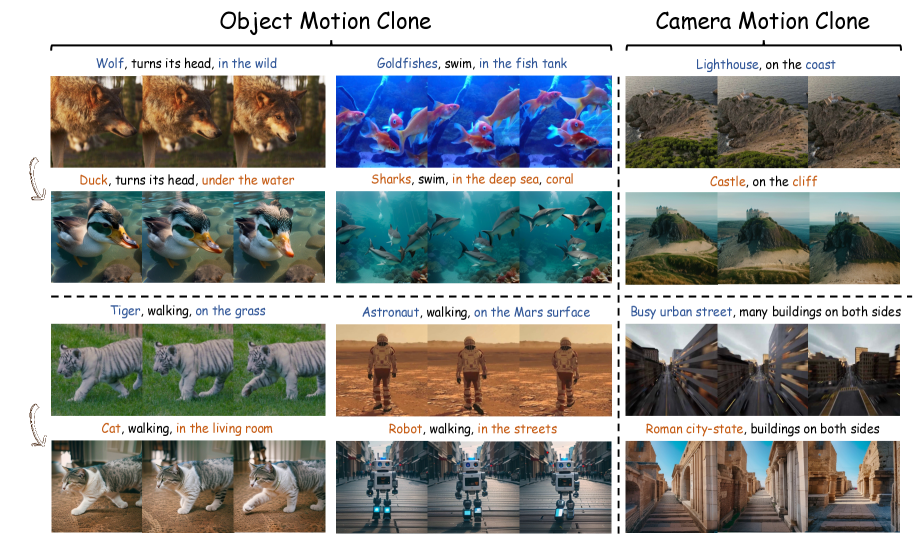

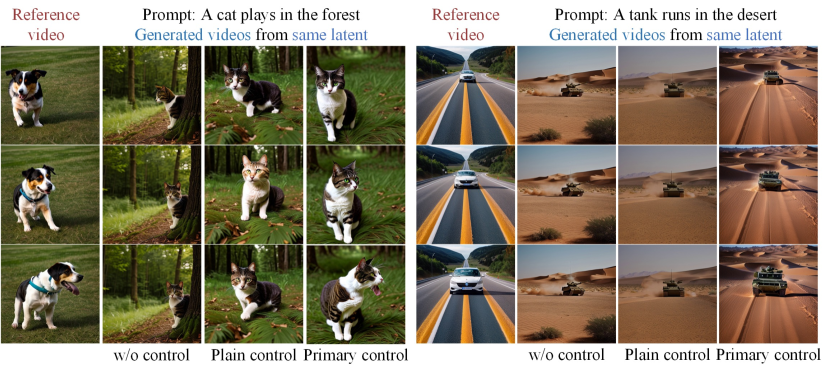

基于运动的可控视频生成为创建引人入胜的视觉内容提供了潜力。现有方法通常需要模型训练来编码特定的运动线索,或者需要进行微调以注入某些运动模式,导致灵活性和泛化性受限。本文提出MotionClone,一个免训练的框架,能够从参考视频中克隆运动,从而实现通用的运动控制视频生成,包括文本到视频和图像到视频。基于时间注意力图中主要成分驱动运动合成,而其余成分主要捕获噪声或非常细微的运动的观察,MotionClone利用稀疏时间注意力权重作为运动表示进行运动引导,促进跨不同场景的多样化运动转移。同时,MotionClone允许通过单个去噪步骤直接提取运动表示,绕过繁琐的反演过程,从而提高效率和灵活性。大量实验表明,MotionClone在全局相机运动和局部对象运动方面均表现出熟练性,在运动保真度、文本对齐和时间一致性方面具有显著优势。

🔬 方法详解

问题定义:现有基于运动的可控视频生成方法,如文本到视频、图像到视频等,通常需要针对特定运动线索进行模型训练或微调,这限制了模型的灵活性和泛化能力。例如,针对特定运动模式训练的模型难以适应新的运动模式,而微调过程则耗时且需要大量数据。因此,如何实现一种免训练的、通用的运动控制视频生成方法是一个关键问题。

核心思路:MotionClone的核心思路是利用预训练的视频生成模型中的时间注意力机制,提取稀疏的时间注意力权重作为运动表示。作者观察到,时间注意力图中的主要成分驱动运动合成,而其余成分主要捕获噪声或细微运动。因此,通过稀疏化时间注意力权重,可以得到更纯粹的运动表示,并将其用于运动引导,从而实现运动克隆和控制。

技术框架:MotionClone的整体框架包括以下几个主要步骤:1) 从参考视频中提取稀疏时间注意力权重作为运动表示;2) 将提取的运动表示注入到视频生成模型的去噪过程中;3) 通过控制注入的运动表示,实现对生成视频的运动控制。该框架可以应用于文本到视频和图像到视频等多种场景。

关键创新:MotionClone的关键创新在于:1) 提出了一种免训练的运动克隆方法,避免了针对特定运动模式进行训练或微调的需要;2) 利用稀疏时间注意力权重作为运动表示,能够更有效地提取和表示运动信息;3) 通过单个去噪步骤直接提取运动表示,绕过了繁琐的反演过程,提高了效率和灵活性。

关键设计:MotionClone的关键设计包括:1) 使用预训练的文本到图像扩散模型作为视频生成模型的基础;2) 通过阈值化或Top-K选择等方法对时间注意力权重进行稀疏化;3) 将稀疏化的时间注意力权重作为条件,注入到扩散模型的去噪过程中,引导视频生成。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MotionClone在运动保真度、文本对齐和时间一致性方面均优于现有方法。例如,在文本到视频生成任务中,MotionClone能够生成与文本描述高度相关的视频,并且视频中的运动与参考视频中的运动高度一致。定量指标显示,MotionClone在运动相似度方面比现有方法提升了显著的百分比。

🎯 应用场景

MotionClone具有广泛的应用前景,包括:1) 视频编辑:用户可以通过提供参考视频,轻松地将参考视频中的运动克隆到新的视频中;2) 虚拟现实/增强现实:可以用于创建具有逼真运动的虚拟角色或物体;3) 游戏开发:可以用于生成具有多样化运动的游戏角色动画。该研究有望推动视频生成技术的发展,并为用户提供更灵活、更易用的视频创作工具。

📄 摘要(原文)

Motion-based controllable video generation offers the potential for creating captivating visual content. Existing methods typically necessitate model training to encode particular motion cues or incorporate fine-tuning to inject certain motion patterns, resulting in limited flexibility and generalization. In this work, we propose MotionClone, a training-free framework that enables motion cloning from reference videos to versatile motion-controlled video generation, including text-to-video and image-to-video. Based on the observation that the dominant components in temporal-attention maps drive motion synthesis, while the rest mainly capture noisy or very subtle motions, MotionClone utilizes sparse temporal attention weights as motion representations for motion guidance, facilitating diverse motion transfer across varying scenarios. Meanwhile, MotionClone allows for the direct extraction of motion representation through a single denoising step, bypassing the cumbersome inversion processes and thus promoting both efficiency and flexibility. Extensive experiments demonstrate that MotionClone exhibits proficiency in both global camera motion and local object motion, with notable superiority in terms of motion fidelity, textual alignment, and temporal consistency.