Varying Manifolds in Diffusion: From Time-varying Geometries to Visual Saliency

作者: Junhao Chen, Manyi Li, Zherong Pan, Xifeng Gao, Changhe Tu

分类: cs.CV, cs.LG

发布日期: 2024-06-07

💡 一句话要点

提出基于生成率的扩散模型几何分析方法,实现图像显著性操控及多种图像编辑任务。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 扩散模型 生成率 流形学习 图像编辑 显著性操控

📋 核心要点

- 现有生成模型缺乏对数据流形几何特性的深入理解,限制了其在图像操作任务中的应用。

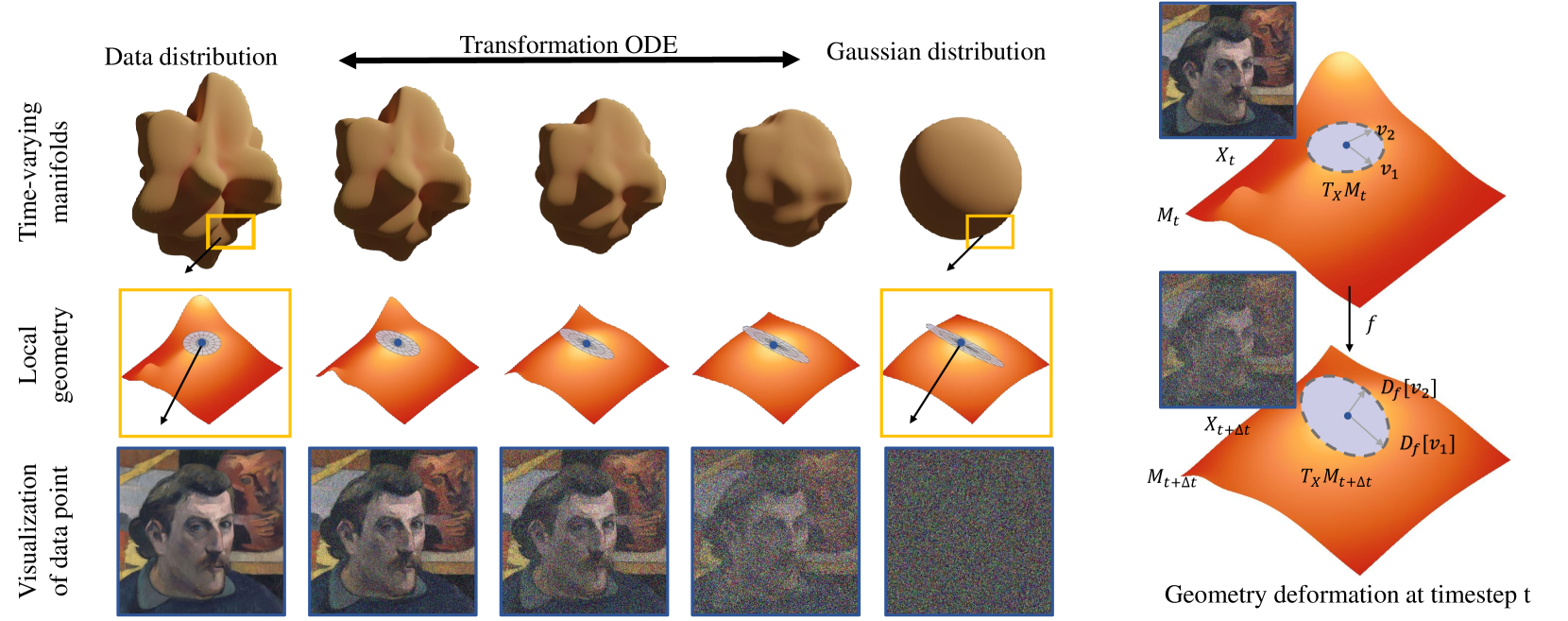

- 提出基于生成率的扩散模型几何分析方法,通过分析流形随时间的局部变形来理解图像组件的视觉属性。

- 实验表明,该方法在语义迁移、对象移除、显著性操控和图像融合等任务上优于现有基线方法。

📝 摘要(中文)

深度生成模型学习到的数据分布集中在低维流形上。对分布转换的几何分析能够更好地理解数据结构,并支持各种应用。本文研究了扩散模型的几何特性,其前向扩散过程和反向生成过程构建了一系列随时间变化的流形上的分布。核心贡献是引入了生成率,它对应于图像组件周围流形随时间的局部变形。研究表明,生成率与图像组件的直观视觉属性(如视觉显著性)高度相关。此外,提出了一种高效且可微的方案来估计给定图像组件随时间的生成率,从而得到生成曲线。该方案的可微性允许通过优化来控制生成曲线的形状。利用不同的损失函数,生成曲线匹配算法为包括语义迁移、对象移除、显著性操控、图像融合等一系列图像操作任务提供了一个统一的框架。通过全面的分析评估来支持研究结果,并在各种操作任务上评估了该框架。结果表明,与最近的基线方法相比,该方法始终能获得更好的操作结果。

🔬 方法详解

问题定义:现有基于扩散模型的图像编辑方法通常缺乏对图像内容几何结构的理解,难以精确控制图像编辑过程,尤其是在显著性操控和复杂场景编辑方面。现有方法难以有效利用扩散模型在流形上的生成特性,导致编辑结果不够自然或精确。

核心思路:本文的核心思路是分析扩散模型在生成图像过程中,数据流形随时间的变化。通过引入“生成率”这一概念,量化图像不同区域在生成过程中的变化速度,从而将图像的视觉属性(如显著性)与扩散模型的生成过程联系起来。通过控制生成率,可以实现对图像特定区域的精确操控。

技术框架:该方法主要包含以下几个阶段:1) 前向扩散过程:将原始图像逐步加入噪声,直至完全变为噪声;2) 反向生成过程:从噪声出发,逐步生成图像;3) 生成率估计:提出可微方案估计图像组件在反向生成过程中的生成率,得到生成曲线;4) 生成曲线匹配:通过优化,调整生成曲线的形状,从而实现对图像的操控。整个框架是端到端可微的,允许使用梯度下降等方法进行优化。

关键创新:最重要的技术创新点在于引入了“生成率”的概念,并将其与图像的视觉属性联系起来。通过分析生成率,可以更好地理解扩散模型的生成过程,并实现对图像的精确操控。与现有方法相比,该方法能够更有效地利用扩散模型在流形上的生成特性,从而获得更自然、更精确的编辑结果。

关键设计:生成率的估计采用可微的方案,允许通过梯度下降进行优化。生成曲线匹配使用不同的损失函数,以适应不同的图像操作任务。例如,在显著性操控任务中,使用损失函数来鼓励生成曲线向目标曲线靠近。网络结构方面,使用了标准的扩散模型架构,并在此基础上添加了生成率估计模块。具体的参数设置和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在语义迁移、对象移除、显著性操控和图像融合等任务上均优于现有基线方法。例如,在显著性操控任务中,该方法能够更精确地控制图像的显著性区域,生成更符合人类视觉感知的图像。定量指标和定性结果均表明,该方法具有显著的优势。

🎯 应用场景

该研究成果可应用于图像编辑、计算机辅助设计、视觉内容创作等领域。例如,可以用于快速生成具有特定显著性特征的图像,或者用于自动化地移除图像中的干扰元素。此外,该方法还可以用于图像修复、图像增强等任务,具有广泛的应用前景。

📄 摘要(原文)

Deep generative models learn the data distribution, which is concentrated on a low-dimensional manifold. The geometric analysis of distribution transformation provides a better understanding of data structure and enables a variety of applications. In this paper, we study the geometric properties of the diffusion model, whose forward diffusion process and reverse generation process construct a series of distributions on manifolds which vary over time. Our key contribution is the introduction of generation rate, which corresponds to the local deformation of manifold over time around an image component. We show that the generation rate is highly correlated with intuitive visual properties, such as visual saliency, of the image component. Further, we propose an efficient and differentiable scheme to estimate the generation rate for a given image component over time, giving rise to a generation curve. The differentiable nature of our scheme allows us to control the shape of the generation curve via optimization. Using different loss functions, our generation curve matching algorithm provides a unified framework for a range of image manipulation tasks, including semantic transfer, object removal, saliency manipulation, image blending, etc. We conduct comprehensive analytical evaluations to support our findings and evaluate our framework on various manipulation tasks. The results show that our method consistently leads to better manipulation results, compared to recent baselines.