SMC++: Masked Learning of Unsupervised Video Semantic Compression

作者: Yuan Tian, Xiaoyue Ling, Cong Geng, Qiang Hu, Guo Lu, Guangtao Zhai

分类: cs.CV, cs.MM

发布日期: 2024-06-07 (更新: 2025-10-13)

备注: Accepted to TPAMI; Substantial Extension of ICCV 2023 paper

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于掩码学习的无监督视频语义压缩框架SMC++,提升视频分析任务性能

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 视频压缩 语义压缩 掩码视频建模 自监督学习 视频分析

📋 核心要点

- 现有视频压缩方法侧重视觉感知,忽略语义信息,导致下游视频分析任务性能下降。

- 提出基于掩码视频建模的压缩框架,通过自监督学习挖掘并压缩视频语义,保留关键语义信息。

- 实验结果表明,SMC和SMC++模型在视频分析任务上显著优于传统和可学习的视频编解码器。

📝 摘要(中文)

大多数视频压缩方法侧重于人类视觉感知,忽略了语义信息的保留,导致压缩过程中严重的语义损失,阻碍了下游视频分析任务。本文提出了一种基于掩码视频建模(MVM)的压缩框架,通过自监督的方式联合挖掘和压缩视频语义,从而特别地保留视频语义。虽然MVM擅长通过掩码块预测任务学习可泛化的语义,但它也可能编码非语义信息,如琐碎的纹理细节,浪费比特成本并带来语义噪声。为了抑制这一点,我们显式地正则化了MVM token空间中压缩视频的非语义熵。所提出的框架被实例化为一个简单的语义挖掘-然后压缩(SMC)模型。此外,我们从几个方面将SMC扩展为一个高级的SMC++模型。首先,我们为其配备了一个掩码运动预测目标,从而提高了时间语义学习能力。其次,我们引入了一个基于Transformer的压缩模块,以提高语义压缩效率。考虑到直接挖掘不同编码阶段异构特征之间的复杂冗余并非易事,我们引入了一个紧凑的蓝图语义表示,将这些特征对齐成相似的形式,充分释放基于Transformer的压缩模块的强大功能。大量的实验结果表明,在三个视频分析任务和七个数据集上,所提出的SMC和SMC++模型比以前的传统、可学习和面向感知质量的视频编解码器显示出显著的优越性。

🔬 方法详解

问题定义:现有视频压缩方法主要关注人类视觉感知,忽略了视频中蕴含的语义信息。这导致压缩后的视频虽然在视觉上可以接受,但在语义层面上损失严重,从而影响了下游的视频分析任务,例如视频分类、目标检测等。现有方法无法有效区分语义信息和非语义信息,导致压缩效率低下,且引入语义噪声。

核心思路:本文的核心思路是通过掩码视频建模(Masked Video Modeling, MVM)来学习视频的语义表示,并在此基础上进行压缩。通过MVM,模型可以学习到视频中重要的语义信息,例如物体的类别、场景的类型等。同时,为了避免模型编码非语义信息(例如纹理细节),作者引入了正则化项,显式地抑制非语义熵。

技术框架:整个框架包含语义挖掘和压缩两个主要阶段。首先,利用MVM对视频进行编码,得到语义表示。然后,通过一个压缩模块对语义表示进行压缩,得到压缩后的视频。为了进一步提高压缩效率,作者提出了SMC++模型,该模型引入了掩码运动预测目标和基于Transformer的压缩模块。掩码运动预测目标可以提高模型的时间语义学习能力,基于Transformer的压缩模块可以更有效地压缩语义表示。

关键创新:本文的关键创新在于将掩码视频建模(MVM)引入到视频压缩领域,并提出了一种新的语义压缩框架。该框架可以有效地保留视频的语义信息,从而提高下游视频分析任务的性能。此外,作者还提出了SMC++模型,该模型通过引入掩码运动预测目标和基于Transformer的压缩模块,进一步提高了压缩效率和语义保留能力。

关键设计:SMC++模型中,掩码运动预测目标通过预测被掩盖的运动信息来增强模型的时间语义理解能力。基于Transformer的压缩模块利用自注意力机制来捕捉不同编码阶段异构特征之间的冗余信息。为了解决异构特征难以直接压缩的问题,作者引入了蓝图语义表示,将这些特征对齐成相似的形式,从而充分发挥Transformer的压缩能力。损失函数包括重建损失、正则化项和压缩损失,共同优化模型的语义保留能力和压缩效率。

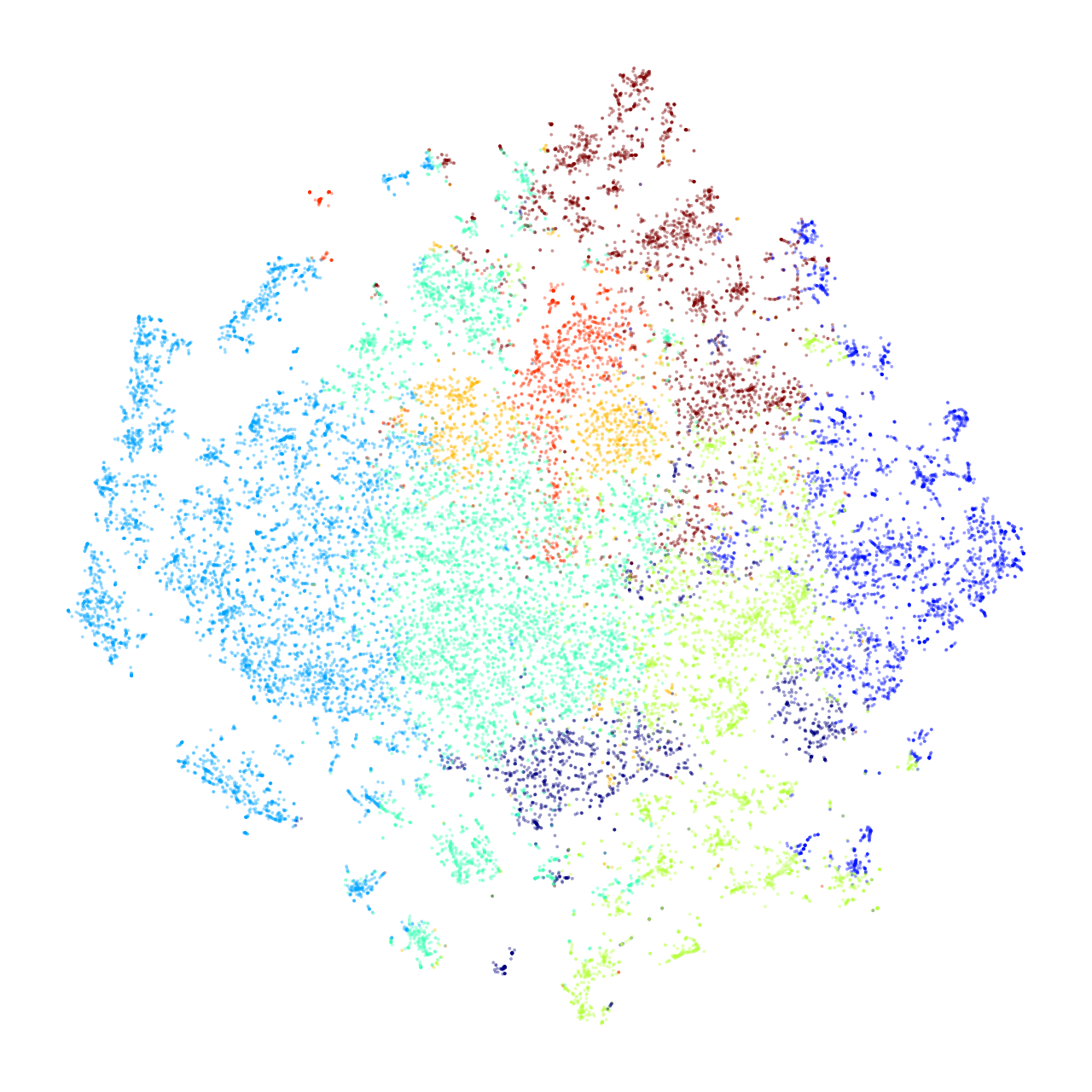

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的SMC和SMC++模型在三个视频分析任务和七个数据集上,显著优于传统的、可学习的和面向感知质量的视频编解码器。具体性能提升数据未知,但论文强调了在多个数据集和任务上的“显著优越性”,表明该方法具有较强的泛化能力和实用价值。

🎯 应用场景

该研究成果可应用于视频监控、智能交通、视频会议、在线教育等领域。通过在压缩过程中保留视频语义信息,可以提高这些应用中视频分析任务的准确性和效率。例如,在视频监控中,可以更准确地检测异常行为;在智能交通中,可以更有效地识别交通事件。

📄 摘要(原文)

Most video compression methods focus on human visual perception, neglecting semantic preservation. This leads to severe semantic loss during the compression, hampering downstream video analysis tasks. In this paper, we propose a Masked Video Modeling (MVM)-powered compression framework that particularly preserves video semantics, by jointly mining and compressing the semantics in a self-supervised manner. While MVM is proficient at learning generalizable semantics through the masked patch prediction task, it may also encode non-semantic information like trivial textural details, wasting bitcost and bringing semantic noises. To suppress this, we explicitly regularize the non-semantic entropy of the compressed video in the MVM token space. The proposed framework is instantiated as a simple Semantic-Mining-then-Compression (SMC) model. Furthermore, we extend SMC as an advanced SMC++ model from several aspects. First, we equip it with a masked motion prediction objective, leading to better temporal semantic learning ability. Second, we introduce a Transformer-based compression module, to improve the semantic compression efficacy. Considering that directly mining the complex redundancy among heterogeneous features in different coding stages is non-trivial, we introduce a compact blueprint semantic representation to align these features into a similar form, fully unleashing the power of the Transformer-based compression module. Extensive results demonstrate the proposed SMC and SMC++ models show remarkable superiority over previous traditional, learnable, and perceptual quality-oriented video codecs, on three video analysis tasks and seven datasets. \textit{Codes and model are available at: https://github.com/tianyuan168326/VideoSemanticCompression-Pytorch.