GeoGen: Geometry-Aware Generative Modeling via Signed Distance Functions

作者: Salvatore Esposito, Qingshan Xu, Kacper Kania, Charlie Hewitt, Octave Mariotti, Lohit Petikam, Julien Valentin, Arno Onken, Oisin Mac Aodha

分类: cs.CV, cs.AI

发布日期: 2024-06-06 (更新: 2024-06-14)

💡 一句话要点

GeoGen:提出基于SDF的几何感知生成模型,提升三维几何体和图像生成质量。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 三维生成模型 有符号距离函数 神经辐射场 对抗训练 几何建模

📋 核心要点

- 现有基于神经辐射场的生成模型在生成三维几何体时,存在噪声大、约束不足的问题,导致网格质量不高。

- GeoGen将体密度视为有符号距离函数(SDF),并引入可学习的变换和深度一致性约束,从而生成更精细的几何体。

- 通过在合成数据集和真实数据集上的实验,证明GeoGen在几何体生成质量上优于现有的基于神经辐射场的生成模型。

📝 摘要(中文)

本文提出了一种新的生成方法GeoGen,用于从单视角图像集合中合成3D几何体和图像。现有方法大多预测体密度来渲染多视角一致的图像,但受限于神经辐射场,生成的几何体噪声大且无约束,限制了输出网格的质量和效用。GeoGen将体密度重新解释为有符号距离函数(SDF),引入先验知识以生成有效的网格。为了避免先验限制模型学习细节,GeoGen使变换可学习,并约束渲染深度图与SDF的零水平集一致。通过对抗训练,鼓励网络在输出网格上产生更高保真度的细节。为了评估,本文引入了一个从360度相机角度捕获的人类化身合成数据集。实验表明,GeoGen比以前基于神经辐射场的生成模型产生视觉效果和质量更好的几何体。

🔬 方法详解

问题定义:现有基于神经辐射场的生成模型在三维几何体生成任务中,生成的网格质量不高,存在噪声大、细节不足的问题。这是因为体密度缺乏明确的几何约束,导致优化过程难以生成高质量的几何体。

核心思路:GeoGen的核心思路是将体密度重新解释为有符号距离函数(SDF)。SDF具有明确的几何意义,其零水平集对应于物体的表面。通过约束体密度为SDF,可以引入几何先验,从而生成更有效的网格。此外,为了保留细节,引入可学习的变换和深度一致性约束。

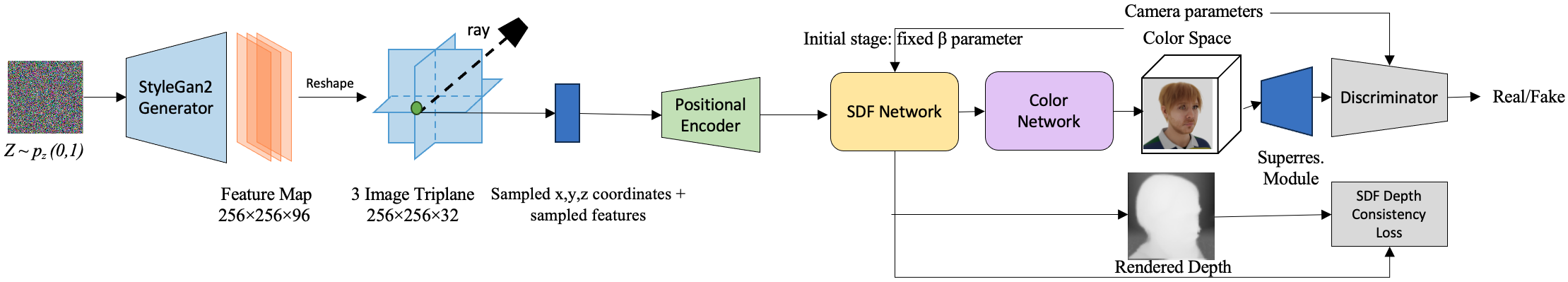

技术框架:GeoGen的整体框架包含一个生成器和一个判别器。生成器负责从隐空间生成SDF,并渲染出图像和深度图。判别器负责区分生成的图像和真实图像,以及生成的深度图和SDF的零水平集是否一致。通过对抗训练,生成器不断提升生成图像和几何体的质量。

关键创新:GeoGen的关键创新在于将体密度重新解释为SDF,并引入可学习的变换和深度一致性约束。这使得模型能够生成具有明确几何意义且细节丰富的几何体。与现有方法相比,GeoGen不再直接预测体密度,而是预测SDF,从而引入了更强的几何约束。

关键设计:GeoGen的关键设计包括:1) 使用MLP网络来表示SDF;2) 引入可学习的变换,将SDF映射到体密度;3) 使用深度一致性损失,约束渲染的深度图与SDF的零水平集一致;4) 使用对抗损失,鼓励生成器生成更逼真的图像和几何体。具体的损失函数包括对抗损失、深度一致性损失和SDF正则化损失。

🖼️ 关键图片

📊 实验亮点

GeoGen在合成数据集和真实数据集上都取得了显著的性能提升。在合成数据集上,GeoGen生成的几何体的Chamfer Distance和Normal Consistency都优于现有的基于神经辐射场的生成模型。在真实数据集上,GeoGen生成的图像的视觉质量也明显优于现有方法。

🎯 应用场景

GeoGen在三维内容生成领域具有广泛的应用前景,例如虚拟现实、增强现实、游戏开发、三维建模等。它可以用于生成高质量的三维模型,从而降低三维内容制作的成本和时间。此外,GeoGen还可以用于三维重建、物体识别等任务。

📄 摘要(原文)

We introduce a new generative approach for synthesizing 3D geometry and images from single-view collections. Most existing approaches predict volumetric density to render multi-view consistent images. By employing volumetric rendering using neural radiance fields, they inherit a key limitation: the generated geometry is noisy and unconstrained, limiting the quality and utility of the output meshes. To address this issue, we propose GeoGen, a new SDF-based 3D generative model trained in an end-to-end manner. Initially, we reinterpret the volumetric density as a Signed Distance Function (SDF). This allows us to introduce useful priors to generate valid meshes. However, those priors prevent the generative model from learning details, limiting the applicability of the method to real-world scenarios. To alleviate that problem, we make the transformation learnable and constrain the rendered depth map to be consistent with the zero-level set of the SDF. Through the lens of adversarial training, we encourage the network to produce higher fidelity details on the output meshes. For evaluation, we introduce a synthetic dataset of human avatars captured from 360-degree camera angles, to overcome the challenges presented by real-world datasets, which often lack 3D consistency and do not cover all camera angles. Our experiments on multiple datasets show that GeoGen produces visually and quantitatively better geometry than the previous generative models based on neural radiance fields.