How Far Can We Compress Instant-NGP-Based NeRF?

作者: Yihang Chen, Qianyi Wu, Mehrtash Harandi, Jianfei Cai

分类: cs.CV

发布日期: 2024-06-06

备注: Project Page: https://yihangchen-ee.github.io/project_cnc/ Code: https://github.com/yihangchen-ee/cnc/. We further propose a 3DGS compression method HAC, which is based on CNC: https://yihangchen-ee.github.io/project_hac/

期刊: CVPR 2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于上下文建模的NeRF压缩框架CNC,显著降低Instant-NGP模型存储空间。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 神经辐射场 NeRF压缩 上下文建模 熵编码 Instant-NGP 三维重建

📋 核心要点

- Instant-NGP等NeRF方法虽然渲染速度快,但引入显式表示导致存储空间需求巨大,限制了其应用。

- CNC框架通过挖掘层级和维度上的上下文依赖性,并结合哈希冲突和占用网格先验,实现高效的NeRF压缩。

- 实验表明,CNC在多个数据集上显著降低了存储空间,同时保持或提高了渲染质量,优于现有压缩方法。

📝 摘要(中文)

近年来,神经辐射场(NeRF)在表示3D场景方面表现出卓越的能力。为了加速渲染过程,引入了可学习的显式表示与隐式NeRF表示相结合,然而这导致了大量的存储空间需求。在本文中,我们提出了基于上下文的NeRF压缩(CNC)框架,该框架利用高效的上下文模型来提供存储友好的NeRF表示。具体来说,我们挖掘了层级和维度上的上下文依赖性,以实现信息熵减少的概率预测。此外,我们利用哈希冲突和占用网格作为强大的先验知识,以实现更好的上下文建模。据我们所知,我们是第一个构建和利用上下文模型进行NeRF压缩的研究。在Synthesic-NeRF和Tanks and Temples数据集上,我们相对于基线Instant-NGP实现了100倍和70倍的尺寸缩减,并提高了保真度。此外,我们相对于SOTA NeRF压缩方法BiRF实现了86.7%和82.3%的存储尺寸缩减。我们的代码已公开。

🔬 方法详解

问题定义:论文旨在解决基于Instant-NGP的NeRF模型存储空间过大的问题。现有方法,如直接使用Instant-NGP,虽然渲染速度快,但其显式表示需要大量存储空间。其他NeRF压缩方法,如BiRF,在压缩率和保真度上仍有提升空间。

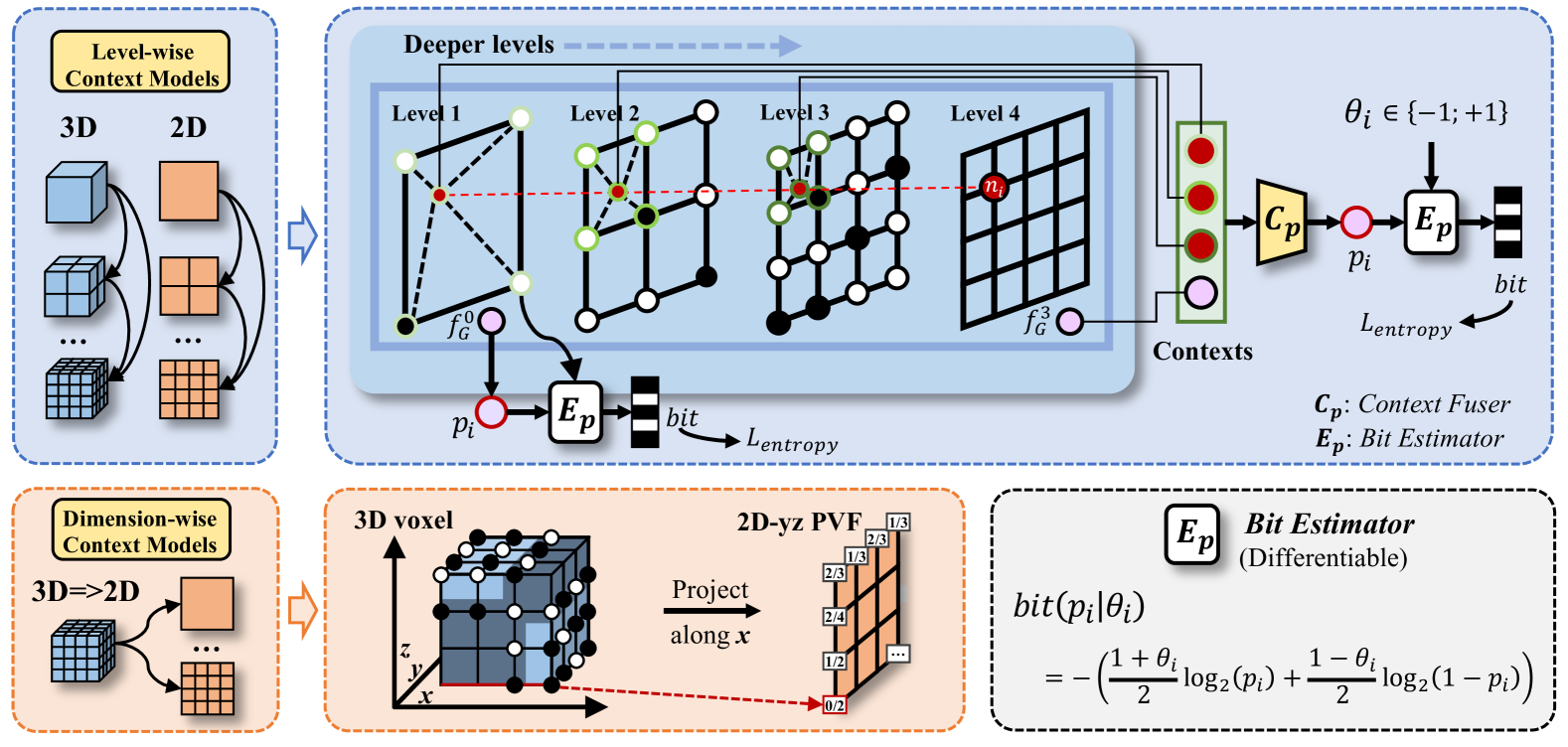

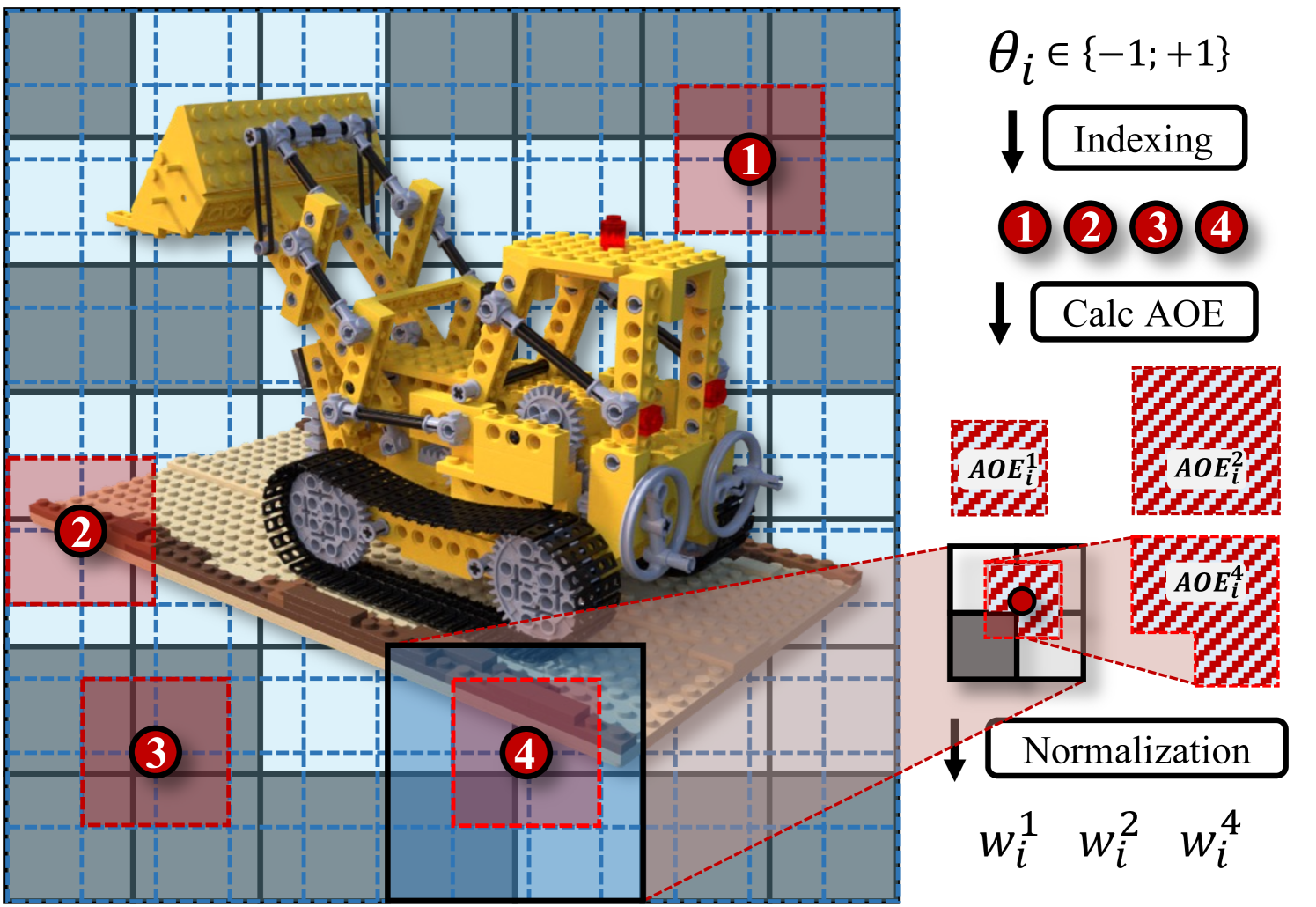

核心思路:论文的核心思路是利用上下文建模来预测NeRF模型中各个元素的概率分布,从而通过熵编码实现高效压缩。通过挖掘层级和维度上的依赖关系,并结合哈希冲突和占用网格等先验知识,可以更准确地估计概率分布,提高压缩率。

技术框架:CNC框架主要包含以下几个模块:1) 上下文建模模块:用于挖掘层级和维度上的上下文依赖性,并结合哈希冲突和占用网格先验。2) 概率预测模块:基于上下文模型,预测NeRF模型中各个元素的概率分布。3) 熵编码模块:使用算术编码等方法,根据预测的概率分布对NeRF模型进行压缩。4) 解码模块:用于从压缩后的数据中恢复NeRF模型。

关键创新:论文的关键创新在于首次将上下文建模应用于NeRF压缩。通过挖掘层级和维度上的依赖关系,并结合哈希冲突和占用网格先验,可以更准确地估计概率分布,从而实现更高的压缩率。与现有方法相比,CNC能够显著降低存储空间,同时保持或提高渲染质量。

关键设计:论文中一些关键的设计包括:1) 使用多层感知机(MLP)来建模层级和维度上的上下文依赖性。2) 使用哈希表来存储占用网格信息,并将其作为上下文信息的一部分。3) 使用算术编码进行熵编码,以实现更高的压缩率。4) 损失函数主要关注重建误差和压缩率之间的平衡。

🖼️ 关键图片

📊 实验亮点

CNC框架在Synthesic-NeRF和Tanks and Temples数据集上,相对于基线Instant-NGP实现了100倍和70倍的尺寸缩减,并提高了保真度。此外,相对于SOTA NeRF压缩方法BiRF实现了86.7%和82.3%的存储尺寸缩减。这些结果表明,CNC在NeRF压缩方面具有显著的优势。

🎯 应用场景

该研究成果可广泛应用于需要存储和传输大量3D场景数据的领域,例如虚拟现实、增强现实、游戏开发、自动驾驶、机器人导航等。通过降低NeRF模型的存储空间,可以更容易地将其部署到移动设备或嵌入式系统中,从而实现更广泛的应用。

📄 摘要(原文)

In recent years, Neural Radiance Field (NeRF) has demonstrated remarkable capabilities in representing 3D scenes. To expedite the rendering process, learnable explicit representations have been introduced for combination with implicit NeRF representation, which however results in a large storage space requirement. In this paper, we introduce the Context-based NeRF Compression (CNC) framework, which leverages highly efficient context models to provide a storage-friendly NeRF representation. Specifically, we excavate both level-wise and dimension-wise context dependencies to enable probability prediction for information entropy reduction. Additionally, we exploit hash collision and occupancy grids as strong prior knowledge for better context modeling. To the best of our knowledge, we are the first to construct and exploit context models for NeRF compression. We achieve a size reduction of 100$\times$ and 70$\times$ with improved fidelity against the baseline Instant-NGP on Synthesic-NeRF and Tanks and Temples datasets, respectively. Additionally, we attain 86.7\% and 82.3\% storage size reduction against the SOTA NeRF compression method BiRF. Our code is available here: https://github.com/YihangChen-ee/CNC.