Superpoint Gaussian Splatting for Real-Time High-Fidelity Dynamic Scene Reconstruction

作者: Diwen Wan, Ruijie Lu, Gang Zeng

分类: cs.CV

发布日期: 2024-06-06

备注: Accepted by ICML 2024

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出Superpoint Gaussian Splatting,用于实时高保真动态场景重建

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 动态场景重建 3D高斯溅射 超点表示 实时渲染 可微分渲染

📋 核心要点

- 现有动态场景重建方法依赖NeRF,渲染质量和速度受限,难以满足实时高保真需求。

- SP-GS通过显式3D高斯函数重建场景,并聚类相似高斯函数为超点,扩展3D高斯溅射到动态场景。

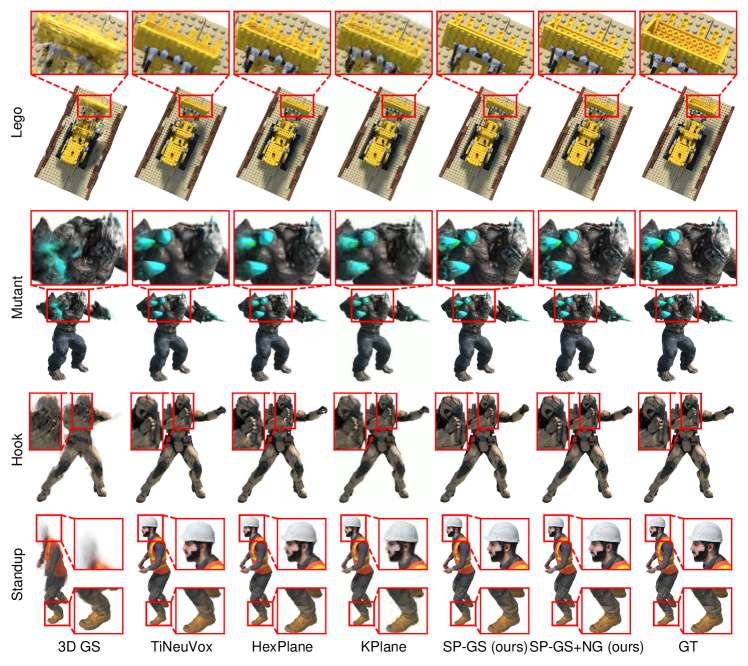

- 实验表明,SP-GS在视觉质量和实时渲染方面达到SOTA,且超点表示提供更强的操作能力。

📝 摘要(中文)

动态场景中的新视角图像渲染是一项关键但具有挑战性的任务。目前的方法主要采用基于NeRF的方法来表示静态场景,并使用额外的时变MLP来建模场景变形,导致渲染质量相对较低且推理速度较慢。为了解决这些挑战,我们提出了一种名为Superpoint Gaussian Splatting (SP-GS) 的新框架。具体来说,我们的框架首先采用显式的3D高斯函数来重建场景,然后将具有相似属性(例如,旋转、平移和位置)的高斯函数聚类成超点。在这些超点的支持下,我们的方法成功地将3D高斯溅射扩展到动态场景,而计算开销仅略有增加。除了在高分辨率下实现最先进的视觉质量和实时渲染外,超点表示还提供了更强的操作能力。大量的实验证明了我们的方法在合成和真实世界数据集上的实用性和有效性。

🔬 方法详解

问题定义:现有动态场景重建方法,特别是基于NeRF的方法,在渲染质量和推理速度上存在瓶颈。它们通常需要额外的时变MLP来建模场景的形变,这增加了计算复杂度,并限制了实时应用的可能性。此外,这些方法在处理复杂动态场景时,难以保持高保真度。

核心思路:SP-GS的核心思路是将动态场景重建问题转化为对3D高斯函数的优化和管理。通过显式地使用3D高斯函数来表示场景,并引入超点(Superpoint)的概念,将具有相似属性的高斯函数聚类在一起,从而有效地减少了需要优化的参数数量,并提高了渲染效率。这种设计允许模型更好地捕捉场景的动态变化,同时保持较高的渲染质量。

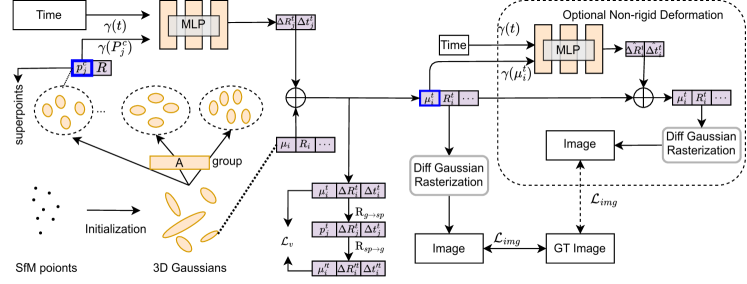

技术框架:SP-GS框架主要包含两个阶段:首先,使用3D高斯函数来重建静态场景。然后,将这些高斯函数根据其属性(如旋转、平移和位置)聚类成超点。每个超点代表场景中的一个局部区域,并包含多个高斯函数。在动态场景中,超点可以独立地进行形变和运动,从而实现对场景动态变化的建模。整个框架利用可微分渲染技术进行端到端优化。

关键创新:SP-GS的关键创新在于引入了超点表示,将传统的3D高斯溅射扩展到动态场景。与直接优化每个高斯函数相比,优化超点可以显著减少计算量,并提高渲染速度。此外,超点表示还提供了更强的场景操作能力,例如可以对场景中的特定区域进行编辑和修改。

关键设计:SP-GS的关键设计包括:1) 使用EM算法或其他聚类算法将高斯函数聚类成超点;2) 设计合适的损失函数,鼓励超点内的各个高斯函数保持一致的运动和形变;3) 采用高效的可微分渲染技术,实现实时渲染。具体的参数设置和网络结构取决于具体的应用场景和数据集。

🖼️ 关键图片

📊 实验亮点

SP-GS在合成和真实数据集上都取得了显著的成果。实验表明,SP-GS在保持高渲染质量的同时,实现了实时渲染,并且计算开销仅略有增加。与现有的基于NeRF的方法相比,SP-GS在视觉质量和渲染速度上都取得了显著的提升。具体性能数据和对比基线可在论文原文和项目页面查看。

🎯 应用场景

SP-GS在虚拟现实、增强现实、游戏开发、机器人导航等领域具有广泛的应用前景。它可以用于创建逼真的动态虚拟环境,支持实时交互和编辑。此外,该技术还可以应用于自动驾驶领域,用于重建和理解周围的动态场景,提高车辆的感知能力。

📄 摘要(原文)

Rendering novel view images in dynamic scenes is a crucial yet challenging task. Current methods mainly utilize NeRF-based methods to represent the static scene and an additional time-variant MLP to model scene deformations, resulting in relatively low rendering quality as well as slow inference speed. To tackle these challenges, we propose a novel framework named Superpoint Gaussian Splatting (SP-GS). Specifically, our framework first employs explicit 3D Gaussians to reconstruct the scene and then clusters Gaussians with similar properties (e.g., rotation, translation, and location) into superpoints. Empowered by these superpoints, our method manages to extend 3D Gaussian splatting to dynamic scenes with only a slight increase in computational expense. Apart from achieving state-of-the-art visual quality and real-time rendering under high resolutions, the superpoint representation provides a stronger manipulation capability. Extensive experiments demonstrate the practicality and effectiveness of our approach on both synthetic and real-world datasets. Please see our project page at https://dnvtmf.github.io/SP_GS.github.io.