AD-H: Autonomous Driving with Hierarchical Agents

作者: Zaibin Zhang, Shiyu Tang, Yuanhang Zhang, Talas Fu, Yifan Wang, Yang Liu, Dong Wang, Jing Shao, Lijun Wang, Huchuan Lu

分类: cs.CV

发布日期: 2024-06-05

🔗 代码/项目: GITHUB

💡 一句话要点

提出AD-H:一种基于分层Agent的自动驾驶系统,提升泛化性和可解释性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动驾驶 多模态大语言模型 分层Agent 语言驱动 泛化能力 可解释性 数据集 闭环评估

📋 核心要点

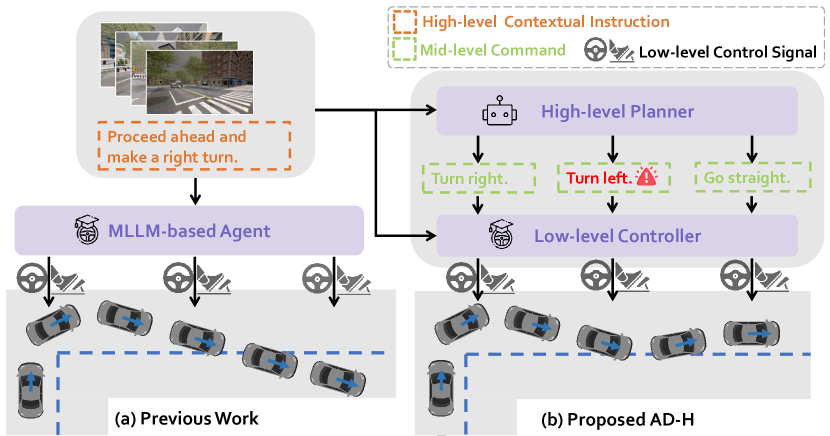

- 现有基于MLLM的自动驾驶方法直接将高层指令转化为底层控制信号,偏离了MLLM的语言生成范式,泛化性受限。

- AD-H通过引入中间层语言指令,连接高层指令和底层控制信号,构建分层多Agent系统,提升泛化性和可解释性。

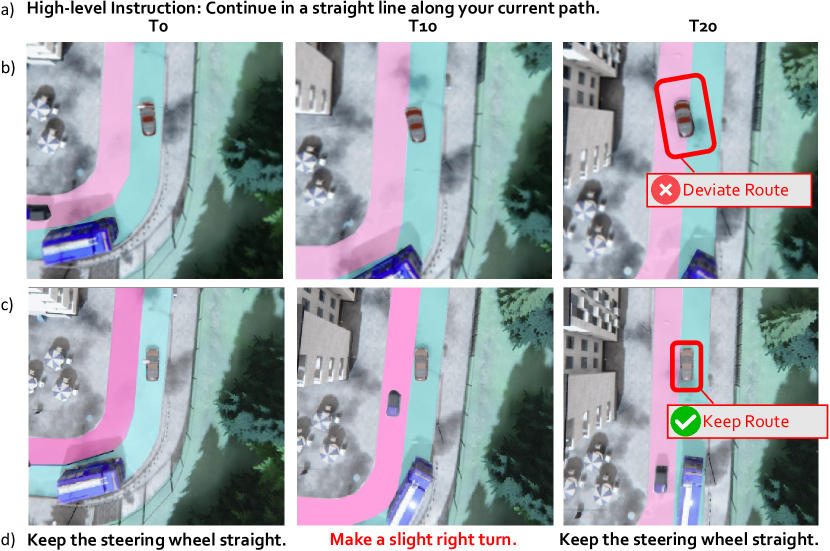

- 实验表明,AD-H在驾驶性能、自我纠正能力和泛化能力方面均优于现有方法,尤其是在长时程指令和新环境条件下。

📝 摘要(中文)

本文提出了一种基于多模态大语言模型(MLLM)的分层Agent自动驾驶系统AD-H,旨在解决现有方法过度依赖微调数据集、泛化能力受限的问题。AD-H通过引入中间层语言驱动的指令,连接高层指令和底层控制信号,弥合了二者之间的差距。该系统包含一个用于高层推理的MLLM规划器和一个用于底层执行的轻量级控制器。分层设计使MLLM摆脱了底层控制信号的解码,充分发挥其在高层感知、推理和规划方面的能力。此外,本文构建了一个带有动作层级标注的新数据集。闭环评估表明,AD-H在驾驶性能方面优于现有方法,即使在训练数据集中未遇到的场景中也表现出自我纠正能力,并在长时程指令和新环境条件下表现出卓越的泛化能力。

🔬 方法详解

问题定义:现有基于多模态大语言模型(MLLM)的自动驾驶方法通常直接将高层指令映射到低层控制信号,这与MLLM擅长的语言生成能力不符。这种直接映射导致模型过度依赖训练数据集,泛化能力较差,难以应对未知的驾驶场景和长时程指令。此外,缺乏中间层的解释性,使得系统的行为难以理解和调试。

核心思路:本文的核心思路是通过引入中间层语言驱动的指令,将高层指令分解为更细粒度、更通用的中间层命令,再由中间层命令驱动底层控制信号的生成。这种分层结构能够更好地利用MLLM的语言生成能力,提高系统的泛化性和可解释性。同时,通过解耦高层规划和底层控制,降低了MLLM直接控制车辆的复杂性。

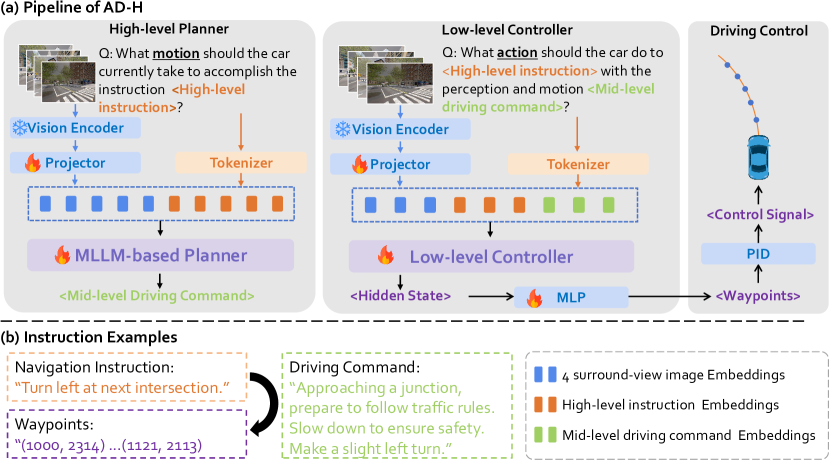

技术框架:AD-H系统采用分层多Agent架构,包含以下两个主要模块:1) MLLM规划器:负责接收高层指令,进行推理和规划,生成中间层语言驱动的命令序列。2) 轻量级控制器:负责接收中间层命令,将其转化为低层控制信号,驱动车辆执行。这两个模块通过中间层命令进行通信和协作,形成一个完整的自动驾驶系统。

关键创新:AD-H的关键创新在于引入了中间层语言驱动的指令,构建了分层多Agent架构。这种架构能够充分发挥MLLM在高层感知、推理和规划方面的能力,同时降低了底层控制的复杂性,提高了系统的泛化性和可解释性。此外,本文还构建了一个带有动作层级标注的新数据集,用于训练和评估AD-H系统。

关键设计:中间层指令的设计是关键。这些指令需要足够细粒度,以便能够准确地指导底层控制器的行为;同时,需要足够通用,以便能够适应不同的驾驶场景和环境。具体实现细节(例如,中间层指令的具体内容、MLLM规划器的网络结构、轻量级控制器的设计等)在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

AD-H在闭环评估中表现出色,在驾驶性能方面显著优于现有方法,即使在训练数据集中未遇到的场景中也表现出自我纠正能力。此外,AD-H在长时程指令和新环境条件下表现出卓越的泛化能力,显著超越了当前最先进的方法。具体性能提升数据未知。

🎯 应用场景

AD-H系统具有广泛的应用前景,可应用于各种自动驾驶场景,包括城市道路、高速公路和越野环境。该系统能够提高自动驾驶系统的安全性、可靠性和泛化能力,并为自动驾驶技术的进一步发展提供新的思路。此外,该研究的中间层指令设计思想也可应用于其他机器人控制领域。

📄 摘要(原文)

Due to the impressive capabilities of multimodal large language models (MLLMs), recent works have focused on employing MLLM-based agents for autonomous driving in large-scale and dynamic environments. However, prevalent approaches often directly translate high-level instructions into low-level vehicle control signals, which deviates from the inherent language generation paradigm of MLLMs and fails to fully harness their emergent powers. As a result, the generalizability of these methods is highly restricted by autonomous driving datasets used during fine-tuning. To tackle this challenge, we propose to connect high-level instructions and low-level control signals with mid-level language-driven commands, which are more fine-grained than high-level instructions but more universal and explainable than control signals, and thus can effectively bridge the gap in between. We implement this idea through a hierarchical multi-agent driving system named AD-H, including a MLLM planner for high-level reasoning and a lightweight controller for low-level execution. The hierarchical design liberates the MLLM from low-level control signal decoding and therefore fully releases their emergent capability in high-level perception, reasoning, and planning. We build a new dataset with action hierarchy annotations. Comprehensive closed-loop evaluations demonstrate several key advantages of our proposed AD-H system. First, AD-H can notably outperform state-of-the-art methods in achieving exceptional driving performance, even exhibiting self-correction capabilities during vehicle operation, a scenario not encountered in the training dataset. Second, AD-H demonstrates superior generalization under long-horizon instructions and novel environmental conditions, significantly surpassing current state-of-the-art methods. We will make our data and code publicly accessible at https://github.com/zhangzaibin/AD-H