Towards Multiple Character Image Animation Through Enhancing Implicit Decoupling

作者: Jingyun Xue, Hongfa Wang, Qi Tian, Yue Ma, Andong Wang, Zhiyuan Zhao, Shaobo Min, Wenzhe Zhao, Kaihao Zhang, Heung-Yeung Shum, Wei Liu, Mengyang Liu, Wenhan Luo

分类: cs.CV

发布日期: 2024-06-05 (更新: 2025-03-01)

💡 一句话要点

提出多条件引导框架,增强隐式解耦能力,实现复杂背景下多角色图像动画

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱八:物理动画 (Physics-based Animation)

关键词: 图像动画 多角色动画 隐式解耦 光流引导 深度顺序 条件生成 复杂背景 角色动画

📋 核心要点

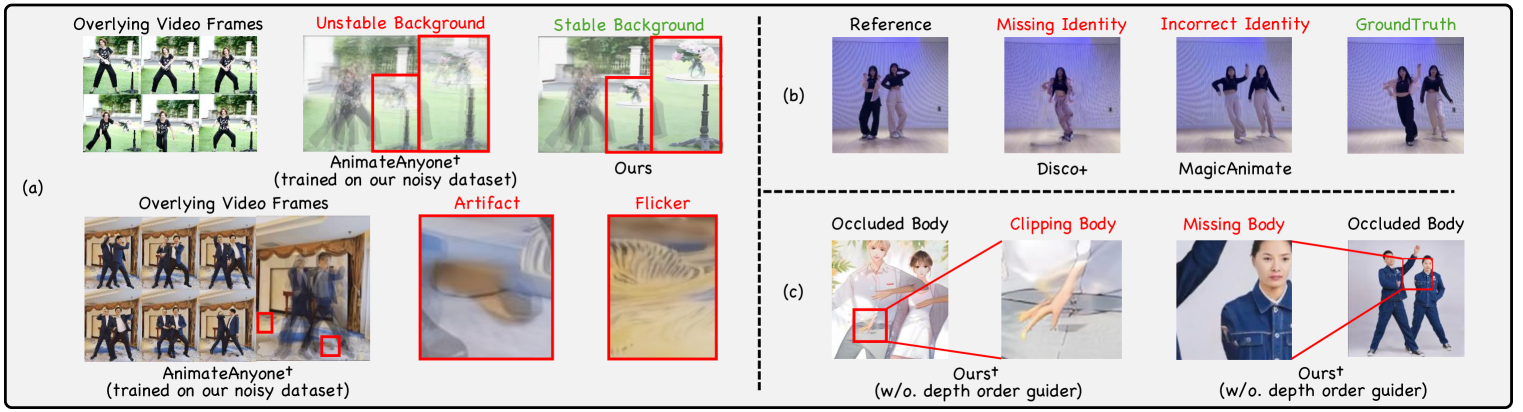

- 现有角色图像动画方法在复杂背景和多角色场景中存在稳定性问题,难以有效解耦背景和角色运动。

- 提出多条件引导框架,利用光流、深度顺序和参考姿势图,增强模型隐式解耦背景、角色和姿势信息的能力。

- 构建包含4000帧的新基准,实验结果表明该方法在复杂场景和多角色动画生成方面表现优异。

📝 摘要(中文)

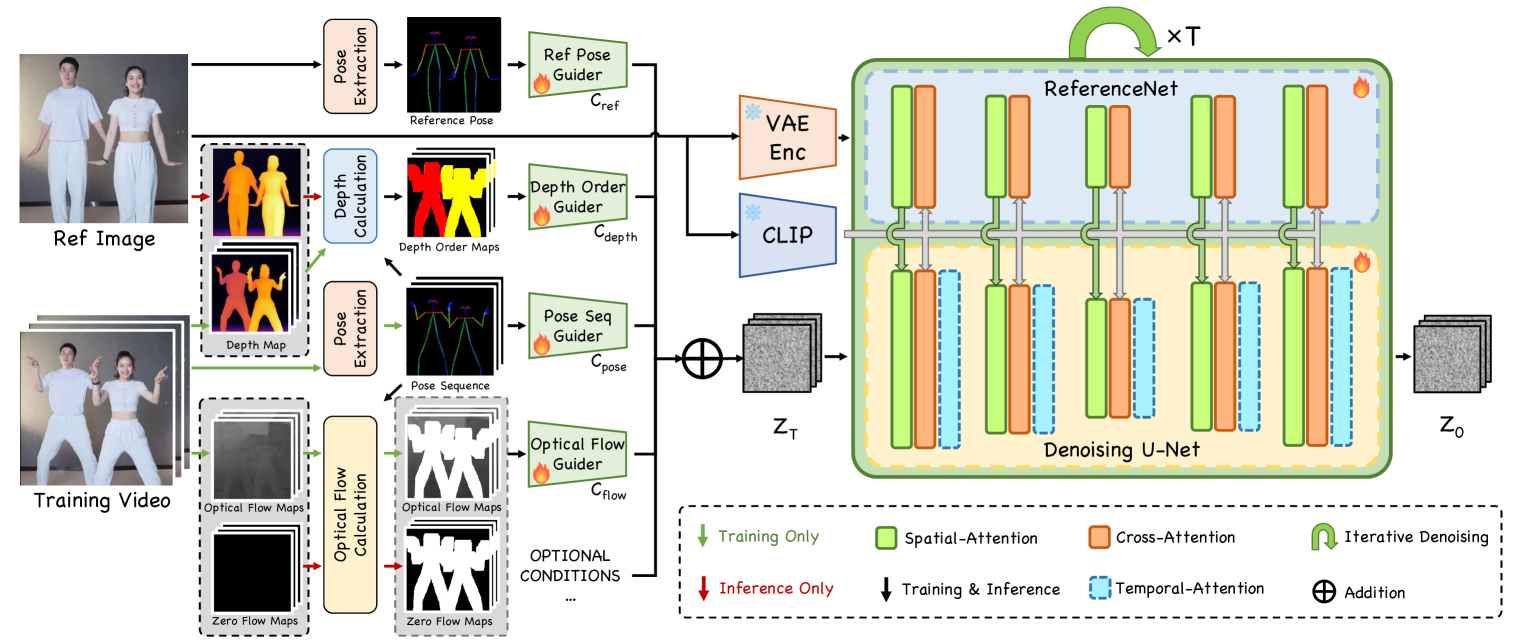

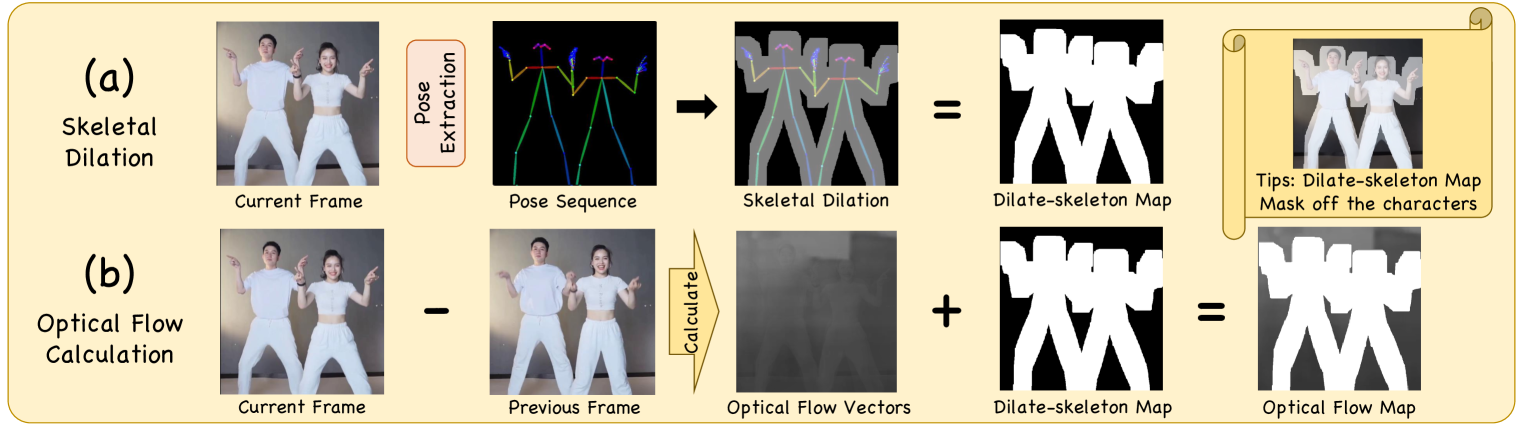

本文提出了一种新颖的多条件引导框架,用于解决角色图像动画中复杂背景和多角色场景下的稳定性问题。该框架通过精心设计的输入模块来增强模型的隐式解耦能力。首先,光流引导器计算背景光流图作为引导信息,使模型能够隐式地学习将背景运动解耦为背景常量和背景动量,并在推理时通过设置零背景动量来生成稳定的背景。其次,深度顺序引导器计算角色的顺序图,将深度信息转换为多个角色的位置信息,从而促进隐式学习解耦不同的角色,尤其是在准确分离多个角色被遮挡的身体部位时。第三,参考姿势图的输入增强了解耦参考图像中角色纹理和姿势信息的能力。此外,为了填补多角色图像动画公平评估的空白,我们提出了一个包含约4000帧的新基准。大量的定性和定量评估表明,我们的方法在生成高质量的角色动画方面表现出色,尤其是在复杂背景和多角色场景中。

🔬 方法详解

问题定义:现有角色图像动画方法在处理复杂背景和多角色场景时,难以保证动画的稳定性和角色间的正确交互。尤其是在角色相互遮挡的情况下,容易出现伪影和不自然的运动。现有方法缺乏对背景运动和角色深度信息的有效建模,导致解耦能力不足。

核心思路:通过引入多条件引导,显式地将背景运动、角色深度顺序和参考姿势信息融入到模型中,从而增强模型隐式解耦这些信息的能力。具体来说,利用光流引导器解耦背景运动,深度顺序引导器解耦角色间的遮挡关系,参考姿势图解耦角色纹理和姿势信息。

技术框架:该框架主要包含三个引导模块:光流引导器、深度顺序引导器和参考姿势图。光流引导器计算背景光流图,深度顺序引导器计算角色顺序图,参考姿势图直接输入。这些引导信息与参考图像和目标姿势一起输入到生成器中,生成最终的动画图像。整体流程是先提取引导信息,然后将这些信息融合到生成器中进行图像生成。

关键创新:该方法的核心创新在于利用多条件引导来增强模型的隐式解耦能力。与现有方法相比,该方法不需要显式地设计复杂的解耦模块,而是通过引导信息让模型自动学习如何解耦背景、角色和姿势信息。此外,提出了一个新的多角色图像动画基准,填补了该领域公平评估的空白。

关键设计:光流引导器使用预训练的光流估计网络计算背景光流图。深度顺序引导器使用预训练的深度估计网络计算深度图,然后根据深度值计算角色顺序图。生成器可以使用各种图像生成模型,例如GAN或扩散模型。损失函数包括重建损失、对抗损失和感知损失等,用于保证生成图像的质量和真实性。具体参数设置和网络结构细节未在摘要中体现,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在复杂背景和多角色场景下的动画生成效果显著优于现有方法。定性结果显示,生成的动画更加稳定、自然,角色间的交互更加真实。定量评估也表明,该方法在图像质量和动画流畅度方面均取得了显著提升。具体性能数据和对比基线未在摘要中体现,属于未知信息。

🎯 应用场景

该研究成果可广泛应用于虚拟形象生成、游戏角色动画、电影特效制作等领域。通过该方法,可以更轻松地创建具有复杂背景和多角色的高质量动画,提高内容创作效率和质量。未来,该技术有望应用于智能教育、虚拟现实等领域,为用户提供更逼真、更具互动性的体验。

📄 摘要(原文)

Controllable character image animation has a wide range of applications. Although existing studies have consistently improved performance, challenges persist in the field of character image animation, particularly concerning stability in complex backgrounds and tasks involving multiple characters. To address these challenges, we propose a novel multi-condition guided framework for character image animation, employing several well-designed input modules to enhance the implicit decoupling capability of the model. First, the optical flow guider calculates the background optical flow map as guidance information, which enables the model to implicitly learn to decouple the background motion into background constants and background momentum during training, and generate a stable background by setting zero background momentum during inference. Second, the depth order guider calculates the order map of the characters, which transforms the depth information into the positional information of multiple characters. This facilitates the implicit learning of decoupling different characters, especially in accurately separating the occluded body parts of multiple characters. Third, the reference pose map is input to enhance the ability to decouple character texture and pose information in the reference image. Furthermore, to fill the gap of fair evaluation of multi-character image animation, we propose a new benchmark comprising about 4,000 frames. Extensive qualitative and quantitative evaluations demonstrate that our method excels in generating high-quality character animations, especially in scenarios of complex backgrounds and multiple characters.