Multi-layer Learnable Attention Mask for Multimodal Tasks

作者: Wayner Barrios, SouYoung Jin

分类: cs.CV, cs.AI, cs.LG, cs.MM

发布日期: 2024-06-04

💡 一句话要点

提出多层可学习注意力掩码(LAM),提升Transformer在多模态任务中的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 注意力机制 Transformer 可学习掩码 视频理解

📋 核心要点

- Transformer自注意力机制在多模态任务中,因token粒度差异和长序列计算量大而受限。

- 提出可学习注意力掩码(LAM),通过全局调节注意力图来突出关键token。

- 实验表明,LAM能有效提升模型性能,并减少冗余计算,尤其在电影理解等复杂场景中。

📝 摘要(中文)

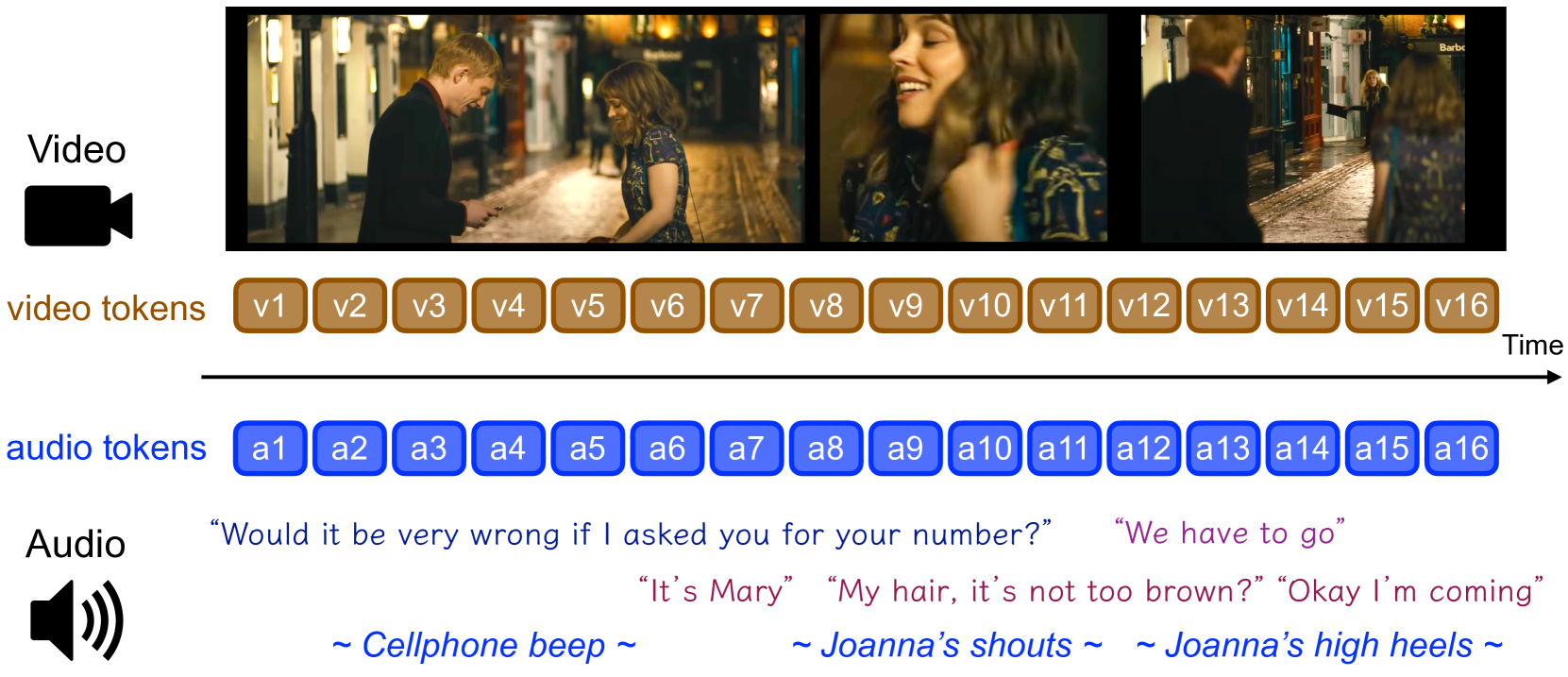

Transformer模型中的自注意力机制在许多领域都已被证明是有效的。然而,我们观察到,由于每个token的不同粒度以及长序列的高计算需求,它在更多样化的设置(例如多模态)中效果较差。为了应对这些挑战,我们引入了可学习注意力掩码(LAM),它经过策略性设计,可以全局调节注意力图并优先考虑序列中的关键token。我们的方法利用类BERT Transformer网络中的自注意力模块,巧妙地捕获token之间的关联。LAM扩展到多层版本,以适应Transformer网络每一层中嵌入的不同信息方面。在MADv2、QVHighlights、ImageNet 1K和MSRVTT等各种数据集上的全面实验验证表明了LAM的有效性,例证了其在减轻冗余计算的同时增强模型性能的能力。这种开创性的方法在增强对复杂场景(例如电影理解)的理解方面取得了重大进展。

🔬 方法详解

问题定义:论文旨在解决Transformer模型在多模态任务中,由于不同模态token粒度差异大和长序列计算复杂度高,导致自注意力机制效率降低的问题。现有方法难以有效区分关键token,造成计算资源浪费和性能瓶颈。

核心思路:论文的核心思路是引入可学习的注意力掩码(Learnable Attention Mask, LAM),通过学习的方式对注意力图进行全局调节,从而突出序列中的关键token,抑制不重要的token,以此提高计算效率和模型性能。LAM的设计目标是使模型能够自适应地关注重要的信息,忽略冗余信息。

技术框架:该方法基于类BERT的Transformer网络,利用自注意力模块捕获token之间的关联。关键在于引入了LAM模块,该模块可以插入到Transformer的每一层中。LAM模块接收自注意力层的输出,并生成一个掩码,该掩码用于调整原始的注意力权重。通过多层LAM的堆叠,模型可以学习到不同层次的注意力模式。

关键创新:最重要的技术创新点在于LAM的设计。与传统的固定掩码或随机掩码不同,LAM是通过学习得到的,可以根据输入数据的特点自适应地调整注意力权重。此外,多层LAM的设计使得模型能够捕捉不同层次的信息,从而更好地理解复杂的多模态数据。

关键设计:LAM模块的具体实现细节未知,但可以推测其可能包含可学习的参数,并通过反向传播进行优化。损失函数的设计可能包括鼓励掩码稀疏性的正则化项,以促使模型选择更少的关键token。网络结构方面,LAM模块可以灵活地插入到Transformer的任意一层,具体插入位置和层数可能需要根据具体任务进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的LAM方法在MADv2、QVHighlights、ImageNet 1K和MSRVTT等多个数据集上均取得了显著的性能提升。具体提升幅度未知,但摘要强调了LAM在增强模型性能的同时,减轻了冗余计算,表明该方法在效率和准确性方面均有优势。

🎯 应用场景

该研究成果可广泛应用于多模态信息处理领域,例如视频理解、图像描述、语音识别等。在电影理解方面,可以帮助模型更好地理解电影的内容、情感和情节发展。此外,该方法还可以应用于机器人视觉、自动驾驶等领域,提升模型对复杂环境的感知和理解能力,具有重要的实际应用价值和广阔的未来发展前景。

📄 摘要(原文)

While the Self-Attention mechanism in the Transformer model has proven to be effective in many domains, we observe that it is less effective in more diverse settings (e.g. multimodality) due to the varying granularity of each token and the high computational demands of lengthy sequences. To address the challenges, we introduce the Learnable Attention Mask (LAM), strategically designed to globally regulate attention maps and prioritize critical tokens within the sequence. Leveraging the Self-Attention module in a BERT-like transformer network, our approach adeptly captures associations between tokens. The extension of the LAM to a multi-layer version accommodates the varied information aspects embedded at each layer of the Transformer network. Comprehensive experimental validation on various datasets, such as MADv2, QVHighlights, ImageNet 1K, and MSRVTT, demonstrates the efficacy of the LAM, exemplifying its ability to enhance model performance while mitigating redundant computations. This pioneering approach presents a significant advancement in enhancing the understanding of complex scenarios, such as in movie understanding.