MASA: Motion-aware Masked Autoencoder with Semantic Alignment for Sign Language Recognition

作者: Weichao Zhao, Hezhen Hu, Wengang Zhou, Yunyao Mao, Min Wang, Houqiang Li

分类: cs.CV

发布日期: 2024-05-31

备注: Accepted by TCSVT 2024

💡 一句话要点

提出MASA:融合运动感知与语义对齐的掩码自编码器用于手语识别

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 手语识别 自监督学习 掩码自编码器 运动感知 语义对齐 表征学习 深度学习

📋 核心要点

- 现有手语识别预训练方法忽略了运动信息,导致信息损失和表征能力受限,且缺乏全局语义信息的指导。

- MASA通过运动感知掩码自编码器重建运动残差,显式探索动态运动线索,并利用动量语义对齐模块融入全局语义信息。

- 实验结果表明,MASA在四个公共基准数据集上取得了新的state-of-the-art性能,验证了其有效性。

📝 摘要(中文)

手语识别(SLR)长期以来受到模型表征能力不足的困扰。虽然目前的预训练方法通过在手势姿态数据上采用各种预训练任务,在一定程度上缓解了这一困境并取得了可喜的性能,但这些方法仍然存在两个主要局限性:1) 显式的运动信息通常在之前的预训练任务中被忽略,导致部分信息丢失和有限的表征能力。2) 之前的方法侧重于手势姿态序列的局部上下文,而没有结合词汇手势的全局含义的指导。为此,我们提出了一种运动感知掩码自编码器与语义对齐(MASA),它在自监督学习范式中集成了丰富的运动线索和全局语义信息,用于SLR。我们的框架包含两个关键组件,即运动感知掩码自编码器(MA)和动量语义对齐模块(SA)。具体来说,在MA中,我们引入了一种具有运动感知掩码策略的自编码器架构来重建掩码帧的运动残差,从而显式地探索手势姿态序列之间的动态运动线索。此外,在SA中,我们通过在共享潜在空间中对齐来自输入序列的不同增强样本的嵌入,将我们的框架嵌入全局语义感知。通过这种方式,我们的框架可以同时学习局部运动线索和全局语义特征,以实现全面的手语表征。此外,我们进行了广泛的实验来验证我们方法的有效性,在四个公共基准上取得了新的最先进的性能。

🔬 方法详解

问题定义:手语识别任务中,现有预训练方法通常忽略了手语中的运动信息,并且缺乏对全局语义信息的有效利用,导致模型表征能力不足,影响识别准确率。现有方法主要关注局部上下文,无法捕捉手语的动态特性和整体含义。

核心思路:论文的核心思路是通过自监督学习的方式,同时学习手语的局部运动信息和全局语义信息。通过运动感知掩码自编码器显式地建模运动信息,并通过语义对齐模块将全局语义信息融入到模型中,从而提升手语表征能力。

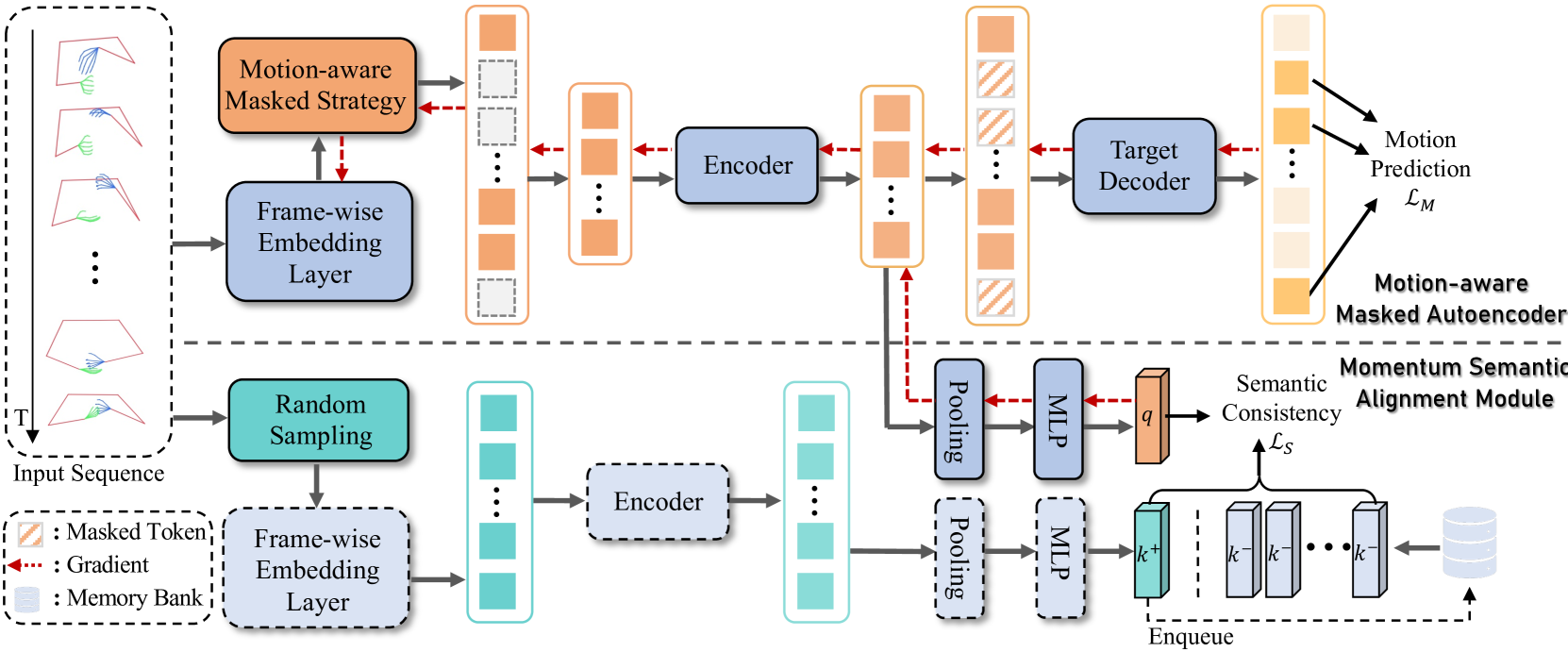

技术框架:MASA框架包含两个主要模块:运动感知掩码自编码器(MA)和动量语义对齐模块(SA)。首先,输入手语姿态序列经过MA模块,该模块采用运动感知掩码策略,对部分帧进行掩码,并重建被掩码帧的运动残差。然后,SA模块通过对齐来自同一输入序列的不同增强样本的嵌入,将全局语义信息融入到模型中。整个框架采用自监督学习的方式进行训练。

关键创新:MASA的关键创新在于同时考虑了手语的运动信息和语义信息。运动感知掩码自编码器能够有效地捕捉手语的动态特性,而语义对齐模块则能够将全局语义信息融入到模型中,从而提升模型的表征能力。与现有方法相比,MASA能够更全面地理解手语的含义。

关键设计:在MA模块中,采用了运动残差重建作为预训练任务,鼓励模型学习运动信息。在SA模块中,使用了动量编码器来生成语义嵌入,并采用InfoNCE损失函数来对齐不同增强样本的嵌入。具体的掩码比例和动量系数等参数需要根据实验进行调整。

🖼️ 关键图片

📊 实验亮点

MASA在四个公开手语识别基准数据集上取得了state-of-the-art的性能。具体而言,相较于之前的最佳方法,在多个数据集上取得了显著的性能提升,验证了运动感知和语义对齐策略的有效性。实验结果表明,MASA能够有效地学习手语的运动信息和语义信息,从而提升手语识别的准确率。

🎯 应用场景

该研究成果可应用于智能手语翻译系统、手语教学辅助工具、以及人机交互等领域。通过提升手语识别的准确率,可以帮助听力障碍人士更好地与社会进行交流,促进无障碍交流环境的建设,具有重要的社会意义和应用价值。

📄 摘要(原文)

Sign language recognition (SLR) has long been plagued by insufficient model representation capabilities. Although current pre-training approaches have alleviated this dilemma to some extent and yielded promising performance by employing various pretext tasks on sign pose data, these methods still suffer from two primary limitations: 1) Explicit motion information is usually disregarded in previous pretext tasks, leading to partial information loss and limited representation capability. 2) Previous methods focus on the local context of a sign pose sequence, without incorporating the guidance of the global meaning of lexical signs. To this end, we propose a Motion-Aware masked autoencoder with Semantic Alignment (MASA) that integrates rich motion cues and global semantic information in a self-supervised learning paradigm for SLR. Our framework contains two crucial components, i.e., a motion-aware masked autoencoder (MA) and a momentum semantic alignment module (SA). Specifically, in MA, we introduce an autoencoder architecture with a motion-aware masked strategy to reconstruct motion residuals of masked frames, thereby explicitly exploring dynamic motion cues among sign pose sequences. Moreover, in SA, we embed our framework with global semantic awareness by aligning the embeddings of different augmented samples from the input sequence in the shared latent space. In this way, our framework can simultaneously learn local motion cues and global semantic features for comprehensive sign language representation. Furthermore, we conduct extensive experiments to validate the effectiveness of our method, achieving new state-of-the-art performance on four public benchmarks.