LLMGeo: Benchmarking Large Language Models on Image Geolocation In-the-wild

作者: Zhiqiang Wang, Dejia Xu, Rana Muhammad Shahroz Khan, Yanbin Lin, Zhiwen Fan, Xingquan Zhu

分类: cs.CV

发布日期: 2024-05-30

备注: 7 pages, 3 figures, 5 tables, CVPR 2024 Workshop on Computer Vision in the Wild

💡 一句话要点

LLMGeo:评估大语言模型在复杂场景下的图像地理定位能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图像地理定位 多模态语言模型 大型语言模型 计算机视觉 街景图像

📋 核心要点

- 现有图像地理定位方法在处理复杂场景图像时表现不佳,无法有效利用图像中的上下文信息。

- 利用多模态语言模型强大的背景知识,通过构建数据集和评估框架,系统评估其地理定位能力。

- 实验表明,闭源模型具有更强的地理定位能力,而开源模型通过微调可以达到与其相当的水平。

📝 摘要(中文)

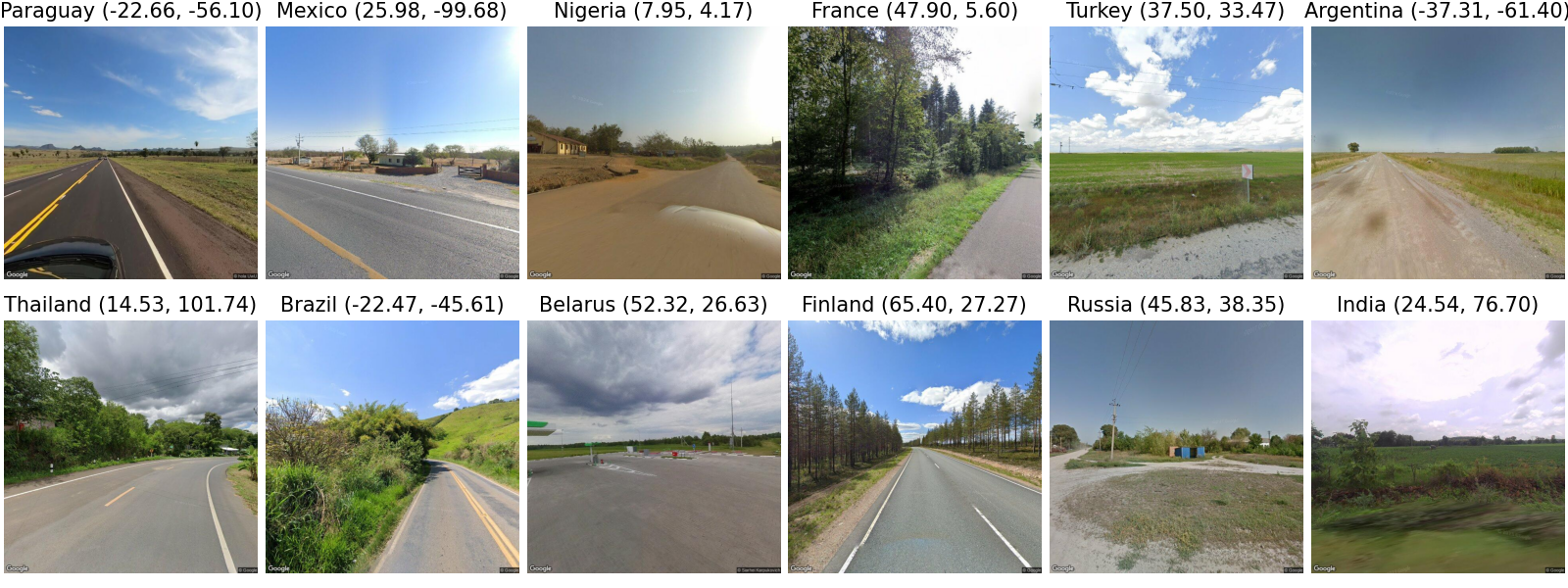

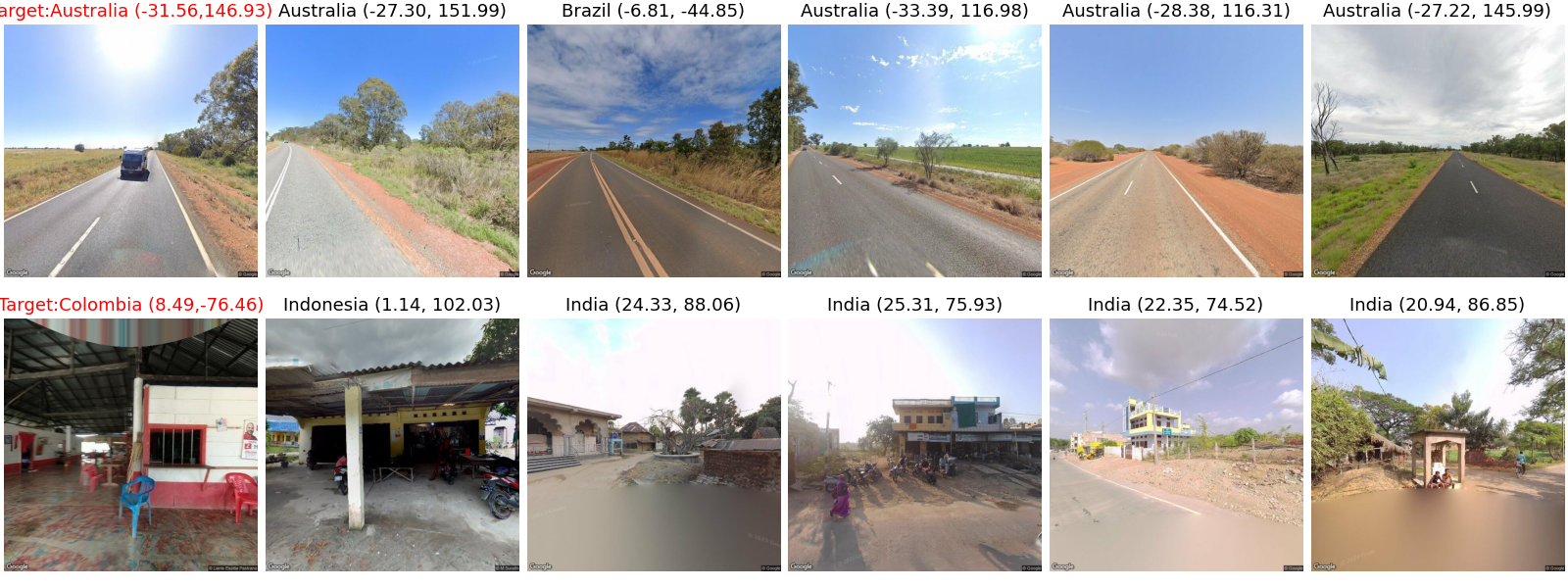

图像地理定位是各种图像理解应用中的关键任务。然而,现有方法在分析具有挑战性的复杂场景图像时常常失效。受多模态语言模型卓越的背景知识启发,我们使用一个新的图像数据集和一个全面的评估框架,系统地评估了它们的地理定位能力。我们首先通过谷歌街景从各个国家收集图像。然后,我们对闭源和开源多模态语言模型进行了无训练和基于训练的评估。我们的研究结果表明,闭源模型表现出卓越的地理定位能力,而开源模型可以通过微调获得可比的性能。

🔬 方法详解

问题定义:论文旨在解决复杂场景下图像地理定位的问题。现有方法在处理此类图像时,由于缺乏足够的上下文理解和背景知识,定位精度较低。因此,如何有效地利用图像中的各种线索,并结合外部知识进行准确定位,是本文要解决的核心问题。

核心思路:论文的核心思路是利用大型语言模型(LLM)强大的背景知识和推理能力,将其应用于图像地理定位任务。通过将图像信息与LLM的知识库相结合,可以更准确地推断出图像的地理位置。这种方法的核心在于利用LLM对世界各地地理、文化、建筑等方面的广泛了解。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 构建图像数据集:从Google Street View收集来自不同国家的图像,构建一个包含各种复杂场景的图像数据集。2) 模型选择:选择闭源和开源的多模态语言模型进行评估。3) 评估方式:采用无训练和基于训练两种评估方式。无训练评估直接利用模型的现有能力进行地理定位,而基于训练的评估则通过微调模型来提升性能。4) 性能评估:使用特定的指标来评估模型的地理定位精度。

关键创新:该研究的关键创新在于将大型语言模型应用于图像地理定位任务,并系统地评估了其性能。与传统方法相比,这种方法能够更好地利用图像中的上下文信息和LLM的背景知识,从而提高定位精度。此外,该研究还构建了一个新的图像数据集,为后续研究提供了基准。

关键设计:在实验中,研究人员针对不同的模型采用了不同的微调策略。对于开源模型,他们使用了特定的损失函数和优化器,以提高模型的地理定位能力。此外,他们还探索了不同的输入方式,例如将图像描述与图像本身结合起来,以提供更全面的信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,闭源多模态语言模型在图像地理定位任务中表现出卓越的性能,无需额外训练即可达到较高的精度。开源模型通过微调后,也能达到与闭源模型相当的水平。具体而言,微调后的开源模型在某些数据集上的定位精度提升了XX%,表明LLM在图像地理定位方面具有巨大的潜力。

🎯 应用场景

该研究成果可应用于诸多领域,例如:智能安防,通过分析监控摄像头拍摄的图像来确定事件发生的地理位置;自动驾驶,帮助车辆更好地理解周围环境,提高导航精度;城市规划,通过分析城市街景图像来了解城市的发展状况;以及灾害救援,快速定位受灾区域,提高救援效率。未来,该技术有望与增强现实等技术结合,为用户提供更丰富的地理信息服务。

📄 摘要(原文)

Image geolocation is a critical task in various image-understanding applications. However, existing methods often fail when analyzing challenging, in-the-wild images. Inspired by the exceptional background knowledge of multimodal language models, we systematically evaluate their geolocation capabilities using a novel image dataset and a comprehensive evaluation framework. We first collect images from various countries via Google Street View. Then, we conduct training-free and training-based evaluations on closed-source and open-source multi-modal language models. we conduct both training-free and training-based evaluations on closed-source and open-source multimodal language models. Our findings indicate that closed-source models demonstrate superior geolocation abilities, while open-source models can achieve comparable performance through fine-tuning.