GaussianRoom: Improving 3D Gaussian Splatting with SDF Guidance and Monocular Cues for Indoor Scene Reconstruction

作者: Haodong Xiang, Xinghui Li, Kai Cheng, Xiansong Lai, Wanting Zhang, Zhichao Liao, Long Zeng, Xueping Liu

分类: cs.CV

发布日期: 2024-05-30 (更新: 2025-04-01)

💡 一句话要点

GaussianRoom:结合SDF引导和单目线索,提升3D高斯溅射在室内场景重建效果

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 神经符号距离场 室内场景重建 新视角合成 几何先验 点云优化

📋 核心要点

- 3D高斯溅射在室内场景中,由于大面积无纹理区域,面临点云初始化不良和欠约束优化的问题,导致重建效果不佳。

- 论文提出了一种统一的优化框架,将神经SDF与3DGS相结合,利用SDF的连续性引导高斯密集化和剪枝,从而更准确地建模场景。

- 实验结果表明,该方法在ScanNet和ScanNet++数据集上,表面重建和新视角合成方面均达到了当前最优水平。

📝 摘要(中文)

具身智能需要精确的重建和渲染来模拟大规模真实世界数据。尽管3D高斯溅射(3DGS)最近展示了高质量和实时性能,但在具有大面积无纹理区域的室内场景中仍然面临挑战,由于点云初始化不良和欠约束优化,导致重建不完整和噪声。受符号距离场(SDF)连续性的启发,SDF在表面建模方面具有天然优势,我们提出了一个统一的优化框架,将神经符号距离场(SDF)与3DGS集成,以实现精确的几何重建和实时渲染。该框架结合了神经SDF场来引导高斯的密集化和剪枝,使高斯即使在初始化不良的点云下也能准确地建模场景。同时,高斯表示的几何形状通过引导其点采样提高了SDF场的效率。此外,我们引入了两个基于法线和边缘先验的正则化项,以解决无纹理区域的几何模糊性并提高细节精度。在ScanNet和ScanNet++上的大量实验表明,我们的方法在表面重建和新视角合成方面都达到了最先进的性能。

🔬 方法详解

问题定义:论文旨在解决在室内场景中使用3D高斯溅射进行三维重建时,由于大面积无纹理区域导致的点云初始化不良和欠约束优化问题。现有方法在这些区域容易产生不完整、有噪声的重建结果,影响了重建质量和真实感。

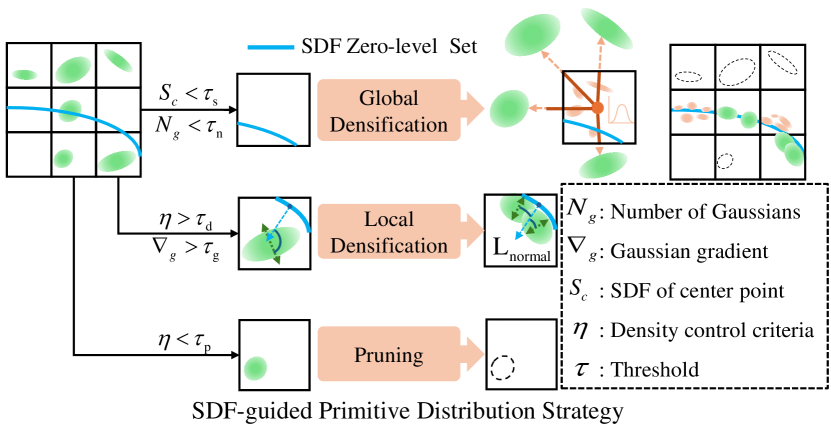

核心思路:论文的核心思路是将神经符号距离场(SDF)与3D高斯溅射(3DGS)相结合。SDF具有良好的表面建模能力,可以提供几何先验信息,引导高斯分布的优化。同时,高斯分布提供的几何信息也可以加速SDF的学习过程。通过这种相互引导的方式,可以克服无纹理区域的重建难题。

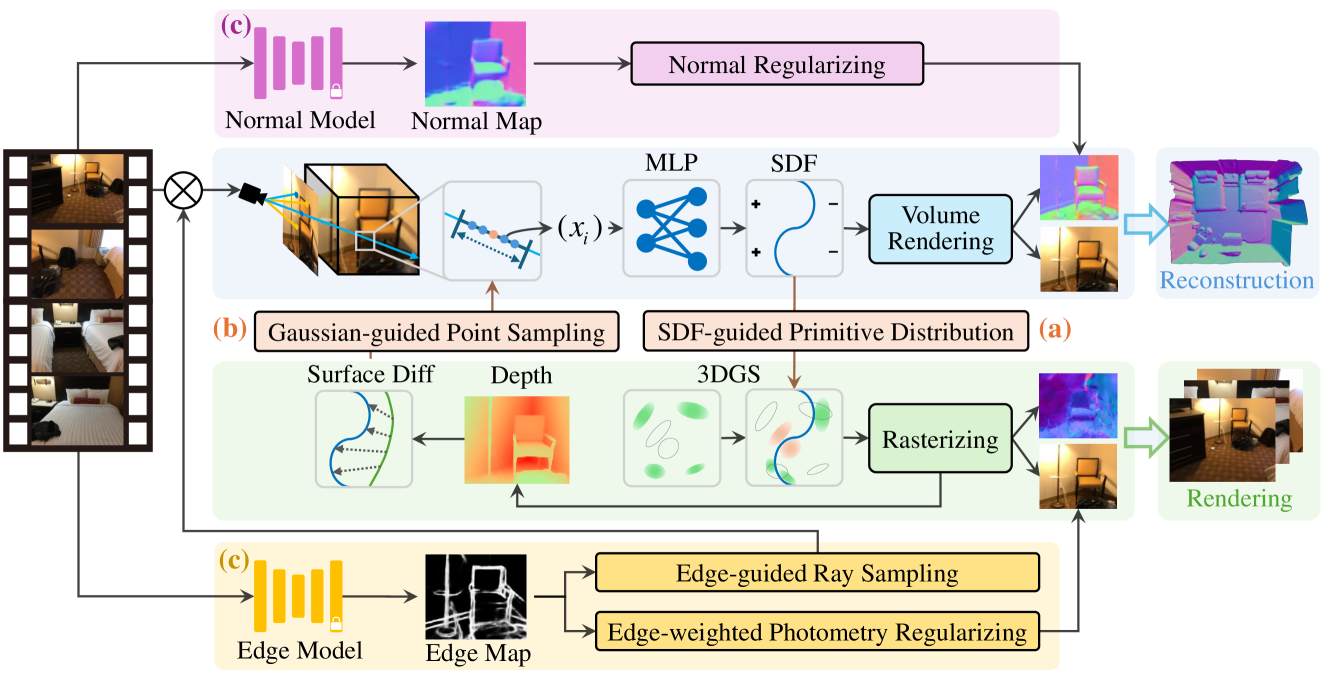

技术框架:整体框架包含两个主要部分:3DGS和神经SDF。首先,使用初始点云初始化3DGS。然后,利用神经SDF提供几何先验,指导高斯分布的密集化和剪枝,从而优化3DGS的几何形状。同时,3DGS提供的几何信息可以用于加速SDF的学习,提高SDF的效率。此外,还引入了基于法线和边缘先验的正则化项,进一步提高重建的细节精度。

关键创新:论文的关键创新在于将神经SDF与3DGS进行深度融合,利用SDF的连续性来引导高斯分布的优化,从而克服了无纹理区域重建的难题。与现有方法相比,该方法能够更有效地利用几何先验信息,提高重建的完整性和准确性。

关键设计:论文的关键设计包括:1) 使用SDF梯度方向引导高斯分布的密集化和剪枝;2) 利用高斯分布的位置信息加速SDF的点采样过程;3) 引入基于法线和边缘先验的正则化项,约束重建的几何形状。损失函数包括渲染损失、SDF损失和正则化损失。网络结构方面,SDF采用MLP结构,高斯分布的参数包括位置、协方差、颜色等。

🖼️ 关键图片

📊 实验亮点

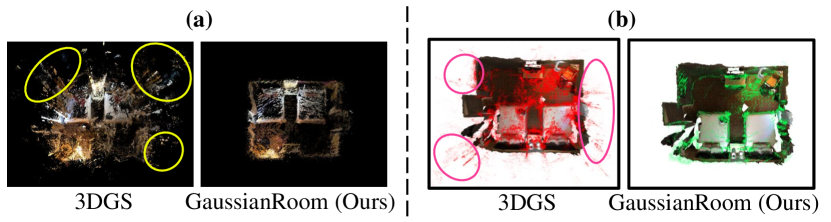

实验结果表明,该方法在ScanNet和ScanNet++数据集上取得了state-of-the-art的性能。在表面重建方面,该方法显著降低了重建误差,提高了重建的完整性和准确性。在新视角合成方面,该方法生成的图像质量更高,细节更丰富,视觉效果更逼真。与现有方法相比,该方法在无纹理区域的重建效果有明显提升。

🎯 应用场景

该研究成果可应用于机器人导航、虚拟现实、增强现实、室内场景建模等领域。精确的室内场景重建能够为机器人提供更可靠的环境感知,提升导航和交互能力。在VR/AR领域,高质量的重建可以提供更逼真的沉浸式体验。此外,该方法还可以用于建筑设计、文物保护等领域,实现对室内场景的数字化建模。

📄 摘要(原文)

Embodied intelligence requires precise reconstruction and rendering to simulate large-scale real-world data. Although 3D Gaussian Splatting (3DGS) has recently demonstrated high-quality results with real-time performance, it still faces challenges in indoor scenes with large, textureless regions, resulting in incomplete and noisy reconstructions due to poor point cloud initialization and underconstrained optimization. Inspired by the continuity of signed distance field (SDF), which naturally has advantages in modeling surfaces, we propose a unified optimization framework that integrates neural signed distance fields (SDFs) with 3DGS for accurate geometry reconstruction and real-time rendering. This framework incorporates a neural SDF field to guide the densification and pruning of Gaussians, enabling Gaussians to model scenes accurately even with poor initialized point clouds. Simultaneously, the geometry represented by Gaussians improves the efficiency of the SDF field by piloting its point sampling. Additionally, we introduce two regularization terms based on normal and edge priors to resolve geometric ambiguities in textureless areas and enhance detail accuracy. Extensive experiments in ScanNet and ScanNet++ show that our method achieves state-of-the-art performance in both surface reconstruction and novel view synthesis.