Programmable Motion Generation for Open-Set Motion Control Tasks

作者: Hanchao Liu, Xiaohang Zhan, Shaoli Huang, Tai-Jiang Mu, Ying Shan

分类: cs.CV

发布日期: 2024-05-29

备注: Accepted by CVPR 2024

💡 一句话要点

提出可编程运动生成框架,解决开放场景下可定制的角色动画控制问题

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 角色动画 运动控制 可编程运动生成 开放集学习 预训练模型

📋 核心要点

- 现有角色动画控制方法难以应对真实场景中复杂多变的约束条件,缺乏通用性和可扩展性。

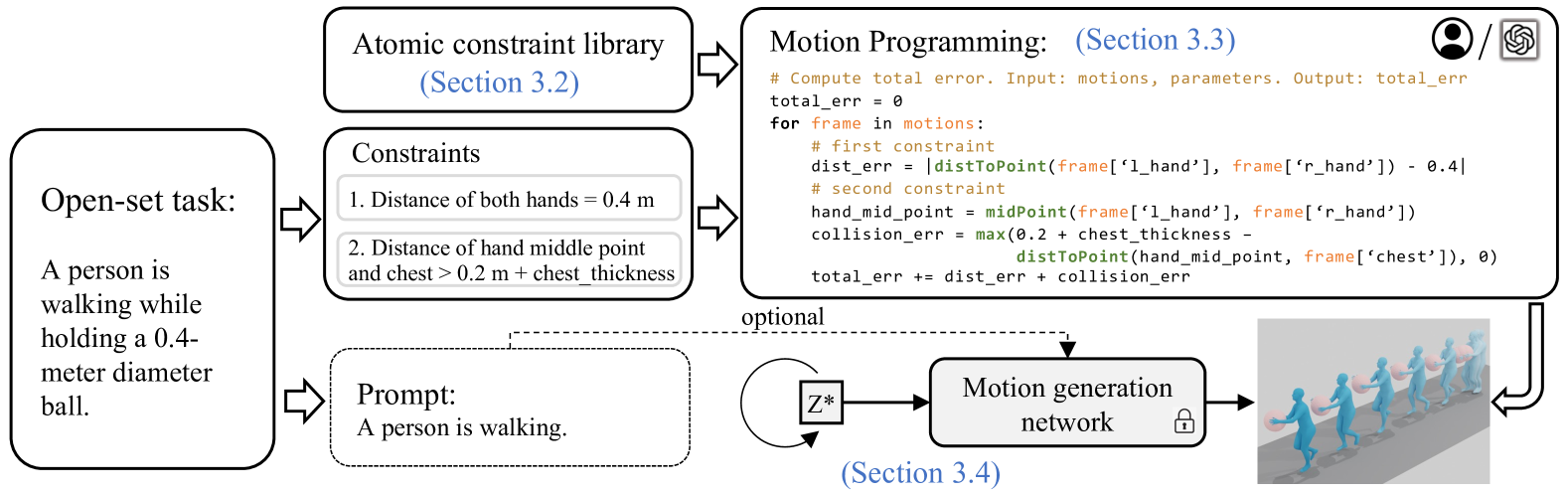

- 提出可编程运动生成范式,将运动控制任务分解为原子约束,并通过优化预训练模型的潜在代码来满足约束。

- 实验证明,该方法能够生成高质量的运动,并能处理各种未见过的任务,无需特定训练数据或网络设计。

📝 摘要(中文)

真实场景中的角色动画需要满足多种约束,如轨迹、关键帧和交互等。现有方法通常将这些约束视为独立的控制任务,缺乏通用性和可扩展性,属于闭集运动控制问题。为应对实际运动控制的复杂性,本文提出了开放集运动控制问题,其特点是运动控制任务集是开放且完全可定制的。为此,引入了一种新的范式:可编程运动生成。该范式将任何给定的运动控制任务分解为原子约束的组合,然后将这些约束编程为一个误差函数,用于量化运动序列对约束的遵守程度。利用预训练的运动生成模型,并优化其潜在代码以最小化误差函数。生成的运动既继承了生成模型的先验知识,又满足了所需的约束。实验表明,该方法能够生成高质量的运动,并能处理各种未见过的任务,包括运动动力学、几何约束、物理定律、与场景、物体或角色自身身体部位的交互等。所有这些都在统一的方法中实现,无需特定的配对训练数据或专门的网络设计。在对新任务进行编程时,观察到模型涌现出超出先前模型的新技能。借助大型语言模型,还实现了自动编程。这项工作有望为通用人工智能体的运动控制铺平道路。

🔬 方法详解

问题定义:论文旨在解决开放集运动控制问题,即如何让角色动画在各种复杂和可定制的约束条件下生成自然合理的运动。现有方法通常针对特定类型的约束进行优化,例如轨迹跟踪或关键帧匹配,缺乏通用性,难以应对真实世界中多种约束并存的复杂场景。这些方法需要针对不同的任务设计专门的模型或收集特定的训练数据,成本高昂且难以扩展。

核心思路:论文的核心思路是将运动控制任务转化为一个优化问题,通过最小化一个误差函数来生成满足约束的运动。误差函数由一系列原子约束组成,每个原子约束对应一种特定的运动控制目标,例如保持平衡、避免碰撞或遵循轨迹。通过调整预训练运动生成模型的潜在代码,可以生成既符合模型先验知识,又满足用户自定义约束的运动。这种方法的核心在于将运动生成和约束满足解耦,从而实现对各种运动控制任务的统一处理。

技术框架:整体框架包含三个主要部分:1) 预训练的运动生成模型,用于提供运动的先验知识;2) 可编程的误差函数,用于量化运动序列对约束的违反程度;3) 优化器,用于调整运动生成模型的潜在代码,以最小化误差函数。用户首先根据所需的运动控制任务,定义一系列原子约束,并将这些约束编程为一个误差函数。然后,利用优化器(例如梯度下降)调整运动生成模型的潜在代码,生成满足约束的运动序列。

关键创新:最重要的技术创新在于提出了可编程运动生成的范式,将运动控制任务分解为原子约束的组合,并通过优化预训练模型的潜在代码来实现对各种运动控制任务的统一处理。与现有方法相比,该方法无需针对不同的任务设计专门的模型或收集特定的训练数据,具有更强的通用性和可扩展性。此外,通过对新任务进行编程,模型能够涌现出超出先前模型的新技能。

关键设计:误差函数的设计是关键。论文中,误差函数由多个原子约束项组成,每个约束项对应一种特定的运动控制目标。每个约束项通常采用平方误差的形式,用于量化运动序列对该约束的违反程度。为了平衡不同约束项之间的重要性,可以为每个约束项设置一个权重。此外,论文还利用大型语言模型实现了自动编程,即根据用户输入的自然语言描述,自动生成相应的误差函数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够生成高质量的运动,并能处理各种未见过的任务,包括运动动力学、几何约束、物理定律、与场景、物体或角色自身身体部位的交互等。该方法在统一的框架下实现了对各种运动控制任务的处理,无需特定的配对训练数据或专门的网络设计。此外,通过对新任务进行编程,模型能够涌现出超出先前模型的新技能。

🎯 应用场景

该研究成果可广泛应用于游戏、电影、虚拟现实等领域,实现更加逼真和可控的角色动画。例如,可以用于生成与环境交互的角色动画,或者根据用户的指令生成特定的运动序列。此外,该方法还可以应用于机器人控制领域,实现更加灵活和智能的机器人运动规划。

📄 摘要(原文)

Character animation in real-world scenarios necessitates a variety of constraints, such as trajectories, key-frames, interactions, etc. Existing methodologies typically treat single or a finite set of these constraint(s) as separate control tasks. They are often specialized, and the tasks they address are rarely extendable or customizable. We categorize these as solutions to the close-set motion control problem. In response to the complexity of practical motion control, we propose and attempt to solve the open-set motion control problem. This problem is characterized by an open and fully customizable set of motion control tasks. To address this, we introduce a new paradigm, programmable motion generation. In this paradigm, any given motion control task is broken down into a combination of atomic constraints. These constraints are then programmed into an error function that quantifies the degree to which a motion sequence adheres to them. We utilize a pre-trained motion generation model and optimize its latent code to minimize the error function of the generated motion. Consequently, the generated motion not only inherits the prior of the generative model but also satisfies the required constraints. Experiments show that we can generate high-quality motions when addressing a wide range of unseen tasks. These tasks encompass motion control by motion dynamics, geometric constraints, physical laws, interactions with scenes, objects or the character own body parts, etc. All of these are achieved in a unified approach, without the need for ad-hoc paired training data collection or specialized network designs. During the programming of novel tasks, we observed the emergence of new skills beyond those of the prior model. With the assistance of large language models, we also achieved automatic programming. We hope that this work will pave the way for the motion control of general AI agents.