NeRF-Casting: Improved View-Dependent Appearance with Consistent Reflections

作者: Dor Verbin, Pratul P. Srinivasan, Peter Hedman, Ben Mildenhall, Benjamin Attal, Richard Szeliski, Jonathan T. Barron

分类: cs.CV, cs.GR

发布日期: 2024-05-23

备注: Project page: http://nerf-casting.github.io

💡 一句话要点

NeRF-Casting:通过一致反射改进视角相关的外观渲染

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 神经辐射场 光线追踪 视角合成 高光反射 渲染 计算机视觉 逆渲染

📋 核心要点

- NeRF难以处理高光物体,视角变化导致外观快速变化,重建和渲染效果不佳。

- 提出NeRF-Casting,通过光线追踪方法,从NeRF表示中投射反射光线,渲染特征向量并解码颜色。

- 实验表明,该模型在合成闪亮物体场景的视角方面优于现有方法,并能合成逼真的高光外观和反射。

📝 摘要(中文)

神经辐射场(NeRFs)通常难以重建和渲染高光泽物体,因为这些物体的外观随视角变化迅速。最近的研究改进了NeRF渲染远处环境光照的精细高光外观的能力,但无法合成近距离内容的一致反射。此外,这些技术依赖于计算量大的神经网络来建模出射辐射,这严重限制了优化和渲染速度。我们通过一种基于光线追踪的方法来解决这些问题:我们的模型不是查询一个昂贵的神经网络来获取沿着每条相机光线的点的视角相关的出射辐射,而是从这些点投射反射光线,并通过NeRF表示追踪它们来渲染特征向量,这些特征向量使用一个小的廉价网络解码为颜色。我们证明了我们的模型优于先前的方法,可以合成包含闪亮物体的场景的视角,并且是唯一可以合成真实场景中逼真高光外观和反射的现有NeRF方法,同时需要与当前最先进的视角合成模型相当的优化时间。

🔬 方法详解

问题定义:NeRF在渲染具有高光反射属性的物体时存在困难,尤其是在视角变化时,物体外观变化剧烈。现有的方法要么无法捕捉到一致的反射效果,要么需要巨大的计算开销,导致优化和渲染速度慢。现有方法难以兼顾高质量的反射效果和高效的渲染速度。

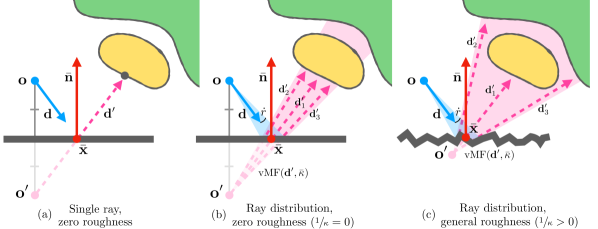

核心思路:该论文的核心思路是利用光线追踪的思想,避免直接查询一个大型神经网络来获取每个点的出射辐射。取而代之的是,从每个采样点投射反射光线,并追踪这些光线与NeRF场景的交互,从而获得用于渲染的特征向量。这种方法降低了对大型神经网络的依赖,提高了效率,并能更好地捕捉反射效果。

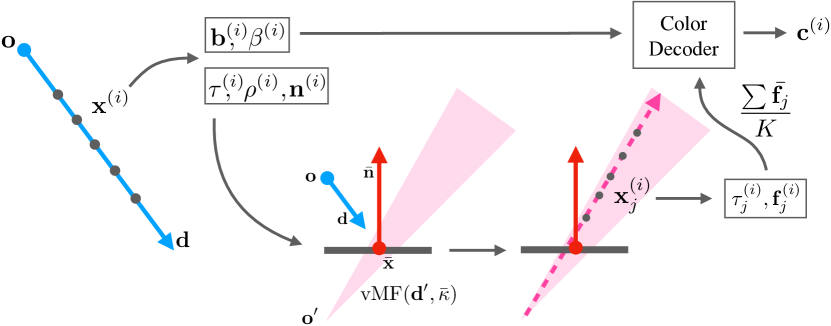

技术框架:NeRF-Casting的整体框架包括以下几个主要步骤:1) 从相机发出光线,并在光线上进行采样;2) 对于每个采样点,计算反射方向,并投射反射光线;3) 追踪反射光线与NeRF场景的交互,得到特征向量;4) 使用一个小型神经网络将特征向量解码为颜色值。整个过程利用NeRF作为场景的几何和辐射表示,并结合光线追踪来模拟反射效果。

关键创新:该论文的关键创新在于使用光线追踪来间接获取视角相关的辐射信息,而不是直接从神经网络中查询。这种方法显著降低了计算复杂度,并使得模型能够更好地捕捉到一致的反射效果。此外,使用小型神经网络解码特征向量进一步提高了渲染速度。

关键设计:该方法使用一个预训练的NeRF模型作为场景的几何和辐射表示。反射光线的方向计算基于表面的法向量,法向量可以通过NeRF的密度场计算得到。特征向量的维度和解码网络的结构是需要仔细设计的参数,以在性能和效率之间取得平衡。损失函数包括重建损失和正则化项,用于优化NeRF和解码网络。

🖼️ 关键图片

📊 实验亮点

实验结果表明,NeRF-Casting在合成具有高光反射物体的场景时,能够显著优于现有的NeRF方法。在视觉质量上,NeRF-Casting能够生成更清晰、更真实的反射效果。在优化时间上,NeRF-Casting与当前最先进的视角合成模型相当,证明了其高效性。具体性能数据未知,但论文强调了在反射效果和渲染效率上的显著提升。

🎯 应用场景

该研究成果可应用于虚拟现实、增强现实、游戏开发等领域,用于创建更逼真、更具沉浸感的虚拟场景。尤其是在需要渲染具有高光反射属性的物体时,例如金属、玻璃等,NeRF-Casting能够提供更优秀的渲染效果。此外,该方法的高效性使其在移动设备等资源受限的平台上也具有应用潜力。

📄 摘要(原文)

Neural Radiance Fields (NeRFs) typically struggle to reconstruct and render highly specular objects, whose appearance varies quickly with changes in viewpoint. Recent works have improved NeRF's ability to render detailed specular appearance of distant environment illumination, but are unable to synthesize consistent reflections of closer content. Moreover, these techniques rely on large computationally-expensive neural networks to model outgoing radiance, which severely limits optimization and rendering speed. We address these issues with an approach based on ray tracing: instead of querying an expensive neural network for the outgoing view-dependent radiance at points along each camera ray, our model casts reflection rays from these points and traces them through the NeRF representation to render feature vectors which are decoded into color using a small inexpensive network. We demonstrate that our model outperforms prior methods for view synthesis of scenes containing shiny objects, and that it is the only existing NeRF method that can synthesize photorealistic specular appearance and reflections in real-world scenes, while requiring comparable optimization time to current state-of-the-art view synthesis models.