MM-Retinal: Knowledge-Enhanced Foundational Pretraining with Fundus Image-Text Expertise

作者: Ruiqi Wu, Chenran Zhang, Jianle Zhang, Yi Zhou, Tao Zhou, Huazhu Fu

分类: cs.CV

发布日期: 2024-05-20

备注: Early Accepted by The International Conference on Medical Image Computing and Computer Assisted Intervention(MICCAI)2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出KeepFIT:一种知识增强的眼底图像-文本预训练模型,提升眼科图像分析的泛化性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 眼底图像分析 知识增强 预训练模型 多模态学习 图像文本对

📋 核心要点

- 现有眼底图像分析模型依赖特定数据集,缺乏先验知识,导致迁移性和泛化性不足。

- 论文提出KeepFIT模型,通过图像相似性引导的文本修订和混合训练策略,融入眼科专业知识。

- KeepFIT在六个下游任务中取得SOTA性能,展现出优秀的零样本和小样本泛化能力。

📝 摘要(中文)

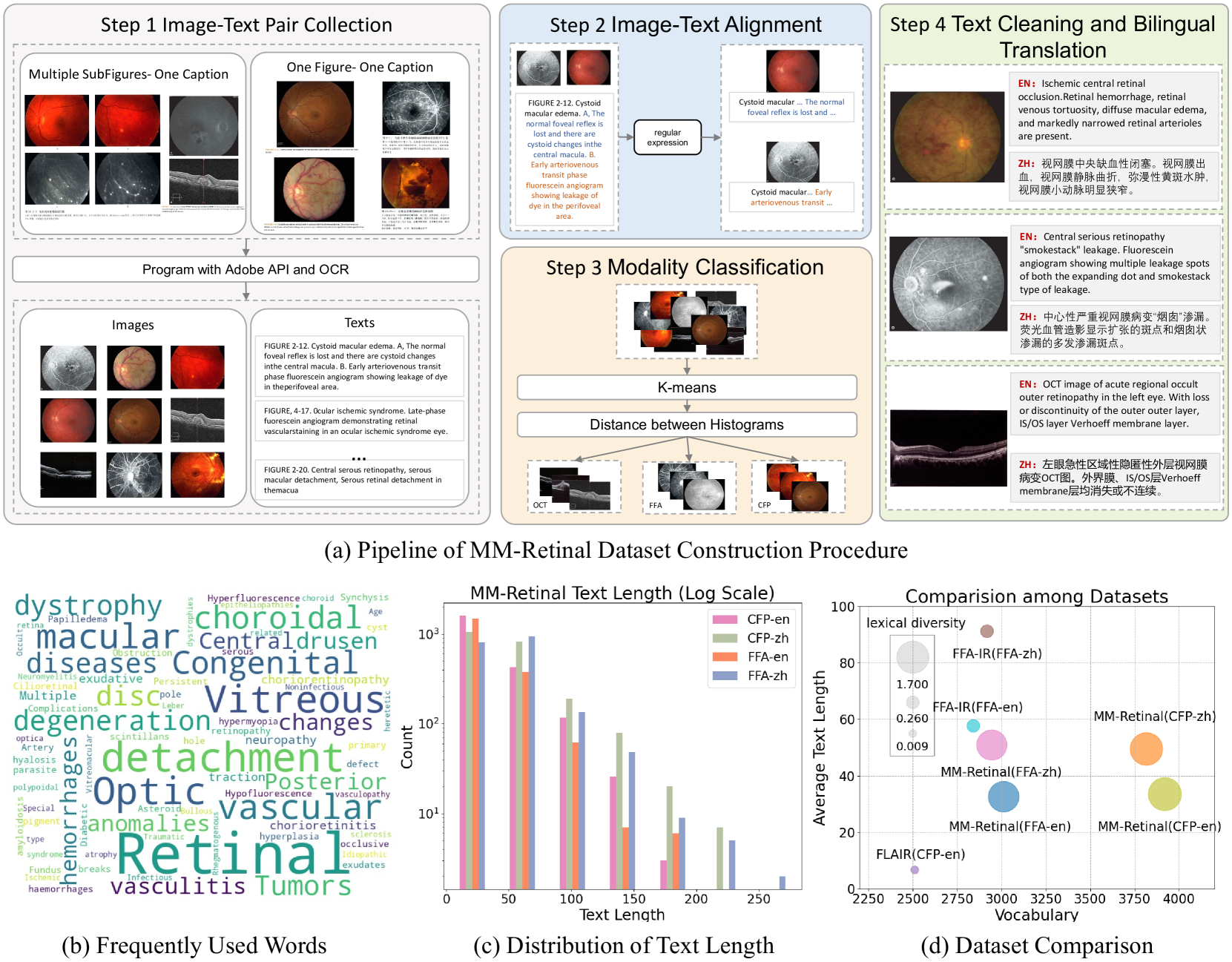

现有的眼底图像分析模型主要针对特定任务,依赖于独立数据集。学习过程通常基于数据驱动范式,缺乏先验知识,导致迁移性和泛化性较差。为了解决这个问题,我们提出了MM-Retinal,一个包含从专业眼底图谱书籍中收集的高质量图像-文本对的多模态数据集。此外,基于MM-Retinal,我们提出了一个新颖的知识增强的基础预训练模型,它融合了眼底图像-文本专业知识,称为KeepFIT。它被设计为具有图像相似性引导的文本修订和混合训练策略,以注入专家知识。我们提出的眼底基础模型在六个未见过的下游任务中实现了最先进的性能,并在零样本和小样本场景中具有出色的泛化能力。MM-Retinal和KeepFIT可在https://github.com/lxirich/MM-Retinal上获得。

🔬 方法详解

问题定义:现有眼底图像分析模型通常针对特定任务和数据集进行训练,缺乏对眼科专业知识的有效利用。这种数据驱动的范式导致模型在面对新的、未见过的数据集或任务时,泛化能力较差。模型难以将从一个数据集学到的知识迁移到另一个数据集上,限制了其在实际临床应用中的价值。

核心思路:论文的核心思路是通过引入眼科专业知识来增强眼底图像分析模型的泛化能力。具体而言,论文构建了一个包含高质量眼底图像-文本对的多模态数据集MM-Retinal,并基于此提出了知识增强的预训练模型KeepFIT。KeepFIT旨在通过图像相似性引导的文本修订和混合训练策略,将眼科专家知识注入到模型中,从而提高其在各种眼底图像分析任务中的性能。

技术框架:KeepFIT的技术框架主要包括以下几个部分:1) MM-Retinal数据集的构建,包含高质量的眼底图像和对应的文本描述;2) 图像相似性引导的文本修订模块,用于修正文本描述中的错误或不准确之处;3) 混合训练策略,将预训练任务和下游任务结合起来进行训练,以提高模型的泛化能力。整体流程是首先利用MM-Retinal数据集对KeepFIT进行预训练,然后在下游任务上进行微调。

关键创新:KeepFIT的关键创新在于其知识增强的预训练方法。与传统的仅依赖数据驱动的预训练方法不同,KeepFIT通过引入眼科专业知识,使得模型能够更好地理解眼底图像的语义信息。图像相似性引导的文本修订模块和混合训练策略是实现这一目标的关键技术手段。

关键设计:在图像相似性引导的文本修订模块中,论文可能采用了对比学习等技术,以确保修订后的文本描述与图像内容更加一致。在混合训练策略中,论文可能采用了不同的损失函数来平衡预训练任务和下游任务之间的关系。具体的网络结构可能基于Transformer等常用的深度学习模型,并针对眼底图像的特点进行了一些定制化的设计。

🖼️ 关键图片

📊 实验亮点

KeepFIT模型在六个未见过的下游任务中取得了state-of-the-art的性能,证明了其卓越的泛化能力。在零样本和小样本场景下的实验结果表明,KeepFIT能够有效地利用预训练阶段学到的知识,快速适应新的任务,显著优于传统的基于数据驱动的眼底图像分析模型。具体的性能提升数据需要在论文中查找。

🎯 应用场景

该研究成果可应用于眼科疾病的自动诊断、筛查和病情监测。通过提升眼底图像分析模型的泛化能力,可以减少对大量标注数据的依赖,降低医疗成本,并为偏远地区提供高质量的眼科医疗服务。未来,该技术有望与远程医疗系统相结合,实现更便捷、高效的眼科疾病管理。

📄 摘要(原文)

Current fundus image analysis models are predominantly built for specific tasks relying on individual datasets. The learning process is usually based on data-driven paradigm without prior knowledge, resulting in poor transferability and generalizability. To address this issue, we propose MM-Retinal, a multi-modal dataset that encompasses high-quality image-text pairs collected from professional fundus diagram books. Moreover, enabled by MM-Retinal, we present a novel Knowledge-enhanced foundational pretraining model which incorporates Fundus Image-Text expertise, called KeepFIT. It is designed with image similarity-guided text revision and mixed training strategy to infuse expert knowledge. Our proposed fundus foundation model achieves state-of-the-art performance across six unseen downstream tasks and holds excellent generalization ability in zero-shot and few-shot scenarios. MM-Retinal and KeepFIT are available at https://github.com/lxirich/MM-Retinal.