Efficient Multimodal Large Language Models: A Survey

作者: Yizhang Jin, Jian Li, Yexin Liu, Tianjun Gu, Kai Wu, Zhengkai Jiang, Muyang He, Bo Zhao, Xin Tan, Zhenye Gan, Yabiao Wang, Chengjie Wang, Lizhuang Ma

分类: cs.CV, cs.AI

发布日期: 2024-05-17 (更新: 2026-01-22)

备注: Accepted by Visual Intelligence

期刊: Visual Intelligence, Volume 3, article number 27, (2025)

DOI: 10.1007/s44267-025-00099-6

🔗 代码/项目: GITHUB

💡 一句话要点

综述高效多模态大语言模型,探索边缘计算场景下的轻量化方案。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 高效模型 模型压缩 知识蒸馏 参数高效微调 边缘计算 视觉问答

📋 核心要点

- 现有MLLM模型规模庞大,训练和推理成本高昂,难以在资源受限的边缘计算场景中部署。

- 该综述旨在系统性地回顾高效MLLM的研究进展,包括模型结构、训练策略和应用场景。

- 通过对现有方法的分析,指出当前高效MLLM研究的局限性,并展望未来的研究方向。

📝 摘要(中文)

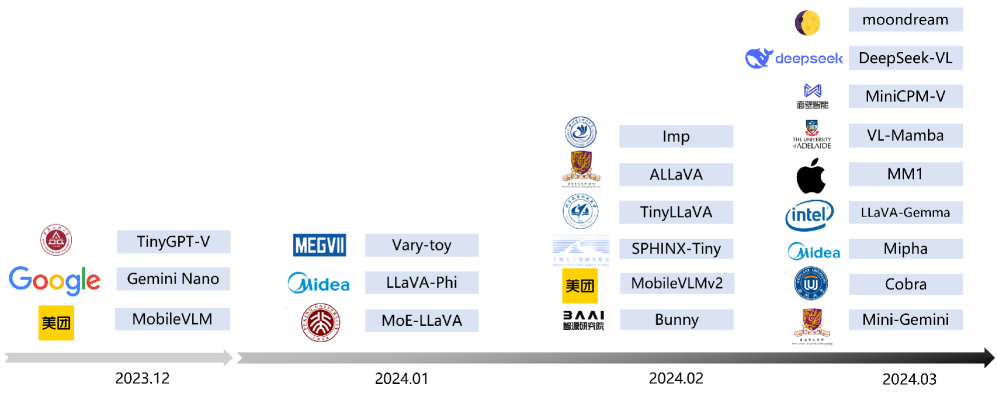

近年来,多模态大语言模型(MLLMs)在视觉问答、视觉理解和推理等任务中表现出卓越的性能。然而,庞大的模型规模以及高昂的训练和推理成本阻碍了MLLMs在学术界和工业界的广泛应用。因此,研究高效且轻量级的MLLMs具有巨大的潜力,尤其是在边缘计算场景中。本综述全面而系统地回顾了当前高效MLLMs的研究现状。具体而言,我们总结了代表性高效MLLMs的时间线、高效结构和策略的研究状态以及应用。最后,我们讨论了当前高效MLLM研究的局限性以及有希望的未来方向。更多详细信息请参考我们的GitHub仓库:https://github.com/lijiannuist/Efficient-Multimodal-LLMs-Survey。

🔬 方法详解

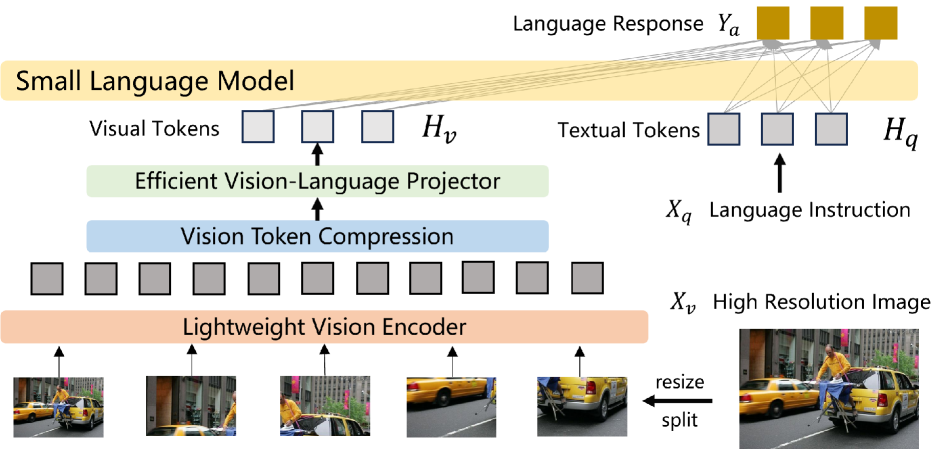

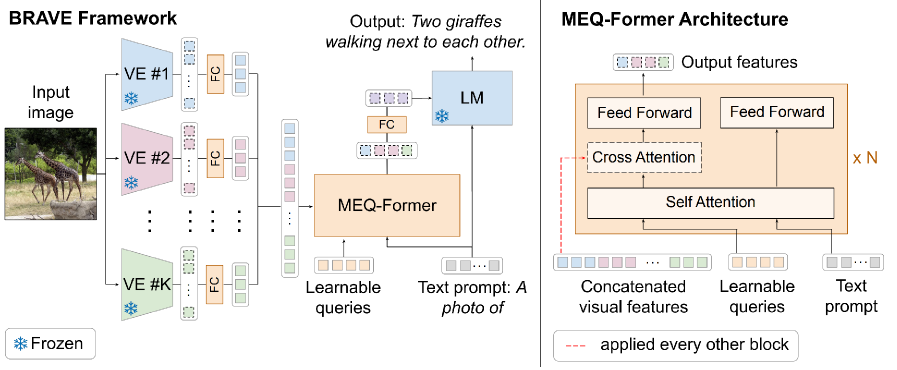

问题定义:论文旨在解决多模态大语言模型(MLLMs)在资源受限场景下部署困难的问题。现有MLLMs模型体积大,计算复杂度高,训练和推理成本高昂,无法满足边缘计算等场景的需求。因此,如何设计高效且轻量级的MLLMs成为一个重要的研究问题。

核心思路:论文的核心思路是对现有高效MLLMs的研究进行系统性的梳理和总结,从模型结构、训练策略和应用等多个角度进行分析。通过对现有方法的归纳和比较,找出高效MLLMs的关键技术和发展趋势,为未来的研究提供指导。

技术框架:该综述的技术框架主要包括以下几个部分:1)回顾代表性高效MLLMs的发展时间线;2)总结高效MLLMs的结构设计,例如模型压缩、知识蒸馏、参数高效微调等;3)分析高效MLLMs的训练策略,例如数据增强、优化算法等;4)探讨高效MLLMs的应用场景,例如视觉问答、图像描述等;5)讨论当前研究的局限性,并展望未来的研究方向。

关键创新:该综述的关键创新在于对现有高效MLLMs的研究进行了全面而系统的总结,并从多个角度对这些方法进行了分析和比较。此外,该综述还指出了当前研究的局限性,并提出了未来可能的研究方向,为该领域的研究人员提供了有价值的参考。

关键设计:该综述的关键设计在于对高效MLLMs的分类和组织方式。论文将现有方法按照模型结构和训练策略进行分类,并对每一类方法进行了详细的描述和分析。此外,论文还对不同方法进行了比较,指出了它们的优缺点,为读者提供了更全面的了解。

🖼️ 关键图片

📊 实验亮点

该论文是一篇综述,没有具体的实验结果。其亮点在于对现有高效多模态大语言模型进行了系统性的总结和分析,为研究人员提供了全面的参考。通过对现有方法的比较,指出了当前研究的局限性,并展望了未来的研究方向。

🎯 应用场景

该研究对边缘计算、移动设备等资源受限场景下的多模态应用具有重要意义。轻量化MLLM能够支持在本地设备上进行视觉问答、图像理解等任务,提高用户隐私和响应速度。未来,该研究将推动多模态AI在智能家居、自动驾驶等领域的广泛应用。

📄 摘要(原文)

In the past year, Multimodal Large Language Models (MLLMs) have demonstrated remarkable performance in tasks such as visual question answering, visual understanding and reasoning. However, the extensive model size and high training and inference costs have hindered the widespread application of MLLMs in academia and industry. Thus, studying efficient and lightweight MLLMs has enormous potential, especially in edge computing scenarios. In this survey, we provide a comprehensive and systematic review of the current state of efficient MLLMs. Specifically, we summarize the timeline of representative efficient MLLMs, research state of efficient structures and strategies, and the applications. Finally, we discuss the limitations of current efficient MLLM research and promising future directions. Please refer to our GitHub repository for more details: https://github.com/lijiannuist/Efficient-Multimodal-LLMs-Survey.