CLIP with Quality Captions: A Strong Pretraining for Vision Tasks

作者: Pavan Kumar Anasosalu Vasu, Hadi Pouransari, Fartash Faghri, Oncel Tuzel

分类: cs.CV, cs.LG

发布日期: 2024-05-14

💡 一句话要点

通过高质量Caption提升CLIP视觉表征,显著改善下游视觉任务

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: CLIP 视觉表征 图像-文本对 高质量Caption 密集预测任务 预训练 语义分割 深度估计

📋 核心要点

- CLIP在密集预测任务中表现不佳,现有方法通常采用多阶段训练来缓解这一问题。

- 本文提出通过提升图像-文本数据集中Caption的质量来改善CLIP的视觉表征。

- 实验表明,高质量Caption的CLIP预训练超越了现有监督、自监督和弱监督预训练方法,并在移动架构上表现出优势。

📝 摘要(中文)

CLIP模型在零样本分类和检索任务中表现出色,但研究表明其学习到的表征不适用于目标检测、语义分割或深度估计等密集预测任务。本文发现,简单地提高图像-文本数据集中Caption的质量,可以显著改善CLIP的视觉表征,从而在下游密集预测视觉任务中获得显著提升。事实上,使用高质量Caption进行CLIP预训练可以超越最近的监督、自监督和弱监督预训练方法。当使用ViT-B/16作为图像编码器的CLIP模型在良好对齐的图像-文本对上进行训练时,在语义分割和深度估计任务中,其mIoU分别高出12.1%,RMSE分别低11.5%,超过了最近的Masked Image Modeling (MIM)预训练方法,如Masked Autoencoder (MAE)。移动架构也从CLIP预训练中受益匪浅。最近的移动视觉架构MCi2,通过CLIP预训练获得了与在ImageNet-22k上预训练的Swin-L相似的语义分割性能,同时模型大小缩小了6.1倍。此外,改进Caption质量可以在密集预测任务的微调中提高10倍的数据效率。

🔬 方法详解

问题定义:CLIP模型在零样本分类和检索任务中表现优异,但其学习到的视觉表征在目标检测、语义分割和深度估计等密集预测任务中表现不佳。现有的多阶段训练方法试图解决这个问题,但计算成本较高,且效果提升有限。

核心思路:本文的核心思路是,CLIP模型性能不佳的原因在于训练数据集中图像-文本对的Caption质量不高。通过提高Caption的质量,可以使CLIP模型学习到更好的视觉表征,从而提升其在下游密集预测任务中的性能。高质量的Caption能够更准确地描述图像内容,从而使模型更好地理解图像的语义信息。

技术框架:本文主要关注CLIP模型的预训练阶段。其技术框架包括:1)收集或生成高质量的图像-文本对数据集;2)使用该数据集训练CLIP模型,包括图像编码器和文本编码器;3)在下游密集预测任务上微调CLIP模型,并评估其性能。图像编码器可以是ViT-B/16或其他视觉Transformer架构,文本编码器通常是Transformer模型。

关键创新:本文最重要的创新点在于强调了Caption质量对CLIP模型性能的重要性。以往的研究更多关注模型架构和训练策略,而忽略了数据质量的影响。本文证明,通过简单地提高Caption质量,就可以显著提升CLIP模型的性能,甚至超越更复杂的预训练方法。

关键设计:本文的关键设计在于如何获取高质量的Caption。具体方法未知,但可以推测包括人工标注、使用更先进的Caption生成模型、以及对现有Caption进行过滤和修正等。损失函数仍然采用CLIP原有的对比学习损失,即最大化图像和对应文本嵌入之间的相似度,最小化图像和非对应文本嵌入之间的相似度。具体的网络结构取决于所选择的图像和文本编码器。

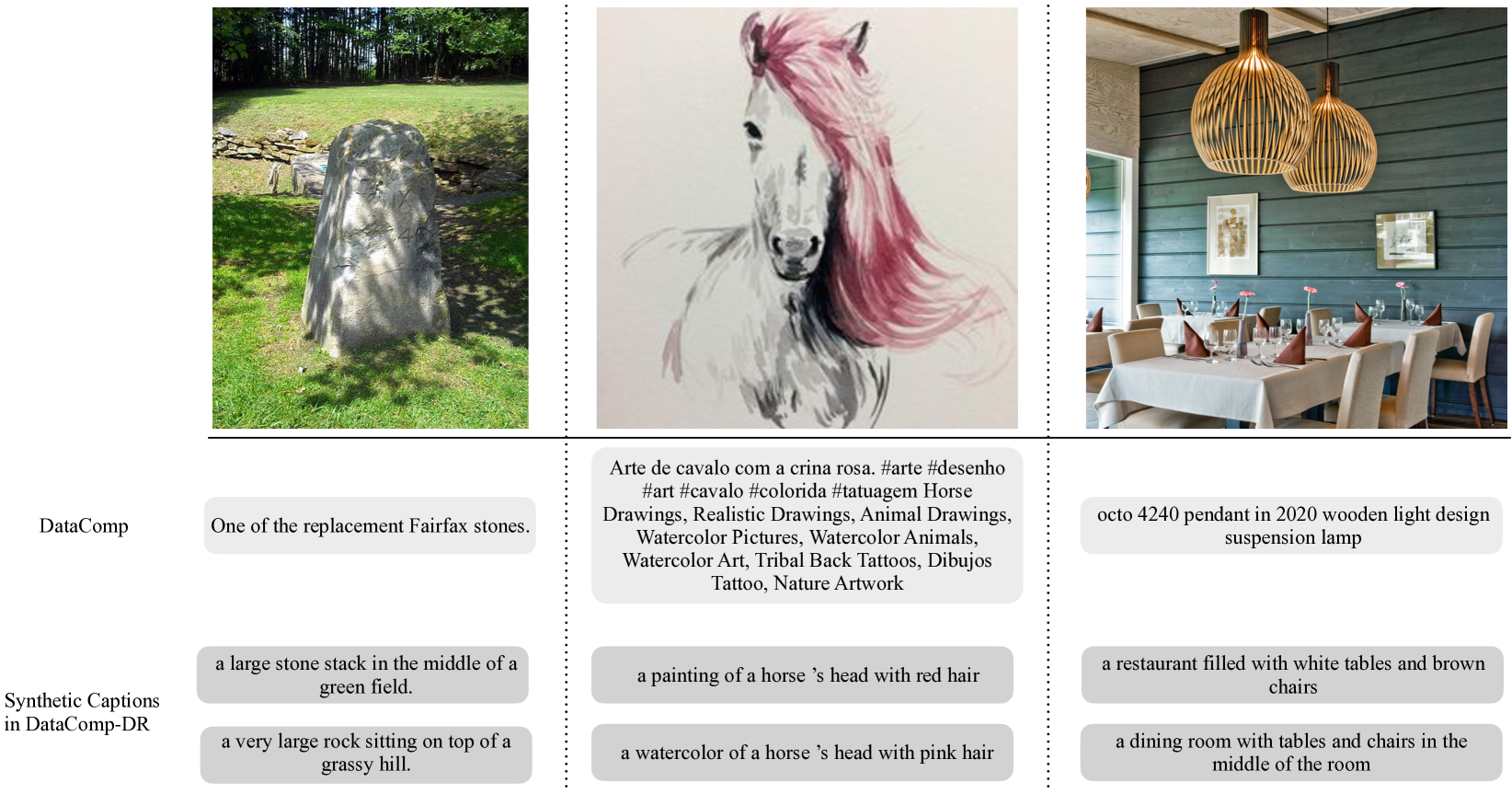

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用高质量Caption训练的CLIP模型,在使用ViT-B/16作为图像编码器时,在语义分割和深度估计任务中,其mIoU分别高出12.1%,RMSE分别低11.5%,超过了MAE等先进的MIM预训练方法。此外,CLIP预训练显著提升了移动视觉架构MCi2的性能,使其在语义分割任务中达到与Swin-L相似的水平,同时模型大小缩小了6.1倍。

🎯 应用场景

该研究成果可广泛应用于计算机视觉领域,尤其是在需要高质量视觉表征的任务中,如自动驾驶、机器人导航、医学图像分析等。通过提升CLIP模型的性能,可以提高这些应用场景中的感知能力和决策能力。此外,该研究也为如何有效利用大规模图像-文本数据进行预训练提供了新的思路。

📄 摘要(原文)

CLIP models perform remarkably well on zero-shot classification and retrieval tasks. But recent studies have shown that learnt representations in CLIP are not well suited for dense prediction tasks like object detection, semantic segmentation or depth estimation. More recently, multi-stage training methods for CLIP models was introduced to mitigate the weak performance of CLIP on downstream tasks. In this work, we find that simply improving the quality of captions in image-text datasets improves the quality of CLIP's visual representations, resulting in significant improvement on downstream dense prediction vision tasks. In fact, we find that CLIP pretraining with good quality captions can surpass recent supervised, self-supervised and weakly supervised pretraining methods. We show that when CLIP model with ViT-B/16 as image encoder is trained on well aligned image-text pairs it obtains 12.1% higher mIoU and 11.5% lower RMSE on semantic segmentation and depth estimation tasks over recent state-of-the-art Masked Image Modeling (MIM) pretraining methods like Masked Autoencoder (MAE). We find that mobile architectures also benefit significantly from CLIP pretraining. A recent mobile vision architecture, MCi2, with CLIP pretraining obtains similar performance as Swin-L, pretrained on ImageNet-22k for semantic segmentation task while being 6.1$\times$ smaller. Moreover, we show that improving caption quality results in $10\times$ data efficiency when finetuning for dense prediction tasks.