SceneFactory: A Workflow-centric and Unified Framework for Incremental Scene Modeling

作者: Yijun Yuan, Michael Bleier, Andreas Nüchter

分类: cs.CV, cs.RO

发布日期: 2024-05-13 (更新: 2025-04-16)

备注: Accepted to IEEE Transactions on Robotics (T-RO). For project page and code, please find https://jarrome.github.io/SceneFactory/

💡 一句话要点

SceneFactory:面向工作流的统一增量场景建模框架,支持多种重建任务。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 场景建模 三维重建 多视图深度估计 SLAM RGB-D RGB-LiDAR 神经渲染 点云处理

📋 核心要点

- 现有场景建模方法在处理不同输入类型和应用时存在冗余设计,缺乏统一性。

- SceneFactory通过四个核心模块(跟踪、弯曲、深度估计、场景重建)构建工作流,支持多种输入和应用。

- 提出的U$^2$-MVD模型和DM-NPs方法分别提升了深度估计和表面颜色重建的质量。

📝 摘要(中文)

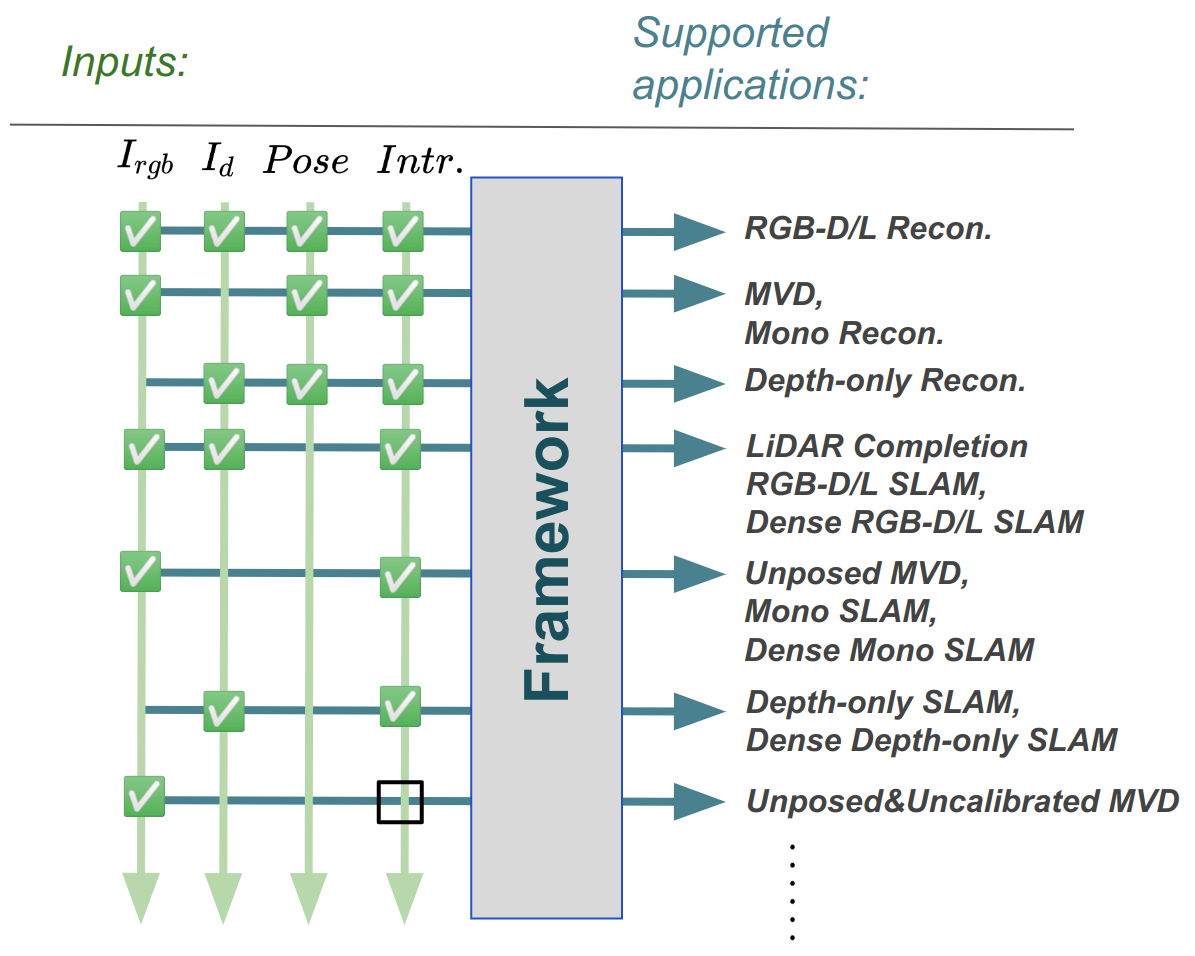

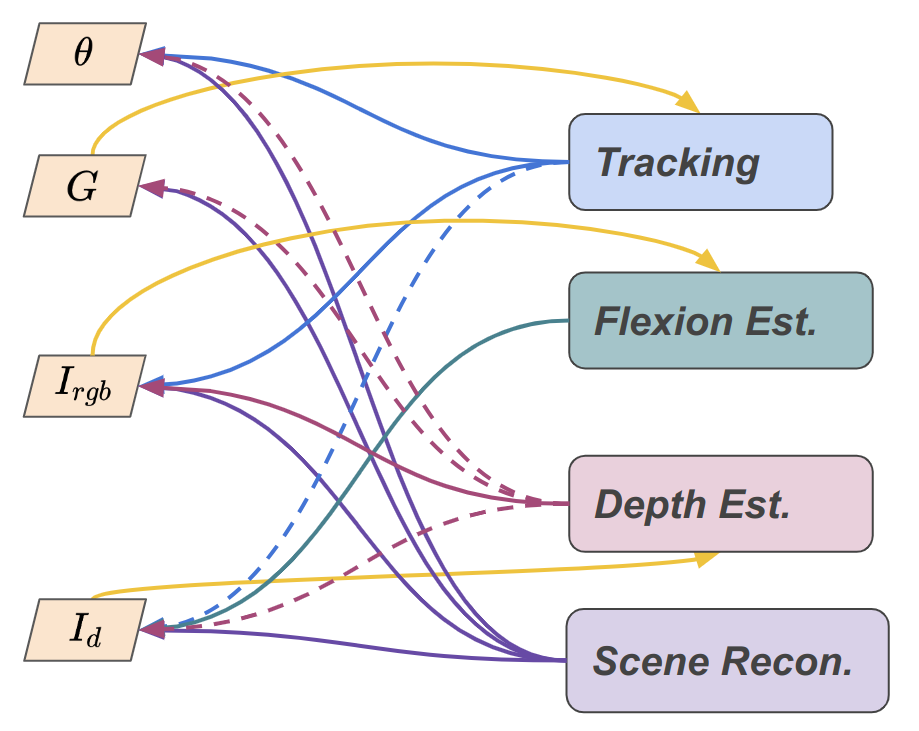

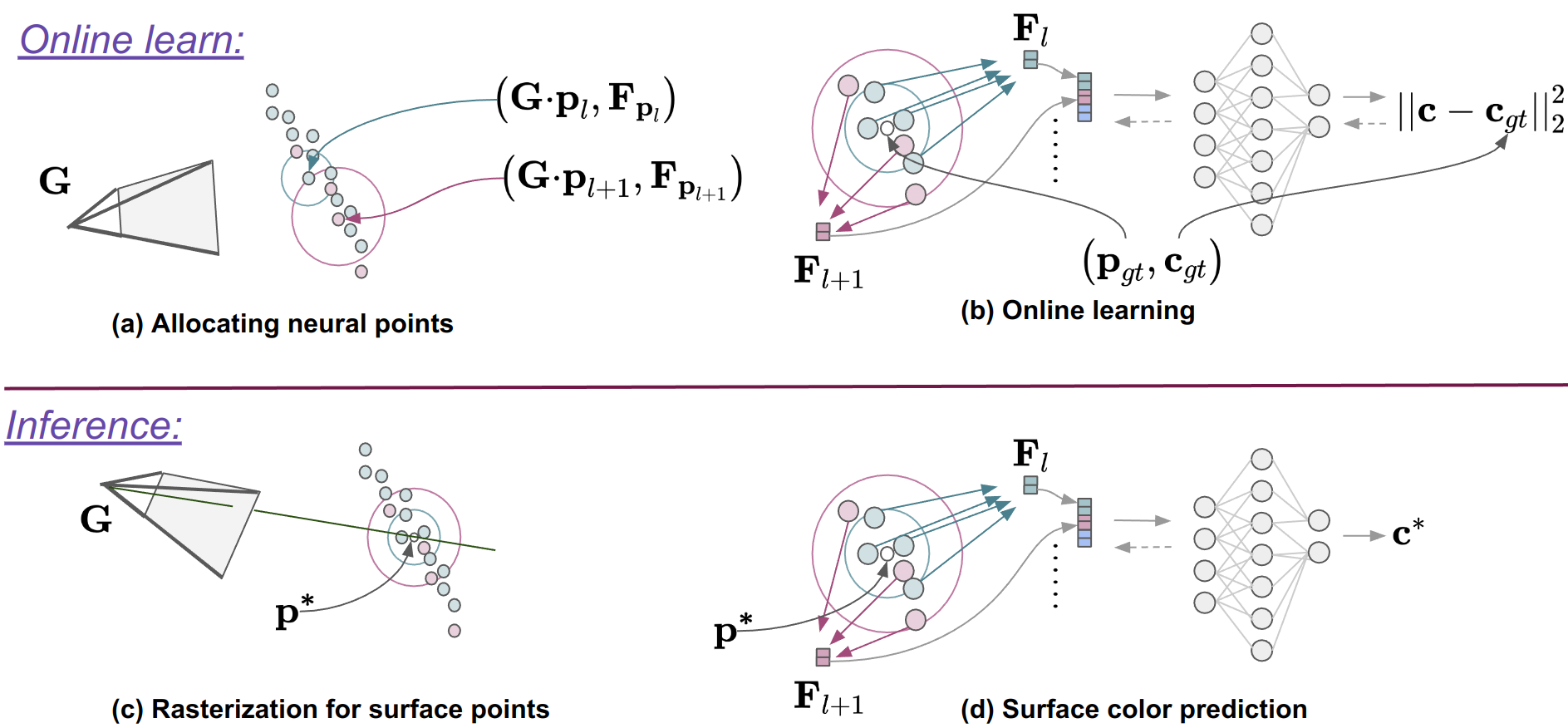

本文提出SceneFactory,一个面向工作流的统一增量场景建模框架,它便捷地支持广泛的应用,例如(无位姿和/或未校准的)多视图深度估计、LiDAR补全、(稠密)RGB-D/RGB-L/单目/仅深度重建和SLAM。工作流中心的设计使用多个块作为构建不同生产线的基础。所支持的应用,即生产,避免了设计中的冗余。因此,重点放在每个块本身以进行独立扩展。为了支持所有输入组合,我们的实现包含四个构建块,它们构成了SceneFactory:(1)跟踪,(2)弯曲(Flexion),(3)深度估计和(4)场景重建。跟踪块基于Mono SLAM,并扩展为支持RGB-D和RGB-LiDAR(RGB-L)输入。Flexion用于将深度图像(不可跟踪)转换为可跟踪图像。对于通用深度估计,我们提出了一种无位姿和未校准的多视图深度估计模型(U$^2$-MVD)来估计稠密几何体。U$^2$-MVD利用稠密Bundle Adjustment来求解位姿、内参和逆深度。然后引入语义感知的ScaleCov步骤来完成多视图深度。依靠U$^2$-MVD,SceneFactory既支持用户友好的3D创建(仅使用图像),又桥接了稠密RGB-D和稠密单目的应用。对于高质量的表面和颜色重建,我们提出了双用途多分辨率神经点(DM-NPs)用于第一个表面可访问的表面颜色场设计,其中我们引入了改进的点栅格化(IPR)用于基于点云的表面查询。

🔬 方法详解

问题定义:现有场景建模方法通常针对特定类型的输入数据(如RGB-D、LiDAR或单目图像)和特定的应用场景(如SLAM、三维重建)进行设计,导致系统复杂且难以扩展。当需要处理不同类型的输入或支持新的应用时,往往需要重新设计整个系统,造成了大量的冗余工作。此外,无位姿和未校准的多视图深度估计仍然是一个具有挑战性的问题,现有的方法通常需要精确的相机位姿和内参,限制了其在实际应用中的灵活性。

核心思路:SceneFactory的核心思路是构建一个模块化的、可扩展的场景建模框架,通过将不同的功能分解为独立的模块,并定义清晰的接口,使得各个模块可以独立开发和维护,从而降低了系统的复杂性。通过工作流中心的设计,不同的应用可以通过组合不同的模块来实现,避免了冗余设计。对于无位姿和未校准的多视图深度估计,采用稠密Bundle Adjustment来同时优化相机位姿、内参和逆深度,从而实现高精度的深度估计。

技术框架:SceneFactory的整体架构包含四个主要模块:(1)跟踪模块:负责估计相机的位姿,支持Mono SLAM,并扩展到支持RGB-D和RGB-LiDAR输入。(2)弯曲(Flexion)模块:用于将深度图像转换为可跟踪的图像,解决深度图像无法直接用于跟踪的问题。(3)深度估计模块:采用提出的U$^2$-MVD模型进行多视图深度估计,生成稠密的深度图。(4)场景重建模块:利用深度估计的结果进行三维场景重建,并采用DM-NPs方法进行高质量的表面和颜色重建。

关键创新:SceneFactory的关键创新在于其统一的框架设计和提出的U$^2$-MVD模型和DM-NPs方法。统一的框架设计使得系统可以灵活地支持多种输入类型和应用场景,避免了冗余设计。U$^2$-MVD模型通过稠密Bundle Adjustment实现了无位姿和未校准的多视图深度估计,提高了深度估计的精度和鲁棒性。DM-NPs方法实现了表面可访问的表面颜色场设计,提高了表面和颜色重建的质量。

关键设计:U$^2$-MVD模型采用了稠密Bundle Adjustment来同时优化相机位姿、内参和逆深度。为了提高深度估计的精度,引入了语义感知的ScaleCov步骤来完成多视图深度。DM-NPs方法采用了多分辨率的神经点来表示场景,并引入了改进的点栅格化(IPR)方法来提高表面查询的效率。

🖼️ 关键图片

📊 实验亮点

论文提出了U$^2$-MVD模型,实现了无位姿和未校准的多视图深度估计,并取得了良好的效果。此外,提出的DM-NPs方法实现了表面可访问的表面颜色场设计,提高了表面和颜色重建的质量。实验结果表明,SceneFactory能够有效地支持多种重建任务,并取得了具有竞争力的性能。

🎯 应用场景

SceneFactory具有广泛的应用前景,可用于机器人导航、增强现实、虚拟现实、三维地图构建、自动驾驶等领域。该框架能够处理多种类型的输入数据,并支持多种重建任务,使得用户可以方便地创建三维场景模型,并将其应用于各种实际应用中。未来,该框架可以进一步扩展到支持更多的输入类型和应用场景,并提高重建的精度和效率。

📄 摘要(原文)

We present SceneFactory, a workflow-centric and unified framework for incremental scene modeling, that conveniently supports a wide range of applications, such as (unposed and/or uncalibrated) multi-view depth estimation, LiDAR completion, (dense) RGB-D/RGB-L/Mono/Depth-only reconstruction and SLAM. The workflow-centric design uses multiple blocks as the basis for constructing different production lines. The supported applications, i.e., productions avoid redundancy in their designs. Thus, the focus is placed on each block itself for independent expansion. To support all input combinations, our implementation consists of four building blocks that form SceneFactory: (1) tracking, (2) flexion, (3) depth estimation, and (4) scene reconstruction. The tracking block is based on Mono SLAM and is extended to support RGB-D and RGB-LiDAR (RGB-L) inputs. Flexion is used to convert the depth image (untrackable) into a trackable image. For general-purpose depth estimation, we propose an unposed \& uncalibrated multi-view depth estimation model (U$^2$-MVD) to estimate dense geometry. U$^2$-MVD exploits dense bundle adjustment to solve for poses, intrinsics, and inverse depth. A semantic-aware ScaleCov step is then introduced to complete the multi-view depth. Relying on U$^2$-MVD, SceneFactory both supports user-friendly 3D creation (with just images) and bridges the applications of Dense RGB-D and Dense Mono. For high-quality surface and color reconstruction, we propose Dual-purpose Multi-resolutional Neural Points (DM-NPs) for the first surface accessible Surface Color Field design, where we introduce Improved Point Rasterization (IPR) for point cloud based surface query. ...