oTTC: Object Time-to-Contact for Motion Estimation in Autonomous Driving

作者: Abdul Hannan Khan, Syed Tahseen Raza Rizvi, Dheeraj Varma Chittari Macharavtu, Andreas Dengel

分类: cs.CV

发布日期: 2024-05-13

备注: 9 pages, 4 figures

💡 一句话要点

提出oTTC,扩展目标检测模型以估计自动驾驶中的目标碰撞时间

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 自动驾驶 碰撞时间估计 目标检测 单目视觉 深度学习

📋 核心要点

- 现有方法依赖于2D目标检测或逐像素碰撞时间估计,前者信息不足,后者计算成本高昂。

- 论文提出扩展现有目标检测模型,直接预测每个目标的碰撞时间(oTTC),从而简化流程。

- 实验表明,该方法在单张图像上实现了比现有技术更高的精度,提升了自动驾驶安全性。

📝 摘要(中文)

自动驾驶系统需要快速且稳健地感知周围环境才能有效执行任务。为了避免碰撞和安全驾驶,自动驾驶系统严重依赖于目标检测。然而,仅凭2D目标检测是不够的,还需要更多信息,例如相对速度和距离,以实现更安全的规划。单目3D目标检测器试图通过直接预测相机图像中的3D边界框和目标速度来解决这个问题。最近的研究表明,逐像素地估计碰撞时间(time-to-contact)比速度和深度结合更有效。然而,逐像素的碰撞时间估计需要目标检测来有效发挥作用,因此需要运行两个不同的模型,从而增加了整体计算需求。为了解决这个问题,我们提出了一种逐目标的碰撞时间估计方法,通过扩展目标检测模型来额外预测每个目标的碰撞时间属性。我们将提出的方法与现有的碰撞时间方法进行比较,并在知名数据集上提供基准测试结果。我们的方法在使用单张图像的情况下,比现有技术实现了更高的精度。

🔬 方法详解

问题定义:自动驾驶系统需要准确估计周围车辆的碰撞时间(Time-to-Contact, TTC)以进行安全规划。现有的方法要么依赖于2D目标检测,缺乏深度信息;要么采用逐像素的TTC估计,计算量大,需要额外的目标检测模型,效率较低。这些方法难以在计算资源有限的自动驾驶平台上实现实时应用。

核心思路:论文的核心思路是将TTC估计集成到目标检测框架中,通过扩展现有的目标检测模型,使其能够直接预测每个检测到的目标的TTC值。这样可以避免单独运行TTC估计模块,降低计算复杂度,并利用目标检测的上下文信息来提高TTC估计的准确性。

技术框架:该方法基于现有的目标检测模型(具体模型未在摘要中提及),并在其输出层添加一个分支,用于预测每个目标的TTC值。整个框架仍然是一个端到端的学习系统,可以同时进行目标检测和TTC估计。输入是单目图像,输出是目标边界框和对应的TTC值。

关键创新:该方法的主要创新在于提出了逐目标的TTC估计,将TTC估计与目标检测紧密结合,避免了额外的计算开销。通过单次前向传播,即可获得目标的位置和碰撞时间信息,提高了效率。

关键设计:论文没有详细说明具体的网络结构和损失函数,但可以推断,TTC预测分支可能采用回归损失函数,例如L1或L2损失,来最小化预测TTC值与真实TTC值之间的差异。具体的网络结构可能根据所选择的目标检测模型进行调整,以实现最佳性能。参数设置和训练策略等细节需要在论文全文中查找。

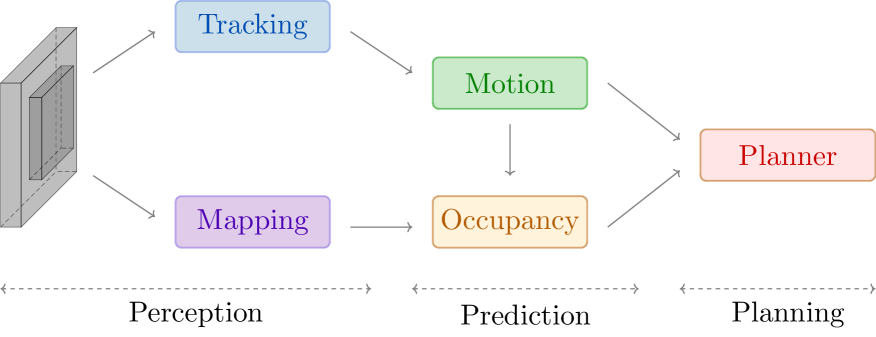

🖼️ 关键图片

📊 实验亮点

论文提出的方法在单张图像上实现了比现有技术更高的精度。虽然摘要中没有给出具体的性能数据,但强调了在精度方面的提升。通过与现有TTC估计方法的比较,验证了所提出方法的有效性。具体的性能提升幅度需要在论文全文中查找。

🎯 应用场景

该研究成果可直接应用于自动驾驶系统,为车辆提供更准确的碰撞风险评估,从而实现更安全的路径规划和决策。通过快速估计周围车辆的碰撞时间,自动驾驶系统可以及时采取避让措施,降低交通事故的发生率。此外,该方法还可以应用于高级驾驶辅助系统(ADAS),提高驾驶安全性。

📄 摘要(原文)

Autonomous driving systems require a quick and robust perception of the nearby environment to carry out their routines effectively. With the aim to avoid collisions and drive safely, autonomous driving systems rely heavily on object detection. However, 2D object detections alone are insufficient; more information, such as relative velocity and distance, is required for safer planning. Monocular 3D object detectors try to solve this problem by directly predicting 3D bounding boxes and object velocities given a camera image. Recent research estimates time-to-contact in a per-pixel manner and suggests that it is more effective measure than velocity and depth combined. However, per-pixel time-to-contact requires object detection to serve its purpose effectively and hence increases overall computational requirements as two different models need to run. To address this issue, we propose per-object time-to-contact estimation by extending object detection models to additionally predict the time-to-contact attribute for each object. We compare our proposed approach with existing time-to-contact methods and provide benchmarking results on well-known datasets. Our proposed approach achieves higher precision compared to prior art while using a single image.