Decoding Emotions in Abstract Art: Cognitive Plausibility of CLIP in Recognizing Color-Emotion Associations

作者: Hanna-Sophia Widhoelzl, Ece Takmaz

分类: cs.CV, cs.CL

发布日期: 2024-05-10

备注: To appear in the Proceedings of the Annual Meeting of the Cognitive Science Society 2024

💡 一句话要点

评估CLIP在抽象艺术情感识别中的认知合理性,揭示机器与人类情感理解的差异

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 抽象艺术 情感识别 CLIP模型 多模态学习 认知合理性

📋 核心要点

- 现有方法难以准确理解抽象艺术中的情感表达,缺乏对人类认知过程的模拟。

- 本研究利用CLIP模型,通过分析图像、文本解释和颜色关联,评估其情感识别的认知合理性。

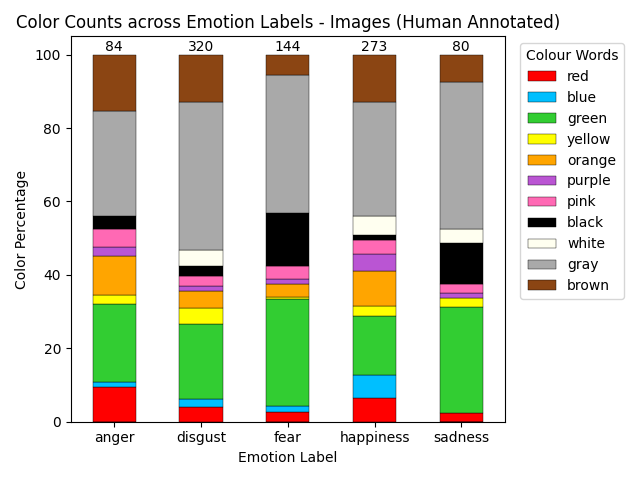

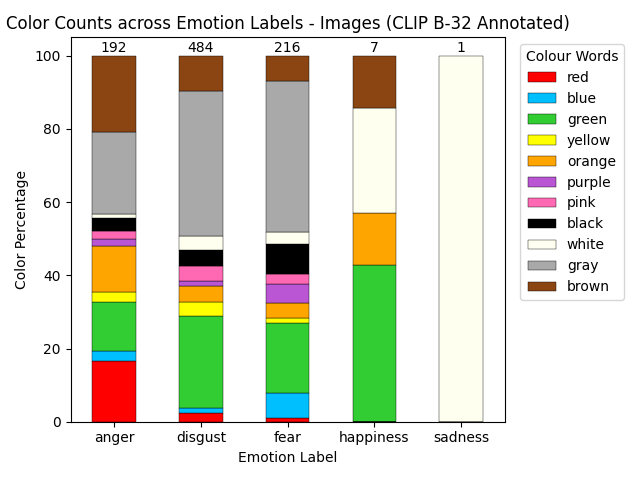

- 实验结果表明,CLIP在抽象艺术情感识别上与人类认知存在差异,但能捕捉到颜色-情感的基本关联。

📝 摘要(中文)

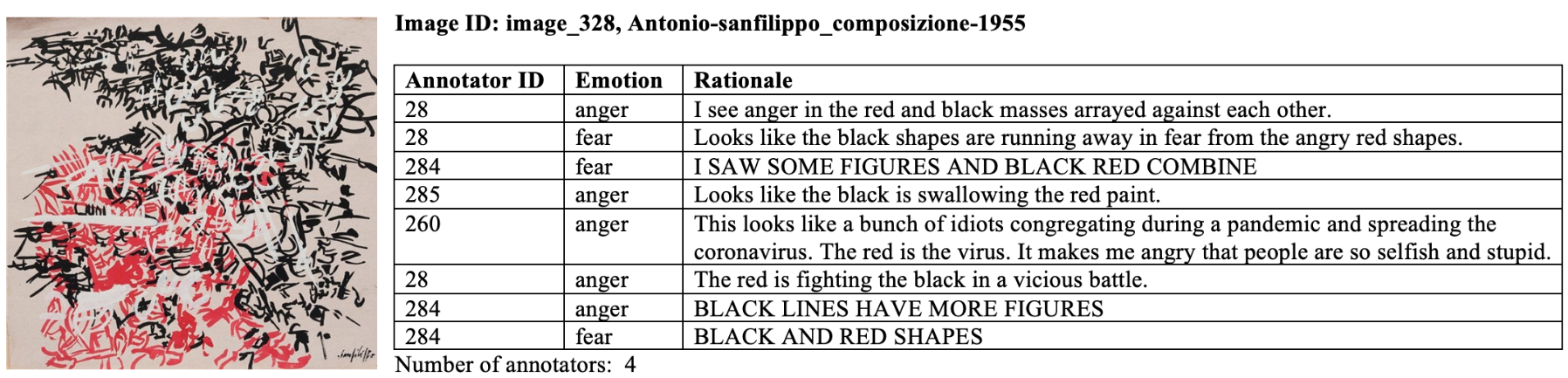

本研究旨在探讨预训练多模态模型CLIP在识别抽象视觉艺术所唤起的情感方面的认知合理性。我们使用包含图像及其相关情感标签的数据集,以及人类标注者提供的标签文本解释。我们对解释文本进行语言分析,对图像和解释文本进行零样本情感分类,应用基于相似性的情感预测,并研究颜色-情感关联。结果表明,CLIP在识别抽象图像和解释文本情感方面的准确率相对较低,但高于基线水平,这表明CLIP解码情感复杂性的方式与人类认知过程不太一致。此外,我们探索了图像和解释文本中的颜色-情感交互。在人类和CLIP标注的情感标签图像和文本中,都识别出了预期的颜色-情感关联,例如红色与愤怒相关,后者甚至表现出更强的交互。我们的结果突出了在连接图像特征和情感时,人类处理和机器处理之间的差异。

🔬 方法详解

问题定义:论文旨在研究预训练模型CLIP在理解抽象艺术作品中所蕴含情感的认知合理性。现有方法在处理抽象艺术的情感识别时,往往缺乏对人类认知过程的模拟,难以准确捕捉图像中的细微情感信息,并且缺乏对颜色-情感关联的深入分析。

核心思路:论文的核心思路是利用CLIP模型的多模态特性,同时分析抽象艺术图像和人类对这些图像情感的文本解释,从而评估CLIP在情感识别方面与人类认知的一致性。通过比较CLIP和人类在颜色-情感关联上的表现,揭示两者在情感理解上的差异。

技术框架:整体框架包括以下几个主要步骤:1) 数据集构建:使用包含抽象艺术图像、情感标签和人类文本解释的数据集。2) 语言分析:对人类提供的文本解释进行语言分析,提取关键情感词汇。3) 零样本情感分类:使用CLIP对图像和文本解释进行零样本情感分类,预测情感标签。4) 相似性预测:基于图像和文本的相似性,预测情感标签。5) 颜色-情感关联分析:分析图像和文本中颜色与情感之间的关联。

关键创新:本研究的关键创新在于:1) 将CLIP模型应用于抽象艺术的情感识别,探索其认知合理性。2) 结合图像和文本解释,综合评估CLIP的情感理解能力。3) 深入分析颜色-情感关联,揭示机器和人类在情感理解上的差异。

关键设计:在颜色-情感关联分析中,论文可能采用了统计方法,例如计算不同颜色在不同情感标签下的出现频率,并使用卡方检验等方法评估颜色和情感之间的关联强度。具体的损失函数和网络结构取决于CLIP模型本身的预训练设置,论文主要关注如何利用CLIP的现有能力进行情感分析。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CLIP在识别抽象图像和解释文本情感方面的准确率高于基线水平,但与人类认知存在显著差异。CLIP能够捕捉到颜色-情感的基本关联,例如红色与愤怒相关,但其关联强度甚至超过了人类的认知。这些结果揭示了机器和人类在情感理解上的差异,为进一步研究情感计算提供了重要参考。

🎯 应用场景

该研究成果可应用于情感计算、人机交互和艺术创作等领域。通过深入理解机器对艺术作品情感的认知方式,可以开发更智能的情感识别系统,提升人机交互的自然性和情感表达能力。此外,该研究还可以为艺术家提供新的创作灵感,探索机器辅助艺术创作的可能性。

📄 摘要(原文)

This study investigates the cognitive plausibility of a pretrained multimodal model, CLIP, in recognizing emotions evoked by abstract visual art. We employ a dataset comprising images with associated emotion labels and textual rationales of these labels provided by human annotators. We perform linguistic analyses of rationales, zero-shot emotion classification of images and rationales, apply similarity-based prediction of emotion, and investigate color-emotion associations. The relatively low, yet above baseline, accuracy in recognizing emotion for abstract images and rationales suggests that CLIP decodes emotional complexities in a manner not well aligned with human cognitive processes. Furthermore, we explore color-emotion interactions in images and rationales. Expected color-emotion associations, such as red relating to anger, are identified in images and texts annotated with emotion labels by both humans and CLIP, with the latter showing even stronger interactions. Our results highlight the disparity between human processing and machine processing when connecting image features and emotions.