A Mixture of Experts Approach to 3D Human Motion Prediction

作者: Edmund Shieh, Joshua Lee Franco, Kang Min Bae, Tej Lalvani

分类: cs.CV

发布日期: 2024-05-09

备注: 16 pages, 6 figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于混合专家模型的3D人体运动预测方法,加速实时推理。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 人体运动预测 混合专家模型 时空Transformer 实时推理 深度学习

📋 核心要点

- 现有方法在人体运动预测中难以兼顾精度与实时性,尤其是在计算资源受限的情况下。

- 论文提出将混合专家(MoE)模块融入时空Transformer,旨在提升模型容量的同时降低推理成本。

- 通过Soft MoE这种可微稀疏Transformer变体,期望在保证预测精度的前提下,显著加速实时推理。

📝 摘要(中文)

本项目旨在解决人体运动预测这一难题,该技术对于自动驾驶车辆运动检测等应用至关重要。以往的研究强调低推理时间以实现实时性能。我们的主要目标是严格评估现有的模型架构,通过尽可能地复现最先进的(SOTA)时空Transformer模型,来识别它们的优势和改进机会,同时考虑计算约束。这些模型已经超越了基于RNN的模型的局限性,并且已经证明了通过使用时空表示来生成短期和长期范围内合理的运动序列的能力。我们还提出了一种新颖的架构,通过在时空(ST)注意力层中加入混合专家(MoE)块来解决实时推理速度的挑战。这里使用的特定变体是Soft MoE,这是一种完全可微的稀疏Transformer,它已显示出在较低的推理成本下实现更大模型容量的有希望的能力。我们的代码已在https://github.com/edshieh/motionprediction上公开。

🔬 方法详解

问题定义:人体运动预测旨在根据过去一段时间的人体运动轨迹,预测未来一段时间的运动轨迹。现有方法,特别是基于RNN的模型,在长期预测中存在误差累积问题。而Transformer模型虽然在精度上有所提升,但计算复杂度较高,难以满足实时性要求,尤其是在资源受限的场景下。

核心思路:论文的核心思路是将混合专家(MoE)模型引入到时空Transformer中。MoE模型通过多个“专家”网络并行处理输入,并使用一个“门控”网络来动态选择或组合这些专家的输出。这种结构可以在不显著增加推理时间的情况下,提升模型的容量和表达能力。

技术框架:该方法基于时空Transformer架构,并在其空间-时间注意力层中引入MoE模块。整体流程为:首先,输入过去一段时间的人体运动数据;然后,通过时空Transformer进行特征提取和表示学习;接着,在注意力层利用MoE模块进行更精细的特征处理;最后,输出未来一段时间的运动预测结果。

关键创新:关键创新在于将Soft MoE这种完全可微的稀疏Transformer变体引入到人体运动预测任务中。Soft MoE允许模型在推理时动态地选择激活部分专家,从而降低计算量,提高推理速度。与传统的MoE相比,Soft MoE是完全可微的,更易于训练。

关键设计:论文采用Soft MoE,它使用一个门控网络来为每个专家分配权重,这些权重是连续的,并且所有专家的权重之和为1。通过引入稀疏性约束,例如L1正则化,可以鼓励门控网络只选择少数几个专家进行激活。损失函数包括运动预测损失(例如,均方误差)和稀疏性损失。具体的网络结构和参数设置需要在实验中进行调整和优化。

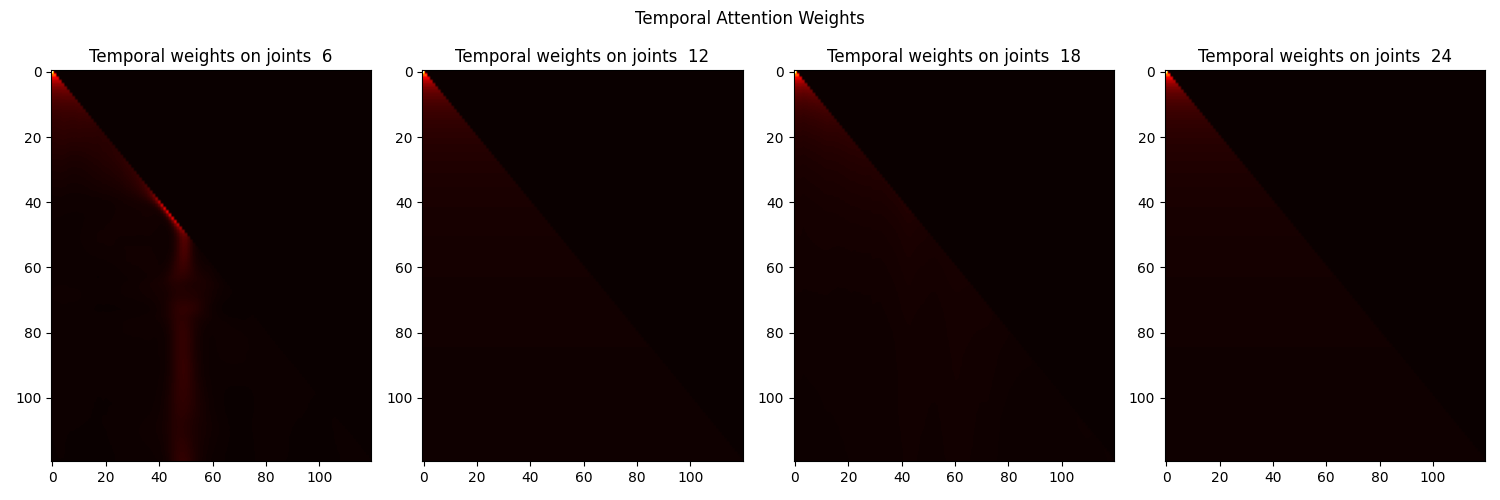

🖼️ 关键图片

📊 实验亮点

论文重点在于提出了一种新的模型架构,通过在时空注意力层中引入混合专家(MoE)块来解决实时推理速度的挑战。虽然摘要中没有明确给出具体的性能数据和提升幅度,但强调了Soft MoE在降低推理成本的同时,实现更大模型容量的潜力。未来的工作应该包含与现有SOTA模型在精度和推理速度上的详细对比实验。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、虚拟现实、游戏等领域。在自动驾驶中,准确的人体运动预测可以帮助车辆更好地理解周围环境,预测行人的行为,从而提高行驶安全性。在机器人领域,该技术可以用于机器人与人的协同工作,使机器人能够预测人的动作,并做出相应的反应。在VR和游戏中,可以生成更真实、自然的虚拟人物动作。

📄 摘要(原文)

This project addresses the challenge of human motion prediction, a critical area for applications such as au- tonomous vehicle movement detection. Previous works have emphasized the need for low inference times to provide real time performance for applications like these. Our primary objective is to critically evaluate existing model ar- chitectures, identifying their advantages and opportunities for improvement by replicating the state-of-the-art (SOTA) Spatio-Temporal Transformer model as best as possible given computational con- straints. These models have surpassed the limitations of RNN-based models and have demonstrated the ability to generate plausible motion sequences over both short and long term horizons through the use of spatio-temporal rep- resentations. We also propose a novel architecture to ad- dress challenges of real time inference speed by incorpo- rating a Mixture of Experts (MoE) block within the Spatial- Temporal (ST) attention layer. The particular variation that is used is Soft MoE, a fully-differentiable sparse Transformer that has shown promising ability to enable larger model capacity at lower inference cost. We make out code publicly available at https://github.com/edshieh/motionprediction