Multi-Modal Data-Efficient 3D Scene Understanding for Autonomous Driving

作者: Lingdong Kong, Xiang Xu, Jiawei Ren, Wenwei Zhang, Liang Pan, Kai Chen, Wei Tsang Ooi, Ziwei Liu

分类: cs.CV, cs.LG, cs.RO

发布日期: 2024-05-08 (更新: 2025-12-05)

备注: IEEE Transactions on Pattern Analysis and Machine Intelligence (TPAMI)

DOI: 10.1109/TPAMI.2025.3535625

💡 一句话要点

提出LaserMix++框架,利用多模态数据高效提升自动驾驶3D场景理解能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D场景理解 自动驾驶 半监督学习 多模态融合 LiDAR语义分割

📋 核心要点

- 现有3D场景理解方法依赖大量人工标注LiDAR数据,成本高昂且效率低下,限制了其在自动驾驶领域的应用。

- LaserMix++框架通过融合多模态信息,利用激光束操作、相机-LiDAR特征蒸馏和语言知识指导,提升数据利用效率。

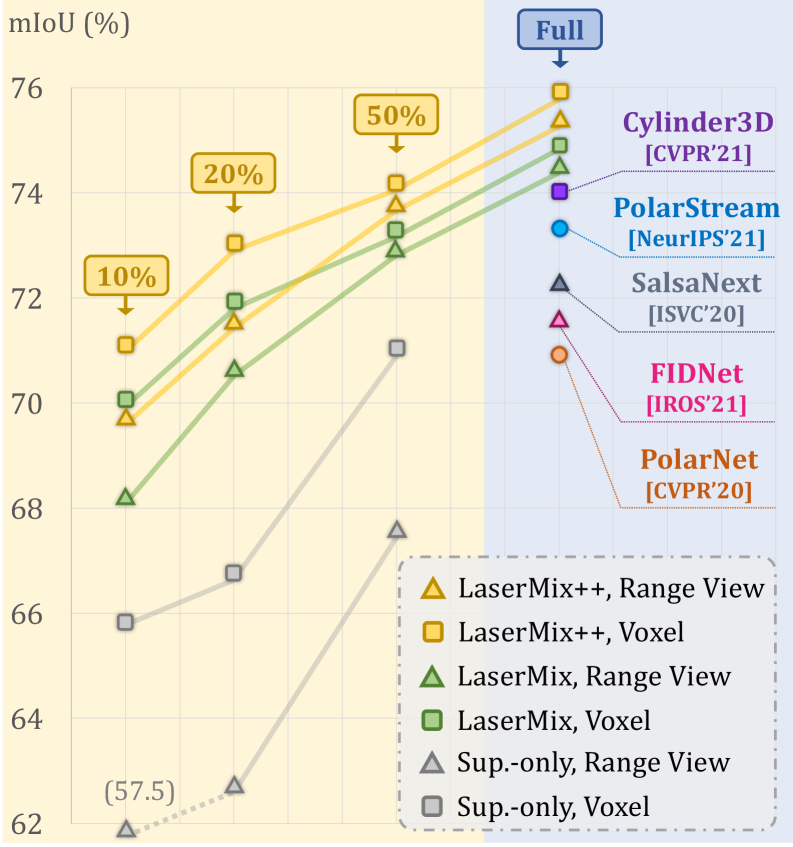

- 实验表明,LaserMix++在仅使用五分之一标注数据的情况下,性能可与全监督方法媲美,显著提升了基线性能。

📝 摘要(中文)

在自动驾驶领域,3D场景理解对大量人工标注的LiDAR点云数据存在依赖。为解决这一问题,本研究扩展了LiDAR语义分割的半监督学习方法,利用驾驶场景的内在空间先验和多传感器互补性来增强未标注数据集的有效性。我们提出了LaserMix++框架,它整合了来自不同LiDAR扫描的激光束操作,并结合了LiDAR-相机对应关系,以进一步辅助数据高效学习。该框架通过融合多模态信息来增强3D场景一致性正则化,包括:1) 用于细粒度跨传感器交互的多模态LaserMix操作;2) 增强LiDAR特征学习的相机到LiDAR特征蒸馏;3) 利用开放词汇模型生成辅助监督的语言驱动知识指导。LaserMix++的通用性使其能够应用于各种LiDAR表示。通过理论分析和在流行驾驶感知数据集上的大量实验验证,结果表明LaserMix++显著优于全监督方法,在标注数据减少五倍的情况下实现了相当的精度,并显著提高了仅使用监督学习的基线性能。这一重大进展突显了半监督方法在减少对基于LiDAR的3D场景理解系统中大量标注数据依赖的潜力。

🔬 方法详解

问题定义:论文旨在解决自动驾驶场景下,3D场景理解任务对大量标注LiDAR点云数据的依赖问题。现有全监督方法需要耗费大量人力物力进行数据标注,限制了其在实际应用中的推广。

核心思路:论文的核心思路是利用半监督学习方法,通过多模态数据融合和知识迁移,充分挖掘未标注数据的潜力,从而减少对标注数据的依赖。具体而言,利用相机图像和语言信息作为辅助,指导LiDAR特征的学习,提高模型的泛化能力。

技术框架:LaserMix++框架主要包含三个模块:1) 多模态LaserMix操作,用于在LiDAR和相机数据之间进行细粒度的交叉融合;2) 相机到LiDAR的特征蒸馏,利用相机图像的语义信息指导LiDAR特征的学习;3) 语言驱动的知识指导,利用开放词汇模型生成辅助监督信号,进一步提升模型的性能。整体流程是先通过多模态融合增强数据,然后利用蒸馏和知识指导进行模型训练。

关键创新:论文的关键创新在于提出了一个统一的多模态半监督学习框架,该框架能够有效地融合LiDAR、相机和语言信息,从而显著提升3D场景理解的性能。与现有方法相比,LaserMix++更加注重多模态信息的协同作用,能够更好地利用未标注数据。

关键设计:在多模态LaserMix操作中,论文设计了一种新的数据增强方法,通过混合不同LiDAR扫描的激光束,生成新的训练样本。在特征蒸馏中,论文采用了一种基于注意力机制的蒸馏方法,能够更有效地将相机图像的语义信息迁移到LiDAR特征中。在语言知识指导中,论文利用CLIP模型生成文本描述,并将其作为辅助监督信号。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LaserMix++在nuScenes和SemanticKITTI数据集上取得了显著的性能提升。在nuScenes数据集上,使用五分之一的标注数据,LaserMix++的性能可与全监督方法媲美。在SemanticKITTI数据集上,LaserMix++显著提高了基线模型的性能,证明了其在半监督学习方面的有效性。

🎯 应用场景

该研究成果可广泛应用于自动驾驶、机器人导航、智能交通等领域。通过减少对大量标注数据的依赖,可以降低3D场景理解系统的开发成本,加速相关技术的落地应用。未来,该方法有望应用于更复杂的场景和任务,例如自动驾驶中的目标检测、跟踪和行为预测等。

📄 摘要(原文)

Efficient data utilization is crucial for advancing 3D scene understanding in autonomous driving, where reliance on heavily human-annotated LiDAR point clouds challenges fully supervised methods. Addressing this, our study extends into semi-supervised learning for LiDAR semantic segmentation, leveraging the intrinsic spatial priors of driving scenes and multi-sensor complements to augment the efficacy of unlabeled datasets. We introduce LaserMix++, an evolved framework that integrates laser beam manipulations from disparate LiDAR scans and incorporates LiDAR-camera correspondences to further assist data-efficient learning. Our framework is tailored to enhance 3D scene consistency regularization by incorporating multi-modality, including 1) multi-modal LaserMix operation for fine-grained cross-sensor interactions; 2) camera-to-LiDAR feature distillation that enhances LiDAR feature learning; and 3) language-driven knowledge guidance generating auxiliary supervisions using open-vocabulary models. The versatility of LaserMix++ enables applications across LiDAR representations, establishing it as a universally applicable solution. Our framework is rigorously validated through theoretical analysis and extensive experiments on popular driving perception datasets. Results demonstrate that LaserMix++ markedly outperforms fully supervised alternatives, achieving comparable accuracy with five times fewer annotations and significantly improving the supervised-only baselines. This substantial advancement underscores the potential of semi-supervised approaches in reducing the reliance on extensive labeled data in LiDAR-based 3D scene understanding systems.