Radar Fields: Frequency-Space Neural Scene Representations for FMCW Radar

作者: David Borts, Erich Liang, Tim Brödermann, Andrea Ramazzina, Stefanie Walz, Edoardo Palladin, Jipeng Sun, David Bruggemann, Christos Sakaridis, Luc Van Gool, Mario Bijelic, Felix Heide

分类: cs.CV

发布日期: 2024-05-07 (更新: 2024-05-09)

备注: 8 pages, 6 figures, to be published in SIGGRAPH 2024

💡 一句话要点

提出Radar Fields,用于FMCW雷达的频域神经场景表示,实现恶劣天气下的场景重建。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 雷达 神经场 场景重建 频域学习 FMCW雷达

📋 核心要点

- 现有神经重建方法主要集中于RGB和LiDAR数据,缺乏对雷达数据的有效处理,尤其是在恶劣天气下的场景重建。

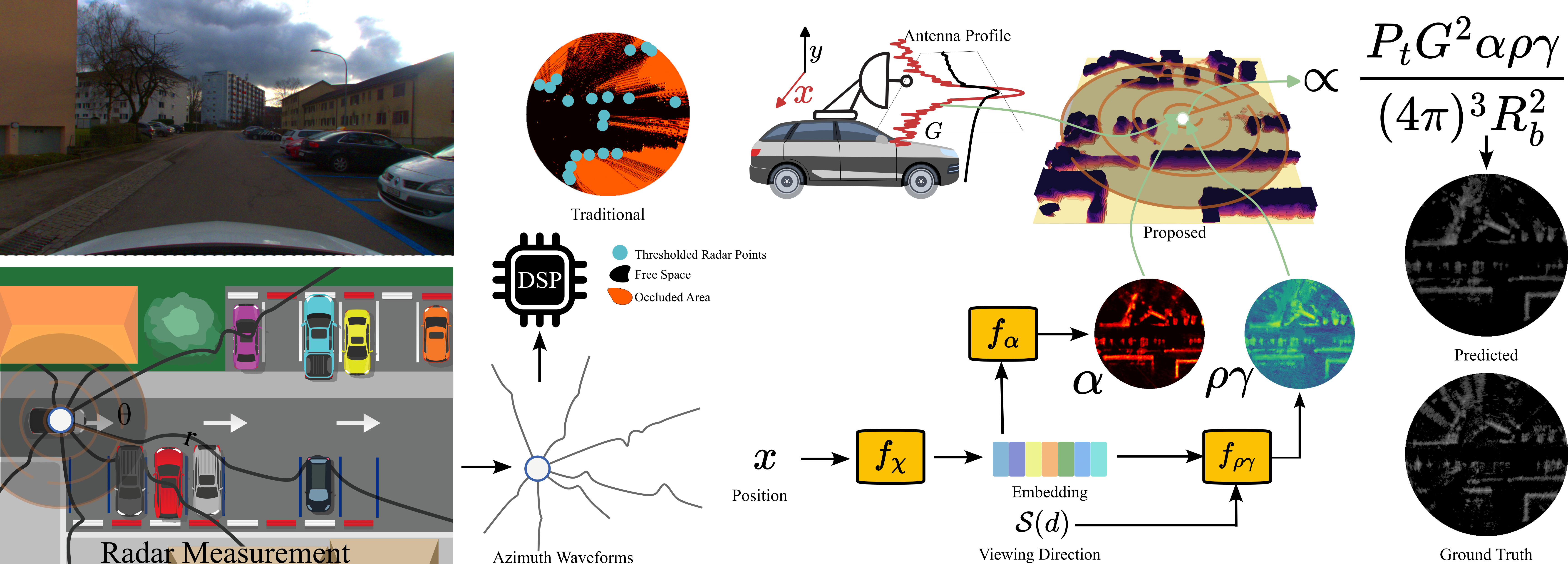

- Radar Fields结合了显式的物理传感器模型和隐式的神经几何与反射模型,直接从原始雷达数据合成测量结果并提取场景占用。

- 该方法在各种室外场景中进行了验证,包括城市环境和恶劣天气,证明了其在毫米波雷达传感方面的有效性。

📝 摘要(中文)

神经场已被广泛研究作为场景表示,用于再现和生成各种室外场景,包括自动驾驶车辆和机器人必须处理的场景。虽然RGB和LiDAR数据已经有成功的方法,但雷达作为一种传感方式的神经重建方法在很大程度上尚未被探索。雷达传感器以毫米波长工作,对雾和雨中的散射具有鲁棒性,因此,为主动和被动光学传感技术提供了一种互补的方式。此外,现有的雷达传感器具有很高的成本效益,并广泛部署在户外工作的机器人和车辆中。我们介绍Radar Fields——一种为主动雷达成像仪设计的神经场景重建方法。我们的方法将显式的、基于物理的传感器模型与隐式的神经几何和反射模型相结合,以直接合成原始雷达测量并提取场景占用。所提出的方法不依赖于体渲染。相反,我们在傅里叶频域中学习场,并用原始雷达数据进行监督。我们在各种室外场景中验证了该方法的有效性,包括具有密集车辆和基础设施的城市场景,以及毫米波长传感特别有利的恶劣天气场景。

🔬 方法详解

问题定义:论文旨在解决利用主动雷达数据进行场景重建的问题。现有方法主要集中于RGB和LiDAR数据,忽略了雷达在恶劣天气条件下的优势。因此,如何有效地利用雷达数据,特别是FMCW雷达的原始数据,进行准确的场景重建是一个挑战。现有方法无法直接处理雷达的原始数据,需要复杂的预处理步骤,并且难以建模雷达信号的物理特性。

核心思路:Radar Fields的核心思路是将场景表示为频域中的神经场,并利用物理信息指导的传感器模型来合成原始雷达测量数据。通过在傅里叶空间中学习场,可以更有效地捕捉雷达信号的全局结构和频率特性。这种方法避免了传统的体渲染,而是直接在频域中进行学习和推理,从而提高了效率和准确性。

技术框架:Radar Fields的整体框架包括以下几个主要模块:1) 显式的、基于物理的传感器模型,用于模拟雷达信号的传播和反射;2) 隐式的神经几何和反射模型,用于表示场景的几何形状和反射特性;3) 频域学习模块,用于在傅里叶空间中学习场景表示;4) 损失函数,用于监督学习过程,使合成的雷达测量数据与真实的雷达数据尽可能接近。整个流程通过优化神经场的参数,使得合成的雷达数据能够准确地反映场景的结构和特性。

关键创新:Radar Fields的关键创新在于将神经场表示与雷达传感器的物理模型相结合,并在频域中进行学习。这种方法能够直接处理原始雷达数据,避免了复杂的预处理步骤,并且能够更好地捕捉雷达信号的物理特性。此外,该方法不依赖于体渲染,而是直接在频域中进行学习和推理,从而提高了效率和准确性。

关键设计:Radar Fields的关键设计包括:1) 使用傅里叶特征来表示场景的几何形状和反射特性;2) 设计一个基于物理的传感器模型,用于模拟雷达信号的传播和反射;3) 使用均方误差(MSE)损失函数来监督学习过程,使合成的雷达测量数据与真实的雷达数据尽可能接近;4) 使用多层感知机(MLP)来学习频域中的神经场表示。

🖼️ 关键图片

📊 实验亮点

论文在各种室外场景中验证了Radar Fields的有效性,包括城市环境和恶劣天气。实验结果表明,该方法能够准确地重建场景的几何形状和反射特性,并且在恶劣天气条件下的性能优于现有的方法。具体性能数据未知,但论文强调了在城市和恶劣天气场景下的有效性。

🎯 应用场景

Radar Fields在自动驾驶、机器人导航、环境感知等领域具有广泛的应用前景。尤其是在恶劣天气条件下,如雾、雨、雪等,雷达传感器能够提供可靠的环境信息,从而提高系统的鲁棒性和安全性。该研究成果有助于推动雷达感知技术的发展,并为未来的智能系统提供更可靠的感知能力。

📄 摘要(原文)

Neural fields have been broadly investigated as scene representations for the reproduction and novel generation of diverse outdoor scenes, including those autonomous vehicles and robots must handle. While successful approaches for RGB and LiDAR data exist, neural reconstruction methods for radar as a sensing modality have been largely unexplored. Operating at millimeter wavelengths, radar sensors are robust to scattering in fog and rain, and, as such, offer a complementary modality to active and passive optical sensing techniques. Moreover, existing radar sensors are highly cost-effective and deployed broadly in robots and vehicles that operate outdoors. We introduce Radar Fields - a neural scene reconstruction method designed for active radar imagers. Our approach unites an explicit, physics-informed sensor model with an implicit neural geometry and reflectance model to directly synthesize raw radar measurements and extract scene occupancy. The proposed method does not rely on volume rendering. Instead, we learn fields in Fourier frequency space, supervised with raw radar data. We validate the effectiveness of the method across diverse outdoor scenarios, including urban scenes with dense vehicles and infrastructure, and in harsh weather scenarios, where mm-wavelength sensing is especially favorable.