Diff-IP2D: Diffusion-Based Hand-Object Interaction Prediction on Egocentric Videos

作者: Junyi Ma, Jingyi Xu, Xieyuanli Chen, Hesheng Wang

分类: cs.CV

发布日期: 2024-05-07 (更新: 2025-11-14)

备注: Accepted to IROS 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出Diff-IP2D,利用扩散模型预测第一视角视频中的手-物交互,解决单向预测误差累积问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱六:视频提取与匹配 (Video Extraction) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 手-物交互预测 扩散模型 第一人称视角 视频预测 运动特征 非自回归 条件生成

📋 核心要点

- 现有手-物交互预测方法采用自回归单向预测,易累积误差,且忽略了相机运动的影响。

- Diff-IP2D利用扩散模型,通过非自回归方式迭代预测未来交互特征,并融入运动特征感知相机动态。

- 实验表明,Diff-IP2D在手-物交互预测任务上显著优于现有方法,验证了生成范式的有效性。

📝 摘要(中文)

本文提出了一种基于扩散模型的手-物交互预测方法Diff-IP2D,用于预测以人为中心的视频中未来的手部轨迹和物体可供性。现有方法主要采用自回归范式进行单向预测,缺乏整体未来序列内的相互约束,并沿时间轴累积误差,同时忽略了相机自身运动对第一人称视角预测的影响。Diff-IP2D通过迭代的非自回归方式,并发预测未来的手部轨迹和物体可供性。该方法将连续的2D图像转换为潜在特征空间,并设计了一个去噪扩散模型,以预测以过去特征为条件的未来潜在交互特征。运动特征被进一步整合到条件去噪过程中,使Diff-IP2D能够感知相机佩戴者的动态,从而实现更准确的交互预测。大量实验表明,该方法在现有指标和新提出的评估协议上均显著优于最先进的基线方法,突出了利用生成范式进行2D手-物交互预测的有效性。

🔬 方法详解

问题定义:现有方法在预测第一人称视角下的手-物交互时,主要采用自回归模型,这导致两个主要问题:一是单向预测过程中,未来序列缺乏相互约束,容易累积误差;二是忽略了相机自身运动对预测结果的影响,降低了预测精度。因此,需要一种能够克服这些限制的方法,以更准确地预测未来的手部轨迹和物体可供性。

核心思路:Diff-IP2D的核心思路是利用扩散模型生成未来交互特征,而非像传统方法那样进行自回归预测。扩散模型通过逐步去噪的方式,能够更好地捕捉数据分布,从而生成更真实、更连贯的未来交互序列。此外,该方法还考虑了相机运动的影响,通过将运动特征融入到条件去噪过程中,使模型能够感知相机佩戴者的动态,从而提高预测精度。

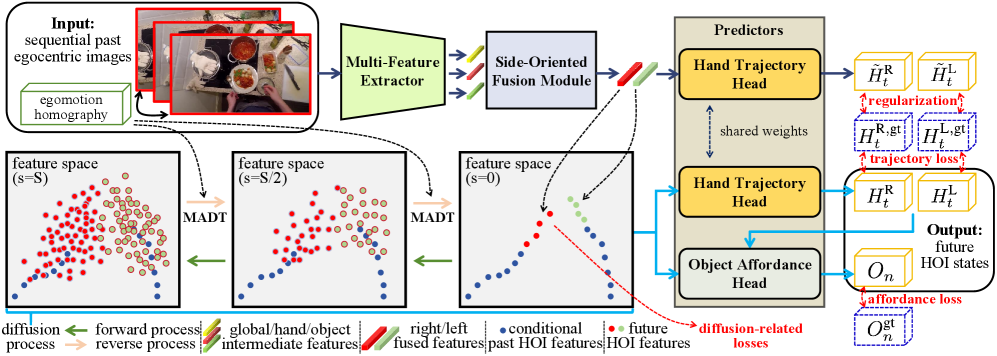

技术框架:Diff-IP2D的整体框架包括以下几个主要模块:1) 特征提取模块:将连续的2D图像转换为潜在特征空间;2) 扩散模型:设计一个去噪扩散模型,以预测以过去特征为条件的未来潜在交互特征;3) 运动特征融合模块:将运动特征整合到条件去噪过程中,使模型能够感知相机佩戴者的动态;4) 预测模块:将生成的潜在特征解码为手部轨迹和物体可供性。整个流程是非自回归的,通过迭代的方式逐步优化预测结果。

关键创新:Diff-IP2D的关键创新在于以下几点:1) 采用扩散模型进行手-物交互预测,克服了自回归模型的误差累积问题;2) 考虑了相机运动的影响,通过融合运动特征提高了预测精度;3) 提出了新的评估协议,更全面地评估了手-物交互预测的性能。与现有方法的本质区别在于,Diff-IP2D是一种生成式方法,而现有方法大多是判别式或自回归方法。

关键设计:在扩散模型的设计上,采用了条件去噪扩散模型,以过去特征作为条件,指导未来特征的生成。运动特征通过concat的方式融入到去噪过程中。损失函数包括扩散模型的标准损失函数,以及手部轨迹和物体可供性的预测损失。网络结构方面,采用了U-Net作为扩散模型的backbone,并针对手-物交互预测任务进行了优化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Diff-IP2D在手-物交互预测任务上显著优于现有方法。在HOI4D数据集上,Diff-IP2D在手部轨迹预测和物体可供性预测方面均取得了显著的提升。此外,Diff-IP2D在新提出的评估协议上也表现出色,验证了其在复杂场景下的泛化能力。具体性能数据请参考论文原文。

🎯 应用场景

Diff-IP2D在服务机器人操作和扩展现实等领域具有广泛的应用前景。例如,在服务机器人中,它可以帮助机器人预测人类的意图,从而更安全、更有效地与人类进行交互。在扩展现实中,它可以用于创建更逼真的虚拟环境,使用户能够与虚拟物体进行更自然的交互。该研究的未来影响在于,它可以推动人机交互技术的发展,使人机交互更加智能、自然和高效。

📄 摘要(原文)

Understanding how humans would behave during hand-object interaction is vital for applications in service robot manipulation and extended reality. To achieve this, some recent works have been proposed to simultaneously forecast hand trajectories and object affordances on human egocentric videos. The joint prediction serves as a comprehensive representation of future hand-object interactions in 2D space, indicating potential human motion and motivation. However, the existing approaches mostly adopt the autoregressive paradigm for unidirectional prediction, which lacks mutual constraints within the holistic future sequence, and accumulates errors along the time axis. Meanwhile, these works basically overlook the effect of camera egomotion on first-person view predictions. To address these limitations, we propose a novel diffusion-based interaction prediction method, namely Diff-IP2D, to forecast future hand trajectories and object affordances concurrently in an iterative non-autoregressive manner. We transform the sequential 2D images into latent feature space and design a denoising diffusion model to predict future latent interaction features conditioned on past ones. Motion features are further integrated into the conditional denoising process to enable Diff-IP2D aware of the camera wearer's dynamics for more accurate interaction prediction. Extensive experiments demonstrate that our method significantly outperforms the state-of-the-art baselines on both the off-the-shelf metrics and our newly proposed evaluation protocol. This highlights the efficacy of leveraging a generative paradigm for 2D hand-object interaction prediction. The code of Diff-IP2D is released as open source at https://github.com/IRMVLab/Diff-IP2D.