Mapping the Unseen: Unified Promptable Panoptic Mapping with Dynamic Labeling using Foundation Models

作者: Mohamad Al Mdfaa, Raghad Salameh, Geesara Kulathunga, Sergey Zagoruyko, Gonzalo Ferrer

分类: cs.CV, cs.AI, cs.RO

发布日期: 2024-05-03 (更新: 2026-02-03)

期刊: Robotics, vol. 15, no. 2, article 31, 2026

💡 一句话要点

UPPM:利用动态标签和基础模型实现统一的可Prompt全景地图构建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 全景地图构建 开放词汇分割 基础模型 动态标签 语义检索 机器人导航 场景理解

📋 核心要点

- 现有开放词汇全景地图构建方法易产生冗余标签,导致全景实体分割错误和体素一致性下降。

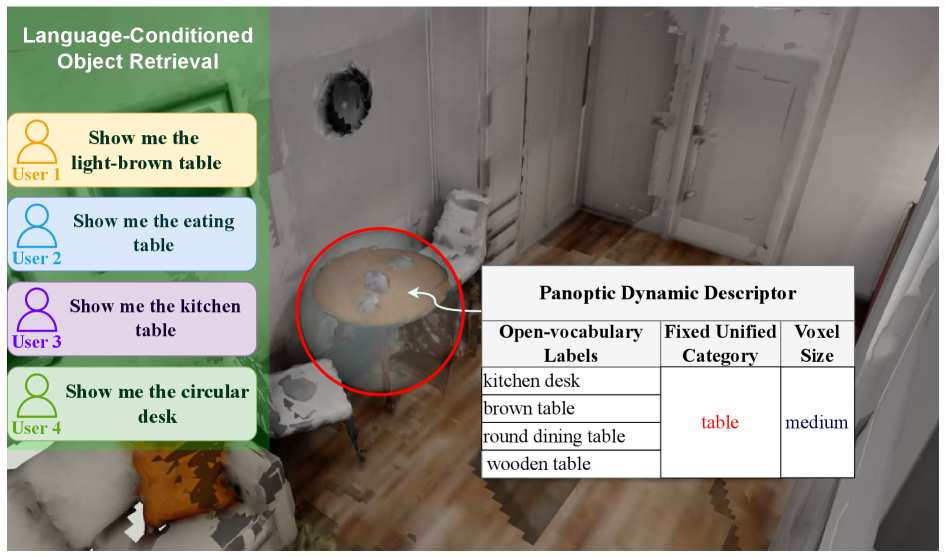

- UPPM提出一种全景动态描述符,融合开放词汇标签与统一类别结构和几何先验,提升地图质量。

- 实验表明,UPPM在地图重建精度和全景分割质量上均优于现有方法,且无需额外模型训练。

📝 摘要(中文)

全景地图使机器人能够推理几何和语义信息。然而,开放词汇模型经常产生密切相关的标签,分割全景实体并降低体素一致性。本文提出的UPPM通过利用基础模型引入全景动态描述符来推进开放世界场景理解,该描述符将开放词汇标签与统一的类别结构和几何尺寸先验相协调。这种动态描述符的融合是在多分辨率多TSDF地图中使用语言引导的开放词汇全景分割和语义检索来执行的,从而产生持久且可Prompt的全景地图,而无需额外的模型训练。基于我们的评估实验,UPPM在地图重建精度和全景分割质量方面表现出最佳的整体性能。消融研究调查了UPPM的每个组成部分(自定义NMS、模糊帧过滤和统一语义)对整体系统性能的贡献。因此,UPPM在保持开放词汇可解释性的同时,提供了强大的几何和全景精度。

🔬 方法详解

问题定义:现有开放词汇全景地图构建方法的主要问题在于,开放词汇模型会产生大量语义上相似但标签不同的结果,导致同一物理实体被分割成多个部分,降低了地图的几何一致性和语义准确性。此外,缺乏对物体大小和形状的先验知识也限制了地图的质量。

核心思路:UPPM的核心思路是利用基础模型强大的语义理解能力,将开放词汇模型产生的冗余标签进行统一,并结合几何先验知识,生成一个更准确、更一致的全景地图。通过引入“全景动态描述符”,将开放词汇标签与统一的类别结构和几何尺寸先验相协调,从而解决标签冗余和分割不一致的问题。

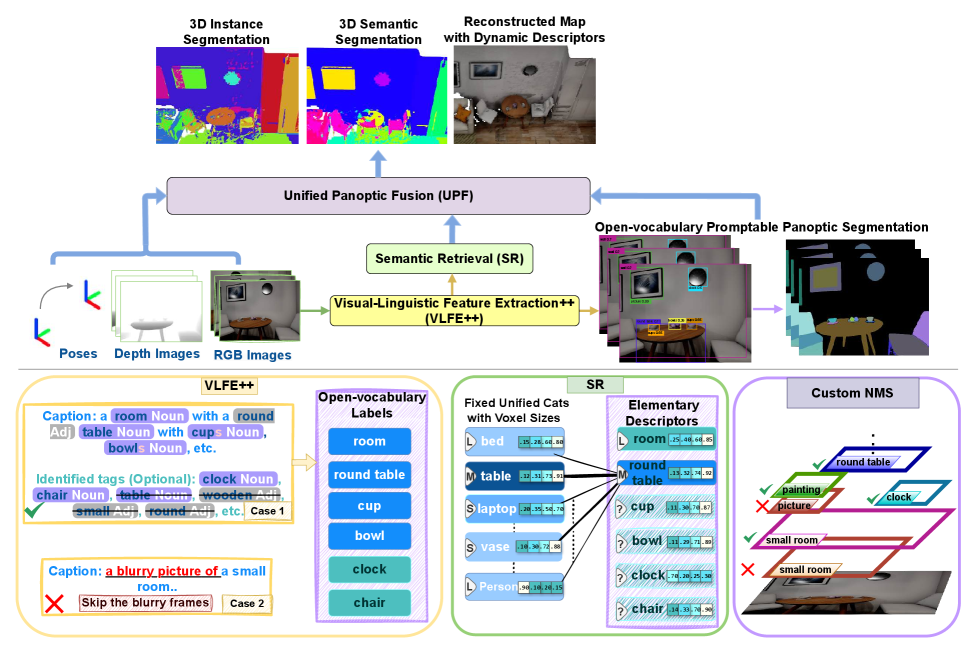

技术框架:UPPM的整体框架包括以下几个主要模块:1) 语言引导的开放词汇全景分割:利用预训练的开放词汇分割模型,对输入图像进行分割,并生成初始的语义标签。2) 语义检索:使用语义检索技术,将相似的语义标签进行聚类,减少标签冗余。3) 全景动态描述符融合:将聚类后的语义标签与几何先验知识融合,生成全景动态描述符。4) 多分辨率多TSDF地图构建:利用全景动态描述符,在多分辨率TSDF地图中进行融合,构建最终的全景地图。

关键创新:UPPM的关键创新在于引入了“全景动态描述符”,它能够将开放词汇标签与统一的类别结构和几何尺寸先验相协调。这种动态描述符能够有效地解决开放词汇模型产生的标签冗余问题,并提高地图的几何一致性和语义准确性。此外,UPPM还采用了语言引导的开放词汇全景分割和语义检索技术,进一步提升了地图的质量。

关键设计:UPPM的关键设计包括:1) 自定义NMS(非极大值抑制):用于抑制冗余的分割结果,提高分割精度。2) 模糊帧过滤:用于过滤掉模糊的图像帧,提高地图的几何精度。3) 统一语义:使用语义检索技术,将相似的语义标签进行聚类,减少标签冗余。此外,UPPM还采用了多分辨率TSDF地图,能够在不同尺度上对场景进行建模,提高地图的鲁棒性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,UPPM在地图重建精度和全景分割质量方面均优于现有方法。具体来说,UPPM在重建精度方面取得了显著提升,并且在全景分割质量方面也达到了最佳性能。消融实验表明,自定义NMS、模糊帧过滤和统一语义等组件对UPPM的整体性能提升均有贡献。

🎯 应用场景

UPPM在机器人导航、场景理解、增强现实等领域具有广泛的应用前景。例如,机器人可以利用UPPM构建的环境地图进行自主导航和物体识别;在AR/VR应用中,UPPM可以用于创建更真实、更具交互性的虚拟场景。此外,该技术还可以应用于城市建模、自动驾驶等领域,具有重要的实际价值和未来影响。

📄 摘要(原文)

Panoptic maps enable robots to reason about both geometry and semantics. However, open-vocabulary models repeatedly produce closely related labels that split panoptic entities and degrade volumetric consistency. The proposed UPPM advances open-world scene understanding by leveraging foundation models to introduce a panoptic Dynamic Descriptor that reconciles open-vocabulary labels with unified category structure and geometric size priors. The fusion for such dynamic descriptors is performed within a multi-resolution multi-TSDF map using language-guided open-vocabulary panoptic segmentation and semantic retrieval, resulting in a persistent and promptable panoptic map without additional model training. Based on our evaluation experiments, UPPM shows the best overall performance in terms of the map reconstruction accuracy and the panoptic segmentation quality. The ablation study investigates the contribution for each component of UPPM (custom NMS, blurry-frame filtering, and unified semantics) to the overall system performance. Consequently, UPPM preserves open-vocabulary interpretability while delivering strong geometric and panoptic accuracy.