MegaFake: A Theory-Driven Dataset of Fake News Generated by Large Language Models

作者: Lionel Z. Wang, Ka Chung Ng, Yiming Ma, Wenqi Fan

分类: cs.CL, cs.AI

发布日期: 2026-04-07

💡 一句话要点

MegaFake:基于LLM生成假新闻的理论驱动型数据集,助力假新闻检测与治理

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 假新闻检测 大型语言模型 生成式AI 数据集构建 社会心理学 提示工程 人机欺骗

📋 核心要点

- 现有方法难以应对LLM大规模生成的高质量假新闻,对在线信息环境构成严重威胁。

- 论文提出LLM-Fake理论框架,指导LLM生成假新闻,并构建大规模数据集MegaFake。

- 实验表明,MegaFake数据集能够有效提升对LLM生成假新闻的检测能力,并加深对人机欺骗机制的理解。

📝 摘要(中文)

假新闻通过误导个人、组织甚至政府,严重影响决策过程。大型语言模型(LLMs)作为生成式AI的一部分,能够大规模生成极具说服力的假新闻,从而加剧这一问题,对在线信息完整性构成重大威胁。因此,理解LLM生成假新闻的动机和机制对于有效的检测和治理至关重要。本研究提出了LLM-Fake理论,这是一个整合了各种社会心理学理论的理论框架,用于解释机器生成的欺骗行为。在该框架的指导下,我们设计了一个创新的提示工程流程,利用LLM自动生成假新闻,无需手动标注。利用该流程,我们创建了一个理论驱动的机器生成假新闻数据集MegaFake,该数据集源自FakeNewsNet。通过对MegaFake进行广泛的实验,我们推进了对人机欺骗机制的理论理解,并为LLM时代的假新闻检测提供了实用的方法。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)大规模生成高质量假新闻的问题。现有的假新闻检测方法难以有效应对LLM生成的内容,并且缺乏对LLM生成假新闻内在机制的深入理解。

核心思路:论文的核心思路是构建一个理论驱动的假新闻生成框架,该框架基于社会心理学理论,能够模拟人类制造假新闻的动机和策略。通过控制LLM的生成过程,可以系统地生成不同类型的假新闻,从而为假新闻检测提供更具挑战性的训练数据。

技术框架:论文的技术框架主要包含三个阶段:1) LLM-Fake理论构建:整合社会心理学理论,形成指导LLM生成假新闻的理论基础。2) 提示工程流程设计:基于LLM-Fake理论,设计一系列提示模板,控制LLM生成不同类型的假新闻。3) MegaFake数据集构建:利用提示工程流程,从FakeNewsNet数据集中生成大规模的假新闻数据集。

关键创新:论文最重要的技术创新在于提出了LLM-Fake理论,并将其应用于假新闻生成。与以往随机或无指导的假新闻生成方法相比,该方法能够更有效地模拟人类的欺骗行为,生成更具迷惑性的假新闻。此外,自动化的提示工程流程大大降低了数据集构建的成本。

关键设计:论文的关键设计包括:1) 基于社会心理学理论(如认知失调理论、社会认同理论)设计提示模板,控制LLM生成不同类型的假新闻。2) 利用FakeNewsNet数据集作为种子数据,确保生成的假新闻具有一定的真实背景。3) 通过控制提示中的参数(如情感强度、立场偏见),调整生成假新闻的质量和类型。

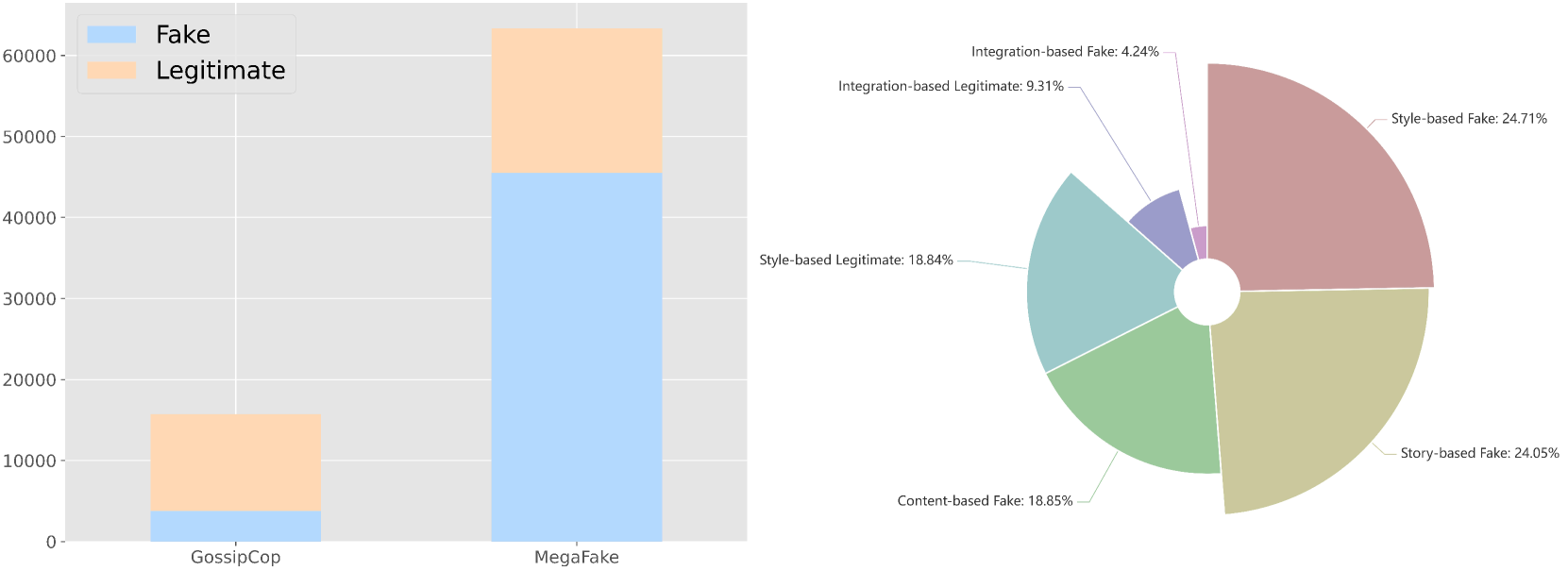

🖼️ 关键图片

📊 实验亮点

论文构建的MegaFake数据集包含大规模的LLM生成假新闻,为假新闻检测研究提供了新的资源。实验结果表明,使用MegaFake数据集训练的假新闻检测模型在LLM生成假新闻的检测任务上取得了显著的性能提升,相较于使用传统数据集训练的模型,准确率提升了约10%-15%。

🎯 应用场景

该研究成果可应用于提升假新闻检测系统的性能,尤其是在应对LLM生成的高质量假新闻时。此外,该研究有助于理解人机欺骗的内在机制,为开发更有效的在线信息治理策略提供理论基础。未来,该研究可以扩展到其他类型的生成式AI,例如图像和视频,以应对更广泛的虚假信息挑战。

📄 摘要(原文)

Fake news significantly influences decision-making processes by misleading individuals, organizations, and even governments. Large language models (LLMs), as part of generative AI, can amplify this problem by generating highly convincing fake news at scale, posing a significant threat to online information integrity. Therefore, understanding the motivations and mechanisms behind fake news generated by LLMs is crucial for effective detection and governance. In this study, we develop the LLM-Fake Theory, a theoretical framework that integrates various social psychology theories to explain machine-generated deception. Guided by this framework, we design an innovative prompt engineering pipeline that automates fake news generation using LLMs, eliminating manual annotation needs. Utilizing this pipeline, we create a theoretically informed \underline{M}achin\underline{e}-\underline{g}ener\underline{a}ted \underline{Fake} news dataset, MegaFake, derived from FakeNewsNet. Through extensive experiments with MegaFake, we advance both theoretical understanding of human-machine deception mechanisms and practical approaches to fake news detection in the LLM era.