Quick on the Uptake: Eliciting Implicit Intents from Human Demonstrations for Personalized Mobile-Use Agents

作者: Zheng Wu, Heyuan Huang, Yanjia Yang, Yuanyi Song, Xingyu Lou, Weiwen Liu, Weinan Zhang, Jun Wang, Zhuosheng Zhang

分类: cs.CL

发布日期: 2026-04-06

💡 一句话要点

提出IFRAgent框架,通过显式和隐式意图学习增强个性化移动代理

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 移动代理 意图识别 个性化 示范学习 隐式意图 显式意图

📋 核心要点

- 现有移动代理主要关注显式意图,忽略了用户个人偏好等隐式意图,导致个性化能力不足。

- IFRAgent框架通过分析显式意图构建标准操作程序库,分析隐式意图构建用户习惯知识库,实现个性化。

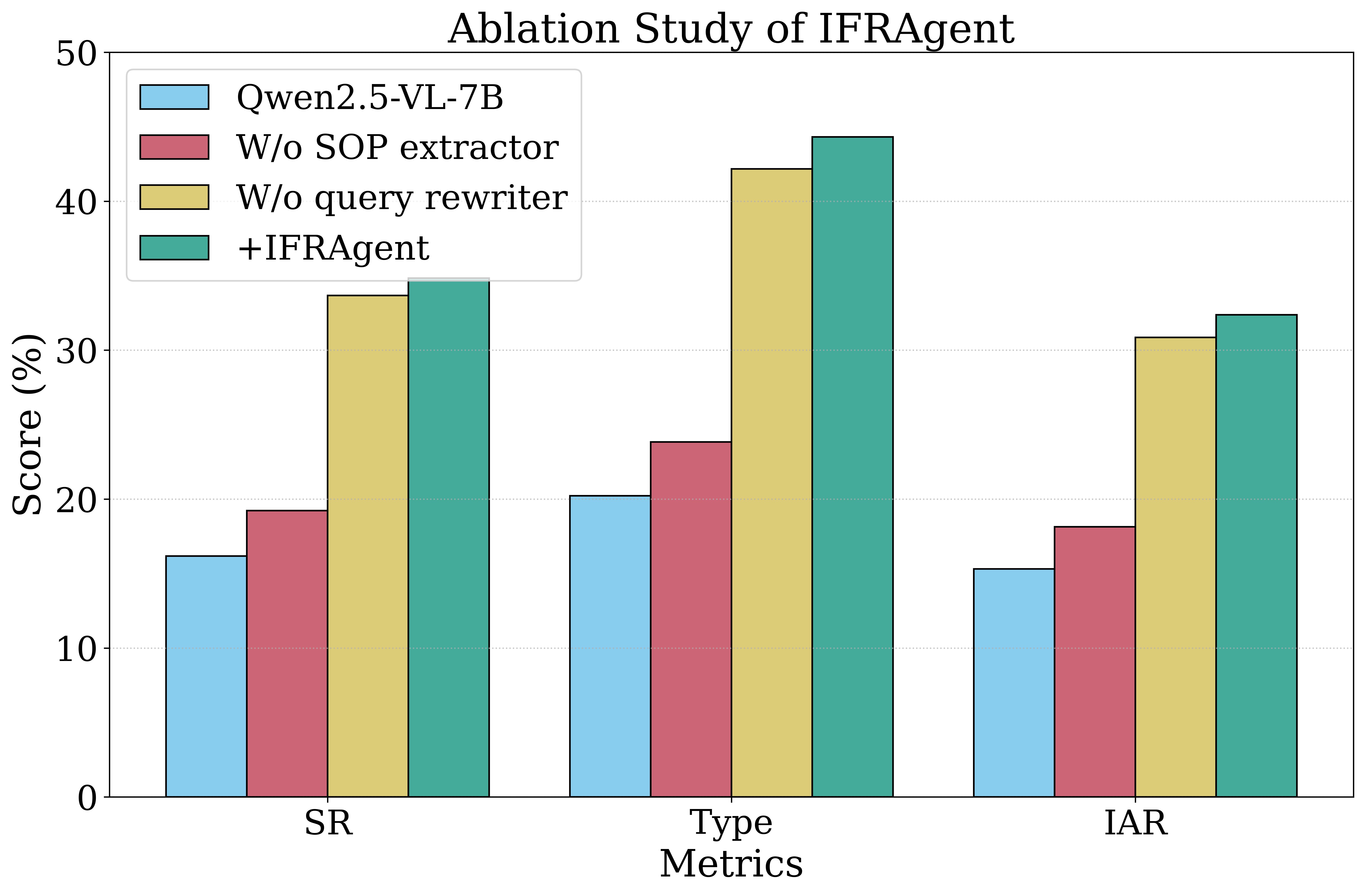

- 实验表明,IFRAgent在人类意图对齐率和步骤完成率上均显著优于现有基线方法,提升明显。

📝 摘要(中文)

随着多模态大型语言模型的快速发展,通过模仿人机界面交互的移动代理实现移动任务自动化变得越来越可行。为了进一步增强移动代理,以往的研究采用示范学习来改进移动代理。然而,这些方法仅关注人类的显式意图流(例如,步骤序列),而忽略了隐式意图流(例如,个人偏好),这使得构建个性化的移动代理变得困难。在这项工作中,为了评估移动代理和人类之间的 extbf{意图对齐率},我们首先收集了 extbf{MobileIAR}数据集,其中包含人类意图对齐的动作和真实动作,从而能够全面评估代理对人类意图的理解。然后,我们提出了一个基于人类演示的 extbf{意图流识别}的框架 extbf{IFRAgent}。IFRAgent分析人类演示中的显式意图流,构建标准操作程序(SOP)的查询级向量库,并分析隐式意图流,构建用户级习惯知识库。然后,IFRAgent利用SOP提取器结合检索增强生成和查询重写器,从原始模糊查询中生成个性化的查询和SOP,从而增强移动代理和人类意图之间的对齐。实验结果表明,IFRAgent在人类意图对齐率方面平均优于基线6.79%(相对提升32.06%),在步骤完成率方面平均提高了5.30%(相对提升26.34%)。代码可在该URL获得。

🔬 方法详解

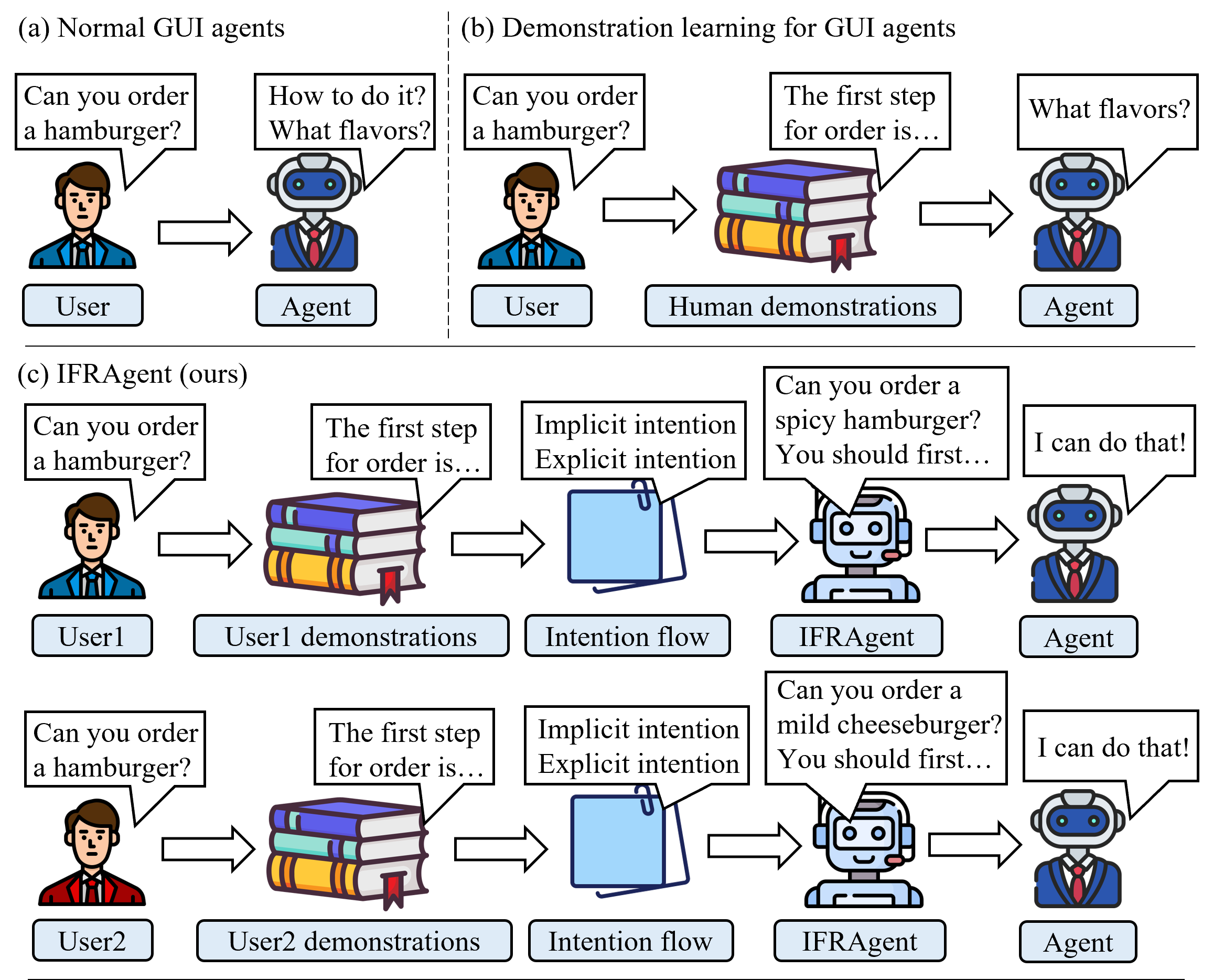

问题定义:现有移动代理主要依赖于显式的用户指令序列,缺乏对用户隐式意图(如个人偏好、习惯等)的理解,导致无法提供个性化的服务。这限制了移动代理在实际应用中的效果和用户体验。

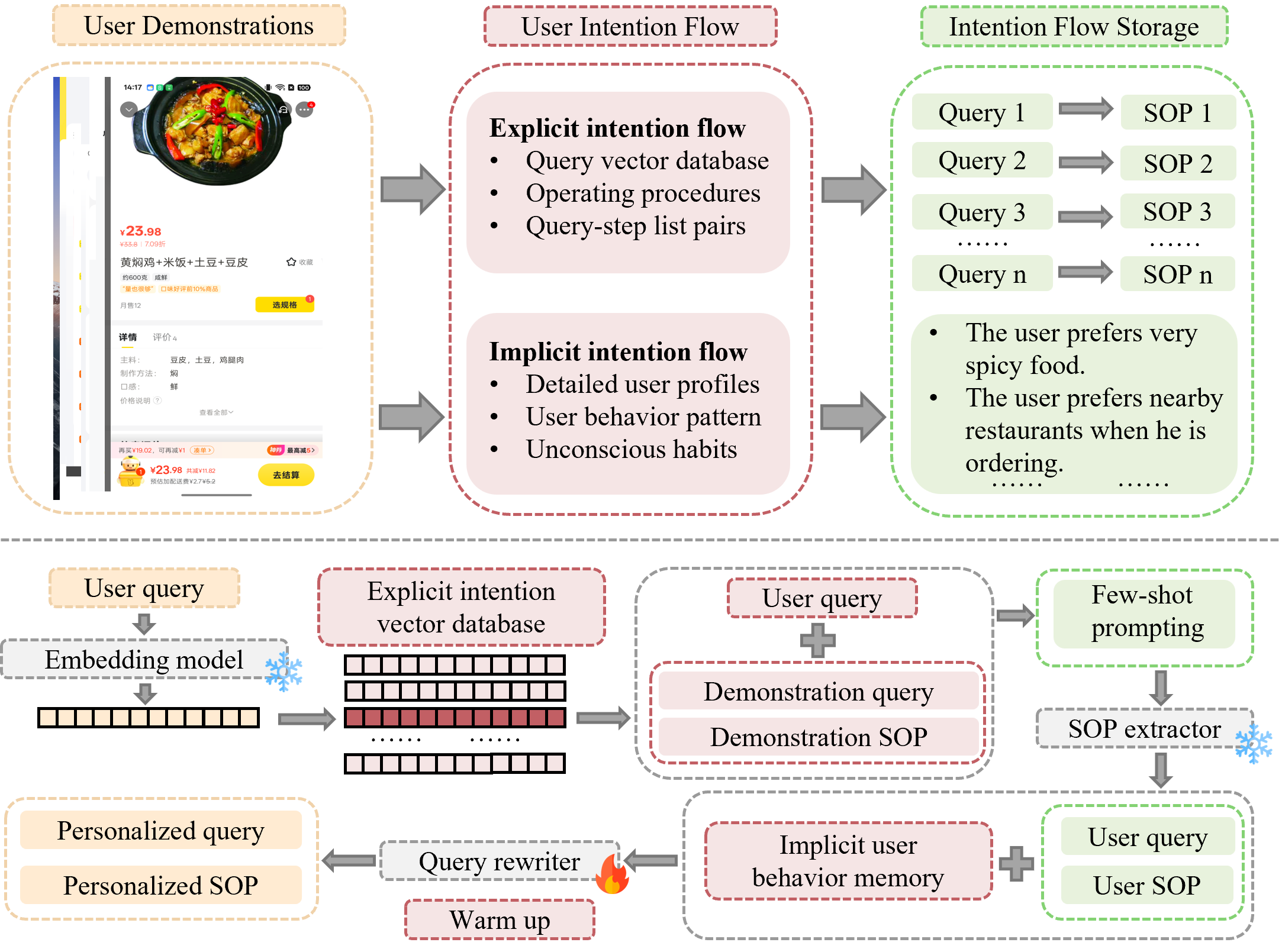

核心思路:IFRAgent的核心思路是从人类的演示数据中同时学习显式和隐式意图。显式意图对应于完成任务的标准操作流程(SOP),而隐式意图则反映用户的个性化习惯和偏好。通过结合这两种意图,IFRAgent能够更准确地理解用户的真实意图,并生成个性化的操作指令。

技术框架:IFRAgent框架主要包含以下几个模块:1) MobileIAR数据集:包含人类意图对齐的动作和真实动作,用于评估意图对齐率。2) 意图流识别模块:分析人类演示中的显式意图流,构建标准操作程序(SOP)的查询级向量库;分析隐式意图流,构建用户级习惯知识库。3) 个性化查询生成模块:利用SOP提取器结合检索增强生成和查询重写器,从原始模糊查询中生成个性化的查询和SOP。

关键创新:该论文的关键创新在于同时考虑了显式和隐式意图,并设计了相应的学习机制。与现有方法只关注显式指令序列不同,IFRAgent能够从用户的演示数据中学习用户的个性化习惯和偏好,从而提供更个性化的服务。

关键设计:IFRAgent的关键设计包括:1) 如何从演示数据中区分和提取显式和隐式意图;2) 如何构建和维护标准操作程序库和用户习惯知识库;3) 如何利用检索增强生成和查询重写器生成个性化的查询和SOP。具体的技术细节(如损失函数、网络结构等)在论文中应该有更详细的描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,IFRAgent在人类意图对齐率方面平均优于基线方法6.79%(相对提升32.06%),在步骤完成率方面平均提高了5.30%(相对提升26.34%)。这些数据表明,IFRAgent能够更准确地理解用户的意图,并生成更有效的操作指令,从而显著提升移动代理的性能。

🎯 应用场景

该研究成果可应用于各种需要个性化服务的移动应用场景,例如智能助手、自动化任务执行、个性化推荐等。通过理解用户的隐式意图,移动代理可以更准确地预测用户的需求,并提供更贴心的服务,从而提升用户体验和应用价值。未来,该技术还可以扩展到其他领域,例如智能家居、智能医疗等。

📄 摘要(原文)

As multimodal large language models advance rapidly, the automation of mobile tasks has become increasingly feasible through the use of mobile-use agents that mimic human interactions from graphical user interface. To further enhance mobile-use agents, previous studies employ demonstration learning to improve mobile-use agents from human demonstrations. However, these methods focus solely on the explicit intention flows of humans (e.g., step sequences) while neglecting implicit intention flows (e.g., personal preferences), which makes it difficult to construct personalized mobile-use agents. In this work, to evaluate the \textbf{I}ntention \textbf{A}lignment \textbf{R}ate between mobile-use agents and humans, we first collect \textbf{MobileIAR}, a dataset containing human-intent-aligned actions and ground-truth actions. This enables a comprehensive assessment of the agents' understanding of human intent. Then we propose \textbf{IFRAgent}, a framework built upon \textbf{I}ntention \textbf{F}low \textbf{R}ecognition from human demonstrations. IFRAgent analyzes explicit intention flows from human demonstrations to construct a query-level vector library of standard operating procedures (SOP), and analyzes implicit intention flows to build a user-level habit repository. IFRAgent then leverages a SOP extractor combined with retrieval-augmented generation and a query rewriter to generate personalized query and SOP from a raw ambiguous query, enhancing the alignment between mobile-use agents and human intent. Experimental results demonstrate that IFRAgent outperforms baselines by an average of 6.79\% (32.06\% relative improvement) in human intention alignment rate and improves step completion rates by an average of 5.30\% (26.34\% relative improvement). The codes are available atthis https URL.