TildeOpen LLM: Leveraging Curriculum Learning to Achieve Equitable Language Representation

作者: Toms Bergmanis, Martins Kronis, Ingus Jānis Pretkalniņš, Dāvis Nicmanis, Jeļizaveta Jeļinska, Roberts Rozis, Rinalds Vīksna, Mārcis Pinnis

分类: cs.CL, cs.AI

发布日期: 2026-03-09

备注: LREC 2026

💡 一句话要点

TildeOpen LLM:利用课程学习实现公平的语言表征

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多语言模型 低资源语言 课程学习 语言公平 开放权重

📋 核心要点

- 现有大型语言模型在非英语语言上表现欠佳,主要原因是训练数据中英语等高资源语言占主导。

- TildeOpen LLM采用数据集上采样和课程学习相结合的训练策略,平衡不同语言的数据分布。

- 实验结果表明,TildeOpen LLM在多种欧洲语言上超越了现有开放权重模型,尤其是在低资源语言上。

📝 摘要(中文)

大型语言模型在许多欧洲语言上的表现不佳,这主要是由于英语和少数高资源语言在训练数据中占据主导地位。本文提出了TildeOpen LLM,一个拥有300亿参数的开放权重基础模型,针对34种欧洲语言进行训练,旨在促进语言公平并提高低资源语言的性能。为了解决数据不平衡问题,我们将数据集上采样与基于课程的学习训练计划相结合,该计划在均匀和自然语言分布之间交替。结果表明,尽管训练计算资源明显减少,但该模型与其它多语言LLM相比表现良好。在多个多语言基准测试中的评估表明,TildeOpen在文本生成和理解方面超越了现有的开放权重模型,尤其是在波罗的海语、芬兰-乌戈尔语和斯拉夫语方面。人工评估证实,相对于领先的基线模型,语言错误减少了高达十倍。该模型和相关资源完全开放权重,并在huggingface.co/TildeAI/TildeOpen-30b上公开提供。这些结果表明,仔细的数据管理和平衡的训练策略可以在不增加模型大小或训练量的情况下,显著提高多语言模型的质量。

🔬 方法详解

问题定义:现有大型语言模型在多语言环境下面临着严重的语言不平衡问题,导致在低资源语言上的性能显著低于高资源语言。现有的多语言模型训练方法往往侧重于高资源语言,忽略了低资源语言的充分学习,从而加剧了这种不平衡。因此,如何有效地利用有限的低资源语言数据,提升模型在这些语言上的表现,是一个亟待解决的问题。

核心思路:TildeOpen LLM的核心思路是通过课程学习(Curriculum Learning)策略,逐步引导模型学习不同语言。具体来说,模型首先在均匀分布的数据上进行训练,确保所有语言都被平等地学习。然后,模型逐渐过渡到在自然分布的数据上进行训练,以适应真实世界中不同语言的频率。这种课程学习策略能够有效地解决数据不平衡问题,提升模型在低资源语言上的表现。

技术框架:TildeOpen LLM的整体训练框架包括以下几个主要阶段:1) 数据准备:收集并清洗34种欧洲语言的文本数据,并进行数据集上采样,增加低资源语言的数据量。2) 预训练:使用基于Transformer的语言模型架构,在预处理后的数据上进行预训练。3) 课程学习:采用课程学习策略,交替使用均匀分布和自然分布的数据进行训练。4) 评估:在多个多语言基准测试中评估模型的性能,并进行人工评估。

关键创新:TildeOpen LLM的关键创新在于将课程学习策略应用于多语言模型的训练中。与传统的训练方法相比,课程学习能够更好地平衡不同语言的学习,提升模型在低资源语言上的表现。此外,该模型采用了开放权重的设计,方便研究人员和开发者使用和改进。

关键设计:TildeOpen LLM的关键设计包括:1) 数据集上采样:通过复制或生成低资源语言的数据,增加其在训练数据中的比例。2) 课程学习计划:设计一个合理的课程学习计划,逐步从均匀分布过渡到自然分布。3) 模型架构:采用基于Transformer的语言模型架构,并进行适当的调整以适应多语言环境。4) 损失函数:使用交叉熵损失函数进行训练,并根据不同语言的权重进行调整。

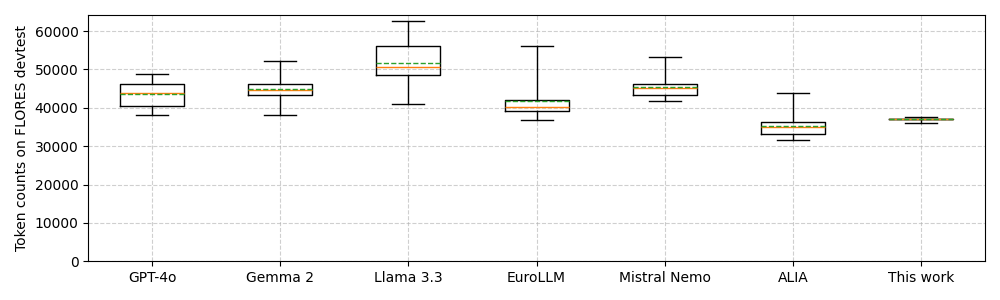

🖼️ 关键图片

📊 实验亮点

TildeOpen LLM在多个多语言基准测试中取得了显著的成果。尤其是在波罗的海语、芬兰-乌戈尔语和斯拉夫语等低资源语言上,该模型超越了现有的开放权重模型。人工评估表明,TildeOpen LLM的语言错误率比领先的基线模型降低了高达十倍,证明了其在提高多语言模型质量方面的有效性。

🎯 应用场景

TildeOpen LLM在机器翻译、跨语言信息检索、多语言文本生成等领域具有广泛的应用前景。它可以用于开发更公平、更高效的多语言应用,促进不同语言之间的交流和理解。此外,该模型还可以作为研究多语言学习和低资源语言处理的基础平台,推动相关领域的发展。

📄 摘要(原文)

Large language models often underperform in many European languages due to the dominance of English and a few high-resource languages in training data. This paper presents TildeOpen LLM, a 30-billion-parameter open-weight foundational model trained for 34 European languages to promote linguistic equity and improve performance for low-resource languages. To address the data imbalance, we combine dataset upsampling with a curriculum-based training schedule that alternates between uniform and natural language distributions. The resulting model performs favorably compared to other multilingual LLMs despite being trained with significantly fewer computing resources. Evaluation across multiple multilingual benchmarks shows that TildeOpen surpasses existing open-weight models in text generation and comprehension, particularly for Baltic, Finno-Ugric, and Slavic languages. Human evaluations confirm an up to tenfold reduction in linguistic errors relative to leading baselines. The model and associated resources are fully open-weight and publicly available at huggingface.co/TildeAI/TildeOpen-30b. These outcomes demonstrate that careful data curation and balanced training strategies can substantially enhance multilingual model quality without increasing model size or training volume.